Document Reconstruction Unlocks Scalable Long-Context RLVR

作者: Yao Xiao, Lei Wang, Yue Deng, Guanzheng Chen, Ziqi Jin, Jung-jae Kim, Xiaoli Li, Roy Ka-wei Lee, Lidong Bing

分类: cs.CL

发布日期: 2026-02-28

💡 一句话要点

提出基于文档重构的无监督RLVR方法,提升LLM长文本处理能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本处理 强化学习 无监督学习 文档重构 大型语言模型

📋 核心要点

- 现有RLVR方法依赖于高质量标注或教师模型,成本高昂且耗时,限制了其可扩展性。

- 论文提出一种基于文档重构的无监督RLVR方法,通过训练LLM恢复被遮蔽的文档来学习长文本依赖。

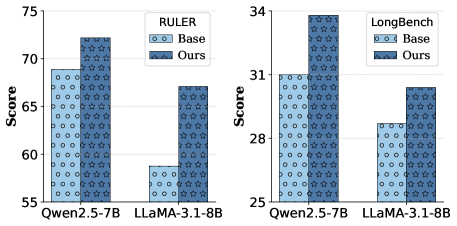

- 实验表明,该方法在RULER上取得显著提升,并在LongBench v2上实现了合理的改进,无需人工标注。

📝 摘要(中文)

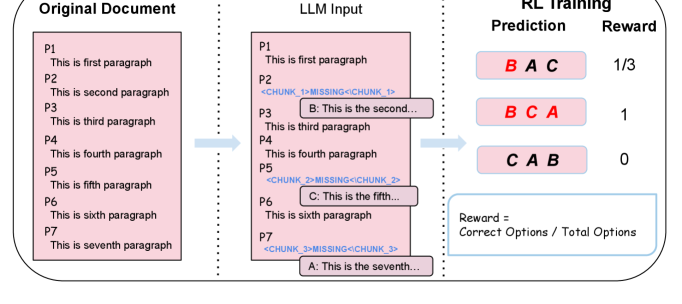

本文提出了一种无监督方法,旨在提升大型语言模型(LLM)的长文本处理能力,无需人工标注或教师模型的监督。该方法通过强化学习训练LLM,使其能够重构被部分遮蔽的长文档。具体而言,首先将长文档中的若干段落替换为特殊占位符,然后训练LLM从候选段落集合中正确识别并排序缺失的段落,从而完成文档重构。这种训练范式使模型能够捕捉全局叙事连贯性,显著提升长文本处理性能。在RULER和LongBench v2两个基准测试上的实验结果表明,该方法在RULER上取得了显著提升,并且在LongBench v2上实现了合理的改进,而无需任何手动标注的长文本问答数据。此外,还进行了大量的消融研究,以分析奖励设计、数据管理策略、训练方案和数据规模效应对模型性能的影响。代码、数据和模型已公开。

🔬 方法详解

问题定义:现有基于强化学习与可验证奖励(RLVR)的方法在提升大型语言模型(LLM)的长文本处理能力时,通常依赖于人工标注的标准答案或强大的教师模型提供的显式评估规则。这些方法成本高昂且耗时,限制了其可扩展性。因此,如何以无监督的方式提升LLM的长文本处理能力是一个关键问题。

核心思路:论文的核心思路是利用文档自身的结构信息进行自监督学习。具体来说,通过将长文档中的部分段落遮蔽,然后训练LLM来重构这些被遮蔽的段落,从而使模型学习到文档的全局叙事连贯性。这种方法无需人工标注或教师模型的监督,降低了训练成本。

技术框架:整体框架包括以下几个步骤:1) 数据准备:从长文档中随机选择若干段落进行遮蔽,生成带有占位符的文档。2) 候选段落生成:将被遮蔽的段落作为候选答案。3) 模型训练:使用强化学习训练LLM,使其能够从候选段落中选择正确的段落并按照正确的顺序进行重构。4) 奖励函数设计:奖励函数用于评估模型重构文档的质量,例如可以使用重构段落与原始段落之间的相似度作为奖励。

关键创新:该方法最重要的创新点在于提出了基于文档重构的无监督RLVR方法。与传统的RLVR方法相比,该方法无需人工标注或教师模型的监督,降低了训练成本,提高了可扩展性。此外,该方法利用文档自身的结构信息进行自监督学习,能够更好地捕捉文档的全局叙事连贯性。

关键设计:在数据准备阶段,需要确定遮蔽段落的数量和位置。在模型训练阶段,需要选择合适的强化学习算法和奖励函数。奖励函数的设计至关重要,需要能够准确地评估模型重构文档的质量。此外,还需要考虑数据规模对模型性能的影响,并进行相应的数据增强。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在RULER数据集上取得了显著的性能提升,同时在LongBench v2数据集上也实现了合理的改进,而无需任何手动标注的长文本问答数据。这表明该方法能够有效地提升LLM的长文本处理能力,并且具有良好的泛化能力。具体的性能数据和提升幅度在论文中进行了详细的展示。

🎯 应用场景

该研究成果可应用于各种需要处理长文本的场景,例如长篇小说生成、法律文档分析、科技论文摘要等。通过提升LLM的长文本处理能力,可以提高这些应用场景的效率和质量。此外,该方法无需人工标注,降低了训练成本,使其更易于部署和应用。

📄 摘要(原文)

Reinforcement Learning with Verifiable Rewards~(RLVR) has become a prominent paradigm to enhance the capabilities (i.e.\ long-context) of Large Language Models~(LLMs). However, it often relies on gold-standard answers or explicit evaluation rubrics provided by powerful teacher models or human experts, which are costly and time-consuming. In this work, we investigate unsupervised approaches to enhance the long-context capabilities of LLMs, eliminating the need for heavy human annotations or teacher models' supervision. Specifically, we first replace a few paragraphs with special placeholders in a long document. LLMs are trained through reinforcement learning to reconstruct the document by correctly identifying and sequencing missing paragraphs from a set of candidate options. This training paradigm enables the model to capture global narrative coherence, significantly boosting long-context performance. We validate the effectiveness of our method on two widely used benchmarks, RULER and LongBench~v2. While acquiring noticeable gains on RULER, it can also achieve a reasonable improvement on LongBench~v2 without any manually curated long-context QA data. Furthermore, we conduct extensive ablation studies to analyze the impact of reward design, data curation strategies, training schemes, and data scaling effects on model performance. We publicly release our code, data, and models.