Knowledge Distillation with Structured Chain-of-Thought for Text-to-SQL

作者: Khushboo Thaker, Yony Bresler

分类: cs.CL, cs.AI, cs.DB

发布日期: 2026-02-28

💡 一句话要点

提出Struct-SQL框架,利用结构化CoT蒸馏提升Text-to-SQL小模型的性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Text-to-SQL 知识蒸馏 思维链 结构化推理 查询执行计划

📋 核心要点

- 企业部署Text-to-SQL系统面临LLM成本高昂和SLM性能不足的难题。

- Struct-SQL框架利用查询执行计划作为结构化CoT,指导SLM学习推理。

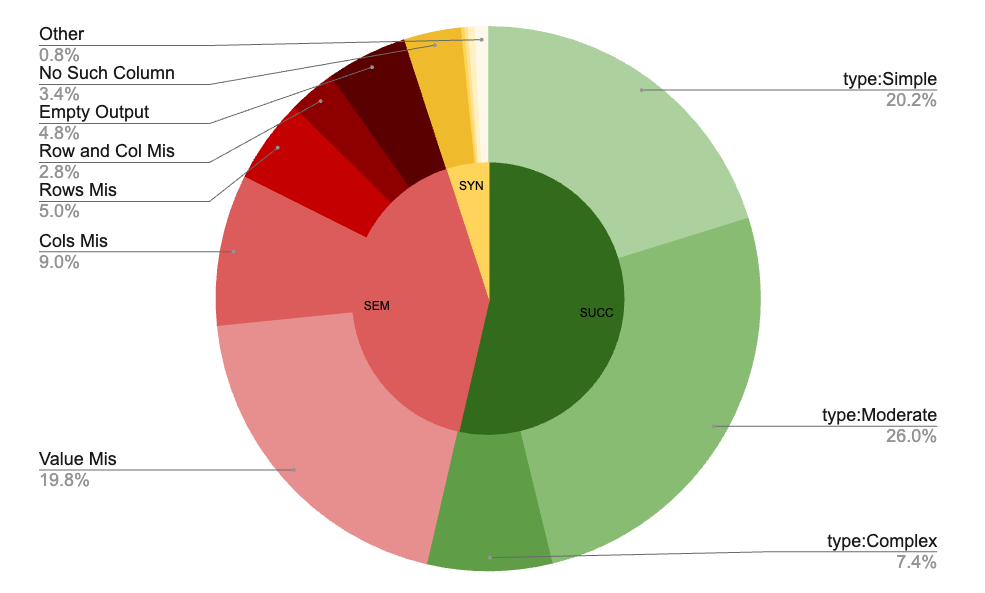

- 实验表明,结构化CoT蒸馏显著提升SLM的SQL生成性能,尤其减少了句法错误。

📝 摘要(中文)

在企业级部署精确的Text-to-SQL系统面临成本、安全和性能的三难困境。目前的解决方案迫使企业在昂贵的专有大型语言模型(LLM)和低性能的小型语言模型(SLM)之间做出选择。改进SLM的努力通常依赖于使用非结构化的思维链(CoT)轨迹从大型LLM中提取推理能力,但这个过程本质上是模糊的。我们假设,形式化的、结构化的推理表示提供了一个更清晰、更可靠的教学信号,因为Text-to-SQL任务需要明确和精确的逻辑步骤。为了评估这个假设,我们提出了Struct-SQL,这是一个新颖的知识蒸馏(KD)框架,用于训练SLM来模仿强大的大型LLM。因此,我们采用查询执行计划作为正式的蓝图来推导出这种结构化的推理。我们的SLM,通过结构化的CoT进行蒸馏,比非结构化的CoT蒸馏基线实现了8.1%的绝对改进。详细的错误分析表明,这种提升的一个关键因素是句法错误的显著减少。这表明,使用结构化的逻辑蓝图来教导模型进行推理对于SLM中可靠的SQL生成是有益的。

🔬 方法详解

问题定义:论文旨在解决Text-to-SQL任务中,小型语言模型(SLM)性能不足的问题。现有方法通常采用非结构化的思维链(CoT)进行知识蒸馏,但这种方法存在模糊性,导致SLM难以准确学习大型语言模型(LLM)的推理过程。

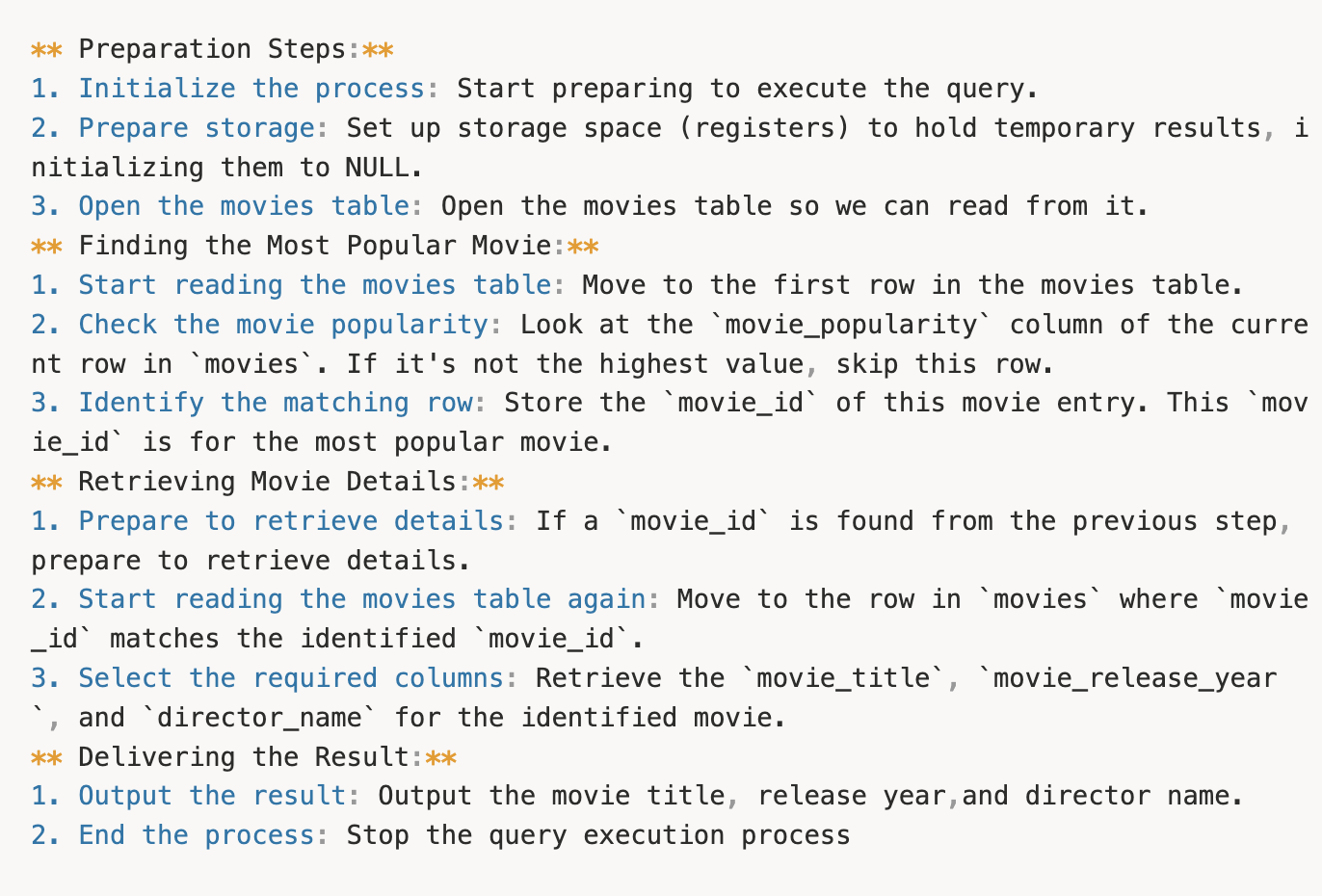

核心思路:论文的核心思路是利用结构化的推理表示,即查询执行计划,作为知识蒸馏的教学信号。查询执行计划能够提供明确和精确的逻辑步骤,从而更有效地指导SLM学习LLM的推理能力。

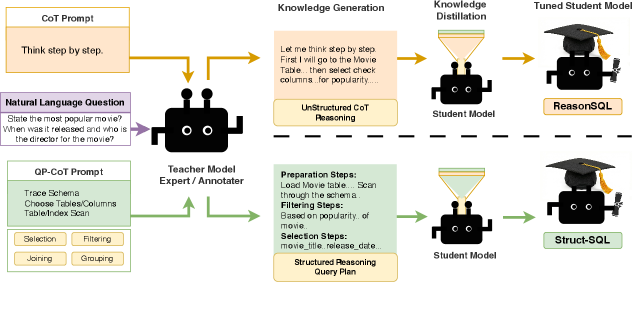

技术框架:Struct-SQL框架是一个知识蒸馏(KD)框架,包含以下主要阶段:首先,使用大型LLM生成Text-to-SQL任务的查询执行计划;然后,将这些查询执行计划作为结构化的CoT数据,用于训练SLM;最后,评估SLM在Text-to-SQL任务上的性能。

关键创新:Struct-SQL的关键创新在于使用查询执行计划作为结构化的CoT进行知识蒸馏。与传统的非结构化CoT相比,结构化的CoT能够提供更清晰、更可靠的教学信号,从而显著提升SLM的性能。

关键设计:论文采用查询执行计划作为结构化CoT,具体实现细节未知。损失函数的设计可能包括模仿学习损失,用于使SLM生成的查询执行计划尽可能接近LLM生成的查询执行计划。网络结构方面,SLM可以采用Transformer架构,并针对Text-to-SQL任务进行微调。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用结构化CoT蒸馏的SLM比使用非结构化CoT蒸馏的基线模型在Text-to-SQL任务上实现了8.1%的绝对性能提升。详细的错误分析表明,这种提升主要归功于句法错误的显著减少,证明了结构化推理对于SLM学习SQL生成的重要性。

🎯 应用场景

该研究成果可应用于企业级Text-to-SQL系统,在保证安全和降低成本的同时,提升系统的性能。通过使用蒸馏后的SLM,企业可以避免依赖昂贵的专有LLM,从而降低运营成本。此外,该方法还可以推广到其他需要精确逻辑推理的任务中,例如代码生成和数学问题求解。

📄 摘要(原文)

Deploying accurate Text-to-SQL systems at the enterprise level faces a difficult trilemma involving cost, security and performance. Current solutions force enterprises to choose between expensive, proprietary Large Language Models (LLMs) and low-performing Small Language Models (SLMs). Efforts to improve SLMs often rely on distilling reasoning from large LLMs using unstructured Chain-of-Thought (CoT) traces, a process that remains inherently ambiguous. Instead, we hypothesize that a formal, structured reasoning representation provides a clearer, more reliable teaching signal, as the Text-to-SQL task requires explicit and precise logical steps. To evaluate this hypothesis, we propose Struct-SQL, a novel Knowledge Distillation (KD) framework that trains an SLM to emulate a powerful large LLM. Consequently, we adopt a query execution plan as a formal blueprint to derive this structured reasoning. Our SLM, distilled with structured CoT, achieves an absolute improvement of 8.1% over an unstructured CoT distillation baseline. A detailed error analysis reveals that a key factor in this gain is a marked reduction in syntactic errors. This demonstrates that teaching a model to reason using a structured logical blueprint is beneficial for reliable SQL generation in SLMs.