Revisiting Self-Play Preference Optimization: On the Role of Prompt Difficulty

作者: Yao Xiao, Jung-jae Kim, Roy Ka-wei Lee, Lidong Bing

分类: cs.CL

发布日期: 2026-02-28

💡 一句话要点

研究提示词难度对自博弈偏好优化性能的影响,并提出优化策略。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自博弈偏好优化 提示词难度 语言模型对齐 奖励模型 直接偏好优化

📋 核心要点

- 现有自博弈偏好优化方法中,提示词的作用未被充分探索,不同难度的提示词对模型训练的影响尚不明确。

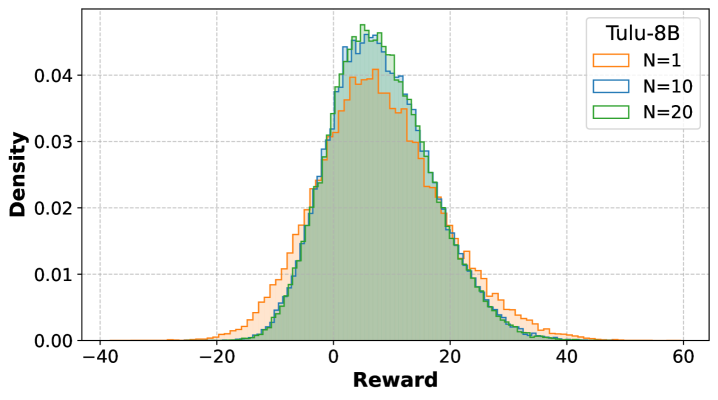

- 该研究通过平均奖励来衡量提示词难度,分析不同难度提示词对自博弈优化性能的影响,并提出优化策略。

- 实验表明,仅使用30%的最简单提示词进行训练,可以有效提升AlpacaEval~2和Arena-Hard上的模型性能。

📝 摘要(中文)

自博弈偏好优化已成为对齐大型语言模型(LLM)的重要范式。它通常涉及一个语言模型为提示词生成on-policy的回复,以及一个奖励模型(RM)来指导选择chosen和rejected的回复,这些回复可以使用直接偏好优化(DPO)进一步训练。然而,提示词作为该流程的核心组成部分,其作用仍未被充分探索。本文研究了不同难度的提示词如何影响自博弈偏好优化。我们使用提示词的采样回复的平均奖励作为其难度的代理。我们首先发现,对于语言模型来说,困难的提示词表现出比简单的提示词差得多的自博弈优化性能。此外,将困难的提示词纳入训练并不能提高整体性能,实际上,与仅在简单提示词上训练相比,会导致轻微的性能下降。第三,随着提示词难度的降低,优化性能呈现明显的上升趋势。我们还观察到,随着模型容量的增加,困难和简单提示词之间的性能差距趋于缩小,这表明提示词难度与模型容量相互作用。基于这些发现,我们探索了减轻困难提示词对最终性能的不利影响的策略。我们证明,仅在小部分(30%)最简单的提示词上进行训练可以提高AlpacaEval~2和Arena-Hard上的整体自博弈性能。我们还报告了失败的尝试和经验教训。

🔬 方法详解

问题定义:论文旨在解决自博弈偏好优化(Self-Play Preference Optimization, SPPO)中提示词难度对模型训练效果的影响问题。现有方法通常忽略了提示词难度的差异,导致模型在困难提示词上表现不佳,影响整体性能。

核心思路:论文的核心思路是研究提示词难度与SPPO性能之间的关系,并提出相应的优化策略。通过将提示词的平均奖励作为其难度的代理指标,分析不同难度提示词对模型训练的影响,从而找到提升SPPO性能的方法。

技术框架:整体流程包括:1) 使用语言模型为提示词生成回复;2) 使用奖励模型(RM)评估回复质量,并选择chosen和rejected的回复;3) 使用直接偏好优化(DPO)训练模型。论文重点关注提示词的选择,并提出仅使用简单提示词进行训练的策略。

关键创新:论文的关键创新在于发现了提示词难度对SPPO性能的显著影响,并提出了通过筛选简单提示词来提升模型性能的策略。这与以往忽略提示词难度的方法不同,为SPPO的优化提供了新的视角。

关键设计:论文的关键设计包括:1) 使用平均奖励作为提示词难度的衡量标准;2) 分析不同难度提示词对模型训练的影响;3) 实验验证仅使用30%最简单提示词进行训练的效果。没有涉及特定的损失函数或网络结构创新。

🖼️ 关键图片

📊 实验亮点

实验结果表明,困难的提示词会导致自博弈优化性能下降,而仅使用30%的最简单提示词进行训练可以显著提高AlpacaEval~2和Arena-Hard上的模型性能。这表明提示词难度是影响SPPO性能的重要因素,选择合适的提示词可以有效提升模型性能。

🎯 应用场景

该研究成果可应用于各种需要使用自博弈偏好优化来对齐大型语言模型的场景,例如对话系统、文本生成、代码生成等。通过选择合适的提示词,可以提高模型的训练效率和生成质量,从而提升用户体验和应用价值。未来的研究可以进一步探索更精细的提示词难度控制方法。

📄 摘要(原文)

Self-play preference optimization has emerged as a prominent paradigm for aligning large language models (LLMs). It typically involves a language model to generate on-policy responses for prompts and a reward model (RM) to guide the selection of chosen and rejected responses, which can be further trained with direct preference optimization (DPO). However, the role of prompts remains underexplored, despite being a core component in this pipeline. In this work, we investigate how prompts of varying difficulty influence self-play preference optimization. We use the mean reward ofsampled responses of a prompt as a proxy for its difficulty. We first find that difficult prompts exhibit substantially inferior self-play optimization performance compared to easy prompts for language models. Moreover, incorporating difficult prompts into training fails to enhance overall performance and, in fact, leads to slight degradation compared to training on easy prompts alone. Third, there is a clear upward trend in optimization performance as prompt difficulty decreases. We also observe that the performance gap between difficult and easy prompts tends to close as the model capacity increases, suggesting that prompt difficulty interacts with the model capacity. Building on these findings, we explore strategies to mitigate the adversary effect of difficult prompts on final performance. We demonstrate that only training on a small portion (30%) of the easiest prompts improves overall self-play performance on AlpacaEval~2 and Arena-Hard. We also report failed attempts and lessons learned.