Generative Pseudo-Labeling for Pre-Ranking with LLMs

作者: Junyu Bi, Xinting Niu, Daixuan Cheng, Kun Yuan, Tao Wang, Binbin Cao, Jian Wu, Yuning Jiang

分类: cs.IR, cs.CL

发布日期: 2026-02-24

💡 一句话要点

提出GPL框架,利用LLM生成伪标签解决预排序中的训练-服务偏差问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 预排序 生成式伪标签 大型语言模型 训练-服务偏差 推荐系统 长尾物品 内容感知 用户兴趣建模

📋 核心要点

- 预排序模型面临训练数据仅包含已曝光物品,而服务时需对所有候选物品打分的训练-服务偏差问题。

- GPL框架利用LLM生成无偏的、内容感知的伪标签,弥合训练和服务的分布差异,提升模型泛化能力。

- 实验表明,GPL在实际生产系统中显著提升了点击率、推荐多样性和长尾物品的发现能力。

📝 摘要(中文)

预排序是工业推荐系统中的关键环节,负责为下游排序阶段高效地对数千个召回物品进行打分。一个主要挑战是训练-服务差异:预排序模型仅在已曝光的交互数据上训练,但必须对所有召回的候选物品(包括未曝光的物品)进行在线打分。这种不匹配不仅导致严重的样本选择偏差,还会降低泛化能力,尤其对于长尾内容。现有的去偏方法通常依赖于启发式方法(例如,负采样)或从有偏排序器中进行知识蒸馏,这要么将合理的未曝光物品错误地标记为负样本,要么将曝光偏差传播到伪标签中。本文提出了生成式伪标签(GPL)框架,该框架利用大型语言模型(LLM)为未曝光物品生成无偏的、内容感知的伪标签,从而显式地将训练分布与在线服务空间对齐。通过离线生成用户特定的兴趣锚点,并在冻结的语义空间中将它们与候选物品进行匹配,GPL提供了高质量的监督,而不会增加在线延迟。在大型生产系统中部署后,GPL将点击率提高了3.07%,同时显著提高了推荐多样性和长尾物品的发现。

🔬 方法详解

问题定义:预排序模型在工业推荐系统中至关重要,但其训练数据通常仅限于已曝光的交互数据,导致模型在服务阶段对未曝光物品的打分存在偏差,即训练-服务偏差。现有方法如负采样或知识蒸馏,要么引入新的偏差,要么无法有效解决长尾物品的泛化问题。

核心思路:GPL的核心思路是利用大型语言模型(LLM)的强大生成能力,为未曝光的物品生成高质量的伪标签。通过LLM理解用户兴趣和物品内容,从而生成更准确、更无偏的训练数据,显式地对齐训练和服务的分布。

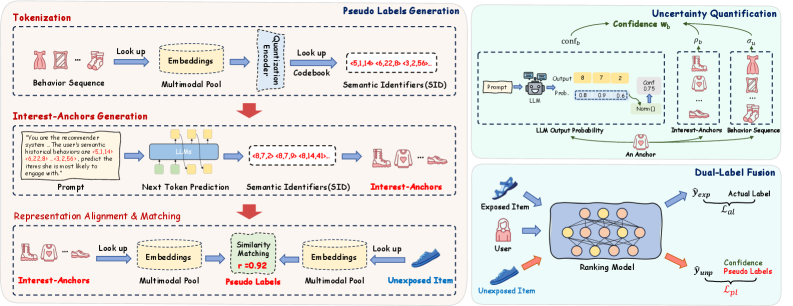

技术框架:GPL框架包含以下主要阶段:1) 用户兴趣锚点生成:利用LLM根据用户历史行为生成用户特定的兴趣锚点,这些锚点代表了用户潜在的兴趣方向。2) 候选物品语义表示:将候选物品嵌入到一个冻结的语义空间中,获得其内容表示。3) 伪标签生成:将用户兴趣锚点与候选物品的语义表示进行匹配,生成伪标签,表示用户对该物品的潜在兴趣程度。4) 模型训练:使用生成的伪标签对预排序模型进行训练,使其能够更好地对未曝光物品进行打分。

关键创新:GPL的关键创新在于利用LLM生成无偏的伪标签,从而显式地解决了预排序中的训练-服务偏差问题。与传统的负采样或知识蒸馏方法不同,GPL不依赖于已曝光数据或有偏排序器,而是直接从内容和用户兴趣出发,生成更准确、更可靠的训练数据。

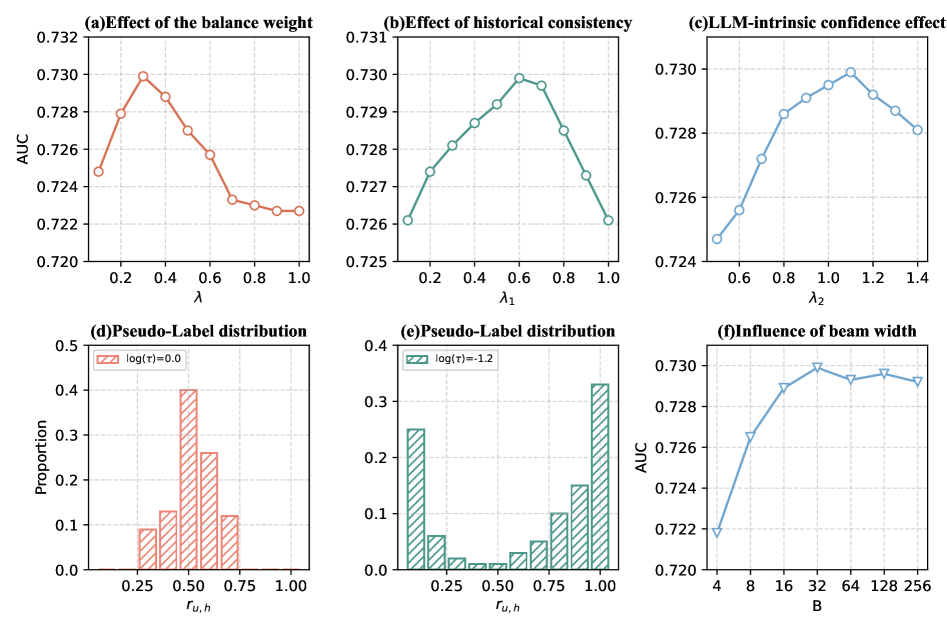

关键设计:GPL的关键设计包括:1) 使用冻结的语义空间,避免LLM的微调带来的不稳定性和计算成本。2) 用户兴趣锚点的生成方式,需要仔细设计prompt,以确保生成的锚点能够准确反映用户兴趣。3) 匹配函数的设计,用于衡量用户兴趣锚点与候选物品语义表示之间的相关性,可以使用余弦相似度或其他更复杂的匹配模型。4) 损失函数的设计,需要平衡已曝光数据和伪标签数据之间的权重,以避免模型过度拟合伪标签。

🖼️ 关键图片

📊 实验亮点

GPL在大型生产系统中部署后,点击率提高了3.07%,同时显著提高了推荐多样性和长尾物品的发现。这些结果表明,GPL能够有效解决预排序中的训练-服务偏差问题,并带来显著的业务价值。与现有方法相比,GPL在提升性能的同时,也提高了推荐系统的公平性和可持续性。

🎯 应用场景

GPL框架可应用于各种工业推荐系统中的预排序环节,尤其适用于需要处理大量长尾物品的场景。通过提高对未曝光物品的打分准确性,GPL能够提升推荐多样性,发现更多潜在用户感兴趣的内容,从而提高用户满意度和平台收益。该方法也可推广到其他存在训练-服务偏差的机器学习任务中。

📄 摘要(原文)

Pre-ranking is a critical stage in industrial recommendation systems, tasked with efficiently scoring thousands of recalled items for downstream ranking. A key challenge is the train-serving discrepancy: pre-ranking models are trained only on exposed interactions, yet must score all recalled candidates -- including unexposed items -- during online serving. This mismatch not only induces severe sample selection bias but also degrades generalization, especially for long-tail content. Existing debiasing approaches typically rely on heuristics (e.g., negative sampling) or distillation from biased rankers, which either mislabel plausible unexposed items as negatives or propagate exposure bias into pseudo-labels. In this work, we propose Generative Pseudo-Labeling (GPL), a framework that leverages large language models (LLMs) to generate unbiased, content-aware pseudo-labels for unexposed items, explicitly aligning the training distribution with the online serving space. By offline generating user-specific interest anchors and matching them with candidates in a frozen semantic space, GPL provides high-quality supervision without adding online latency. Deployed in a large-scale production system, GPL improves click-through rate by 3.07%, while significantly enhancing recommendation diversity and long-tail item discovery.