Position: General Alignment Has Hit a Ceiling; Edge Alignment Must Be Taken Seriously

作者: Han Bao, Yue Huang, Xiaoda Wang, Zheyuan Zhang, Yujun Zhou, Carl Yang, Xiangliang Zhang, Yanfang Ye

分类: cs.CL

发布日期: 2026-02-23

备注: 26 pages, 5 figures

💡 一句话要点

提出边缘对齐,解决通用对齐在复杂社会技术系统中存在的局限性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 对齐 价值观 边缘对齐 社会技术系统

📋 核心要点

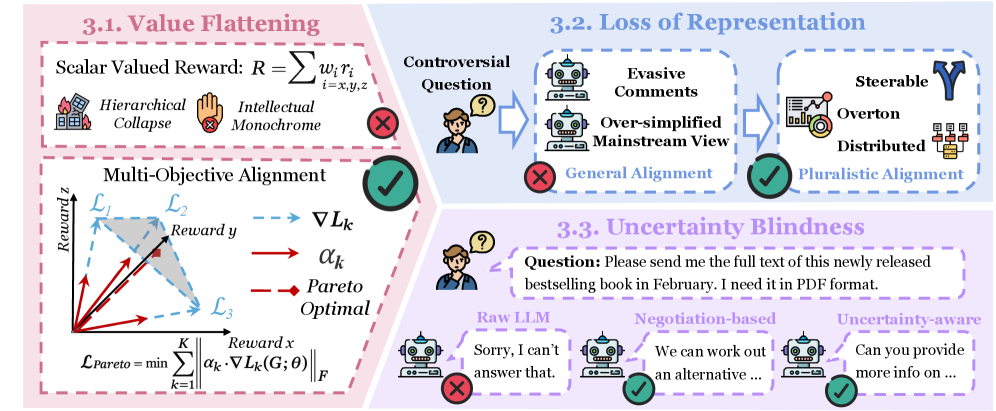

- 现有通用对齐方法将复杂价值观简化为单一标量奖励,在多元利益和不确定性场景下存在结构性缺陷。

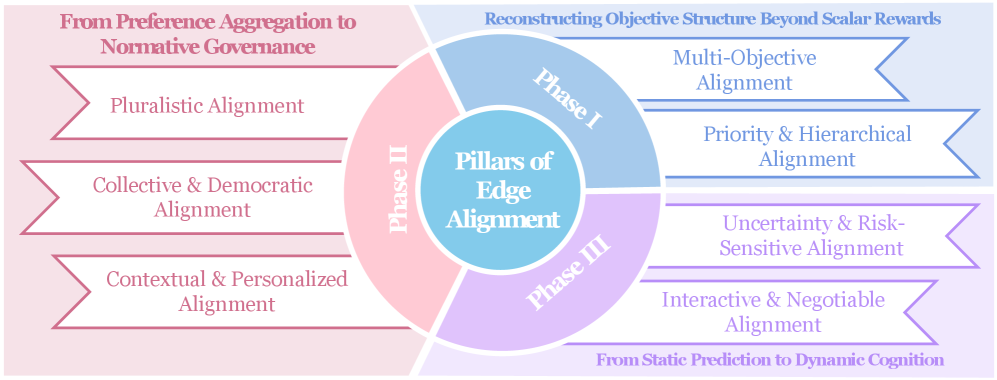

- 论文提出边缘对齐方法,旨在保留多维价值结构,支持多元表征,并融入认知机制以进行交互和澄清。

- 论文提出了边缘对齐的七个支柱,并讨论了数据收集、训练目标和评估中的关键挑战,为动态规范治理提供方向。

📝 摘要(中文)

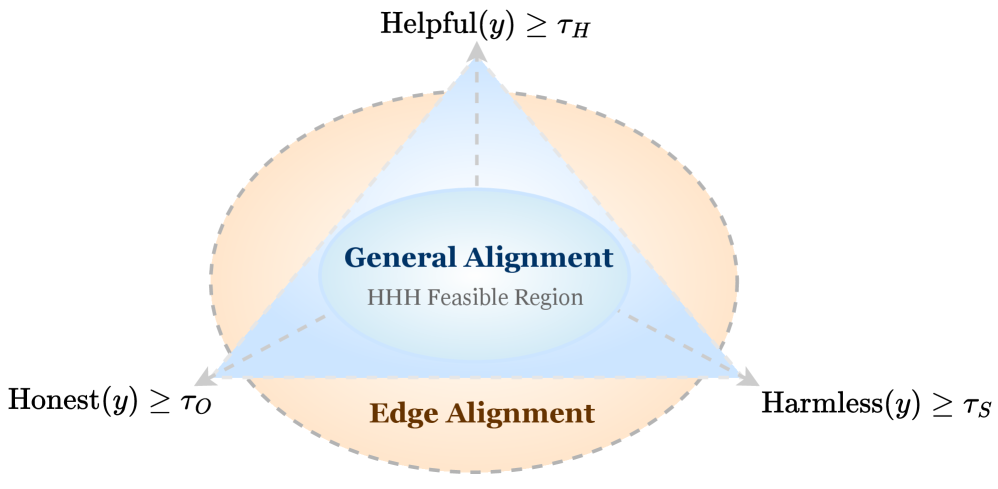

大型语言模型正被部署在复杂的社会技术系统中,这暴露了当前对齐实践的局限性。我们认为,将多样化的人类价值观压缩成单一标量奖励的通用对齐范式,在存在冲突价值观、多元利益相关者和不可约不确定性的环境中,达到了结构性上限。这些失败源于标量化的数学和激励机制,导致结构性价值扁平化、规范性表征损失和认知不确定性盲视。我们引入边缘对齐作为一种不同的方法,其中系统保留多维价值结构,支持多元和民主的表征,并结合认知机制进行交互和澄清。为了使这种方法切实可行,我们提出了七个相互依存的支柱,组织成三个阶段。我们确定了数据收集、训练目标和评估中的关键挑战,概述了互补的技术和治理方向。总而言之,这些措施将对齐重新定义为一个动态规范治理的生命周期问题,而不是一个单一实例优化任务。

🔬 方法详解

问题定义:现有的大型语言模型对齐方法,特别是通用对齐,试图将所有人类价值观压缩成一个单一的标量奖励函数。这种方法在简单的任务中可能有效,但在涉及冲突价值观、多个利益相关者以及固有不确定性的复杂社会技术系统中会失效。其痛点在于价值扁平化、规范性信息丢失以及对不确定性的认知盲视。

核心思路:论文的核心思路是引入“边缘对齐”的概念,不再试图将所有价值观压缩成单一标量,而是保留多维的价值结构。通过支持多元和民主的表征,并结合认知机制进行交互和澄清,边缘对齐旨在更好地处理复杂场景中的价值冲突和不确定性。这种设计是为了克服通用对齐的结构性限制,并更准确地反映人类价值观的复杂性。

技术框架:边缘对齐方法包含七个相互依存的支柱,组织成三个阶段。具体的技术框架细节未知,但可以推断包括:1) 数据收集阶段,需要收集能够反映多元价值观的数据;2) 训练目标阶段,需要设计能够保留多维价值结构的训练目标;3) 评估阶段,需要设计能够评估系统在处理价值冲突和不确定性方面的表现的评估指标。此外,还强调了交互和澄清的认知机制,可能涉及用户反馈、解释生成等技术。

关键创新:最关键的创新点在于从通用对齐到边缘对齐的范式转变。通用对齐试图找到一个“正确”的答案,而边缘对齐则承认价值观的多元性和不确定性,并试图构建能够处理这些复杂性的系统。这种转变反映了对大型语言模型对齐问题的更深刻理解。

关键设计:论文中没有提供具体的参数设置、损失函数或网络结构等技术细节。未来的研究需要进一步探索如何将边缘对齐的理念转化为具体的算法和模型。可能涉及的技术包括多目标优化、强化学习、因果推理、知识图谱等。

🖼️ 关键图片

📊 实验亮点

论文主要贡献在于提出了边缘对齐的理念框架,并分析了通用对齐的局限性。虽然没有提供具体的实验结果,但其理论分析为未来的研究方向提供了指导,并强调了在复杂社会技术系统中进行对齐的必要性。

🎯 应用场景

该研究成果可应用于需要处理复杂价值观和多元利益相关者的场景,例如医疗决策、法律咨询、政策制定等。通过边缘对齐,系统可以更好地理解和尊重不同的价值观,从而做出更公平、更合理的决策。未来的影响在于构建更值得信赖和负责任的人工智能系统。

📄 摘要(原文)

Large language models are being deployed in complex socio-technical systems, which exposes limits in current alignment practice. We take the position that the dominant paradigm of General Alignment, which compresses diverse human values into a single scalar reward, reaches a structural ceiling in settings with conflicting values, plural stakeholders, and irreducible uncertainty. These failures follow from the mathematics and incentives of scalarization and lead to \textbf{structural} value flattening, \textbf{normative} representation loss, and \textbf{cognitive} uncertainty blindness. We introduce Edge Alignment as a distinct approach in which systems preserve multi dimensional value structure, support plural and democratic representation, and incorporate epistemic mechanisms for interaction and clarification. To make this approach practical, we propose seven interdependent pillars organized into three phases. We identify key challenges in data collection, training objectives, and evaluation, outlining complementary technical and governance directions. Taken together, these measures reframe alignment as a lifecycle problem of dynamic normative governance rather than as a single instance optimization task.