gencat: Generative computerized adaptive testing

作者: Wanyong Feng, Andrew Lan

分类: cs.CL

发布日期: 2026-02-23

备注: 19 pages, 2 figures

💡 一句话要点

提出GENCAT:一种利用生成式大语言模型的自适应测试框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 计算机自适应测试 生成式模型 大型语言模型 项目反应理论 知识评估

📋 核心要点

- 传统CAT框架依赖预测学生答案正确性,忽略了开放式问题中的丰富文本信息。

- GENCAT利用大型语言模型进行知识评估和问题选择,核心是生成式项目反应理论(GIRT)模型。

- 实验表明,GENCAT在编程数据集上优于现有基线,AUC提升高达4.32%,尤其在早期测试阶段。

📝 摘要(中文)

现有的计算机自适应测试(CAT)框架通常建立在预测学生对问题的回答正确性之上。虽然有效,但这种方法未能充分利用问题和答案中的文本信息,特别是对于开放式问题。本文提出了GENCAT(生成式CAT),一种新颖的CAT框架,它利用大型语言模型进行知识评估和问题选择。首先,我们开发了一个生成式项目反应理论(GIRT)模型,使我们能够从学生的开放式回答中估计他们的知识,并预测对未见过问题的回答。我们通过两步过程训练模型,首先通过监督微调,然后通过偏好优化来实现知识-反应对齐。其次,我们引入了三种问题选择算法,这些算法利用GIRT模型的生成能力,基于抽样学生回答的不确定性、语言多样性和信息量。第三,我们在两个真实世界的编程数据集上进行了实验,结果表明GENCAT优于现有的CAT基线,在关键的早期测试阶段实现了高达4.32%的AUC提升。

🔬 方法详解

问题定义:现有计算机自适应测试(CAT)框架主要依赖于预测学生对问题的回答是否正确,这种方法在处理开放式问题时,无法有效利用问题和答案中蕴含的丰富文本信息,导致知识评估不够准确,问题选择不够高效。

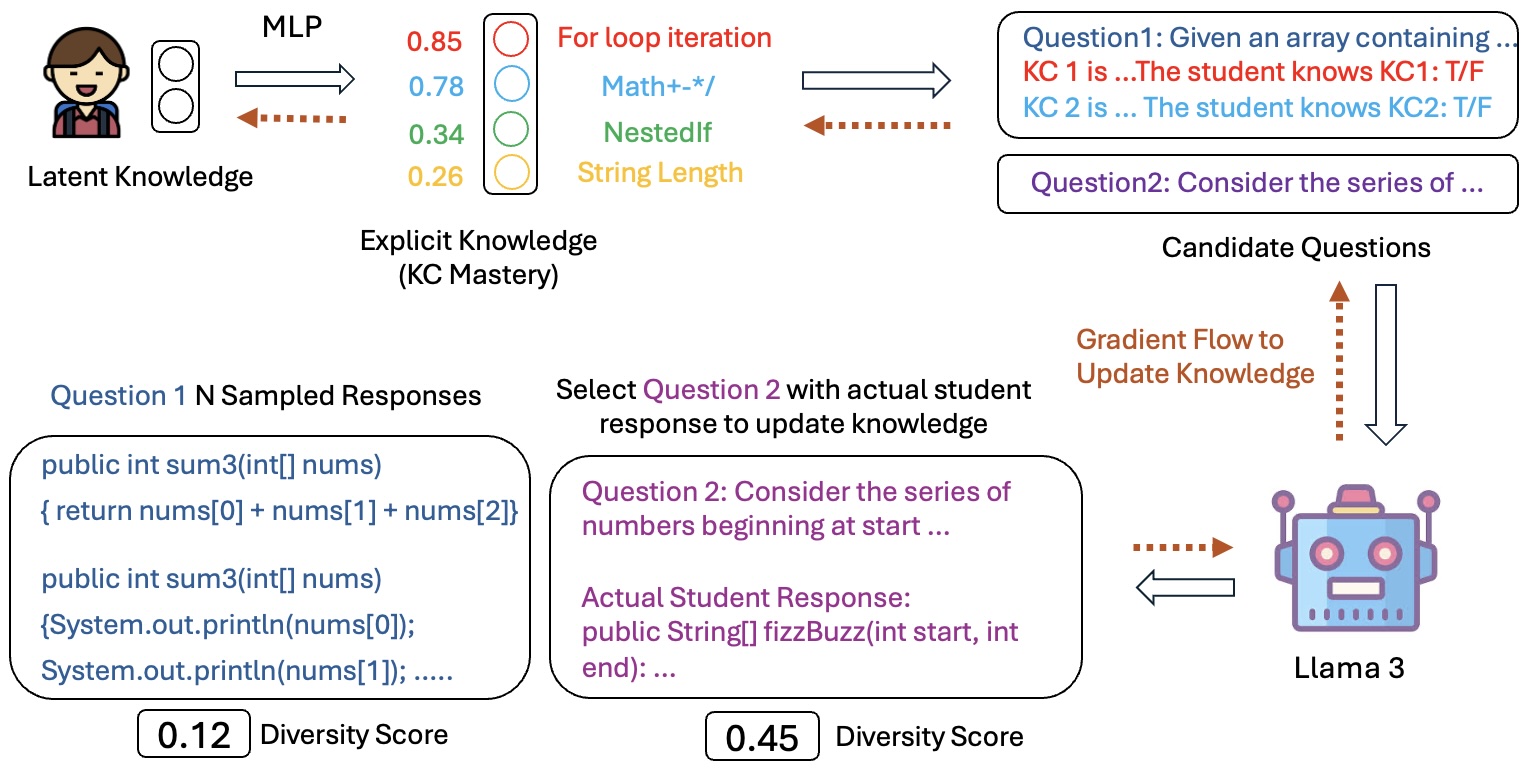

核心思路:GENCAT的核心思路是利用大型语言模型的生成能力,构建一个生成式项目反应理论(GIRT)模型。该模型能够从学生的开放式回答中估计其知识水平,并预测其对未见过问题的回答。通过这种方式,GENCAT能够更全面地评估学生的知识,并选择更具信息量的问题。

技术框架:GENCAT框架主要包含以下几个模块:1) GIRT模型训练模块:该模块通过两阶段训练过程优化GIRT模型,首先进行监督微调,然后进行偏好优化,以实现知识-反应对齐。2) 知识评估模块:利用训练好的GIRT模型,根据学生的回答评估其知识水平。3) 问题选择模块:基于GIRT模型的生成能力,设计了三种问题选择算法,分别考虑了学生回答的不确定性、语言多样性和信息量。4) 测试流程控制模块:负责控制整个测试流程,包括问题呈现、答案收集、知识评估和问题选择等环节。

关键创新:GENCAT的关键创新在于提出了生成式项目反应理论(GIRT)模型,并将其应用于计算机自适应测试。与传统的基于预测的模型不同,GIRT模型能够生成学生的回答,从而更全面地评估学生的知识,并选择更具信息量的问题。此外,GENCAT还提出了三种基于GIRT模型的问题选择算法,进一步提高了测试效率。

关键设计:GIRT模型的训练采用了两阶段策略。第一阶段,使用监督微调,利用已有的问题-答案对数据训练模型,使其具备生成合理回答的能力。第二阶段,使用偏好优化,通过比较不同回答的质量,进一步优化模型,使其生成的回答能够更好地反映学生的知识水平。问题选择算法的设计考虑了不确定性、语言多样性和信息量三个方面,具体实现方式未知。

🖼️ 关键图片

📊 实验亮点

在两个真实世界的编程数据集上进行的实验表明,GENCAT显著优于现有的CAT基线。在关键的早期测试阶段,GENCAT实现了高达4.32%的AUC提升。这表明GENCAT能够更有效地评估学生的知识水平,并选择更具信息量的问题,从而提高测试效率。

🎯 应用场景

GENCAT框架可广泛应用于在线教育、技能评估、人才招聘等领域。通过更准确地评估学生的知识水平,并选择更具信息量的问题,GENCAT能够提高测试效率,降低测试成本,并为学生提供更个性化的学习体验。未来,GENCAT有望成为智能教育的重要组成部分。

📄 摘要(原文)

Existing computerized Adaptive Testing (CAT) frameworks are typically built on predicting the correctness of a student response to a question. Although effective, this approach fails to leverage textual information in questions and responses, especially for open-ended questions. In this work, we propose GENCAT (\textbf{GEN}erative \textbf{CAT}), a novel CAT framework that leverages Large Language Models for knowledge estimate and question selection. First, we develop a Generative Item Response Theory (GIRT) model that enables us to estimate student knowledge from their open-ended responses and predict responses to unseen questions. We train the model in a two-step process, first via Supervised Fine-Tuning and then via preference optimization for knowledge-response alignment. Second, we introduce three question selection algorithms that leverage the generative capabilities of the GIRT model, based on the uncertainty, linguistic diversity, and information of sampled student responses. Third, we conduct experiments on two real-world programming datasets and demonstrate that GENCAT outperforms existing CAT baselines, achieving an AUC improvement of up to 4.32\% in the key early testing stages.