KGHaluBench: A Knowledge Graph-Based Hallucination Benchmark for Evaluating the Breadth and Depth of LLM Knowledge

作者: Alex Robertson, Huizhi Liang, Mahbub Gani, Rohit Kumar, Srijith Rajamohan

分类: cs.CL

发布日期: 2026-02-23

备注: EACL 2026 Findings

💡 一句话要点

KGHaluBench:基于知识图谱的大语言模型幻觉评测基准,评估知识的广度和深度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 幻觉评估 知识图谱 基准测试 知识真实性

📋 核心要点

- 现有LLM评测基准存在静态、问题狭窄等局限性,无法全面评估LLM的知识真实性。

- KGHaluBench利用知识图谱动态构建多方面问题,并进行难度统计估计,从而克服流行度偏差。

- 该基准采用自动化验证流程,从概念和正确性层面检测LLM的幻觉,并评估了25个前沿模型。

📝 摘要(中文)

大型语言模型(LLM)具有生成令人信服且易于理解的语言的卓越能力。然而,连贯性并不等同于真实性,因为回复通常包含细微的幻觉。现有的基准测试受到静态和狭窄问题的限制,导致覆盖范围有限和具有误导性的评估。我们提出了KGHaluBench,这是一个基于知识图谱的幻觉基准,用于评估LLM知识的广度和深度,从而提供对LLM真实性的更公平和更全面的洞察。我们的框架利用知识图谱动态构建具有挑战性的多方面问题,然后对其难度进行统计估计,以解决流行度偏差。我们的自动化验证管道检测弃权,并在概念和正确性级别验证LLM的响应,以识别不同类型的幻觉。我们使用新颖的准确性和幻觉指标评估了25个前沿模型。结果提供了对导致不同模型大小出现幻觉的知识因素的更具可解释性的洞察。KGHaluBench可公开使用,以支持未来在幻觉缓解方面的发展。

🔬 方法详解

问题定义:现有的大语言模型评测基准通常采用静态且范围狭窄的问题,无法充分评估模型知识的广度和深度,容易产生误导性的评估结果。此外,现有方法难以有效识别和区分不同类型的幻觉,并且容易受到流行度偏差的影响,即模型更容易回答常见问题,而忽略不常见但同样重要的问题。

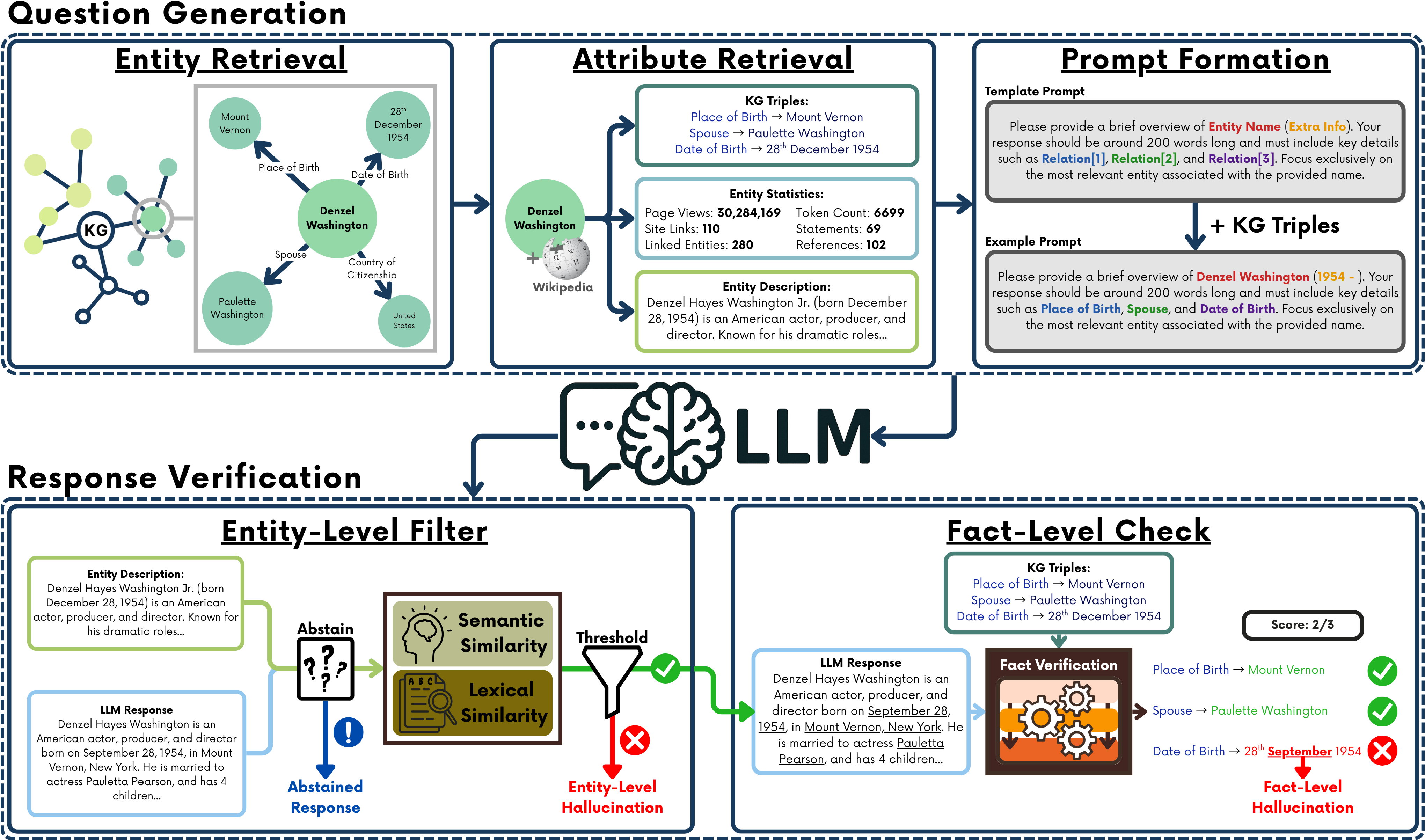

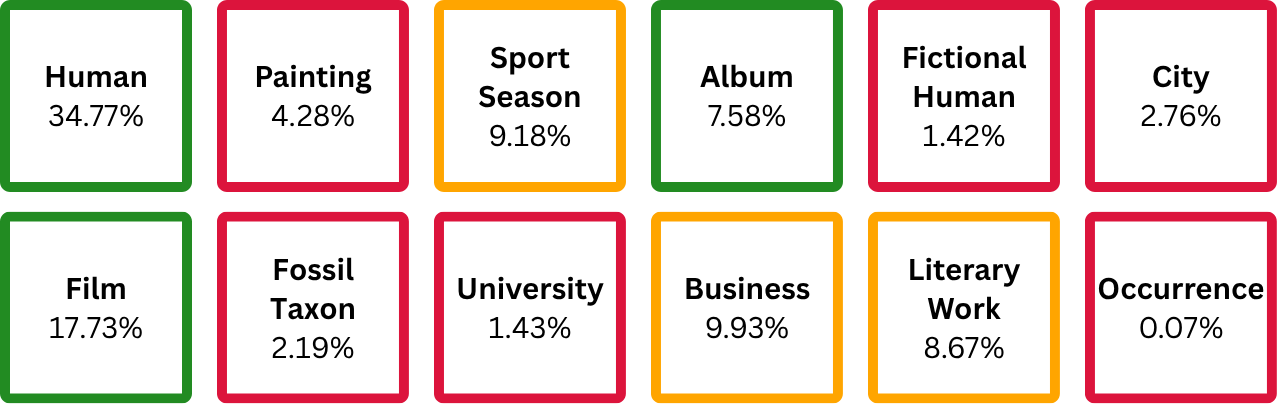

核心思路:KGHaluBench的核心思路是利用知识图谱(KG)作为知识来源,动态生成具有挑战性的、多方面的问题,从而更全面地评估LLM的知识。通过统计估计问题的难度,可以减轻流行度偏差的影响。此外,该基准还设计了一个自动化验证流程,能够检测模型的弃权行为,并从概念和正确性两个层面验证模型的回答,从而识别不同类型的幻觉。

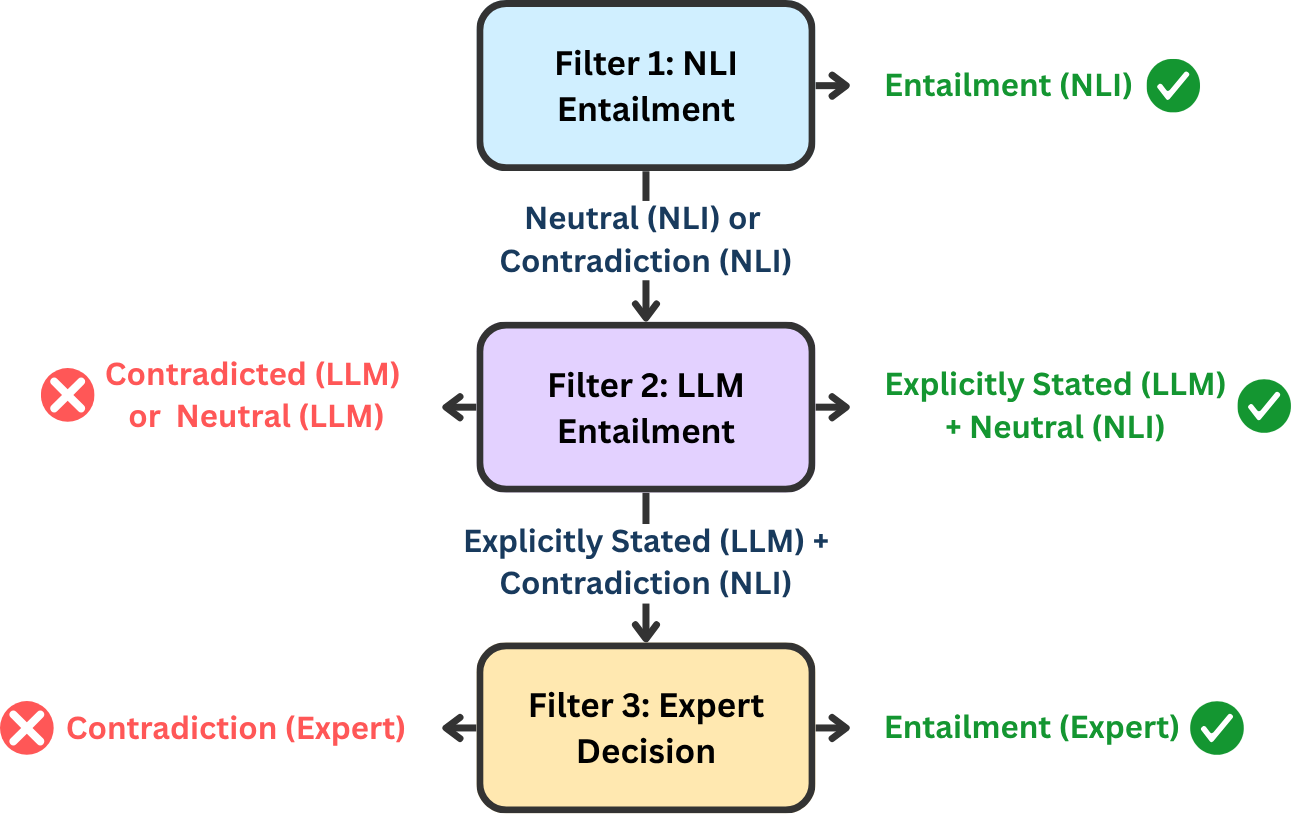

技术框架:KGHaluBench的整体框架包含以下几个主要模块:1) 知识图谱构建模块:选择合适的知识图谱作为知识来源。2) 问题生成模块:基于知识图谱,动态生成具有挑战性的多方面问题。3) 难度估计模块:对生成的问题进行难度统计估计,以解决流行度偏差。4) 模型推理模块:利用待评估的LLM回答生成的问题。5) 自动化验证模块:检测模型的弃权行为,并从概念和正确性两个层面验证模型的回答,识别不同类型的幻觉。6) 评估指标计算模块:计算准确率和幻觉指标,评估LLM的性能。

关键创新:KGHaluBench的关键创新在于:1) 基于知识图谱的动态问题生成:能够生成更具挑战性和多样性的问题,从而更全面地评估LLM的知识。2) 难度统计估计:减轻了流行度偏差的影响,使得评估结果更加公平。3) 自动化验证流程:能够检测模型的弃权行为,并从概念和正确性两个层面验证模型的回答,从而识别不同类型的幻觉。

关键设计:在问题生成方面,论文可能采用了基于KG路径遍历的方法,生成需要多步推理的问题。在难度估计方面,可能采用了基于问题在KG中的路径长度、实体流行度等特征的统计模型。在自动化验证方面,可能采用了基于语义相似度计算、知识图谱查询等技术,判断模型回答的概念正确性和事实正确性。具体的参数设置、损失函数、网络结构等技术细节未知,需要查阅论文原文。

🖼️ 关键图片

📊 实验亮点

KGHaluBench评估了25个前沿模型,并使用新颖的准确性和幻觉指标进行了评估。实验结果表明,不同模型大小的模型在不同知识因素下会产生幻觉,为理解LLM幻觉的成因提供了更具可解释性的视角。具体的性能数据和提升幅度需要在论文中查找。

🎯 应用场景

KGHaluBench可用于评估和比较不同LLM的知识真实性,帮助研究人员和开发者更好地了解模型的优缺点。该基准还可用于指导LLM的训练和改进,例如通过对抗训练来减少幻觉的产生。此外,该基准还可应用于需要高度可靠信息的领域,如医疗诊断、金融分析等,以确保LLM提供的建议和决策是准确和可信的。

📄 摘要(原文)

Large Language Models (LLMs) possess a remarkable capacity to generate persuasive and intelligible language. However, coherence does not equate to truthfulness, as the responses often contain subtle hallucinations. Existing benchmarks are limited by static and narrow questions, leading to limited coverage and misleading evaluations. We present KGHaluBench, a Knowledge Graph-based hallucination benchmark that assesses LLMs across the breadth and depth of their knowledge, providing a fairer and more comprehensive insight into LLM truthfulness. Our framework utilises the KG to dynamically construct challenging, multifaceted questions, whose difficulty is then statistically estimated to address popularity bias. Our automated verification pipeline detects abstentions and verifies the LLM's response at both conceptual and correctness levels to identify different types of hallucinations. We evaluate 25 frontier models, using novel accuracy and hallucination metrics. The results provide a more interpretable insight into the knowledge factors that cause hallucinations across different model sizes. KGHaluBench is publicly available to support future developments in hallucination mitigation.