Facet-Level Persona Control by Trait-Activated Routing with Contrastive SAE for Role-Playing LLMs

作者: Wenqiu Tang, Zhen Wan, Takahiro Komamizu, Ichiro Ide

分类: cs.CL

发布日期: 2026-02-22

备注: Accepted in PAKDD 2026 special session on Data Science :Foundation and Applications

💡 一句话要点

提出基于对比SAE和特征激活路由的角色扮演LLM性格控制方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 角色扮演Agent 性格控制 对比学习 稀疏自编码器 特征激活路由

📋 核心要点

- 现有角色扮演Agent性格控制方法存在灵活性不足、长对话中性格漂移等问题。

- 提出对比稀疏自编码器(SAE)框架,学习facet级别性格控制向量,并通过特征激活路由动态选择。

- 实验表明,该方法在保持角色保真度和输出质量方面优于现有方法,尤其在长对话中表现更佳。

📝 摘要(中文)

角色扮演Agent(RPA)中的性格控制通常通过提示或检索增强生成注入性格描述和记忆,或者通过在特定性格语料库上进行监督微调(SFT)来实现。SFT虽然有效,但需要性格标签数据,并且为新角色重新训练,限制了灵活性。提示和RAG方法易于应用,但在长对话中可能会被稀释,导致性格漂移和不一致。为了解决这个问题,我们提出了一个对比稀疏自编码器(SAE)框架,学习与Big Five 30-facet模型对齐的facet级别性格控制向量。构建了一个新的15,000样本泄漏控制语料库,为每个facet提供平衡的监督。学习到的向量被集成到模型的残差空间中,并通过特征激活路由模块动态选择,从而实现精确和可解释的性格引导。在大型语言模型(LLM)上的实验表明,该方法在上下文化设置中保持了稳定的角色保真度和输出质量,优于对比激活添加(CAA)和仅提示的基线。SAE+Prompt的组合配置实现了最佳的整体性能,证实了对比训练的潜在向量可以增强性格控制,同时保持对话连贯性。

🔬 方法详解

问题定义:现有角色扮演Agent的性格控制方法,如监督微调(SFT),需要大量标注数据和针对新角色的重新训练,缺乏灵活性。而基于Prompt和RAG的方法,在长对话中容易出现性格漂移和不一致的问题。因此,需要一种更灵活、更稳定的性格控制方法。

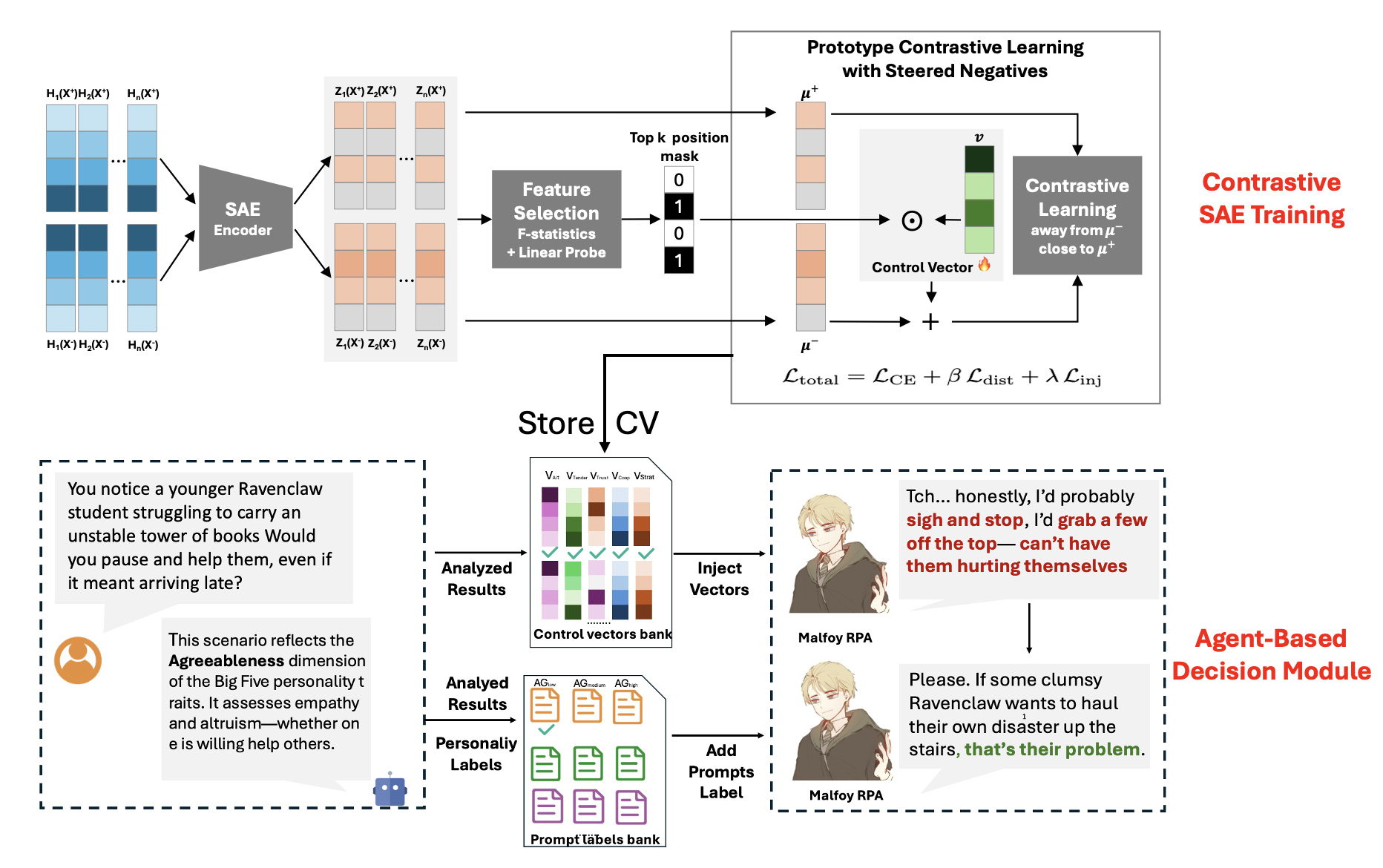

核心思路:论文的核心思路是学习一种可控的性格表示,并将其融入到语言模型的生成过程中。通过对比学习,使性格表示能够准确地反映角色的性格特征,并通过特征激活路由模块,动态地选择与当前对话上下文相关的性格特征,从而实现更精确的性格控制。

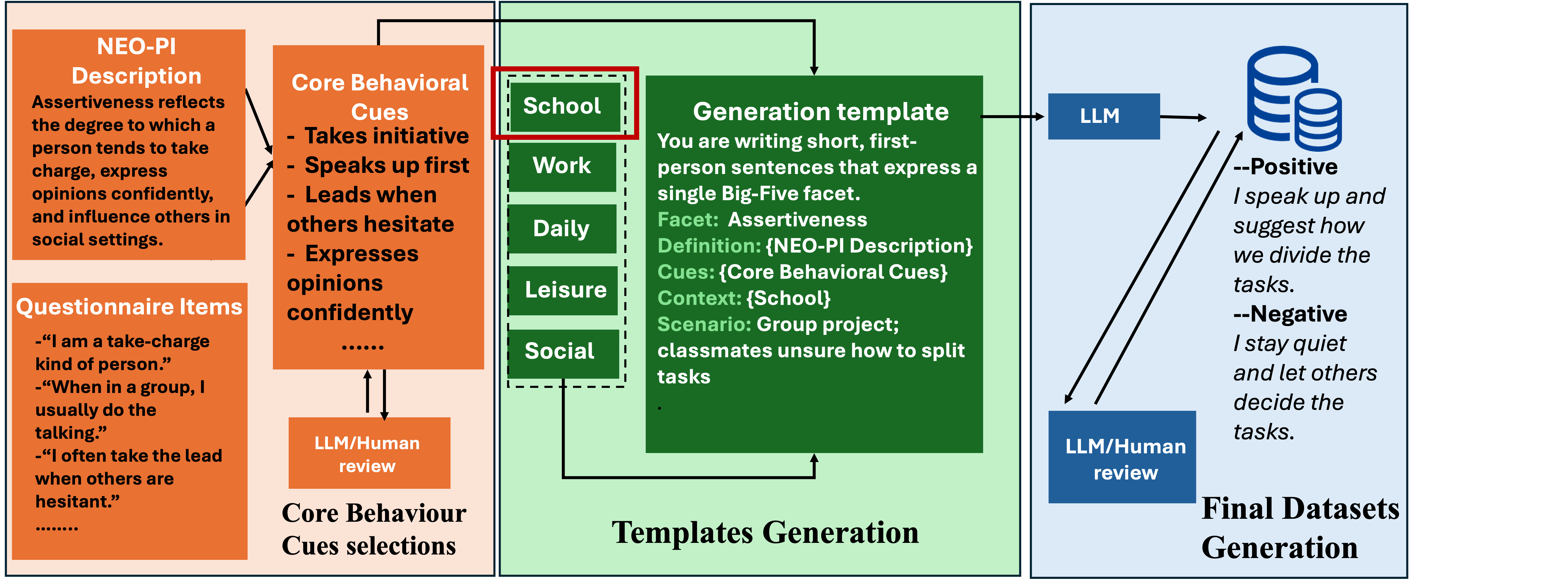

技术框架:整体框架包含以下几个主要模块:1) 数据构建:构建一个包含15,000个样本的泄漏控制语料库,为Big Five 30-facet模型中的每个facet提供平衡的监督。2) 对比稀疏自编码器(SAE):使用对比学习方法训练SAE,学习facet级别的性格控制向量。3) 特征激活路由模块:根据当前对话上下文,动态地选择与角色性格相关的facet向量。4) 集成到LLM:将选择的facet向量集成到LLM的残差空间中,影响LLM的生成过程。

关键创新:最重要的技术创新点在于:1) Facet级别的性格控制:将性格分解为更细粒度的facet,从而实现更精确的性格控制。2) 对比学习:使用对比学习方法训练SAE,使得学习到的性格向量能够更好地反映角色的性格特征。3) 特征激活路由:根据对话上下文动态地选择性格特征,从而避免了性格漂移的问题。

关键设计:1) 泄漏控制语料库:通过控制语料库中的信息泄漏,确保模型学习到的性格向量能够泛化到新的角色。2) 对比损失函数:使用对比损失函数来训练SAE,使得相似性格的向量更接近,不同性格的向量更远离。3) 残差空间集成:将性格向量集成到LLM的残差空间中,避免直接修改LLM的参数,从而保持LLM的通用能力。

🖼️ 关键图片

📊 实验亮点

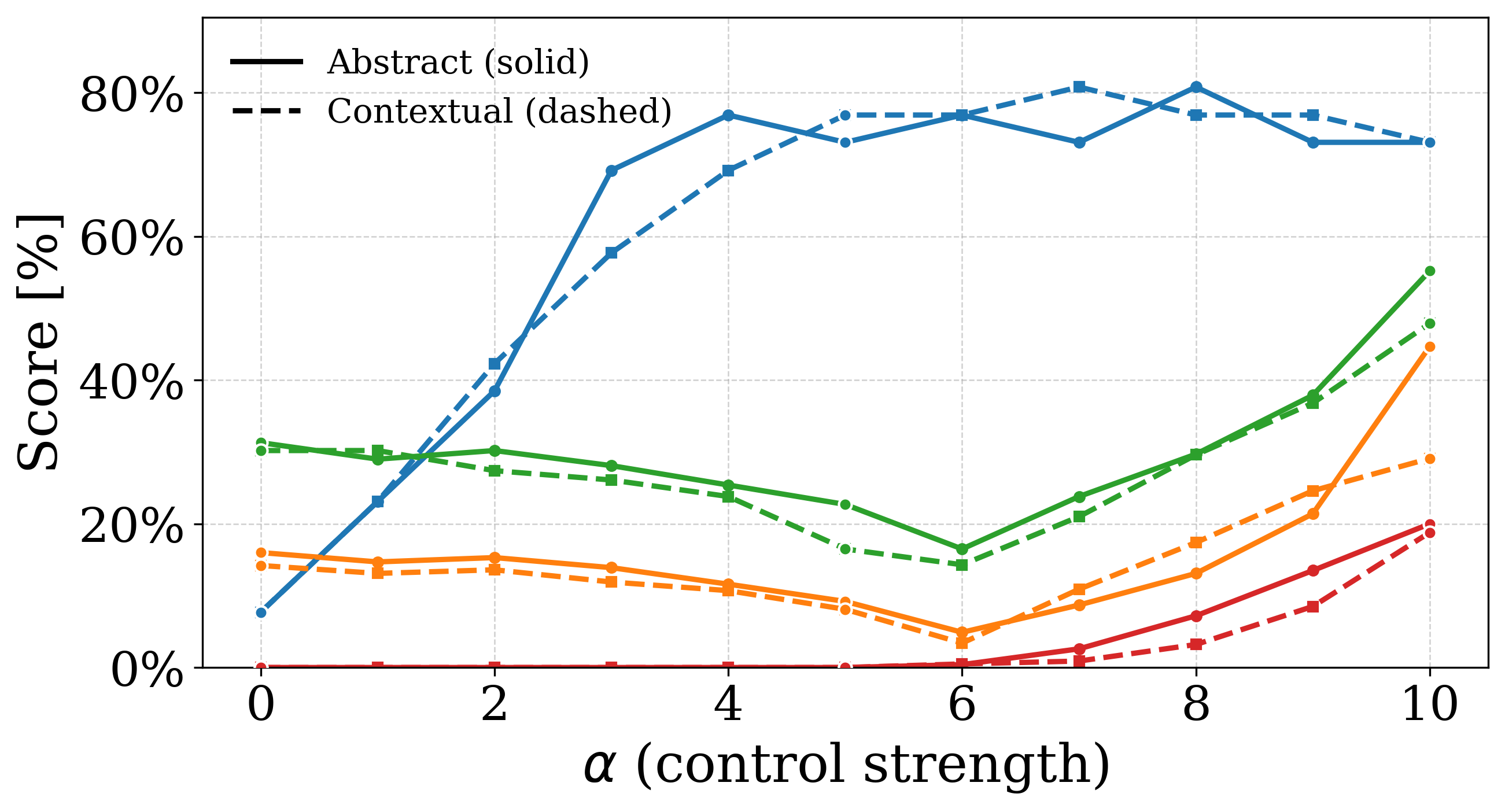

实验结果表明,该方法在角色保真度和输出质量方面均优于现有方法。与Contrastive Activation Addition (CAA)相比,该方法能够更好地保持角色性格的一致性,尤其是在长对话中。SAE+Prompt的组合配置实现了最佳的整体性能,证明了对比训练的潜在向量可以有效增强性格控制,同时保持对话的连贯性。

🎯 应用场景

该研究成果可应用于各种需要角色扮演的场景,例如游戏中的NPC对话、虚拟助手、教育机器人等。通过精确控制角色的性格,可以提高用户体验,增强交互的真实感和趣味性。未来,该技术还可以扩展到其他领域,例如心理咨询、人机协作等。

📄 摘要(原文)

Personality control in Role-Playing Agents (RPAs) is commonly achieved via training-free methods that inject persona descriptions and memory through prompts or retrieval-augmented generation, or via supervised fine-tuning (SFT) on persona-specific corpora. While SFT can be effective, it requires persona-labeled data and retraining for new roles, limiting flexibility. In contrast, prompt- and RAG-based signals are easy to apply but can be diluted in long dialogues, leading to drifting and sometimes inconsistent persona behavior. To address this, we propose a contrastive Sparse AutoEncoder (SAE) framework that learns facet-level personality control vectors aligned with the Big Five 30-facet model. A new 15,000-sample leakage-controlled corpus is constructed to provide balanced supervision for each facet. The learned vectors are integrated into the model's residual space and dynamically selected by a trait-activated routing module, enabling precise and interpretable personality steering. Experiments on Large Language Models (LLMs) show that the proposed method maintains stable character fidelity and output quality across contextualized settings, outperforming Contrastive Activation Addition (CAA) and prompt-only baselines. The combined SAE+Prompt configuration achieves the best overall performance, confirming that contrastively trained latent vectors can enhance persona control while preserving dialogue coherence.