How Do LLMs Encode Scientific Quality? An Empirical Study Using Monosemantic Features from Sparse Autoencoders

作者: Michael McCoubrey, Angelo Salatino, Francesco Osborne, Enrico Motta

分类: cs.CL, cs.AI, cs.DL

发布日期: 2026-02-22

备注: Presented at SESAME 2025: Smarter Extraction of ScholArly MEtadata using Knowledge Graphs and Language Models, @ JCDL 2025

💡 一句话要点

利用稀疏自编码器的单义特征,研究LLM如何编码科学质量

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 科学质量评估 稀疏自编码器 单义特征 研究质量指标

📋 核心要点

- 大型语言模型在评估科研质量方面展现潜力,但其内部运作机制尚不明确,阻碍了进一步优化。

- 本研究利用稀疏自编码器提取单义特征,探究LLM如何编码科学质量,揭示其内在表征。

- 实验表明,LLM能够编码与研究方法、出版类型、研究领域和科学术语相关的质量维度特征。

📝 摘要(中文)

近年来,生成式AI,特别是大型语言模型(LLM),在科学工作的评估和生成方面得到越来越多的应用。尽管一些研究表明LLM可以在一定程度上根据感知质量评估研究,但我们对支持这种能力的内部机制的理解仍然有限。本文首次研究了LLM如何通过使用稀疏自编码器提取的相关单义特征来编码科学质量的概念。我们在不同的实验设置下推导出这些特征,并评估它们在与研究质量相关的三个任务中作为预测因子的能力:预测引用次数、期刊SJR和期刊h指数。结果表明,LLM编码了与科学质量的多个维度相关的特征。特别是,我们确定了四种反复出现的特征类型,它们捕捉了研究质量如何表示的关键方面:1)反映研究方法的特征;2)与出版类型相关的特征,其中文献综述通常表现出更高的影响力;3)与高影响力研究领域和技术相关的特征;4)与特定科学术语相对应的特征。这些发现代表了理解LLM如何封装与研究质量相关的概念的重要一步。

🔬 方法详解

问题定义:论文旨在理解大型语言模型(LLM)如何在其内部表征中编码科学研究的质量。现有方法缺乏对LLM内部机制的深入理解,无法解释LLM如何评估研究质量,阻碍了进一步提升LLM在科学评估方面的能力。

核心思路:论文的核心思路是利用稀疏自编码器提取LLM中的单义特征,这些特征被认为是LLM理解和表示科学质量的关键组成部分。通过分析这些特征与不同质量指标(如引用次数、期刊SJR和h指数)之间的关系,可以揭示LLM如何编码科学质量的不同维度。

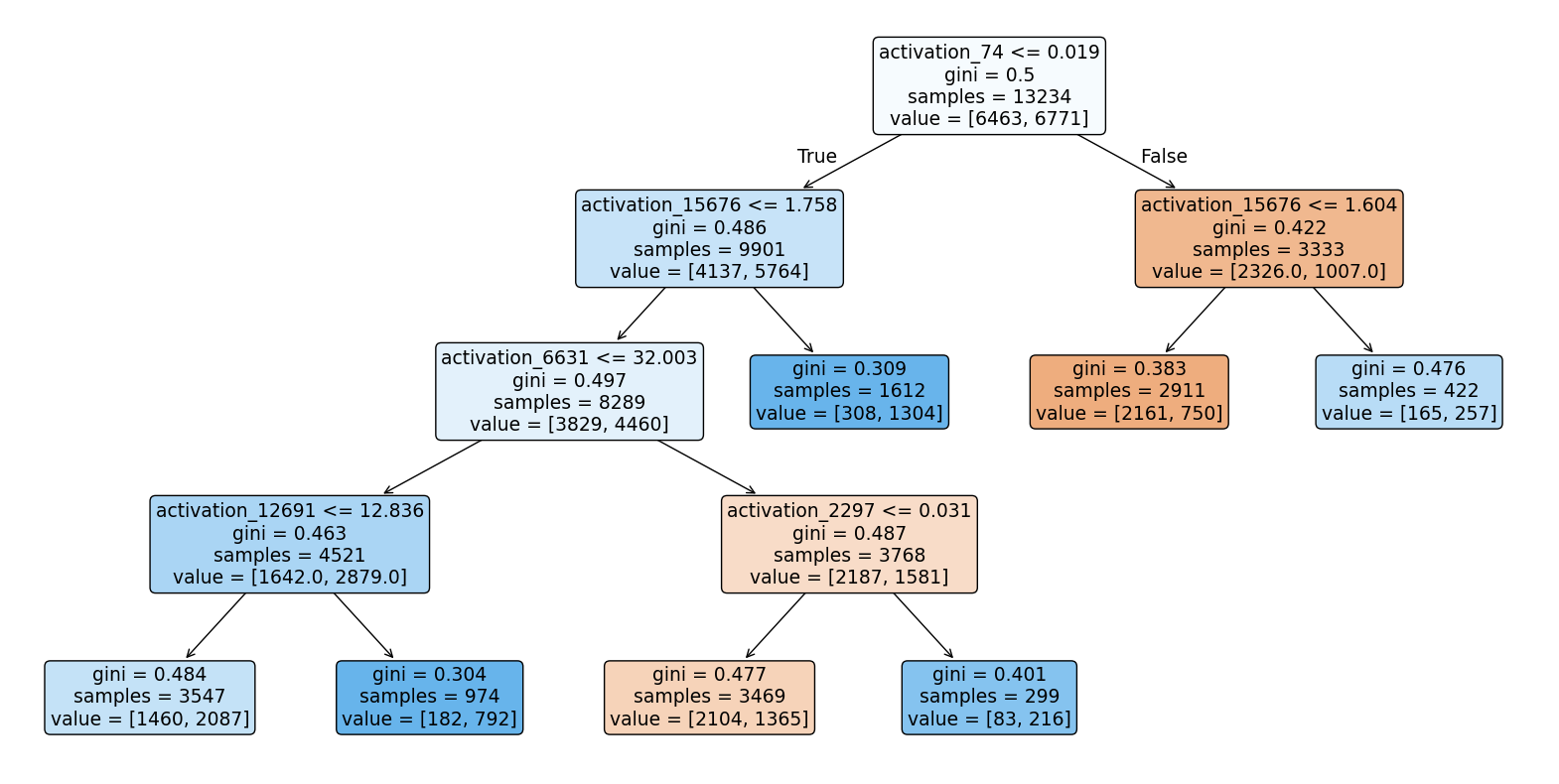

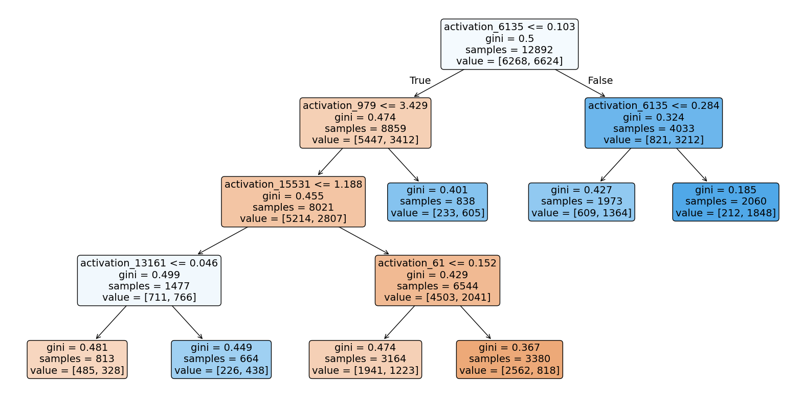

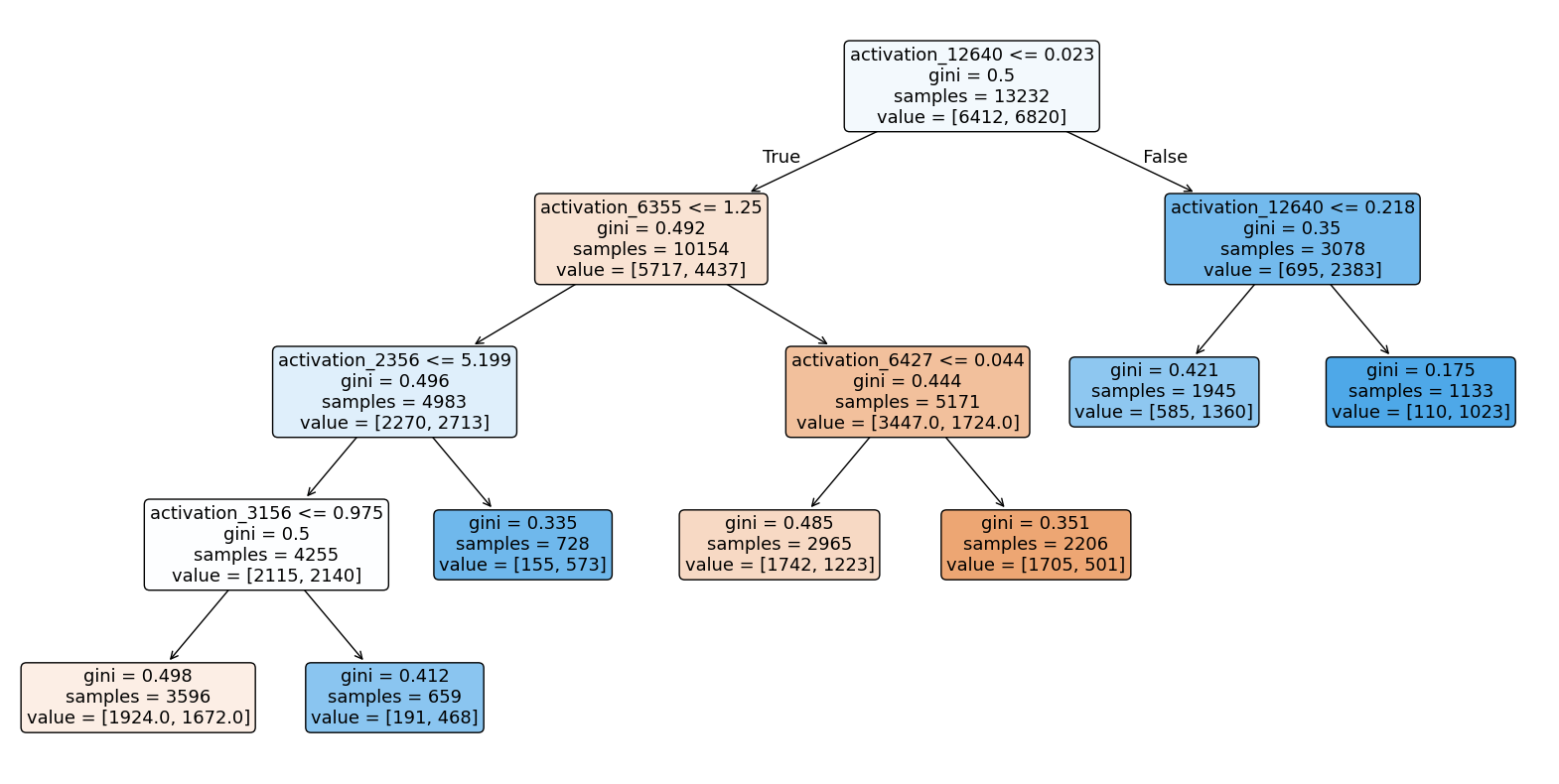

技术框架:整体框架包括以下几个主要阶段:1)使用稀疏自编码器从LLM中提取单义特征;2)构建预测模型,使用提取的特征作为输入,预测研究质量指标;3)分析特征的重要性和类型,识别与不同质量维度相关的特征;4)对识别出的特征进行解释,理解其代表的科学概念和知识。

关键创新:该研究的关键创新在于使用稀疏自编码器从LLM中提取单义特征,并将其应用于理解LLM如何编码科学质量。与以往的研究不同,该方法关注LLM的内部表征,而不是仅仅关注LLM的外部表现。此外,该研究还识别了四种反复出现的特征类型,这些特征捕捉了研究质量如何表示的关键方面。

关键设计:论文使用了稀疏自编码器来提取单义特征。稀疏自编码器的目标是学习一个稀疏的隐藏层表示,使得输入可以被很好地重构。通过限制隐藏层神经元的数量,可以迫使自编码器学习到输入数据中最具代表性的特征。论文中具体使用的稀疏自编码器的结构和参数设置(如隐藏层大小、稀疏惩罚系数等)未知。

🖼️ 关键图片

📊 实验亮点

研究表明,LLM编码了与科学质量的多个维度相关的特征。具体而言,识别出四种反复出现的特征类型:研究方法、出版类型(文献综述影响力较高)、高影响力研究领域和技术、以及特定科学术语。这些特征能够有效预测引用次数、期刊SJR和期刊h指数等质量指标,表明LLM具备一定的科学质量评估能力。

🎯 应用场景

该研究成果可应用于改进LLM在科学研究评估和推荐方面的能力,例如自动评估论文质量、推荐相关研究、辅助科研人员进行文献综述等。通过理解LLM如何编码科学质量,可以更好地利用LLM来支持科学研究和创新。

📄 摘要(原文)

In recent years, there has been a growing use of generative AI, and large language models (LLMs) in particular, to support both the assessment and generation of scientific work. Although some studies have shown that LLMs can, to a certain extent, evaluate research according to perceived quality, our understanding of the internal mechanisms that enable this capability remains limited. This paper presents the first study that investigates how LLMs encode the concept of scientific quality through relevant monosemantic features extracted using sparse autoencoders. We derive such features under different experimental settings and assess their ability to serve as predictors across three tasks related to research quality: predicting citation count, journal SJR, and journal h-index. The results indicate that LLMs encode features associated with multiple dimensions of scientific quality. In particular, we identify four recurring types of features that capture key aspects of how research quality is represented: 1) features reflecting research methodologies; 2) features related to publication type, with literature reviews typically exhibiting higher impact; 3) features associated with high-impact research fields and technologies; and 4) features corresponding to specific scientific jargons. These findings represent an important step toward understanding how LLMs encapsulate concepts related to research quality.