ReHear: Iterative Pseudo-Label Refinement for Semi-Supervised Speech Recognition via Audio Large Language Models

作者: Zefang Liu, Chenyang Zhu, Sangwoo Cho, Shi-Xiong Zhang

分类: cs.CL, eess.AS

发布日期: 2026-02-21

💡 一句话要点

提出ReHear框架,利用音频大语言模型迭代优化伪标签,提升半监督语音识别性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 半监督学习 语音识别 伪标签 大语言模型 自训练 音频建模 迭代优化

📋 核心要点

- 传统半监督语音识别依赖伪标签,但噪声伪标签导致确认偏差和误差累积。

- ReHear利用音频大语言模型,结合语音和识别结果,迭代优化伪标签质量。

- 实验表明,ReHear有效缓解误差传播,性能超越监督学习和传统伪标签方法。

📝 摘要(中文)

半监督语音识别通常依赖于伪标签,但伪标签容易受到确认偏差和错误累积的影响。为了解决这个问题,我们提出了ReHear,一个迭代伪标签优化框架,它将指令调整的、音频感知的大语言模型(LLM)集成到自训练循环中。与传统的基于文本的校正器不同,我们的方法使LLM以ASR假设和源音频为条件,从而即使从严重的识别错误中也能恢复语音上准确的转录。这些优化的伪标签作为高保真目标,用于迭代循环中微调ASR模型。在各种基准测试上的实验结果表明,ReHear有效地缓解了错误传播,始终优于监督和伪标签基线。

🔬 方法详解

问题定义:半监督语音识别中,利用伪标签进行自训练的方法容易受到噪声伪标签的影响,导致确认偏差和错误累积,进而降低模型性能。现有的基于文本的纠错方法无法充分利用原始音频信息,难以从严重的识别错误中恢复正确的转录。

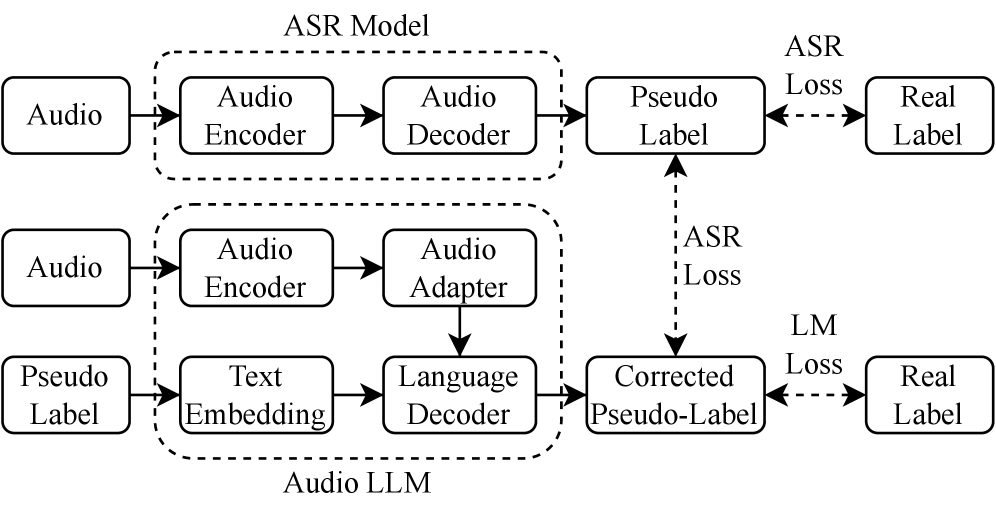

核心思路:ReHear的核心思路是利用音频大语言模型(Audio LLM)同时对ASR的识别结果和原始音频进行建模,从而更准确地纠正伪标签中的错误。通过迭代地生成和优化伪标签,逐步提升ASR模型的性能。

技术框架:ReHear框架包含以下几个主要步骤:1) 使用现有的ASR模型对未标注的音频数据进行转录,生成初始伪标签。2) 将ASR的识别结果和原始音频输入到指令调整的Audio LLM中,LLM根据指令生成更准确的转录结果,作为优化后的伪标签。3) 使用优化后的伪标签对ASR模型进行微调。4) 重复步骤1-3,进行迭代优化。

关键创新:ReHear的关键创新在于将Audio LLM引入到半监督语音识别的伪标签优化过程中。与传统的基于文本的纠错方法相比,Audio LLM能够同时利用音频和文本信息,从而更有效地纠正伪标签中的错误。此外,迭代优化策略能够逐步提升伪标签的质量和ASR模型的性能。

关键设计:ReHear的关键设计包括:1) 使用指令调整的Audio LLM,使其能够根据指令生成高质量的转录结果。2) 设计合适的指令,引导LLM进行伪标签纠错。3) 选择合适的损失函数和优化器,对ASR模型进行微调。4) 探索不同的迭代次数和学习率,以获得最佳的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ReHear在多个语音识别基准测试中均取得了显著的性能提升,超越了监督学习和传统的伪标签方法。具体而言,ReHear能够有效缓解错误传播,降低词错误率(WER),并且在不同数据集上都表现出一致的优越性。这些结果验证了ReHear框架的有效性和鲁棒性。

🎯 应用场景

ReHear可应用于各种语音识别场景,尤其是在标注数据稀缺的情况下,例如低资源语言的语音识别、特定领域的语音识别等。该方法能够有效提升语音识别系统的性能,降低对大量标注数据的依赖,具有重要的实际应用价值和潜力。未来可进一步探索其在多语种、噪声环境下的应用。

📄 摘要(原文)

Semi-supervised learning in automatic speech recognition (ASR) typically relies on pseudo-labeling, which often suffers from confirmation bias and error accumulation due to noisy supervision. To address this limitation, we propose ReHear, a framework for iterative pseudo-label refinement that integrates an instruction-tuned, audio-aware large language model (LLM) into the self-training loop. Unlike conventional text-based correctors, our approach conditions the LLM on both the ASR hypothesis and the source audio, allowing it to recover phonetically accurate transcripts even from severe recognition errors. These refined pseudo-labels serve as high-fidelity targets for fine-tuning the ASR model in an iterative cycle. Experimental results across diverse benchmarks demonstrate that ReHear effectively mitigates error propagation, consistently outperforming both supervised and pseudo-labeling baselines.