Simplifying Outcomes of Language Model Component Analyses with ELIA

作者: Aaron Louis Eidt, Nils Feldhus

分类: cs.CL, cs.AI, cs.LG

发布日期: 2026-02-20

备注: EACL 2026 System Demonstrations. GitHub: https://github.com/aaron0eidt/ELIA

💡 一句话要点

ELIA:利用AI解释简化语言模型内部机制分析,提升可访问性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可解释性AI 语言模型 组件分析 自然语言解释 交互式界面 视觉-语言模型 用户研究

📋 核心要点

- 现有语言模型可解释性分析工具复杂,导致非专业人士难以使用,限制了其应用范围。

- ELIA利用视觉-语言模型为语言模型组件分析结果生成自然语言解释,并提供交互式界面。

- 用户研究表明,ELIA显著提升了非专业人士对语言模型内部机制的理解,降低了知识门槛。

📝 摘要(中文)

针对大型语言模型(LLM)内部机制分析工具复杂性高、专家依赖性强的问题,本文设计并构建了交互式Web应用ELIA(Explainable Language Interpretability Analysis),旨在简化语言模型组件分析结果,使其更易于理解。ELIA集成了归因分析、函数向量分析和电路追踪三种关键技术,并创新性地引入了视觉-语言模型,自动生成自然语言解释(NLE)来解读复杂的可视化结果。通过混合方法用户研究验证了该方法的有效性,结果表明,用户更倾向于交互式、可探索的界面,而非简单的静态可视化。AI驱动的解释有效弥合了非专家的知识鸿沟,用户经验与理解得分之间无显著相关性,表明该系统降低了不同经验水平用户的理解门槛。结论是,AI系统可以简化复杂的模型分析,但其真正的力量在于与以用户为中心的设计相结合,优先考虑交互性、特异性和叙事指导。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)可解释性分析方法,例如归因分析、函数向量分析和电路追踪等,虽然强大,但其输出结果往往复杂且难以理解,导致只有专业人士才能有效利用这些工具。这限制了这些方法在更广泛范围内的应用,阻碍了对LLM内部工作机制的深入理解。现有方法的痛点在于缺乏易于理解的解释和交互式探索能力。

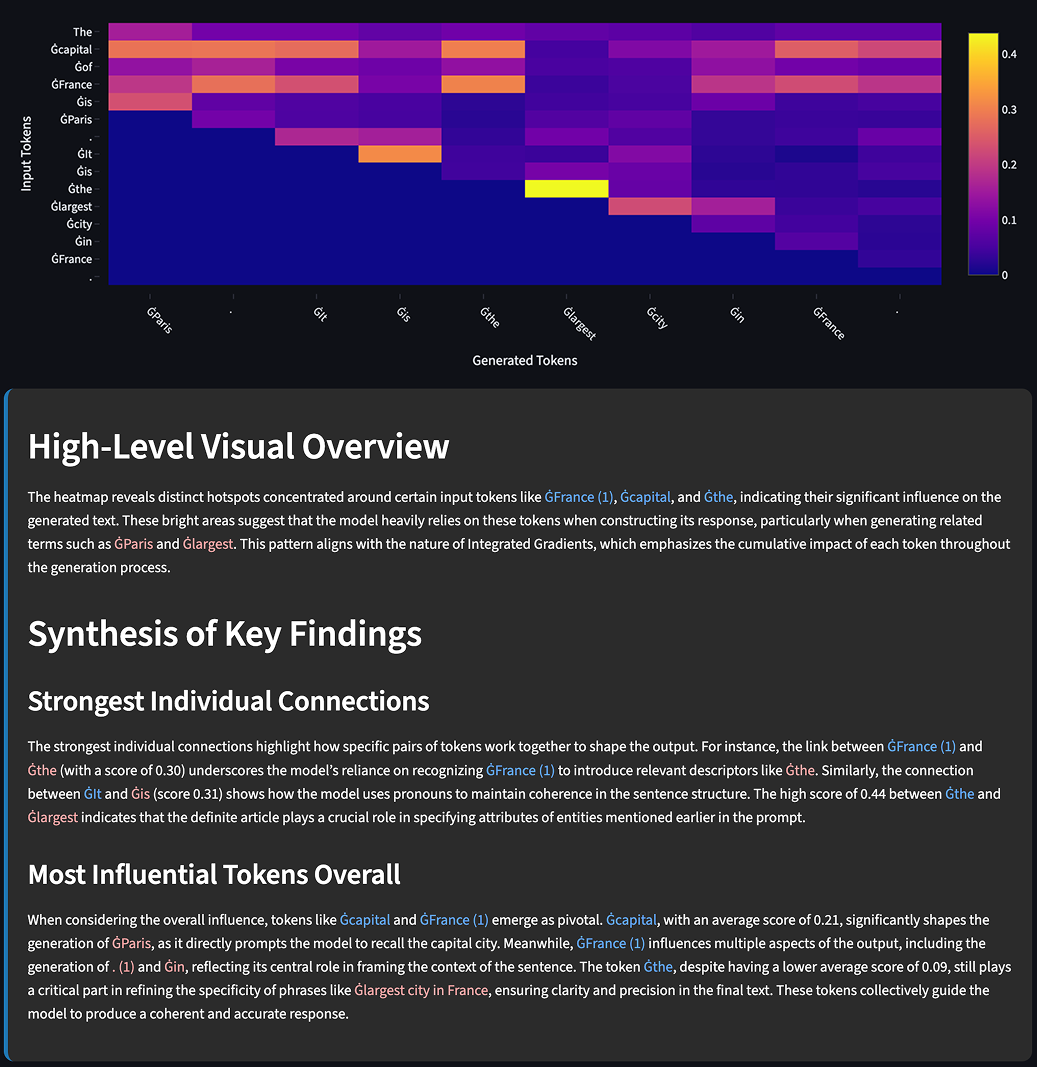

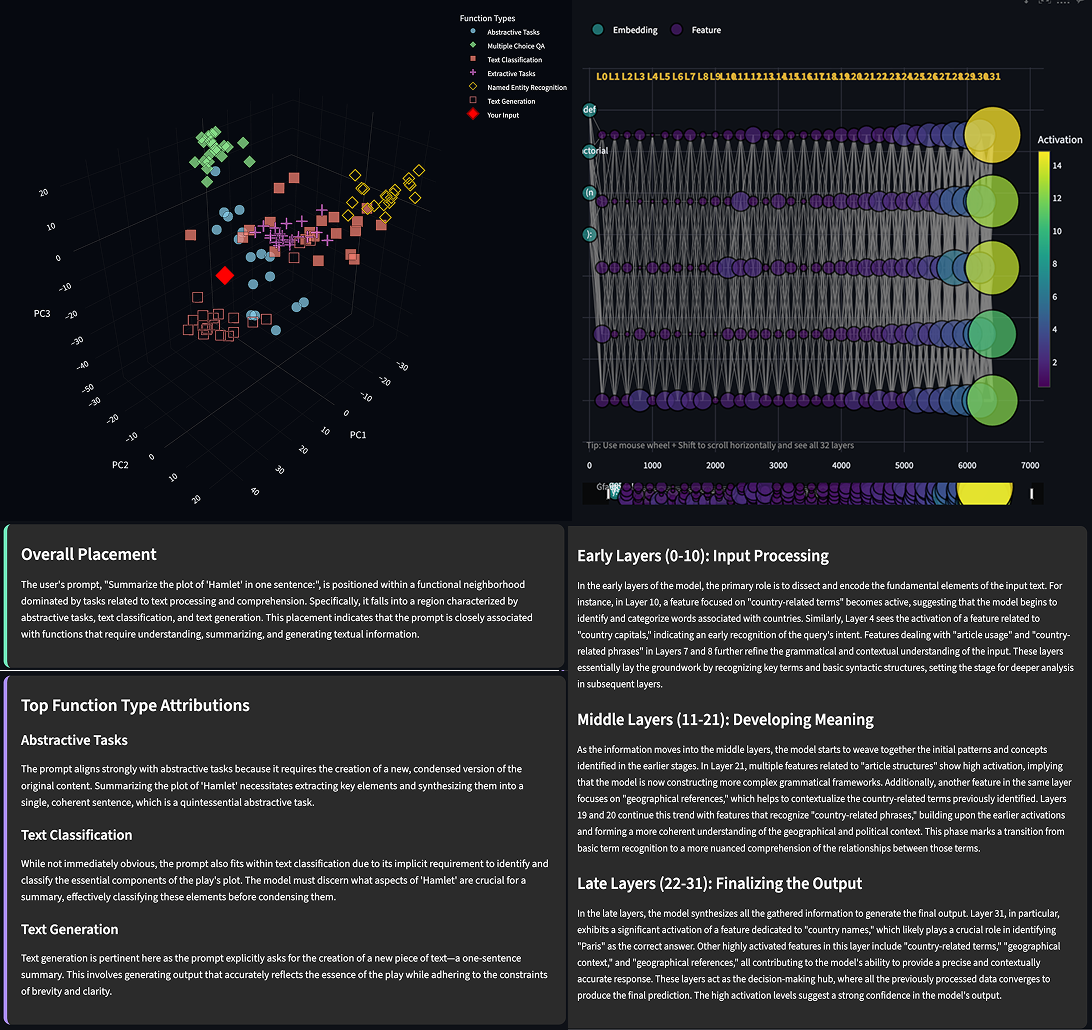

核心思路:本文的核心思路是利用AI(特别是视觉-语言模型)自动生成对复杂模型分析结果的自然语言解释(NLE)。通过将复杂的可视化结果转化为易于理解的文字描述,降低了非专业人士理解这些分析结果的门槛。此外,结合交互式Web应用,用户可以探索不同的分析结果,并根据自己的需求获取更详细的解释。

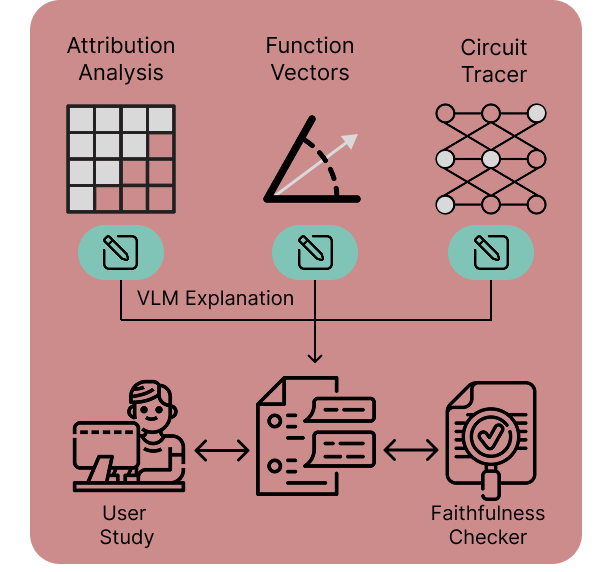

技术框架:ELIA系统主要包含三个模块:1) 集成现有的语言模型组件分析技术(归因分析、函数向量分析、电路追踪);2) 利用视觉-语言模型,将这些分析技术产生的复杂可视化结果转化为自然语言解释;3) 提供一个交互式的Web应用界面,用户可以通过该界面探索分析结果和对应的自然语言解释。整体流程是:用户选择要分析的语言模型和任务,系统运行组件分析技术,生成可视化结果,然后视觉-语言模型将这些结果转化为自然语言解释,最后用户通过Web界面查看和交互。

关键创新:最重要的技术创新点在于使用视觉-语言模型自动生成自然语言解释。与传统的静态可视化或人工解释相比,这种方法可以更快速、更灵活地为不同的分析结果生成定制化的解释。此外,交互式Web应用的设计也使得用户可以更方便地探索和理解模型内部机制。与现有方法的本质区别在于,ELIA不仅仅提供分析工具,更侧重于提供易于理解的解释和交互式探索能力。

关键设计:关于视觉-语言模型的选择和训练,论文中没有详细说明具体的模型架构和训练细节,这部分信息未知。Web应用界面的设计重点在于提供清晰的可视化展示和易于使用的交互功能,例如,用户可以通过点击不同的组件来查看对应的自然语言解释,或者通过搜索功能来查找特定的分析结果。具体的参数设置、损失函数、网络结构等技术细节在论文中没有详细描述,这部分信息未知。

🖼️ 关键图片

📊 实验亮点

用户研究表明,ELIA显著提升了非专业人士对语言模型内部机制的理解。统计分析显示,用户对LLM的先验经验与理解得分之间没有显著相关性,表明ELIA有效降低了不同经验水平用户的理解门槛。用户更倾向于使用交互式、可探索的界面,而非简单的静态可视化。

🎯 应用场景

ELIA可应用于教育领域,帮助学生理解语言模型内部机制;也可用于模型调试和优化,帮助研究人员快速定位问题;还可用于向非技术人员解释AI系统的决策过程,增强AI系统的透明度和可信度。未来,该系统可扩展到其他类型的AI模型,促进更广泛的可解释性研究。

📄 摘要(原文)

While mechanistic interpretability has developed powerful tools to analyze the internal workings of Large Language Models (LLMs), their complexity has created an accessibility gap, limiting their use to specialists. We address this challenge by designing, building, and evaluating ELIA (Explainable Language Interpretability Analysis), an interactive web application that simplifies the outcomes of various language model component analyses for a broader audience. The system integrates three key techniques -- Attribution Analysis, Function Vector Analysis, and Circuit Tracing -- and introduces a novel methodology: using a vision-language model to automatically generate natural language explanations (NLEs) for the complex visualizations produced by these methods. The effectiveness of this approach was empirically validated through a mixed-methods user study, which revealed a clear preference for interactive, explorable interfaces over simpler, static visualizations. A key finding was that the AI-powered explanations helped bridge the knowledge gap for non-experts; a statistical analysis showed no significant correlation between a user's prior LLM experience and their comprehension scores, suggesting that the system reduced barriers to comprehension across experience levels. We conclude that an AI system can indeed simplify complex model analyses, but its true power is unlocked when paired with thoughtful, user-centered design that prioritizes interactivity, specificity, and narrative guidance.