Detecting Contextual Hallucinations in LLMs with Frequency-Aware Attention

作者: Siya Qi, Yudong Chen, Runcong Zhao, Qinglin Zhu, Zhanghao Hu, Wei Liu, Yulan He, Zheng Yuan, Lin Gui

分类: cs.CL

发布日期: 2026-02-20

备注: 25 pages, 10 figures

💡 一句话要点

提出基于频率感知的注意力机制,用于检测LLM在上下文生成中的幻觉问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 幻觉检测 注意力机制 频率分析 上下文生成

📋 核心要点

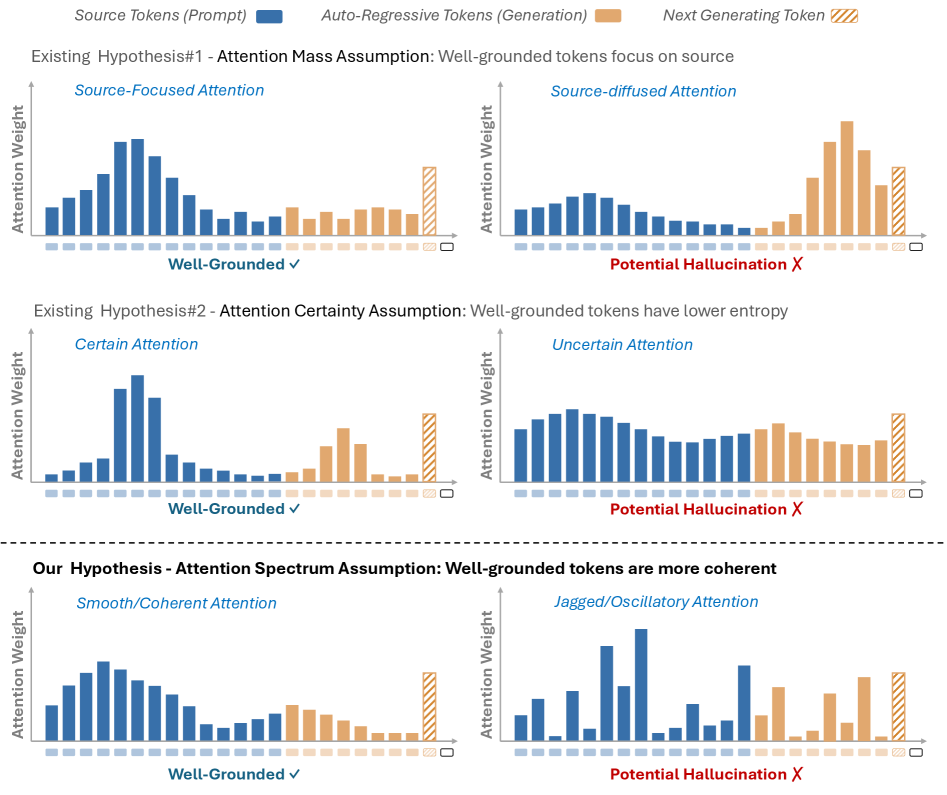

- 现有方法在检测LLM幻觉时,对注意力机制的利用不够精细,无法捕捉到细粒度的不稳定性。

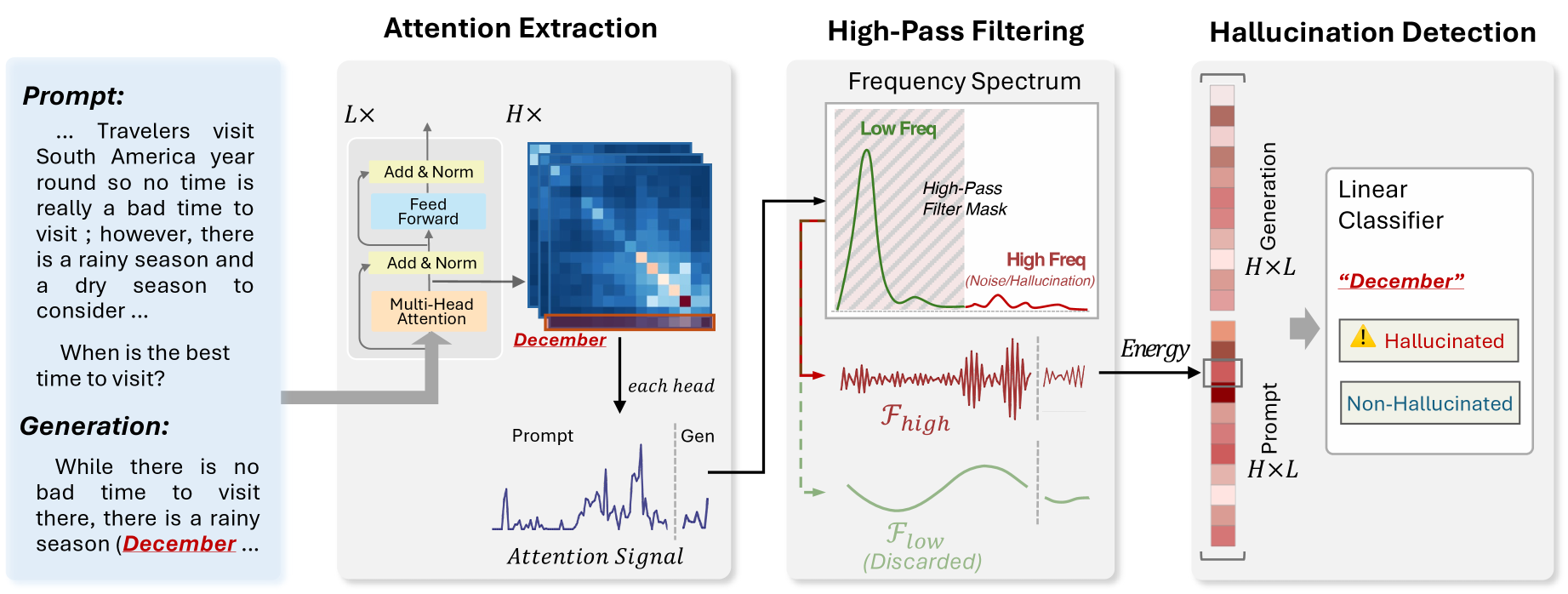

- 论文提出一种频率感知的注意力机制,将注意力分布视为信号,分析其高频分量以反映 grounding 行为。

- 实验表明,该方法在幻觉检测任务上优于现有方法,证明了高频注意力特征的有效性。

📝 摘要(中文)

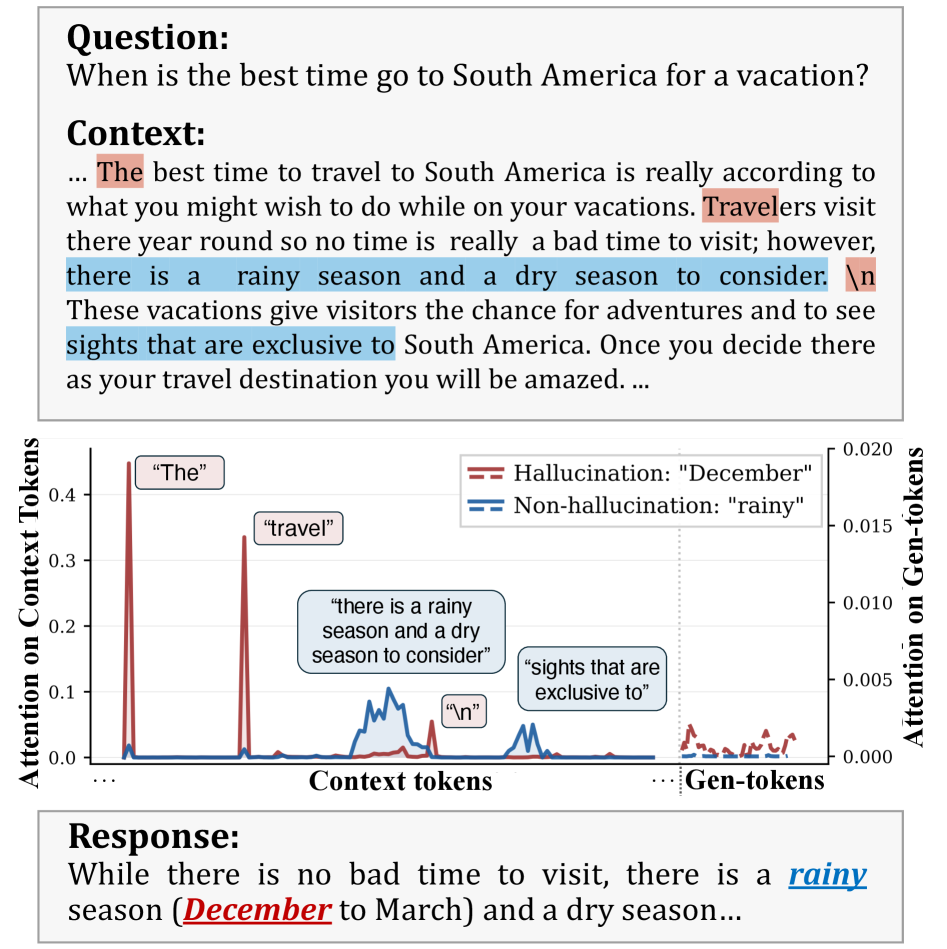

幻觉检测对于确保大型语言模型(LLM)在基于上下文生成中的可靠性至关重要。先前的工作探索了生成过程中可用的内在信号,其中注意力机制直接反映了 grounding 行为。然而,现有方法通常依赖于粗略的总结,无法捕捉注意力中的细粒度不稳定性。受信号处理的启发,我们通过分析注意力在生成过程中的变化,引入了一种频率感知的注意力视角。我们将注意力分布建模为离散信号,并提取反映注意力快速局部变化的高频分量。我们的分析表明,幻觉 token 与高频注意力能量相关联,反映了碎片化和不稳定的 grounding 行为。基于这一洞察,我们开发了一种使用高频注意力特征的轻量级幻觉检测器。在 RAGTruth 和 HalluRAG 基准测试上的实验表明,我们的方法在模型和任务中实现了优于基于验证、基于内部表示和基于注意力的方法的性能提升。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在上下文生成过程中出现的幻觉问题。现有方法在利用注意力机制进行幻觉检测时,通常采用粗略的总结方式,忽略了注意力分布中细粒度的不稳定性,导致检测精度受限。这些方法无法有效捕捉到幻觉token对应的碎片化和不稳定的 grounding 行为。

核心思路:论文的核心思路是将注意力分布视为离散信号,并借鉴信号处理中的频率分析方法,提取注意力分布中的高频分量。作者认为,幻觉token的生成与注意力分布的快速局部变化(即高频分量)密切相关,因为幻觉通常伴随着不稳定的 grounding 行为。通过分析注意力的高频能量,可以更有效地检测LLM的幻觉。

技术框架:该方法主要包含以下几个阶段:1) 将LLM的注意力分布建模为离散信号。2) 对注意力信号进行频率分析,提取高频分量。3) 利用高频注意力特征训练一个轻量级的幻觉检测器。该检测器可以判断生成的token是否为幻觉。整体流程简单高效,易于集成到现有的LLM系统中。

关键创新:该论文最重要的技术创新点在于引入了频率感知的注意力视角。与现有方法不同,该方法不再简单地对注意力分布进行粗略的总结,而是通过分析注意力分布的频率特征,更精细地捕捉 grounding 行为的不稳定性。这种方法能够更有效地识别与幻觉相关的注意力模式。

关键设计:论文的关键设计包括:1) 如何将注意力分布建模为离散信号。2) 如何选择合适的频率分析方法(例如傅里叶变换)来提取高频分量。3) 如何设计轻量级的幻觉检测器,使其能够高效地利用高频注意力特征进行幻觉检测。具体的参数设置和网络结构在论文中可能有所描述,但摘要中未提及。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在 RAGTruth 和 HalluRAG 基准测试上,相较于基于验证、基于内部表示和基于注意力的现有方法,取得了性能上的提升。具体提升幅度未知,但强调了该方法在不同模型和任务上的有效性。这表明基于频率感知的注意力机制能够更有效地检测LLM的幻觉。

🎯 应用场景

该研究成果可应用于各种需要可靠上下文生成的大型语言模型应用中,例如问答系统、对话生成、文本摘要等。通过提高LLM生成内容的真实性和可靠性,可以增强用户信任度,并减少因幻觉导致的错误信息传播。该技术还有助于开发更安全、更值得信赖的AI系统。

📄 摘要(原文)

Hallucination detection is critical for ensuring the reliability of large language models (LLMs) in context-based generation. Prior work has explored intrinsic signals available during generation, among which attention offers a direct view of grounding behavior. However, existing approaches typically rely on coarse summaries that fail to capture fine-grained instabilities in attention. Inspired by signal processing, we introduce a frequency-aware perspective on attention by analyzing its variation during generation. We model attention distributions as discrete signals and extract high-frequency components that reflect rapid local changes in attention. Our analysis reveals that hallucinated tokens are associated with high-frequency attention energy, reflecting fragmented and unstable grounding behavior. Based on this insight, we develop a lightweight hallucination detector using high-frequency attention features. Experiments on the RAGTruth and HalluRAG benchmarks show that our approach achieves performance gains over verification-based, internal-representation-based, and attention-based methods across models and tasks.