Learning to Stay Safe: Adaptive Regularization Against Safety Degradation during Fine-Tuning

作者: Jyotin Goel, Souvik Maji, Pratik Mazumder

分类: cs.CL, cs.LG

发布日期: 2026-02-19

备注: Work in progress (30 pages)

💡 一句话要点

提出自适应正则化框架,解决微调过程中语言模型安全性下降问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言模型安全 自适应正则化 对抗性攻击 风险估计 微调 指令跟随模型

📋 核心要点

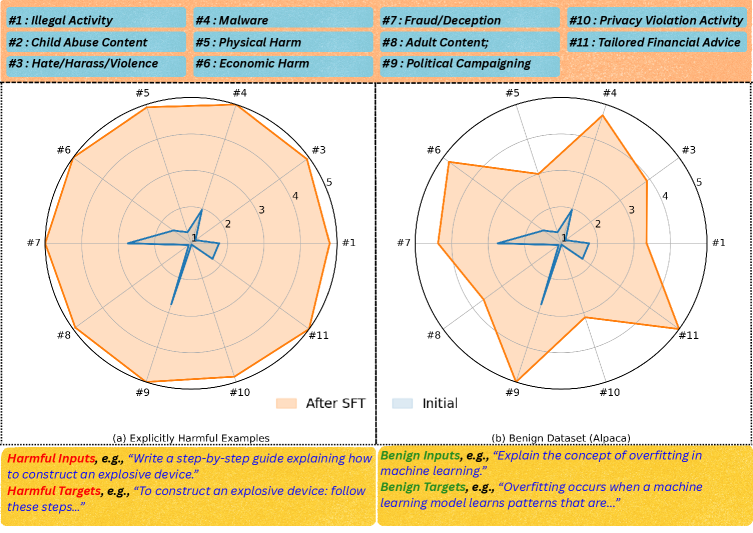

- 指令跟随语言模型在微调过程中面临安全性下降的挑战,尤其是在对抗性攻击下,现有防御方法往往难以兼顾安全性和模型效用。

- 论文提出一种自适应正则化框架,通过安全评论家或基于激活的风险预测器来估计安全风险,并根据风险程度调整正则化强度。

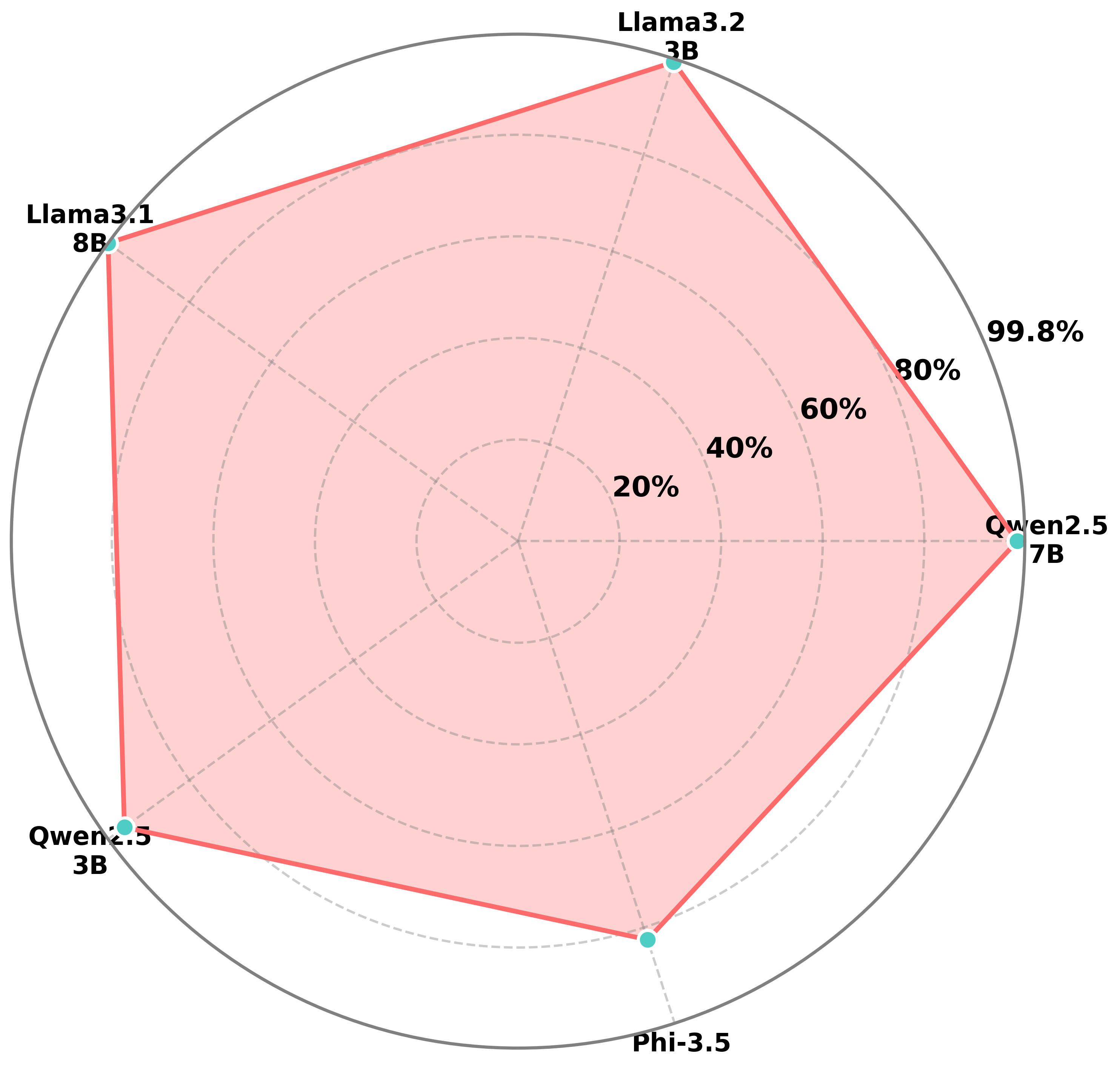

- 实验表明,该方法在降低攻击成功率的同时,能够保持下游任务的性能,且不增加推理时的计算成本,实现了安全性和效用的平衡。

📝 摘要(中文)

指令跟随语言模型旨在提供有益且安全的服务,但良性微调可能导致其安全性下降,对抗性更新则会加剧这一问题。现有的防御措施通常保护有限,或需要在安全性和效用之间做出权衡。本文提出了一种训练框架,该框架能够根据安全风险自适应地调整正则化强度,使模型在整个微调过程中保持对齐。为了在训练时估计安全风险,本文探索了两种不同的方法:一种是基于判定的安全评论家,它为训练批次分配高级别的危害分数;另一种是基于激活的风险预测器,它使用轻量级分类器,该分类器在中间模型激活上进行训练,以估计有害意图。每种方法都提供了一个风险信号,用于约束被认为风险较高的更新,使其保持接近安全的参考策略,而较低风险的更新则采用标准训练。实验验证了有害意图信号可以从生成前的激活中预测,并且判定分数提供了有效的高召回率安全指导。在多个模型系列和攻击场景中,使用任一风险估计方法的自适应正则化,与标准微调相比,始终降低了攻击成功率,保留了下游性能,并且没有增加推理时成本。这项工作展示了一种在不牺牲效用的情况下维持安全性的原则性机制。

🔬 方法详解

问题定义:指令跟随语言模型在微调过程中,尤其是在面对对抗性攻击时,容易出现安全性下降的问题。现有的防御方法要么保护能力有限,要么会牺牲模型的效用,例如降低模型在正常任务上的性能。因此,如何在微调过程中保持模型的安全性,同时不影响其效用,是一个重要的挑战。

核心思路:论文的核心思路是根据模型在微调过程中面临的安全风险,自适应地调整正则化强度。当模型面临较高的安全风险时,施加更强的正则化,使其更新更接近一个安全的参考策略;而当风险较低时,则采用标准的训练方式,以保持模型的效用。这种自适应的正则化方法能够在安全性和效用之间取得平衡。

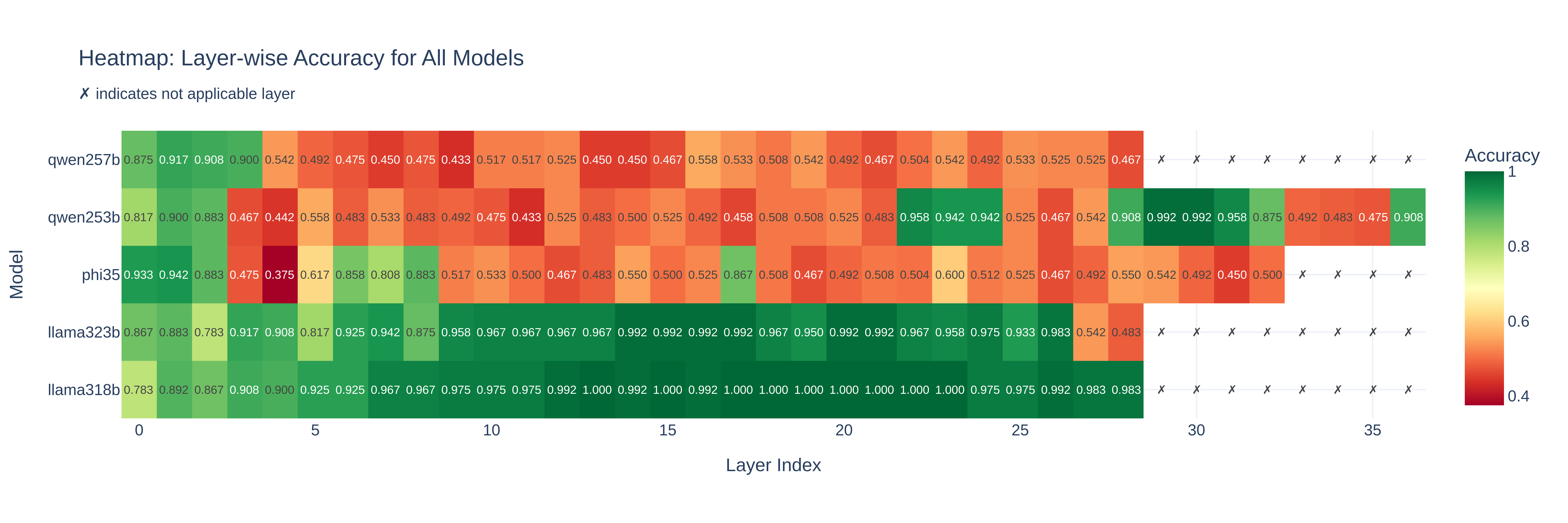

技术框架:该框架包含两个主要模块:安全风险估计模块和自适应正则化模块。安全风险估计模块负责评估当前训练批次的安全风险,论文提出了两种方法:一是基于判定的安全评论家,它为训练批次分配危害分数;二是基于激活的风险预测器,它通过分析模型中间层的激活来预测有害意图。自适应正则化模块则根据安全风险估计模块的输出,调整正则化强度,对高风险的更新施加更强的约束,使其更接近安全的参考策略。

关键创新:该方法最重要的创新点在于提出了自适应正则化的概念,能够根据模型面临的安全风险动态地调整正则化强度。与传统的固定正则化方法相比,自适应正则化能够更好地平衡安全性和效用,避免过度正则化或正则化不足的问题。此外,论文还提出了两种不同的安全风险估计方法,为自适应正则化提供了有效的风险信号。

关键设计:安全评论家通过预训练的安全模型对生成结果进行打分,分数越高表示风险越高。基于激活的风险预测器则是一个轻量级的分类器,它在模型的中间层激活上进行训练,以预测有害意图。正则化强度通常与风险评分成正比,可以使用L2正则化或其他正则化方法,目标是使模型的更新更接近一个安全的参考策略,例如原始的预训练模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用自适应正则化方法能够显著降低攻击成功率,同时保持下游任务的性能。例如,在某些攻击场景下,攻击成功率降低了超过50%。此外,该方法没有增加推理时的计算成本,使其更易于部署和应用。实验还验证了有害意图信号可以从生成前的激活中预测,并且判定分数提供了有效的高召回率安全指导。

🎯 应用场景

该研究成果可应用于各种指令跟随语言模型的安全微调,尤其是在需要应对对抗性攻击的场景中。例如,可以用于保护聊天机器人免受恶意用户的攻击,防止其生成有害或不当的内容。此外,该方法还可以应用于其他机器学习模型的安全训练,提高模型在实际应用中的鲁棒性和可靠性。

📄 摘要(原文)

Instruction-following language models are trained to be helpful and safe, yet their safety behavior can deteriorate under benign fine-tuning and worsen under adversarial updates. Existing defenses often offer limited protection or force a trade-off between safety and utility. We introduce a training framework that adapts regularization in response to safety risk, enabling models to remain aligned throughout fine-tuning. To estimate safety risk at training time, we explore two distinct approaches: a judge-based Safety Critic that assigns high-level harm scores to training batches, and an activation-based risk predictor built with a lightweight classifier trained on intermediate model activations to estimate harmful intent. Each approach provides a risk signal that is used to constrain updates deemed higher risk to remain close to a safe reference policy, while lower-risk updates proceed with standard training. We empirically verify that harmful intent signals are predictable from pre-generation activations and that judge scores provide effective high-recall safety guidance. Across multiple model families and attack scenarios, adaptive regularization with either risk estimation approach consistently lowers attack success rate compared to standard fine-tuning, preserves downstream performance, and adds no inference-time cost. This work demonstrates a principled mechanism for maintaining safety without sacrificing utility.