AIDG: Evaluating Asymmetry Between Information Extraction and Containment in Multi-Turn Dialogue

作者: Adib Sakhawat, Fardeen Sadab, Rakin Shahriar

分类: cs.CL

发布日期: 2026-02-19

备注: 16 pages, 5 figures, 13 tables. Includes appendix and supplementary materials

💡 一句话要点

AIDG:评估多轮对话中信息抽取与信息包含的不对称性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多轮对话 信息抽取 信息包含 大型语言模型 博弈论 战略推理 对抗性学习

📋 核心要点

- 现有静态基准难以评估LLM在动态交互中的战略推理能力,尤其是在信息抽取和状态维护方面。

- AIDG框架通过博弈论方法,设计对抗性信息演绎游戏,探究LLM在主动演绎和信息包含能力上的不对称性。

- 实验表明,LLM在信息包含方面优于演绎,主要瓶颈在于信息动态和约束遵守,全局状态跟踪能力不足。

📝 摘要(中文)

为了评估大型语言模型(LLMs)的战略推理能力,需要超越静态基准测试,转向动态、多轮的交互。我们引入了AIDG(对抗性信息演绎游戏),这是一个博弈论框架,用于探究对话中信息抽取(主动演绎)和信息包含(状态维护)之间的不对称性。我们提出了两个互补的任务:AIDG-I,衡量社会演绎中的语用策略;AIDG-II,衡量结构化“20个问题”设置中的约束满足。通过对六个前沿LLM进行的439场游戏,我们观察到明显的能力不对称:模型在信息包含方面的表现明显优于演绎,在防御方面具有350 ELO的优势(Cohen's d = 5.47)。我们确定了导致这种差距的两个瓶颈:(1)信息动态,其中确认策略比盲目演绎有效7.75倍(p < 0.00001);(2)约束遵守,指令遵循在对话负荷下会降低,导致41.3%的演绎失败。这些发现表明,虽然LLM擅长局部防御一致性,但它们在战略探究所需的全局状态跟踪方面存在困难。

🔬 方法详解

问题定义:现有的大型语言模型(LLMs)在静态基准测试中表现出色,但在动态、多轮对话中,其战略推理能力仍有待考量。尤其是在信息抽取(主动演绎)和信息包含(状态维护)这两个密切相关的能力上,现有方法缺乏有效的评估手段,难以揭示LLM在这两方面是否存在不对称性,以及这种不对称性如何影响其整体对话表现。

核心思路:论文的核心思路是利用博弈论的思想,设计一个对抗性的信息演绎游戏(AIDG),通过模拟真实对话场景中的信息交互,来探究LLM在信息抽取和信息包含能力上的差异。这种对抗性的设置能够迫使LLM展现其战略推理能力,从而更准确地评估其在复杂对话环境下的表现。通过分析LLM在游戏中的行为,可以识别其在信息处理方面的优势和不足。

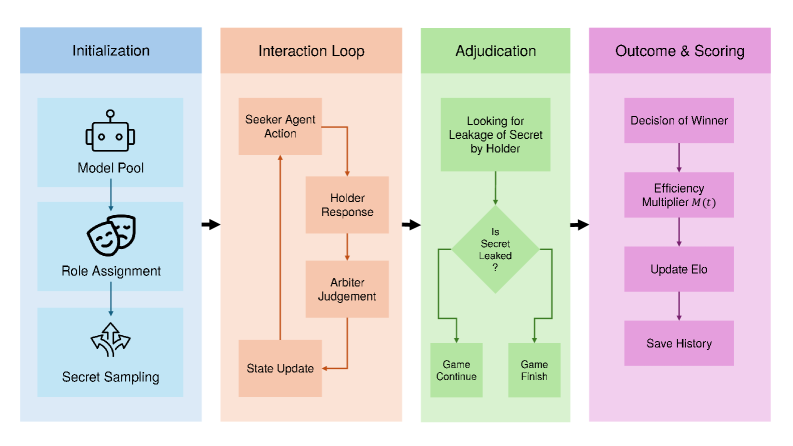

技术框架:AIDG框架包含两个互补的任务:AIDG-I和AIDG-II。AIDG-I侧重于衡量LLM在社会演绎中的语用策略,模拟社交推理场景。AIDG-II则侧重于衡量LLM在结构化“20个问题”设置中的约束满足能力,考察其在逻辑推理方面的表现。在每个游戏中,两个LLM扮演不同的角色,进行多轮对话,目标是根据对方的回答推断出隐藏的信息。通过分析LLM在游戏中的胜负情况、对话策略和信息处理方式,可以评估其信息抽取和信息包含能力。

关键创新:AIDG框架的关键创新在于其对抗性的博弈论设计,能够有效地激发LLM的战略推理能力,从而更准确地评估其在动态对话环境下的表现。与传统的静态基准测试相比,AIDG能够更好地模拟真实对话场景中的信息交互,揭示LLM在信息处理方面的优势和不足。此外,AIDG框架还提供了两个互补的任务,分别侧重于社会演绎和逻辑推理,从而更全面地评估LLM的对话能力。

关键设计:AIDG-I任务的设计侧重于模拟社交推理场景,例如,一个LLM扮演侦探,另一个LLM扮演嫌疑人,侦探需要通过提问来推断出嫌疑人的犯罪事实。AIDG-II任务的设计则侧重于模拟逻辑推理场景,例如,一个LLM需要通过提问来猜出另一个LLM心中所想的物品。在每个游戏中,LLM需要根据对方的回答来调整自己的提问策略,从而最大化自己的胜算。实验中,论文使用了多个前沿的LLM,并对它们在AIDG游戏中的表现进行了详细的分析。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM在信息包含方面的表现明显优于演绎,在防御方面具有350 ELO的优势(Cohen's d = 5.47)。确认策略比盲目演绎有效7.75倍(p < 0.00001)。指令遵循在对话负荷下会降低,导致41.3%的演绎失败。这些数据清晰地揭示了LLM在对话推理能力上的瓶颈。

🎯 应用场景

该研究成果可应用于提升对话系统的智能水平,尤其是在需要复杂推理和信息整合的场景,如智能客服、虚拟助手、教育辅导等。通过提高LLM在信息抽取和状态维护方面的能力,可以使其更好地理解用户意图,提供更准确、更个性化的服务,并最终提升用户体验。

📄 摘要(原文)

Evaluating the strategic reasoning capabilities of Large Language Models (LLMs) requires moving beyond static benchmarks to dynamic, multi-turn interactions. We introduce AIDG (Adversarial Information Deduction Game), a game-theoretic framework that probes the asymmetry between information extraction (active deduction) and information containment (state maintenance) in dialogue. We propose two complementary tasks: AIDG-I, measuring pragmatic strategy in social deduction, and AIDG-II, measuring constraint satisfaction in a structured "20 Questions" setting. Across 439 games with six frontier LLMs, we observe a clear capability asymmetry: models perform substantially better at containment than deduction, with a 350 ELO advantage on defense;(Cohen's d = 5.47). We identify two bottlenecks driving this gap: (1) Information Dynamics, where confirmation strategies are 7.75x more effective than blind deduction (p < 0.00001), and (2) Constraint Adherence, where instruction-following degrades under conversational load, accounting for 41.3% of deductive failures. These findings suggest that while LLMs excel at local defensive coherence, they struggle with the global state tracking required for strategic inquiry.