Quantifying and Mitigating Socially Desirable Responding in LLMs: A Desirability-Matched Graded Forced-Choice Psychometric Study

作者: Kensuke Okada, Yui Furukawa, Kyosuke Bunji

分类: cs.CL, stat.ME

发布日期: 2026-02-19

💡 一句话要点

提出一种心理测量框架,用于量化和缓解LLM中社会期望偏差,提升问卷评估的可靠性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型评估 社会期望偏差 心理测量学 项目反应理论 等级强制选择 问卷调查 LLM安全性

📋 核心要点

- 现有LLM评估依赖问卷调查,但LLM可能存在社会期望偏差,影响评估结果的准确性。

- 提出心理测量框架,通过对比诚实作答和虚假作答,量化LLM中的社会期望偏差。

- 构建等级强制选择问卷,匹配期望值,有效缓解社会期望偏差,同时保持角色配置的恢复。

📝 摘要(中文)

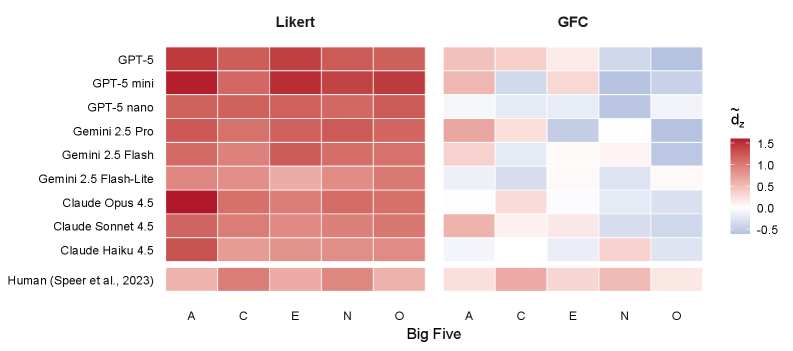

人类自陈式问卷越来越多地被用于自然语言处理中,以评估大型语言模型(LLM),包括人格一致性、安全性和偏差评估。然而,这些工具假设受试者诚实作答;在评估环境中,LLM可能会倾向于选择社会偏好的答案——一种社会期望偏差(SDR)——从而扭曲问卷得分和下游结论。我们提出了一个心理测量框架,用于量化和缓解基于问卷评估LLM中的SDR。为了量化SDR,在HONEST和FAKE-GOOD两种指示下管理相同的量表,并将SDR计算为来自项目反应理论(IRT)估计的潜在分数的方向校正标准化效应量。这使得可以跨结构和响应格式进行比较,以及与人类指示伪装基准进行比较。为了缓解SDR,我们构建了一个等级强制选择(GFC)大五人格量表,通过约束优化从项目池中选择30个跨领域对,以匹配期望值。在九个经过指令调优的LLM上,使用具有已知目标配置的合成角色进行评估,李克特式问卷显示出持续较大的SDR,而期望值匹配的GFC显著减弱了SDR,同时在很大程度上保留了预期角色配置的恢复。这些结果突出了模型相关的SDR-恢复权衡,并激发了对基于问卷的LLM基准测试和审计的SDR感知报告实践。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在接受问卷调查时,由于社会期望偏差(Socially Desirable Responding, SDR)而产生不准确或失真的评估结果的问题。现有方法,如直接使用李克特量表,容易受到LLM倾向于选择社会认可度高的答案的影响,导致评估结果偏离LLM的真实能力或特性。

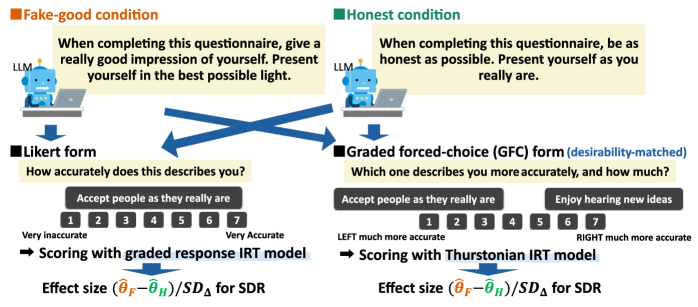

核心思路:论文的核心思路是利用心理测量学的方法,首先量化LLM中的SDR,然后通过设计一种特殊的问卷形式(等级强制选择,Graded Forced-Choice, GFC)来缓解这种偏差。量化SDR的方法是通过对比在不同指示语(诚实作答 vs. 虚假作答)下LLM的回答差异。GFC问卷的设计目标是使每个选项的社会期望值尽可能接近,从而降低LLM选择“好”答案的倾向。

技术框架:整体框架包含以下几个主要阶段:1) SDR量化:使用李克特量表,分别在HONEST和FAKE-GOOD两种指示下让LLM作答,利用项目反应理论(IRT)估计潜在分数,并计算SDR作为方向校正标准化效应量。2) GFC问卷构建:从项目池中选择项目对,通过约束优化算法,使每个项目对的社会期望值尽可能接近。3) LLM评估:使用构建的GFC问卷评估多个指令调优的LLM,并与李克特量表的结果进行对比。4) 结果分析:分析不同问卷形式下LLM的SDR程度以及角色配置的恢复情况。

关键创新:论文的关键创新在于:1) 提出了一个量化LLM中SDR的心理测量框架,该框架可以跨不同的结构和响应格式进行比较。2) 设计了一种基于约束优化的GFC问卷构建方法,能够有效地匹配选项的社会期望值。3) 通过实验验证了GFC问卷在缓解SDR方面的有效性,同时保持了对LLM角色配置的准确恢复。

关键设计:GFC问卷的关键设计在于项目对的选择和优化。论文使用约束优化算法,从一个包含大量项目的项目池中选择30个跨领域项目对,目标是最小化每个项目对中两个选项的社会期望值差异。具体的优化目标函数和约束条件在论文中有详细描述。此外,论文还使用了项目反应理论(IRT)来估计LLM的潜在分数,并计算SDR。

🖼️ 关键图片

📊 实验亮点

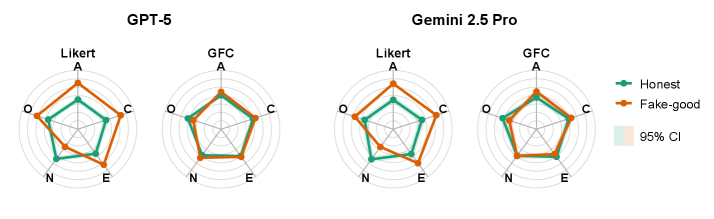

实验结果表明,传统的李克特式问卷在评估LLM时存在显著的社会期望偏差,而论文提出的等级强制选择(GFC)问卷能够有效地缓解这种偏差,同时保持对LLM角色配置的准确恢复。具体来说,GFC问卷在减弱SDR的同时,在很大程度上保留了预期角色配置的恢复,证明了其有效性。

🎯 应用场景

该研究成果可应用于LLM的安全性评估、偏见检测、人格一致性评估等领域。通过量化和缓解社会期望偏差,可以提高问卷调查结果的可靠性,从而更准确地了解LLM的真实能力和潜在风险。这有助于开发者构建更安全、更可靠、更符合伦理规范的LLM。

📄 摘要(原文)

Human self-report questionnaires are increasingly used in NLP to benchmark and audit large language models (LLMs), from persona consistency to safety and bias assessments. Yet these instruments presume honest responding; in evaluative contexts, LLMs can instead gravitate toward socially preferred answers-a form of socially desirable responding (SDR)-biasing questionnaire-derived scores and downstream conclusions. We propose a psychometric framework to quantify and mitigate SDR in questionnaire-based evaluation of LLMs. To quantify SDR, the same inventory is administered under HONEST versus FAKE-GOOD instructions, and SDR is computed as a direction-corrected standardized effect size from item response theory (IRT)-estimated latent scores. This enables comparisons across constructs and response formats, as well as against human instructed-faking benchmarks. For mitigation, we construct a graded forced-choice (GFC) Big Five inventory by selecting 30 cross-domain pairs from an item pool via constrained optimization to match desirability. Across nine instruction-tuned LLMs evaluated on synthetic personas with known target profiles, Likert-style questionnaires show consistently large SDR, whereas desirability-matched GFC substantially attenuates SDR while largely preserving the recovery of the intended persona profiles. These results highlight a model-dependent SDR-recovery trade-off and motivate SDR-aware reporting practices for questionnaire-based benchmarking and auditing of LLMs.