Supercharging Agenda Setting Research: The ParlaCAP Dataset of 28 European Parliaments and a Scalable Multilingual LLM-Based Classification

作者: Taja Kuzman Pungeršek, Peter Rupnik, Daniela Širinić, Nikola Ljubešić

分类: cs.CL

发布日期: 2026-02-18

备注: 17 pages, 7 figures, 7 tables. Submitted to the PoliticalNLP 2026 workshop, co-located with LREC 2026 conference

💡 一句话要点

提出ParlaCAP数据集和基于LLM的多语种议题分类方法,用于欧洲议会政治议程分析。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 议会研究 政治议程设置 多语种处理 大型语言模型 文本分类

📋 核心要点

- 现有议程设置研究缺乏大规模、多语种的议会数据,限制了跨国比较分析的深度和广度。

- 利用LLM的强大能力,自动标注大规模议会语料,并用标注数据微调多语种编码器,构建领域定制的分类器。

- 实验表明,该方法在议题分类任务上表现优异,LLM标注质量与人工标注相当,模型性能超越现有方法。

📝 摘要(中文)

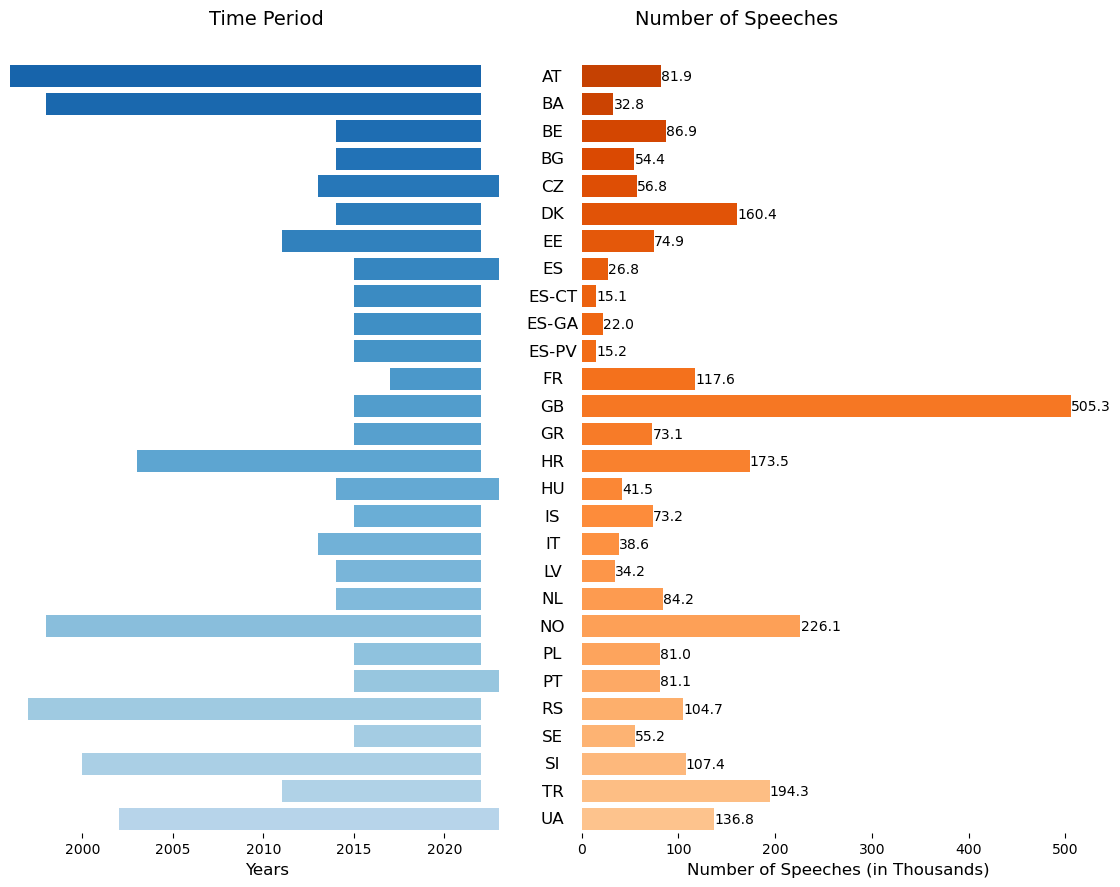

本文介绍了ParlaCAP,一个用于分析欧洲议会政治议程设置的大规模数据集,并提出了一种经济高效的方法来构建特定领域的政策主题分类器。通过将比较议程项目(CAP)模式应用于来自28个欧洲国家和自治区的议会的ParlaMint多语种语料库(超过800万篇演讲),我们遵循一种teacher-student框架,其中高性能的大型语言模型(LLM)标注领域内训练数据,并且多语种编码器模型在这些标注上进行微调,以实现可扩展的数据标注。我们表明,这种方法产生了一个针对目标领域量身定制的分类器。LLM和人工标注者之间的一致性与人类之间的标注者间一致性相当,并且由此产生的模型优于在手动标注但领域外数据上训练的现有CAP分类器。除了CAP标注之外,ParlaCAP数据集还提供丰富的发言者和政党元数据,以及来自ParlaSent多语种Transformer模型的情感预测,从而能够对跨国家的政治关注和代表性进行比较研究。我们通过三个用例来说明数据集的分析潜力,研究议会对政策主题的关注分布、议会演讲中的情感模式以及政策关注中的性别差异。

🔬 方法详解

问题定义:论文旨在解决欧洲议会研究中缺乏大规模、多语言议程设置数据集的问题。现有方法依赖于人工标注,成本高昂且难以扩展到多语种环境。此外,现有的CAP分类器通常在领域外数据上训练,无法很好地适应议会领域的特殊性。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大能力,以teacher-student的方式自动标注大规模议会语料库,然后使用这些自动标注的数据来微调一个多语种编码器模型。这样既可以降低标注成本,又可以构建一个针对议会领域定制的分类器。

技术框架:整体框架包含以下几个主要阶段: 1. 数据收集:收集来自28个欧洲议会的ParlaMint多语种语料库,包含超过800万篇演讲。 2. LLM标注:使用高性能LLM(作为teacher)根据Comparative Agendas Project (CAP) schema对语料进行自动标注。 3. 模型微调:使用LLM标注的数据微调一个多语种编码器模型(作为student)。 4. 模型评估:评估微调后的模型在议题分类任务上的性能。

关键创新:最重要的技术创新点在于利用LLM进行大规模、低成本的领域内数据标注。与传统的人工标注相比,该方法大大降低了成本,并提高了标注效率。与在领域外数据上训练的分类器相比,该方法能够更好地适应议会领域的特殊性,从而提高分类精度。

关键设计:论文采用了teacher-student框架,LLM作为teacher负责生成高质量的标注数据,多语种编码器模型作为student负责学习这些标注数据。具体来说,LLM使用zero-shot或few-shot的方式进行标注,然后使用标注数据微调一个基于Transformer的编码器模型。损失函数通常采用交叉熵损失函数,优化器可以选择Adam或AdamW等。具体的参数设置和网络结构取决于所选择的LLM和编码器模型。

🖼️ 关键图片

📊 实验亮点

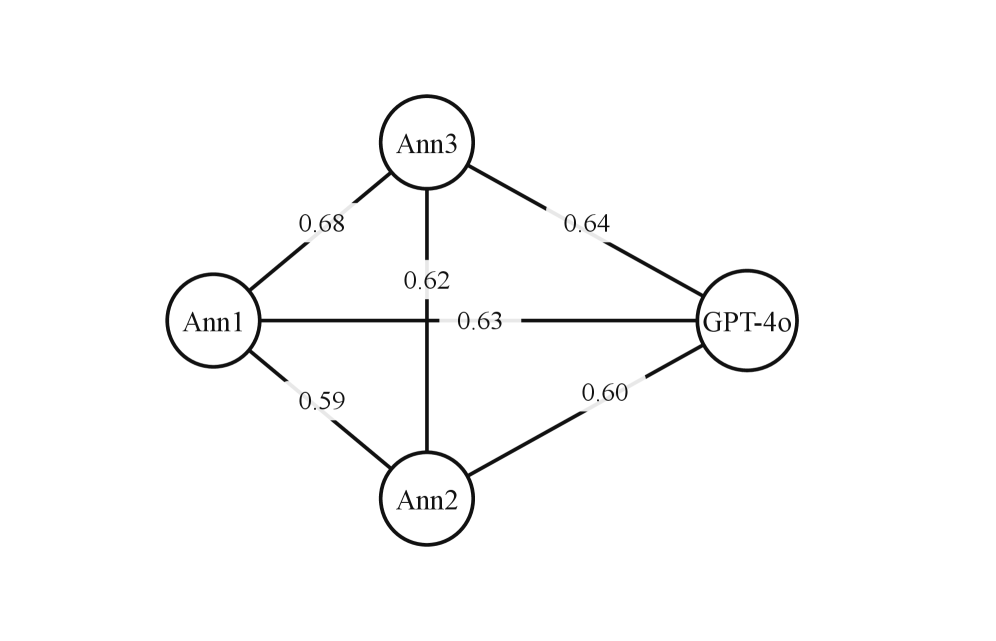

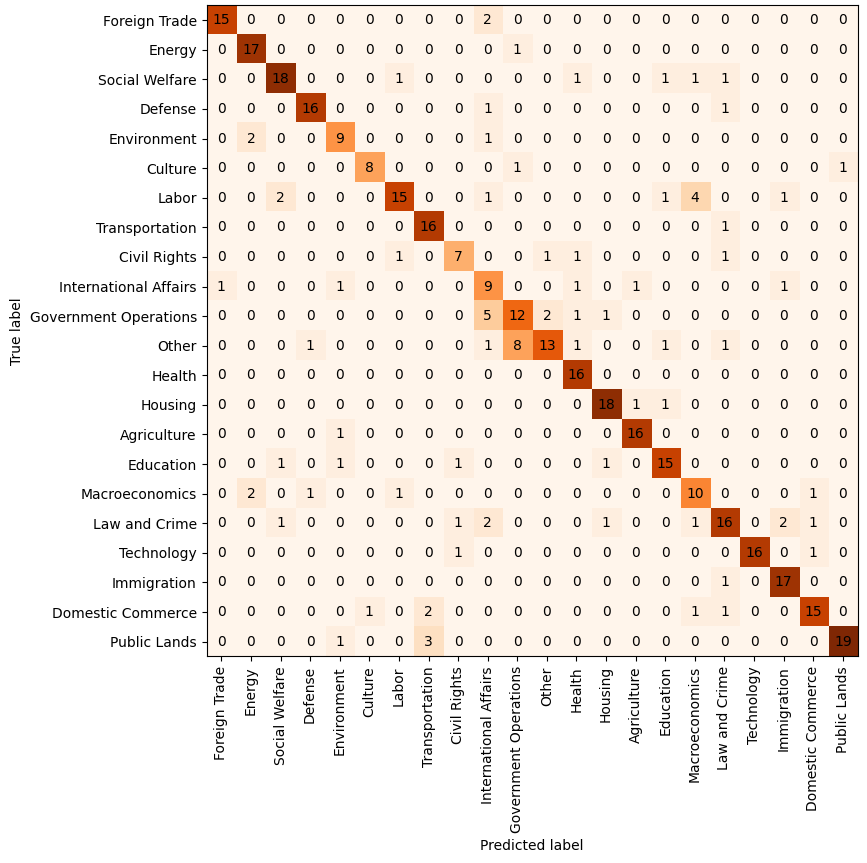

实验结果表明,LLM标注的数据质量与人工标注相当,LLM与人工标注者之间的一致性与人类标注者之间的一致性相近。使用LLM标注数据微调的模型,在议题分类任务上优于在领域外数据上训练的现有CAP分类器。具体性能数据未知,但论文强调了显著的性能提升。

🎯 应用场景

该研究成果可广泛应用于政治学、传播学等领域,用于分析议会政治议程的设置、政治关注的分布、政治代表性以及政治情感的演变。ParlaCAP数据集和分类器可以帮助研究人员更好地理解欧洲议会的运作机制,并为政策制定者提供有价值的参考。

📄 摘要(原文)

This paper introduces ParlaCAP, a large-scale dataset for analyzing parliamentary agenda setting across Europe, and proposes a cost-effective method for building domain-specific policy topic classifiers. Applying the Comparative Agendas Project (CAP) schema to the multilingual ParlaMint corpus of over 8 million speeches from 28 parliaments of European countries and autonomous regions, we follow a teacher-student framework in which a high-performing large language model (LLM) annotates in-domain training data and a multilingual encoder model is fine-tuned on these annotations for scalable data annotation. We show that this approach produces a classifier tailored to the target domain. Agreement between the LLM and human annotators is comparable to inter-annotator agreement among humans, and the resulting model outperforms existing CAP classifiers trained on manually-annotated but out-of-domain data. In addition to the CAP annotations, the ParlaCAP dataset offers rich speaker and party metadata, as well as sentiment predictions coming from the ParlaSent multilingual transformer model, enabling comparative research on political attention and representation across countries. We illustrate the analytical potential of the dataset with three use cases, examining the distribution of parliamentary attention across policy topics, sentiment patterns in parliamentary speech, and gender differences in policy attention.