Learning to Learn from Language Feedback with Social Meta-Learning

作者: Jonathan Cook, Diego Antognini, Martin Klissarov, Claudiu Musat, Edward Grefenstette

分类: cs.CL, cs.AI

发布日期: 2026-02-18

💡 一句话要点

提出基于社会元学习的语言反馈学习方法,提升LLM对话交互能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社会元学习 语言反馈 大型语言模型 对话交互 主动学习

📋 核心要点

- 现有大型语言模型在对话中缺乏主动性和适应性,难以有效利用纠正性反馈。

- 论文提出将社会元学习(SML)应用于LLM,使其能够主动征求并学习语言反馈,提升交互能力。

- 实验表明,SML训练的模型在解决数学、编程等问题时,能更好地利用反馈,并能处理信息不明确的任务。

📝 摘要(中文)

大型语言模型(LLM)通常难以在对话环境中从纠正性反馈中学习。它们很少主动征求反馈,即使面对不明确的情况也是如此,这使得它们的对话感觉静态、单方面,并且缺乏人类对话的适应性。为了解决这些限制,我们从人类的社会元学习(SML)中汲取灵感——即学习如何向他人学习的过程。我们将SML形式化为一种微调方法,训练LLM在模拟的教学对话中征求并学习语言反馈,其中静态任务被转换为交互式社会学习问题。SML有效地教会模型使用对话来解决它们无法在单轮中解决的问题。这种能力可以跨领域推广;在数学问题上进行SML训练的模型可以更好地利用反馈来解决编码问题,反之亦然。此外,尽管仅在完全指定的问题上进行训练,但这些模型能够更好地解决信息在多轮中揭示的不明确任务。当面对这种不明确性时,经过SML训练的模型会减少过早的答案尝试,并且更有可能询问他们需要的信息。这项工作提出了一种可扩展的方法来开发能够有效从语言反馈中学习的AI系统。

🔬 方法详解

问题定义:现有大型语言模型(LLM)在对话交互中表现出明显的局限性,主要体现在两个方面:一是缺乏主动性,即使在面对信息不明确或自身能力不足的情况下,也很少主动寻求反馈;二是难以有效利用对话中的纠正性反馈进行学习,导致对话过程显得静态和单向。这些问题阻碍了LLM在实际应用中实现更自然、更智能的人机交互。

核心思路:论文的核心思路是借鉴人类的社会元学习(SML)机制,即学习如何向他人学习。通过将SML引入LLM的训练过程,使模型具备主动征求和有效利用语言反馈的能力。这种方法旨在将静态的任务解决过程转化为动态的、交互式的社会学习过程,从而提升LLM的适应性和问题解决能力。论文认为,通过模拟教学对话,可以有效地训练LLM掌握SML的能力。

技术框架:论文将SML形式化为一种微调(fine-tuning)方法。具体而言,首先构建模拟的教学对话数据集,其中包含学生和老师的角色,学生负责尝试解决问题,老师负责提供反馈。然后,使用这些数据对LLM进行微调,使其学会主动向老师提问,并根据老师的反馈调整自己的答案。整个框架可以概括为:1) 数据集构建:模拟教学对话;2) 模型微调:使用教学对话数据训练LLM;3) 评估:测试模型在不同任务上的表现。

关键创新:论文的关键创新在于将社会元学习(SML)的概念引入到LLM的训练中,并提出了一种可行的微调方法来实现SML。与传统的训练方法相比,SML方法更加注重模型的交互能力和学习能力,使其能够从对话中获取知识并不断改进自身。此外,论文还证明了SML训练的模型具有良好的泛化能力,可以在不同领域和不同类型的任务上有效利用反馈。

关键设计:论文的关键设计包括:1) 模拟教学对话数据集的设计,需要保证数据的多样性和质量,以便模型能够学习到有效的反馈策略;2) 微调过程中的损失函数设计,需要考虑模型的主动提问行为和对反馈的利用程度;3) 评估指标的选择,需要能够全面反映模型的交互能力和问题解决能力。具体的参数设置和网络结构等技术细节在论文中可能没有详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

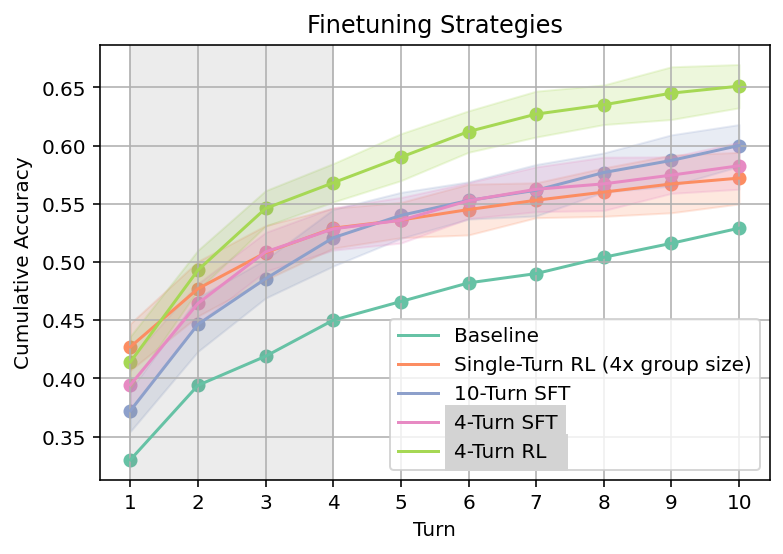

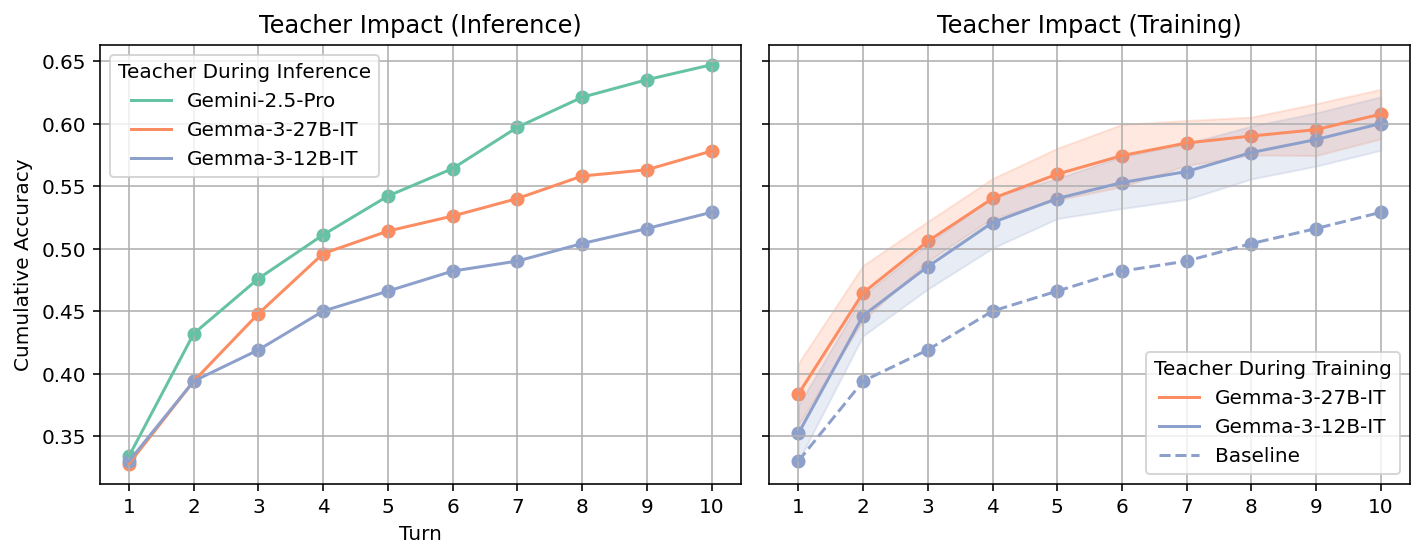

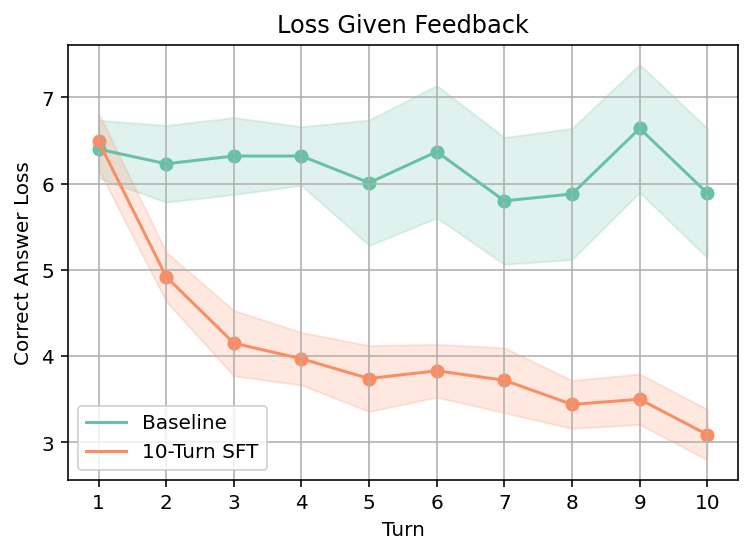

实验结果表明,经过SML训练的模型在解决数学和编程问题时,能够更好地利用反馈信息,显著提升问题解决的准确率。此外,这些模型还能够更好地处理信息不明确的任务,减少过早的答案尝试,并更主动地询问所需信息。更重要的是,SML训练的模型具有良好的泛化能力,可以在不同领域和不同类型的任务上有效利用反馈。

🎯 应用场景

该研究成果具有广泛的应用前景,例如智能教育助手、智能客服、人机协作机器人等。通过使AI系统能够主动学习和利用人类反馈,可以显著提升其在复杂任务中的表现,并实现更自然、更高效的人机交互。未来,该技术有望应用于更多领域,例如医疗诊断、金融分析等,为人类提供更智能、更可靠的辅助工具。

📄 摘要(原文)

Large language models (LLMs) often struggle to learn from corrective feedback within a conversational context. They are rarely proactive in soliciting this feedback, even when faced with ambiguity, which can make their dialogues feel static, one-sided, and lacking the adaptive qualities of human conversation. To address these limitations, we draw inspiration from social meta-learning (SML) in humans - the process of learning how to learn from others. We formulate SML as a finetuning methodology, training LLMs to solicit and learn from language feedback in simulated pedagogical dialogues, where static tasks are converted into interactive social learning problems. SML effectively teaches models to use conversation to solve problems they are unable to solve in a single turn. This capability generalises across domains; SML on math problems produces models that better use feedback to solve coding problems and vice versa. Furthermore, despite being trained only on fully-specified problems, these models are better able to solve underspecified tasks where critical information is revealed over multiple turns. When faced with this ambiguity, SML-trained models make fewer premature answer attempts and are more likely to ask for the information they need. This work presents a scalable approach to developing AI systems that effectively learn from language feedback.