Long-Tail Knowledge in Large Language Models: Taxonomy, Mechanisms, Interventions and Implications

作者: Sanket Badhe, Deep Shah, Nehal Kathrotia

分类: cs.CL, cs.AI, cs.CY

发布日期: 2026-02-18

💡 一句话要点

构建长尾知识分析框架,提升大语言模型在低频知识上的表现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长尾知识 大语言模型 知识表示 公平性 责任性 评估方法 知识图谱

📋 核心要点

- 现有大语言模型在长尾知识上表现不佳,尤其是在低频、领域特定、文化和时间相关的知识上。

- 论文提出了一个结构化的分析框架,用于理解和解决大语言模型中长尾知识的缺失或扭曲问题。

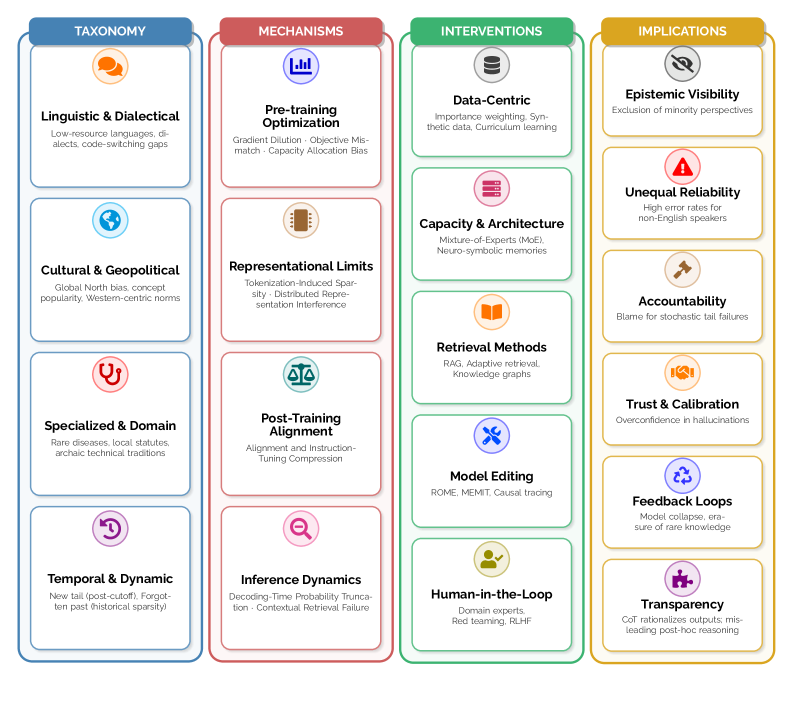

- 该框架从定义、机制、干预和影响四个维度综合分析了长尾知识,并指出了评估实践中的问题。

📝 摘要(中文)

大型语言模型(LLM)在网络规模的语料库上进行训练,这些语料库呈现出陡峭的幂律分布,其中知识的分布高度长尾化,大多数知识出现频率很低。虽然扩展规模提高了平均性能,但在低频、特定领域、文化和时间知识方面的持续失败仍然缺乏明确的描述。本文构建了一个结构化的长尾知识分类和分析框架,综合了技术和社会技术视角的先前工作。我们引入了一个结构化的分析框架,该框架综合了先前工作,涵盖四个互补的维度:长尾知识的定义、在训练和推理过程中丢失或扭曲的机制、为缓解这些失败而提出的技术干预措施,以及这些失败对公平性、责任性、透明度和用户信任的影响。我们进一步研究了现有的评估方法如何掩盖尾部行为,并使对罕见但重要的失败的问责变得复杂。最后,本文指出了与隐私、可持续性和治理相关的开放性挑战,这些挑战限制了长尾知识的表示。总而言之,本文提供了一个统一的概念框架,用于理解长尾知识是如何被定义、丢失、评估并在已部署的语言模型系统中体现的。

🔬 方法详解

问题定义:大语言模型在海量数据上训练,但数据分布呈现长尾效应,导致模型对低频知识学习不足,出现知识缺失或扭曲。现有方法难以有效评估和解决长尾知识问题,影响模型的公平性、可靠性和透明度。

核心思路:论文的核心思路是构建一个全面的分析框架,系统性地研究长尾知识在大语言模型中的存在形式、产生原因、潜在影响以及可能的解决方案。通过对长尾知识进行分类和分析,可以更好地理解其特性,并针对性地设计干预措施。

技术框架:该论文提出了一个四维分析框架,包括:1) 长尾知识的定义;2) 长尾知识在训练和推理过程中丢失或扭曲的机制;3) 缓解这些问题的技术干预措施;4) 这些问题对公平性、责任性、透明度和用户信任的影响。该框架旨在提供一个统一的视角,用于理解和解决大语言模型中的长尾知识问题。

关键创新:该论文的主要创新在于提出了一个结构化的分析框架,将长尾知识问题分解为四个相互关联的维度,并综合了技术和社会技术视角的研究成果。该框架有助于研究人员更全面地理解长尾知识问题,并为未来的研究提供指导。

关键设计:论文并没有提出具体的算法或模型,而是侧重于概念框架的构建。关键设计在于四个维度的划分和相互联系的分析,以及对现有评估方法的批判性审视。论文强调了隐私、可持续性和治理在长尾知识表示中的重要性,并指出了未来的研究方向。

🖼️ 关键图片

📊 实验亮点

论文重点在于框架的构建和分析,而非具体的实验结果。亮点在于对现有评估方法的局限性进行了分析,指出其难以有效评估长尾知识的表现,并呼吁开发更全面的评估指标。

🎯 应用场景

该研究成果可应用于提升大语言模型在特定领域、文化背景下的知识理解能力,提高模型在处理罕见事件或低频查询时的准确性和可靠性。有助于构建更公平、透明和值得信赖的AI系统,尤其是在医疗、法律等高风险领域。

📄 摘要(原文)

Large language models (LLMs) are trained on web-scale corpora that exhibit steep power-law distributions, in which the distribution of knowledge is highly long-tailed, with most appearing infrequently. While scaling has improved average-case performance, persistent failures on low-frequency, domain-specific, cultural, and temporal knowledge remain poorly characterized. This paper develops a structured taxonomy and analysis of long-Tail Knowledge in large language models, synthesizing prior work across technical and sociotechnical perspectives. We introduce a structured analytical framework that synthesizes prior work across four complementary axes: how long-Tail Knowledge is defined, the mechanisms by which it is lost or distorted during training and inference, the technical interventions proposed to mitigate these failures, and the implications of these failures for fairness, accountability, transparency, and user trust. We further examine how existing evaluation practices obscure tail behavior and complicate accountability for rare but consequential failures. The paper concludes by identifying open challenges related to privacy, sustainability, and governance that constrain long-Tail Knowledge representation. Taken together, this paper provides a unifying conceptual framework for understanding how long-Tail Knowledge is defined, lost, evaluated, and manifested in deployed language model systems.