Emotion Collider: Dual Hyperbolic Mirror Manifolds for Sentiment Recovery via Anti Emotion Reflection

作者: Rong Fu, Ziming Wang, Shuo Yin, Wenxin Zhang, Haiyun Wei, Kun Liu, Xianda Li, Zeli Su, Simon Fong

分类: cs.MM, cs.CL, cs.LG

发布日期: 2026-02-18

备注: 25 pages, 14 figures

💡 一句话要点

提出Emotion Collider,利用双曲超图反射机制进行情感恢复,提升多模态情感理解的鲁棒性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态情感分析 双曲几何 超图神经网络 对比学习 情感识别

📋 核心要点

- 现有情感建模方法在处理多模态数据时,难以有效捕捉模态间的复杂关系和层级结构,尤其是在数据存在噪声或缺失的情况下。

- Emotion Collider (EC-Net) 利用双曲几何的特性,在Poincare球中嵌入模态层级结构,并通过超图融合机制实现模态间信息的有效传递。

- 实验结果表明,EC-Net 在多模态情感基准测试中表现出色,尤其是在模态数据不完整或存在噪声时,能够显著提高情感识别的准确性。

📝 摘要(中文)

本文提出了一种名为Emotion Collider (EC-Net) 的双曲超图框架,用于多模态情感和情感建模。EC-Net 使用Poincare球嵌入表示模态层次结构,并通过超图机制执行融合,该机制在节点和超边之间双向传递消息。为了锐化类分离,在双曲空间中制定了具有解耦的径向和角度目标的对比学习。通过自适应超边构建,保留了跨时间步长和模态的高阶语义关系。在标准多模态情感基准上的实验结果表明,EC-Net 产生鲁棒、语义连贯的表示,并持续提高准确性,尤其是在模态部分可用或被噪声污染时。这些发现表明,显式的层次几何结构与超图融合相结合,对于弹性多模态情感理解是有效的。

🔬 方法详解

问题定义:多模态情感分析旨在理解和识别人类情感,但现有方法难以有效处理模态间的复杂关系,尤其是在数据存在噪声或部分缺失的情况下。传统方法通常采用简单的特征拼接或注意力机制,无法充分利用模态间的层级结构和高阶语义关系,导致模型鲁棒性较差。

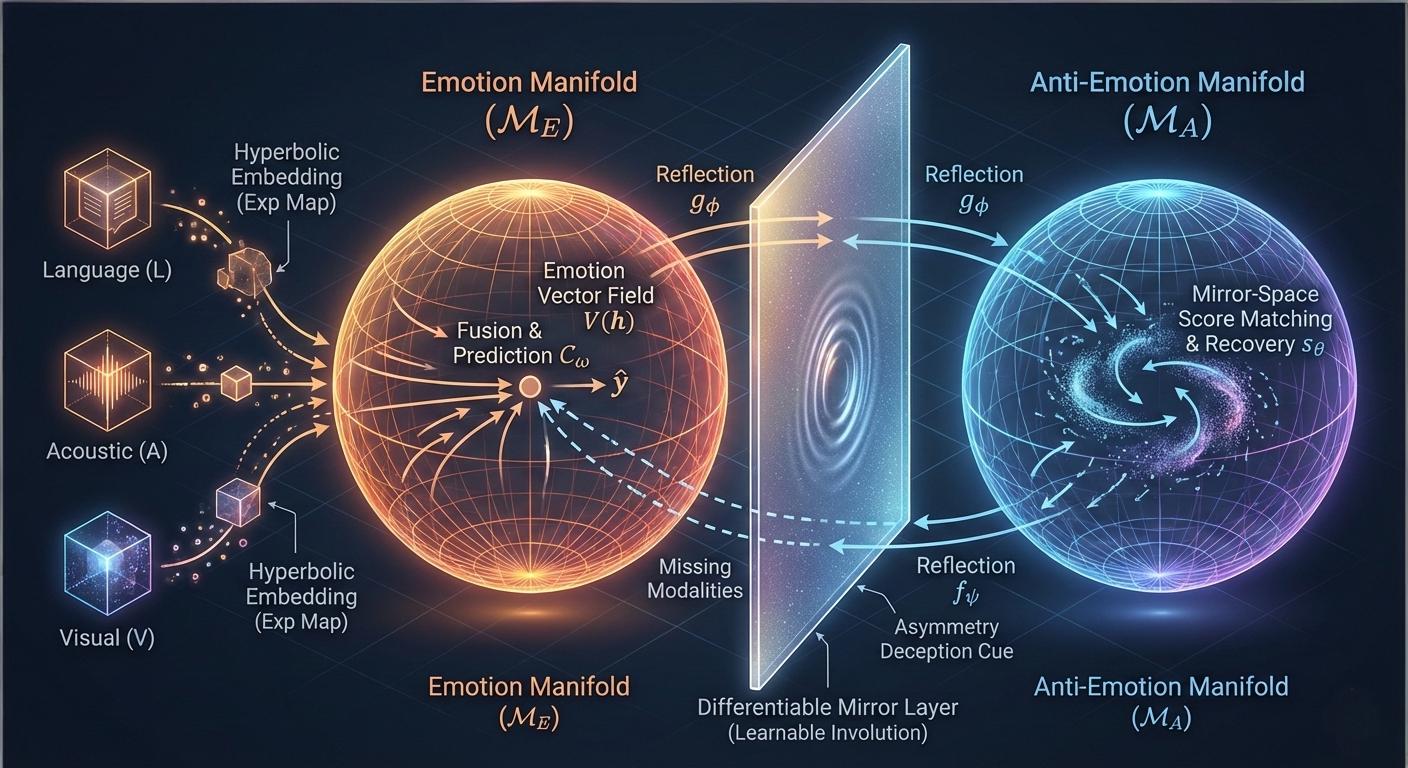

核心思路:本文的核心思路是利用双曲几何的特性,将模态层级结构嵌入到Poincare球中,并采用超图融合机制来建模模态间的高阶关系。双曲空间能够更好地表示层级结构,而超图则可以捕捉多个节点之间的复杂关联,从而提高模型对噪声和数据缺失的鲁棒性。通过对比学习,进一步增强类间区分度。

技术框架:EC-Net 的整体架构包括以下几个主要模块:1) Poincare球嵌入模块,用于将不同模态的特征嵌入到双曲空间中;2) 超图构建模块,用于自适应地构建超边,捕捉模态间的高阶语义关系;3) 超图融合模块,通过消息传递机制在节点和超边之间进行信息交互;4) 对比学习模块,在双曲空间中进行对比学习,增强类间区分度。

关键创新:EC-Net 的关键创新在于:1) 采用双曲几何来建模模态层级结构,更好地捕捉模态间的关系;2) 使用超图融合机制来建模模态间的高阶语义关系,提高模型对噪声和数据缺失的鲁棒性;3) 在双曲空间中进行对比学习,进一步增强类间区分度。

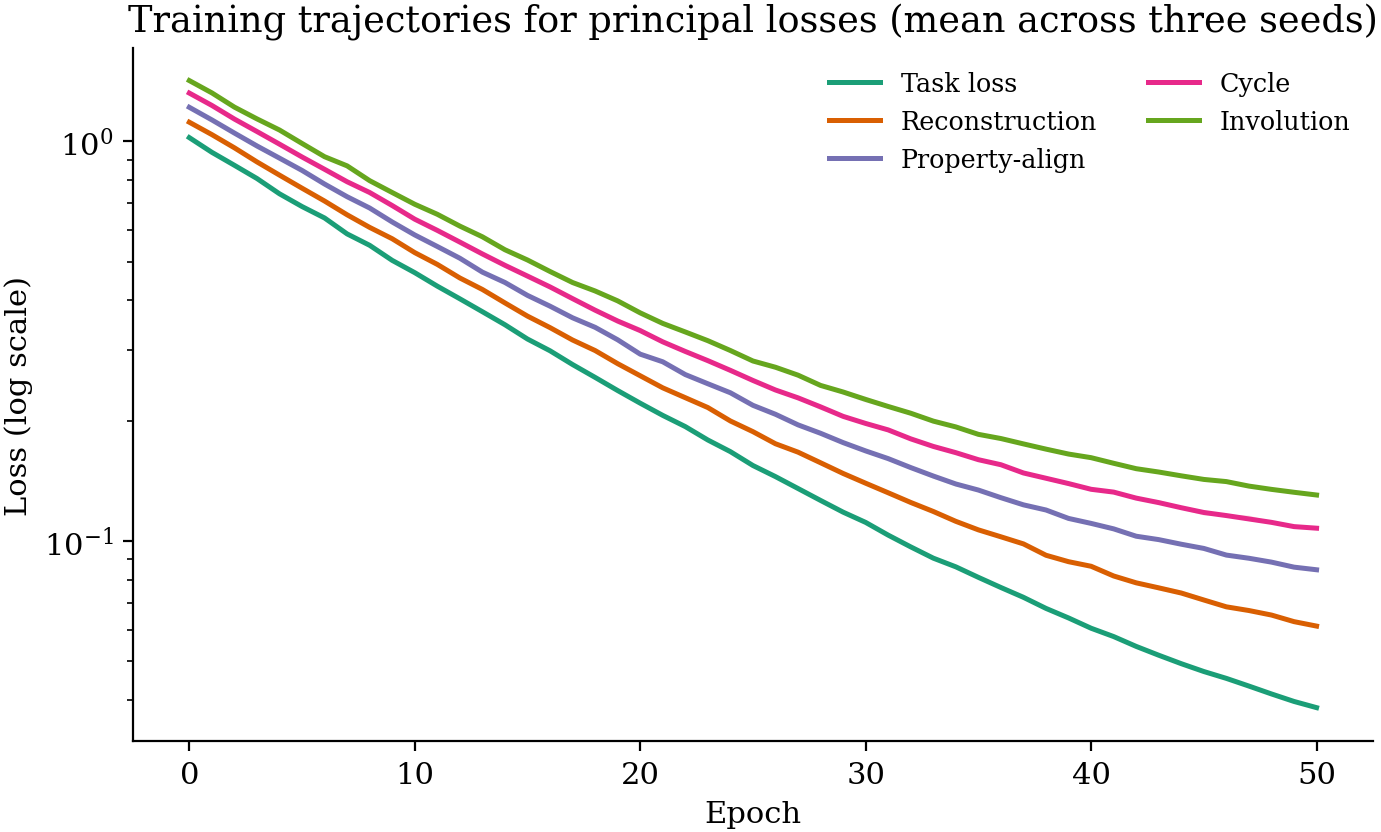

关键设计:在Poincare球嵌入模块中,使用了双曲切空间到Poincare球的指数映射和对数映射。超图构建模块采用自适应的方式,根据节点之间的相似度动态地构建超边。对比学习模块采用了解耦的径向和角度目标,分别优化样本在双曲空间中的半径和角度。损失函数包括交叉熵损失和对比学习损失,通过加权求和进行优化。

🖼️ 关键图片

📊 实验亮点

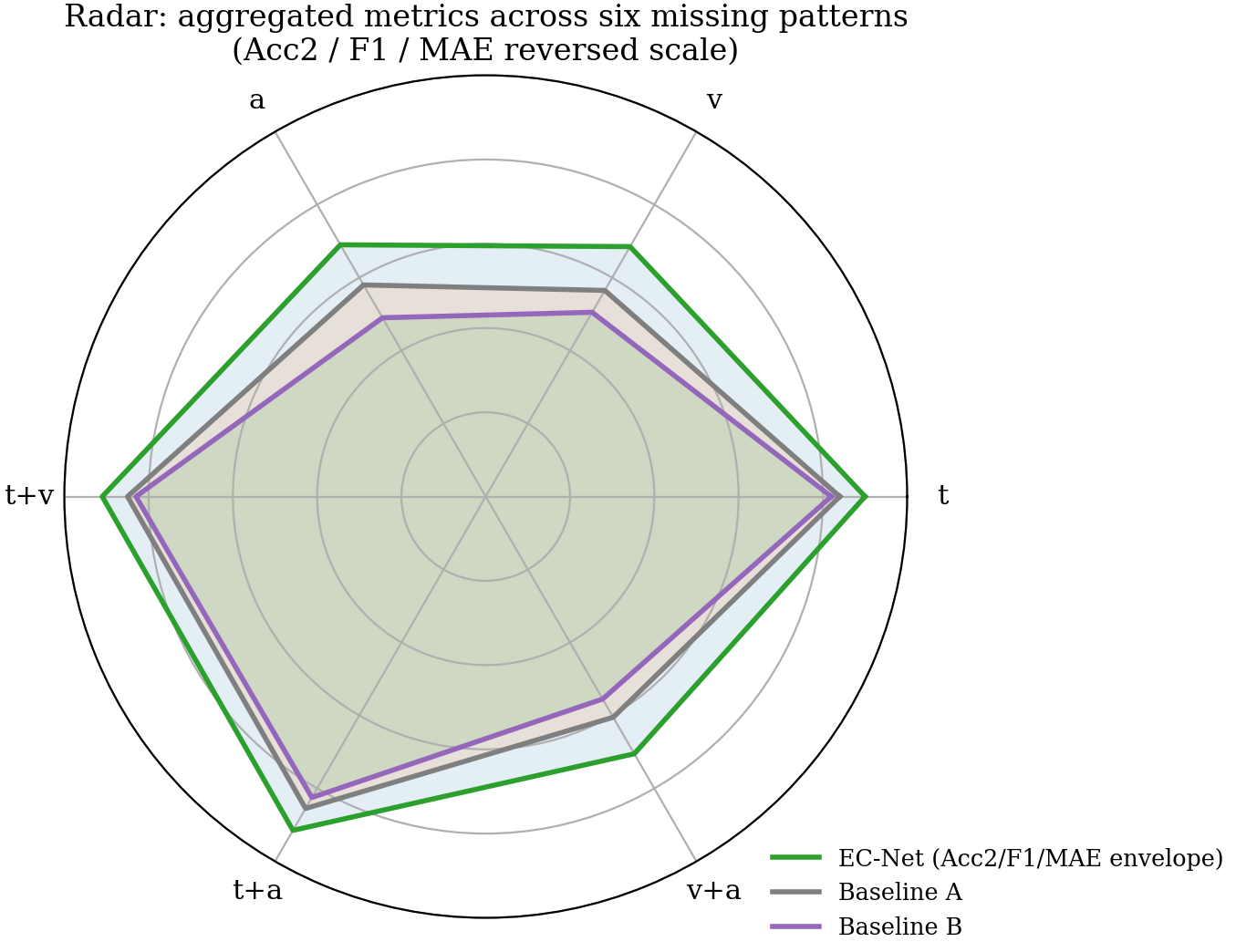

实验结果表明,EC-Net 在 CMU-MOSEI 和 IEMOCAP 等标准多模态情感基准测试中取得了显著的性能提升。例如,在 CMU-MOSEI 数据集上,EC-Net 的准确率相比现有最佳方法提高了 2-3 个百分点,尤其是在模态数据不完整或存在噪声的情况下,EC-Net 的鲁棒性优势更加明显。

🎯 应用场景

该研究成果可应用于人机交互、情感计算、智能客服等领域。通过更准确地理解用户的情感,可以提升人机交互的自然性和有效性,例如,智能客服可以根据用户的情绪提供更个性化的服务。此外,该技术还可以应用于心理健康监测和辅助诊断,通过分析语音、面部表情等多模态数据,识别潜在的情感问题。

📄 摘要(原文)

Emotional expression underpins natural communication and effective human-computer interaction. We present Emotion Collider (EC-Net), a hyperbolic hypergraph framework for multimodal emotion and sentiment modeling. EC-Net represents modality hierarchies using Poincare-ball embeddings and performs fusion through a hypergraph mechanism that passes messages bidirectionally between nodes and hyperedges. To sharpen class separation, contrastive learning is formulated in hyperbolic space with decoupled radial and angular objectives. High-order semantic relations across time steps and modalities are preserved via adaptive hyperedge construction. Empirical results on standard multimodal emotion benchmarks show that EC-Net produces robust, semantically coherent representations and consistently improves accuracy, particularly when modalities are partially available or contaminated by noise. These findings indicate that explicit hierarchical geometry combined with hypergraph fusion is effective for resilient multimodal affect understanding.