DependencyAI: Detecting AI Generated Text through Dependency Parsing

作者: Sara Ahmed, Tracy Hammond

分类: cs.CL

发布日期: 2026-02-17

💡 一句话要点

DependencyAI:利用依存句法分析检测AI生成文本,无需神经网络。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI生成文本检测 依存句法分析 自然语言处理 可解释性 机器学习

📋 核心要点

- 大型语言模型普及带来风险,现有AI生成文本检测方法仍有不足。

- DependencyAI利用依存句法关系标签,无需神经网络即可检测AI生成文本。

- 实验表明,该方法在多种设置下性能优异,并具有良好的可解释性。

📝 摘要(中文)

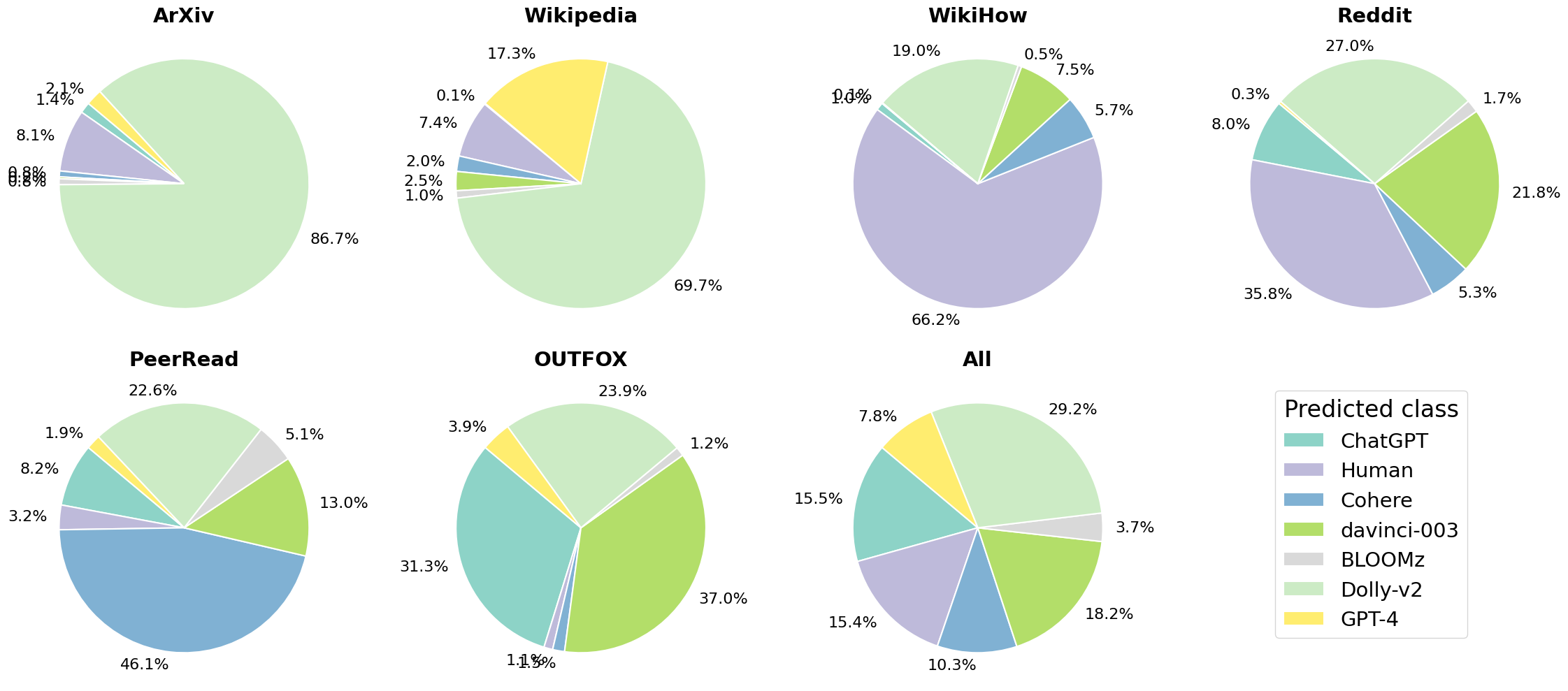

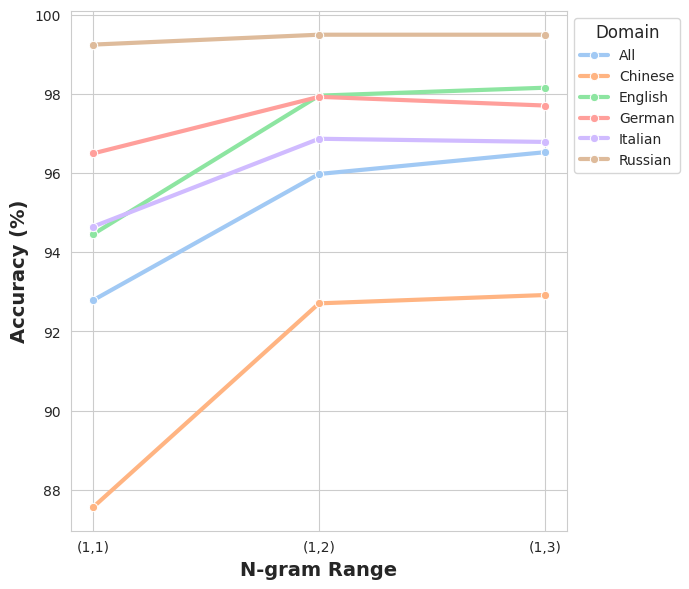

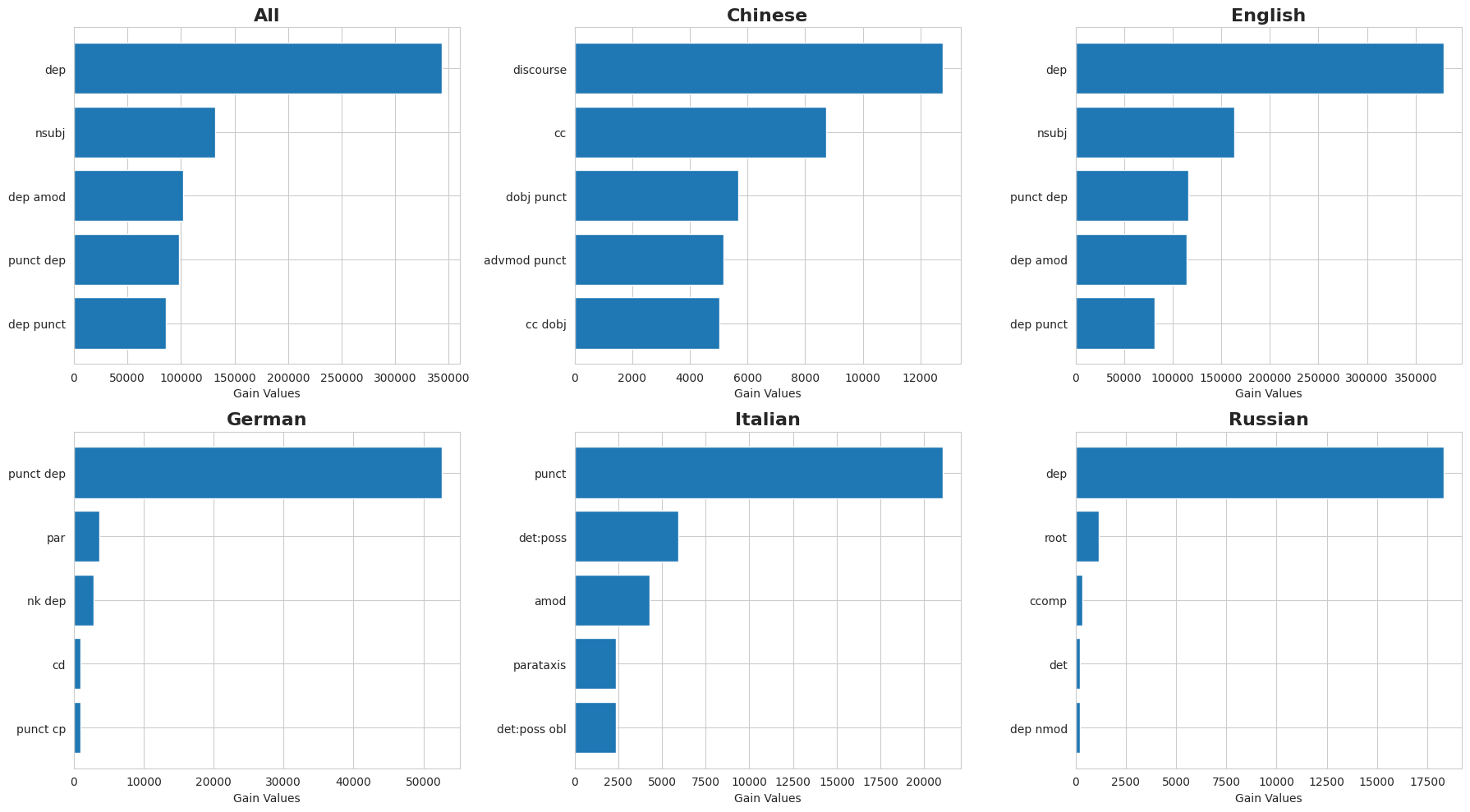

随着大型语言模型(LLMs)日益普及,可靠的AI生成文本检测方法对于降低潜在风险至关重要。我们提出了DependencyAI,一种简单且可解释的方法,仅使用语言依存关系的标签来检测AI生成的文本。我们的方法在单语、多生成器和多语种设置中都取得了具有竞争力的性能。为了提高可解释性,我们分析了特征重要性,揭示了区分AI生成文本和人类书写文本的句法结构。我们还观察到某些模型在未见领域存在系统性的过度预测,这表明特定生成器的写作风格可能会影响跨领域泛化。总的来说,我们的结果表明,仅依存关系就为AI生成文本检测提供了强大的信号,从而将DependencyAI确立为一个强大的、基于语言学的、可解释的且非神经网络的基线。

🔬 方法详解

问题定义:论文旨在解决如何有效且可解释地检测AI生成的文本的问题。现有方法可能依赖于复杂的神经网络,缺乏可解释性,并且可能在跨领域泛化方面存在问题。DependencyAI旨在提供一个更简单、更易于理解的替代方案,避免对大型神经网络的依赖。

核心思路:核心思路是利用AI生成文本和人类书写文本在句法结构上的差异。通过分析文本的依存关系,可以提取出能够区分二者的特征。DependencyAI假设不同来源(人类 vs. AI)的文本在句法结构的使用频率上存在可识别的模式。

技术框架:DependencyAI的整体框架包括以下步骤:1) 对输入文本进行依存句法分析,提取依存关系标签。2) 将依存关系标签转换为特征向量。3) 使用机器学习分类器(例如,逻辑回归或支持向量机)训练模型,区分AI生成文本和人类书写文本。4) 分析特征重要性,识别区分AI生成文本和人类书写文本的关键句法结构。

关键创新:DependencyAI的关键创新在于它仅使用依存关系标签进行AI生成文本检测,而无需复杂的神经网络。这种方法不仅提高了可解释性,而且在计算上更加高效。此外,该研究还揭示了不同AI生成器在写作风格上的差异,以及这些差异如何影响跨领域泛化能力。

关键设计:DependencyAI的关键设计包括:1) 使用标准的依存句法分析器(例如,Stanford CoreNLP或spaCy)提取依存关系标签。2) 将依存关系标签转换为one-hot编码的特征向量。3) 使用L1正则化的逻辑回归模型进行分类,以提高模型的稀疏性和可解释性。4) 使用permutation importance或SHAP值等方法分析特征重要性。

🖼️ 关键图片

📊 实验亮点

DependencyAI在单语、多生成器和多语种设置中均表现出竞争力,无需神经网络。特征重要性分析揭示了AI生成文本和人类书写文本在句法结构上的差异。研究还发现,特定AI模型在未见领域存在过度预测,表明生成器风格影响泛化能力。

🎯 应用场景

DependencyAI可应用于内容审核、学术诚信检测、新闻真实性验证等领域。该方法能够帮助识别和过滤AI生成的虚假信息或抄袭内容,维护网络信息安全和学术规范。未来,DependencyAI可以与其他检测方法结合,构建更强大的AI生成内容检测系统。

📄 摘要(原文)

As large language models (LLMs) become increasingly prevalent, reliable methods for detecting AI-generated text are critical for mitigating potential risks. We introduce DependencyAI, a simple and interpretable approach for detecting AI-generated text using only the labels of linguistic dependency relations. Our method achieves competitive performance across monolingual, multi-generator, and multilingual settings. To increase interpretability, we analyze feature importance to reveal syntactic structures that distinguish AI-generated from human-written text. We also observe a systematic overprediction of certain models on unseen domains, suggesting that generator-specific writing styles may affect cross-domain generalization. Overall, our results demonstrate that dependency relations alone provide a robust signal for AI-generated text detection, establishing DependencyAI as a strong linguistically grounded, interpretable, and non-neural network baseline.