The Interspeech 2026 Audio Reasoning Challenge: Evaluating Reasoning Process Quality for Audio Reasoning Models and Agents

作者: Ziyang Ma, Ruiyang Xu, Yinghao Ma, Chao-Han Huck Yang, Bohan Li, Jaeyeon Kim, Jin Xu, Jinyu Li, Carlos Busso, Kai Yu, Eng Siong Chng, Xie Chen

分类: cs.SD, cs.CL, cs.MM

发布日期: 2026-02-15

备注: The official website of the Audio Reasoning Challenge: https://audio-reasoning-challenge.github.io

💡 一句话要点

Interspeech 2026音频推理挑战赛:评估音频推理模型和智能体的推理过程质量

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 音频推理 链式思考 可解释性 大型音频语言模型 多模态分析

📋 核心要点

- 现有大型音频语言模型(LALMs)缺乏透明的推理过程,如同“黑盒”,难以解释其决策依据。

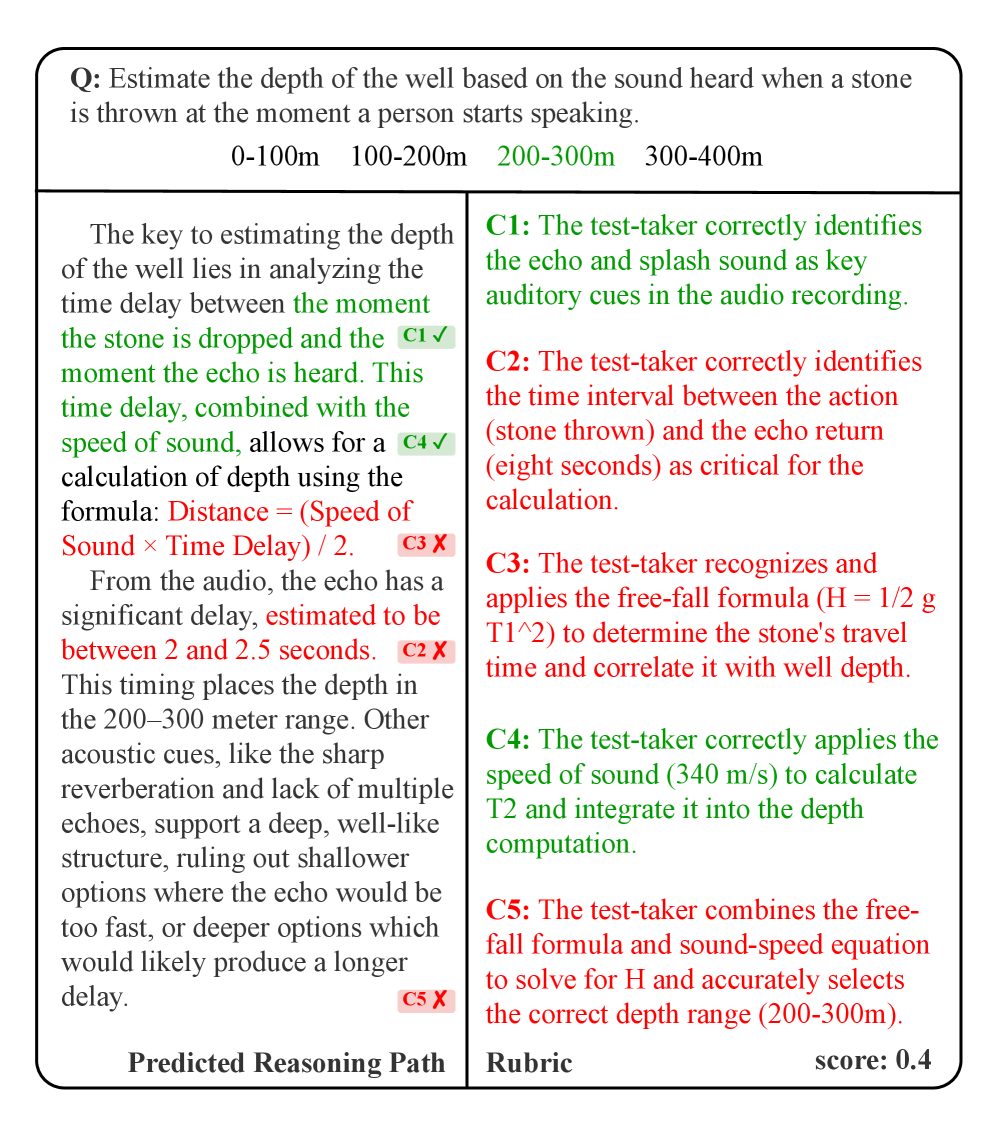

- 挑战赛引入MMAR-Rubrics协议,从事实性和逻辑性两方面评估推理链的质量,旨在提升模型的可解释性。

- 智能体系统通过迭代工具编排和跨模态分析在推理质量上领先,单模型则通过强化学习快速进步。

📝 摘要(中文)

本文介绍了Interspeech 2026举办的音频推理挑战赛,这是首个专注于评估音频领域链式思考(Chain-of-Thought, CoT)质量的共享任务。该挑战赛引入了MMAR-Rubrics,一种新颖的实例级别协议,用于评估推理链的事实性和逻辑性。比赛分为单模型和智能体两个赛道,吸引了来自18个国家和地区的156支队伍。结果表明,智能体系统在推理质量方面目前处于领先地位,这得益于迭代工具编排和跨模态分析。此外,单模型也通过强化学习和复杂的数据管道迅速发展。本文详细介绍了挑战赛的设计、方法以及对最先进系统的全面分析,为可解释的音频智能提供了新的见解。

🔬 方法详解

问题定义:现有的大型音频语言模型(LALMs)在音频理解方面表现出色,但其推理过程缺乏透明度,如同一个“黑盒”。这使得我们难以理解模型做出特定决策的原因,限制了模型在需要高可信度和可解释性的场景中的应用。因此,如何评估和提升音频推理模型的可解释性成为了一个重要的研究问题。

核心思路:本文的核心思路是通过举办一个共享任务(Audio Reasoning Challenge)来促进音频推理模型可解释性的研究。挑战赛引入了一种新的评估协议MMAR-Rubrics,该协议旨在从事实性和逻辑性两个方面评估推理链的质量。通过提供一个统一的评估标准,挑战赛鼓励研究人员开发更具可解释性的音频推理模型。

技术框架:挑战赛包含两个主要赛道:单模型赛道和智能体赛道。单模型赛道侧重于评估单个模型的推理能力,而智能体赛道则侧重于评估多个工具协同工作的能力。MMAR-Rubrics协议被用于评估两个赛道的参赛模型。该协议在实例级别评估推理链的事实性和逻辑性,从而提供更细粒度的评估结果。

关键创新:该论文的关键创新在于引入了MMAR-Rubrics协议,这是一种专门为评估音频推理链质量而设计的评估方法。与传统的评估方法相比,MMAR-Rubrics协议更加注重推理过程的质量,而不仅仅是最终结果的准确性。此外,挑战赛本身也是一个创新,它为研究人员提供了一个交流和比较不同音频推理模型的平台。

关键设计:MMAR-Rubrics协议的具体设计细节未知,摘要中只提到它评估推理链的事实性和逻辑性。挑战赛的具体数据集和评估指标也未知。但是,摘要中提到智能体系统利用迭代工具编排和跨模态分析,这表明参赛者可能使用了各种技术来提高推理质量。单模型赛道中,强化学习和复杂的数据管道被用于提高模型性能,这些都是重要的技术细节。

🖼️ 关键图片

📊 实验亮点

挑战赛结果表明,智能体系统在推理质量方面领先,这得益于迭代工具编排和跨模态分析。单模型也通过强化学习和复杂的数据管道迅速发展。挑战赛吸引了来自18个国家和地区的156支队伍参与,证明了该研究方向的吸引力。

🎯 应用场景

该研究成果可应用于智能语音助手、音频事件检测、音乐信息检索等领域。提升音频推理模型的可解释性有助于提高用户信任度,并促进模型在安全、医疗等高风险场景中的应用。未来,可解释的音频智能有望在人机交互、内容创作和辅助诊断等方面发挥重要作用。

📄 摘要(原文)

Recent Large Audio Language Models (LALMs) excel in understanding but often lack transparent reasoning. To address this "black-box" limitation, we organized the Audio Reasoning Challenge at Interspeech 2026, the first shared task dedicated to evaluating Chain-of-Thought (CoT) quality in the audio domain. The challenge introduced MMAR-Rubrics, a novel instance-level protocol assessing the factuality and logic of reasoning chains. Featured Single Model and Agent tracks, the competition attracting 156 teams from 18 countries and regions. Results show agent systems currently lead in reasoning quality, utilizing iterative tool orchestration and cross-modal analysis. Besides, single models are rapidly advancing via reinforcement learning and sophisticated data pipeline. We details the challenge design, methodology, and a comprehensive analysis of state-of-the-art systems, providing new insights for explainable audio intelligence.