SecureGate: Learning When to Reveal PII Safely via Token-Gated Dual-Adapters for Federated LLMs

作者: Mohamed Shaaban, Mohamed Elmahallawy

分类: cs.CR, cs.CL

发布日期: 2026-02-13

💡 一句话要点

SecureGate:通过令牌门控双适配器为联邦LLM学习安全地揭示PII

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 大型语言模型 隐私保护 个人身份信息 适配器 令牌门控

📋 核心要点

- 现有联邦学习微调LLM的方法在保护PII方面存在不足,数据清理和差分隐私等手段会降低模型性能。

- SecureGate提出双适配器LoRA架构,通过安全适配器和揭示适配器分别处理全局共享和组织特定知识,实现细粒度隐私控制。

- 实验表明,SecureGate在显著降低PII泄露的同时,保持了任务效用,并实现了高效的适配器路由。

📝 摘要(中文)

联邦学习(FL)无需共享原始数据即可实现跨组织孤岛的协作训练,使其对隐私敏感型应用具有吸引力。随着大型语言模型(LLM)的快速普及,生成式LLM的联邦微调作为一种在保护机密性的同时利用分布式数据的方式而备受关注。然而,这种设置引入了根本性的挑战:(i)由于LLM的记忆效应导致的个人身份信息(PII)的隐私泄露,以及(ii)异构数据下全局泛化和局部效用之间持续存在的张力。现有的防御措施,如数据清理和差分隐私,虽然减少了泄露,但通常会降低下游性能。我们提出了SecureGate,一个面向LLM的隐私感知联邦微调框架,它提供了细粒度的隐私控制,而不会牺牲效用。SecureGate采用双适配器LoRA架构:一个安全的适配器,学习经过清理的、全局可共享的表示;以及一个揭示适配器,捕获敏感的、特定于组织的知识。一个令牌控制的门控模块在推理时选择性地激活这些适配器,从而实现受控的信息披露,而无需重新训练。在多个LLM和真实世界数据集上的大量实验表明,SecureGate提高了任务效用,同时显著降低了PII泄露,对于未经授权的请求,推理攻击准确率降低高达31.66倍,提取召回率降低高达17.07倍。此外,它保持了100%的路由可靠性,并且仅产生极小的计算和通信开销。

🔬 方法详解

问题定义:联邦学习在微调大型语言模型时,面临着如何在保护用户隐私(特别是PII)的同时,保持模型在特定任务上的性能这一难题。现有方法如数据清洗和差分隐私虽然能降低隐私泄露风险,但往往会损害模型的下游任务表现。

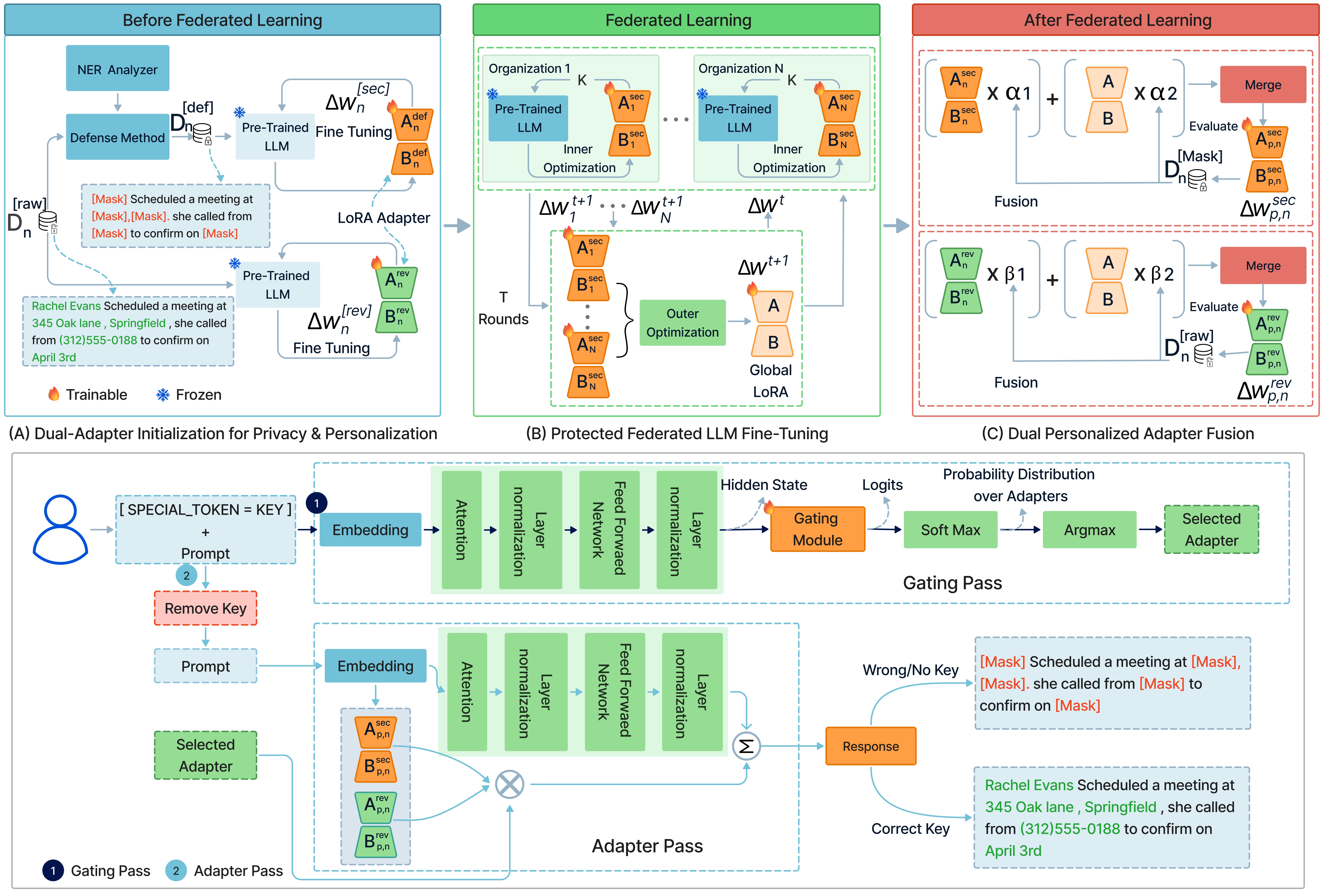

核心思路:SecureGate的核心思路是利用双适配器架构,将模型学习到的知识分为两部分:一部分是经过清洗的、可以安全共享的全局知识,另一部分是包含敏感信息的、特定于组织的局部知识。通过令牌控制的门控机制,在推理时动态选择使用哪个适配器,从而实现对PII泄露的细粒度控制。

技术框架:SecureGate的整体框架包括以下几个主要模块:1) 双适配器LoRA架构:包含一个安全适配器和一个揭示适配器。2) 令牌控制门控模块:根据输入令牌决定激活哪个适配器。3) 联邦学习训练流程:在联邦学习框架下,对适配器进行训练。具体流程是,每个客户端使用本地数据训练安全适配器和揭示适配器,然后将安全适配器的更新发送到服务器进行聚合,最后将聚合后的安全适配器更新分发回客户端。

关键创新:SecureGate的关键创新在于其双适配器架构和令牌控制门控机制。与现有方法相比,SecureGate能够在不牺牲模型性能的前提下,实现对PII泄露的细粒度控制。此外,令牌控制门控机制允许在推理时动态选择使用哪个适配器,从而更好地适应不同的隐私需求。

关键设计:SecureGate的关键设计包括:1) LoRA适配器的选择:使用LoRA(Low-Rank Adaptation)作为适配器,以减少计算和通信开销。2) 令牌控制门控模块的设计:使用一个简单的神经网络来预测每个令牌应该激活哪个适配器。3) 损失函数的设计:使用交叉熵损失函数来训练令牌控制门控模块,以确保正确的适配器路由。

🖼️ 关键图片

📊 实验亮点

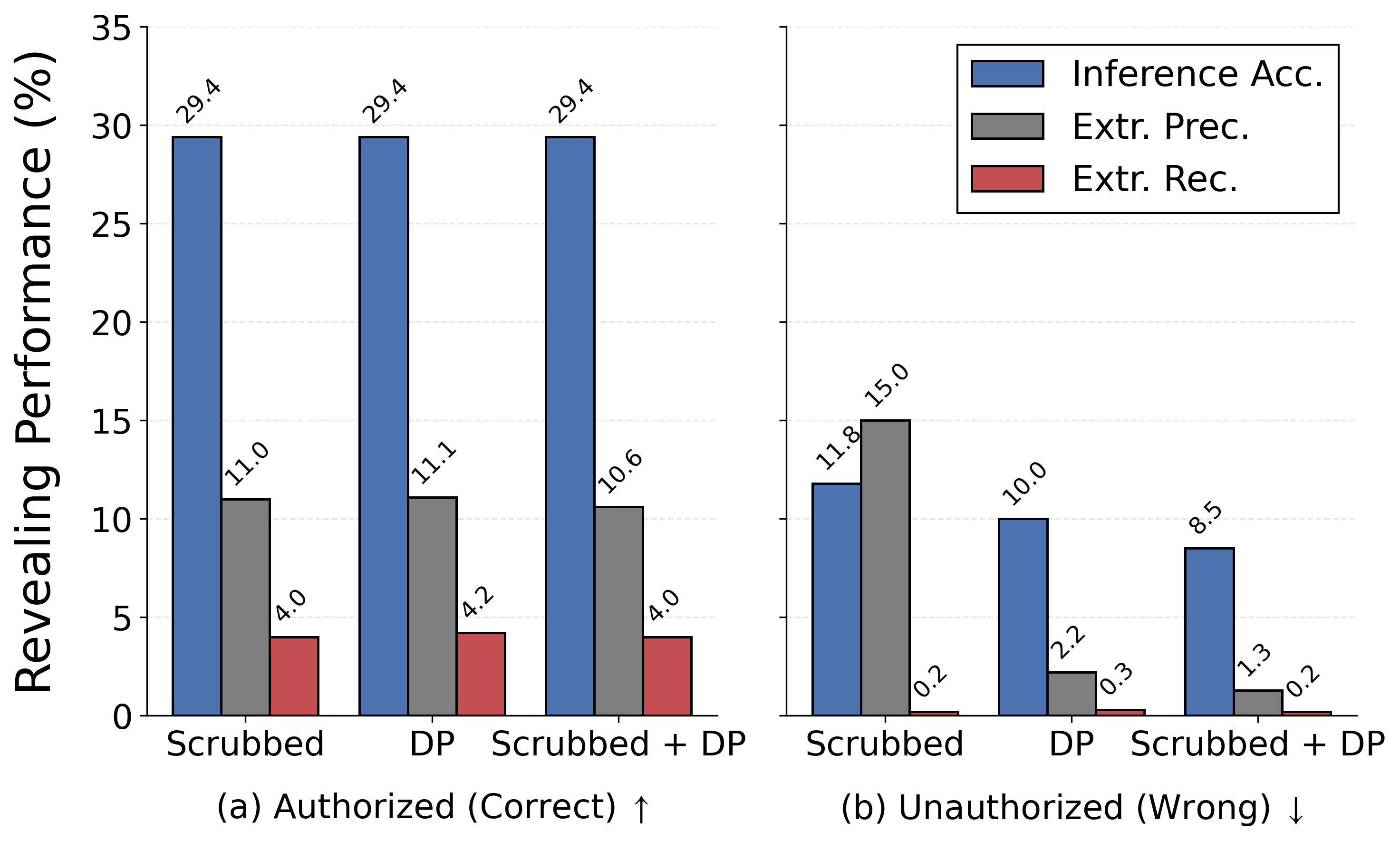

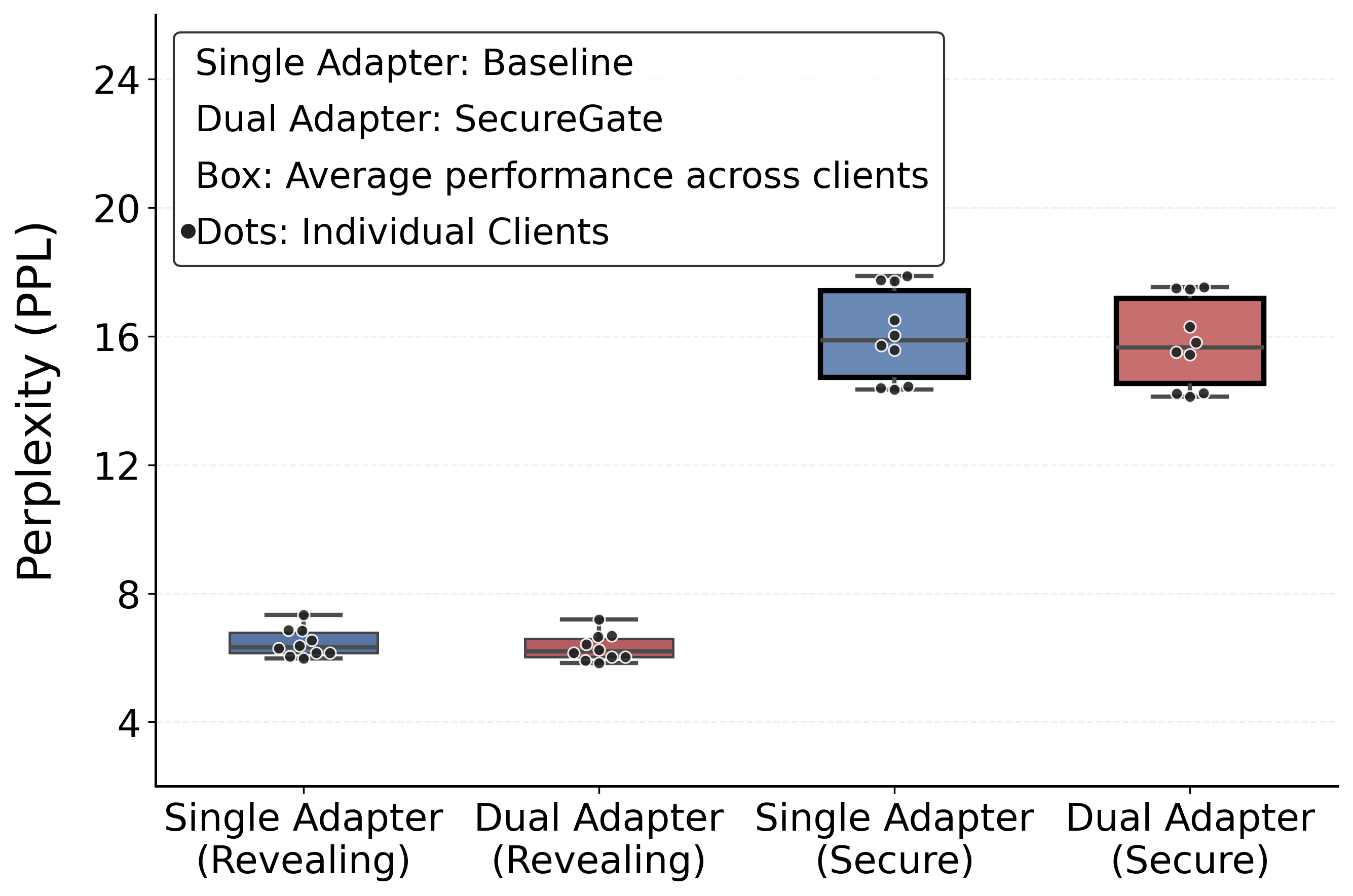

SecureGate在多个LLM和真实世界数据集上进行了广泛的实验,结果表明,SecureGate在显著降低PII泄露的同时,保持了任务效用。具体来说,SecureGate在未经授权的请求下,推理攻击准确率降低高达31.66倍,提取召回率降低高达17.07倍。此外,SecureGate保持了100%的适配器路由可靠性,并且仅产生极小的计算和通信开销。

🎯 应用场景

SecureGate可应用于各种需要联邦学习和隐私保护的LLM应用场景,例如:医疗健康领域,可以利用不同医院的病历数据训练LLM,同时保护患者隐私;金融领域,可以利用不同银行的交易数据训练LLM,同时保护用户隐私。该研究有助于推动联邦学习在隐私敏感领域的应用,并促进安全可靠的AI发展。

📄 摘要(原文)

Federated learning (FL) enables collaborative training across organizational silos without sharing raw data, making it attractive for privacy-sensitive applications. With the rapid adoption of large language models (LLMs), federated fine-tuning of generative LLMs has gained attention as a way to leverage distributed data while preserving confidentiality. However, this setting introduces fundamental challenges: (i) privacy leakage of personally identifiable information (PII) due to LLM memorization, and (ii) a persistent tension between global generalization and local utility under heterogeneous data. Existing defenses, such as data sanitization and differential privacy, reduce leakage but often degrade downstream performance. We propose SecureGate, a privacy-aware federated fine-tuning framework for LLMs that provides fine-grained privacy control without sacrificing utility. SecureGate employs a dual-adapter LoRA architecture: a secure adapter that learns sanitized, globally shareable representations, and a revealing adapter that captures sensitive, organization-specific knowledge. A token-controlled gating module selectively activates these adapters at inference time, enabling controlled information disclosure without retraining. Extensive experiments across multiple LLMs and real-world datasets show that SecureGate improves task utility while substantially reducing PII leakage, achieving up to a 31.66X reduction in inference attack accuracy and a 17.07X reduction in extraction recall for unauthorized requests. Additionally, it maintains 100% routing reliability to the correct adapter and incurs only minimal computational and communication overhead.