Visual Reasoning Benchmark: Evaluating Multimodal LLMs on Classroom-Authentic Visual Problems from Primary Education

作者: Mohamed Huti, Alasdair Mackintosh, Amy Waldock, Dominic Andrews, Maxime Lelièvre, Moritz Boos, Tobias Murray, Paul Atherton, Robin A. A. Ince, Oliver G. B. Garrod

分类: cs.CL, cs.AI

发布日期: 2026-02-12

💡 一句话要点

提出视觉推理基准VRB,评估多模态LLM在小学教育场景下的视觉问题解决能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉推理 多模态学习 大型语言模型 小学教育 基准数据集

📋 核心要点

- 现有AI模型在文本推理方面表现出色,但在空间和关系结构上的推理能力仍然不足,尤其是在依赖视觉的小学数学中。

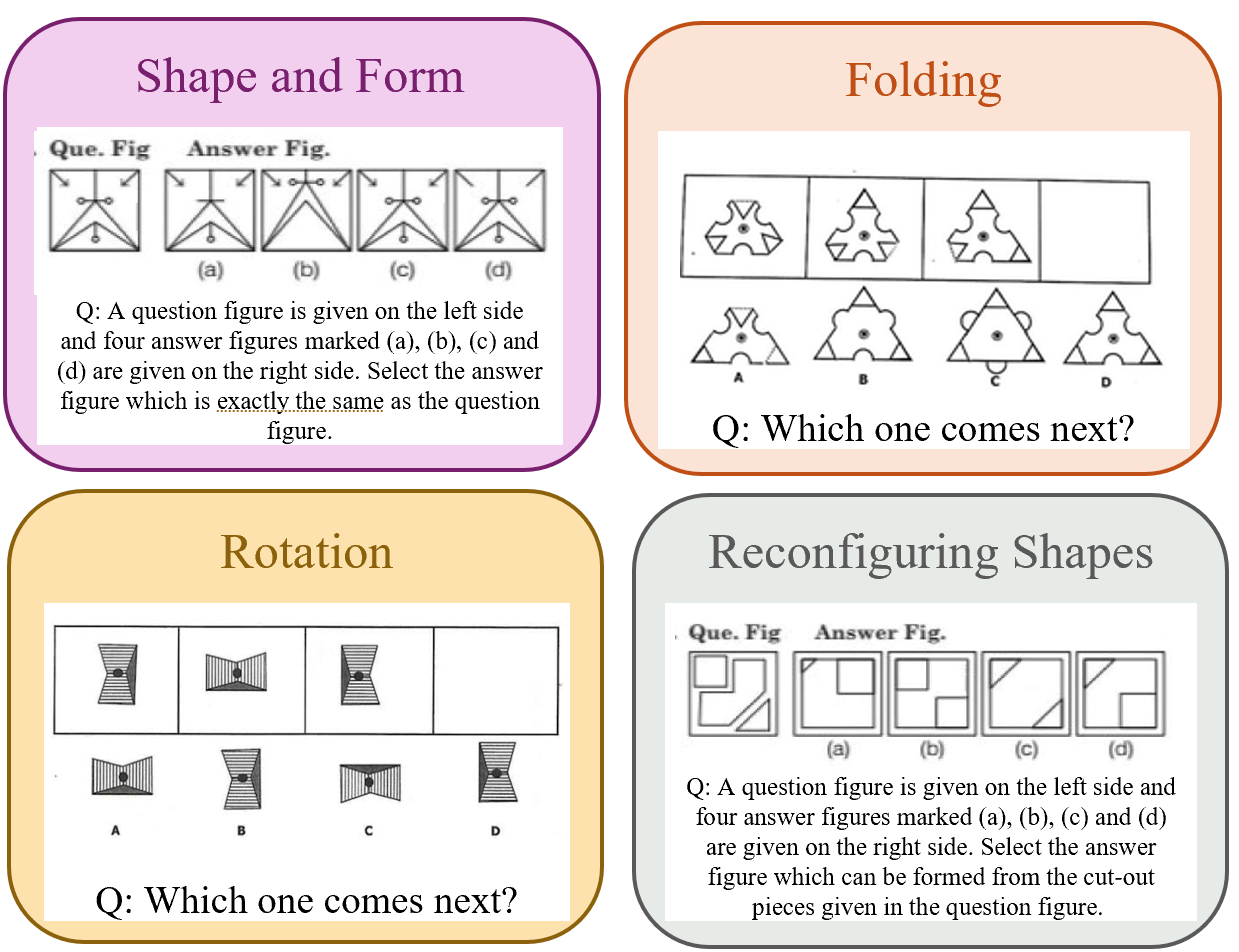

- 论文构建了视觉推理基准(VRB),包含来自赞比亚和印度小学考试的701个视觉问题,涵盖多种视觉推理任务。

- 实验表明,模型在静态视觉任务上表现较好,但在动态空间操作上存在明显局限,这限制了其在小学教育中的应用。

📝 摘要(中文)

本文提出了视觉推理基准(VRB),这是一个新的数据集,旨在评估多模态大型语言模型(MLLM)解决课堂真实视觉问题的能力,这些问题来源于小学教育。该基准包含701个问题,源自赞比亚和印度的考试,涵盖类比推理、模式补全和空间匹配等任务。研究详细介绍了基准的构建方法,该基准有意使用未经编辑、文本最少的图像,以测试模型是否能满足小学教育的实际需求。研究结果揭示了模型能力的“锯齿状前沿”,模型在计数和缩放等静态技能方面表现出较好的能力,但在折叠、反射和旋转等动态操作方面达到了明显的“空间天花板”。这些弱点给视觉推理问题在课堂上的使用带来了风险,可能导致错误的评分、错误的支架搭建和强化学生的误解。因此,像VRB这样以教育为中心的基准对于确定课堂中使用的多模态工具的功能边界至关重要。

🔬 方法详解

问题定义:论文旨在解决多模态大型语言模型(MLLM)在小学教育场景下,对视觉信息进行推理能力不足的问题。现有方法在处理空间关系和动态视觉操作时存在明显瓶颈,无法满足小学课堂中真实视觉问题的需求。这可能导致模型在教育应用中产生误导,例如错误的评分或强化学生的错误概念。

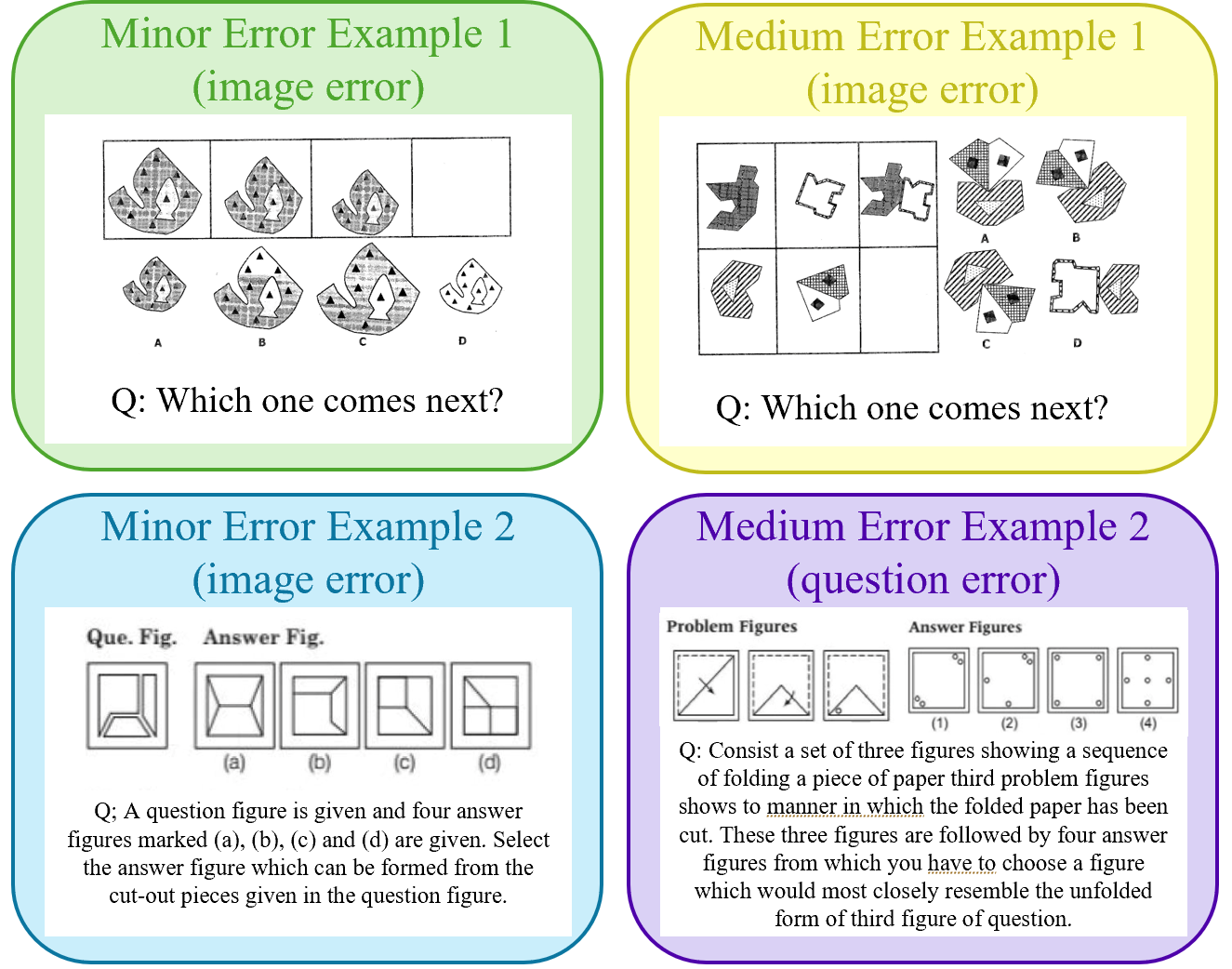

核心思路:论文的核心思路是构建一个更贴近真实课堂环境的视觉推理基准(VRB),该基准包含未经编辑、文本最少的图像,并涵盖多种小学教育中常见的视觉推理任务。通过在该基准上评估MLLM的性能,可以更准确地了解模型在实际教育场景中的能力边界和潜在风险。

技术框架:VRB基准的构建流程主要包括以下几个阶段:1) 从赞比亚和印度的考试中收集小学视觉问题;2) 对问题进行筛选和整理,确保其涵盖类比推理、模式补全、空间匹配等多种任务;3) 对图像进行最小化处理,去除不必要的文本信息,以更真实地反映课堂环境;4) 构建评估指标,用于衡量MLLM在不同视觉推理任务上的性能。

关键创新:VRB基准的关键创新在于其真实性和教育针对性。与现有视觉推理数据集相比,VRB更注重模拟真实的课堂环境,使用未经编辑的图像和来自小学考试的真实问题。此外,VRB还特别关注模型在动态空间操作(如折叠、旋转)上的推理能力,这对于小学数学教育至关重要。

关键设计:VRB基准包含701个问题,涵盖类比推理、模式补全和空间匹配等任务。图像采用未经编辑的原始图像,并尽量减少图像中的文本信息。评估指标包括准确率等常用指标,以及针对特定任务设计的指标,例如衡量模型在空间操作上的准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MLLM在静态视觉任务(如计数和缩放)上表现较好,但在动态空间操作(如折叠、旋转)上存在明显局限,达到了“空间天花板”。这表明现有MLLM在处理复杂视觉推理问题时仍存在不足,需要在空间推理能力方面进行改进。该研究强调了教育专用基准的重要性,有助于识别MLLM在教育应用中的潜在风险。

🎯 应用场景

该研究成果可应用于开发更可靠、更有效的教育辅助工具,例如智能辅导系统和自动评分系统。通过使用VRB基准评估和改进MLLM的视觉推理能力,可以提高这些工具在小学教育中的应用效果,并减少因模型错误导致的负面影响。未来的研究可以进一步扩展VRB基准,涵盖更多学科和年龄段,并探索更有效的视觉推理模型。

📄 摘要(原文)

AI models have achieved state-of-the-art results in textual reasoning; however, their ability to reason over spatial and relational structures remains a critical bottleneck -- particularly in early-grade maths, which relies heavily on visuals. This paper introduces the visual reasoning benchmark (VRB), a novel dataset designed to evaluate Multimodal Large Language Models (MLLMs) on their ability to solve authentic visual problems from classrooms. This benchmark is built on a set of 701 questions sourced from primary school examinations in Zambia and India, which cover a range of tasks such as reasoning by analogy, pattern completion, and spatial matching. We outline the methodology and development of the benchmark which intentionally uses unedited, minimal-text images to test if models can meet realistic needs of primary education. Our findings reveal a

jagged frontier'' of capability where models demonstrate better proficiency in static skills such as counting and scaling, but reach a distinctspatial ceiling'' when faced with dynamic operations like folding, reflection, and rotation. These weaknesses pose a risk for classroom use on visual reasoning problems, with the potential for incorrect marking, false scaffolding, and reinforcing student misconceptions. Consequently, education-focused benchmarks like the VRB are essential for determining the functional boundaries of multimodal tools used in classrooms.