Query-focused and Memory-aware Reranker for Long Context Processing

作者: Yuqing Li, Jiangnan Li, Mo Yu, Guoxuan Ding, Zheng Lin, Weiping Wang, Jie Zhou

分类: cs.CL

发布日期: 2026-02-12

备注: 14 pages, 2 figures

💡 一句话要点

提出一种查询聚焦且具备记忆能力的重排序框架,用于处理长文本上下文。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 重排序 长文本处理 注意力机制 信息检索 语言模型 列表式排序 检索头

📋 核心要点

- 现有方法难以有效利用候选列表的整体信息进行排序,且对监督信息要求较高。

- 利用检索头的注意力分数估计段落-查询相关性,实现列表式排序,并产生连续相关性分数。

- 实验表明,该方法在多个领域优于现有方法,并在LoCoMo基准测试上取得了新的SOTA。

📝 摘要(中文)

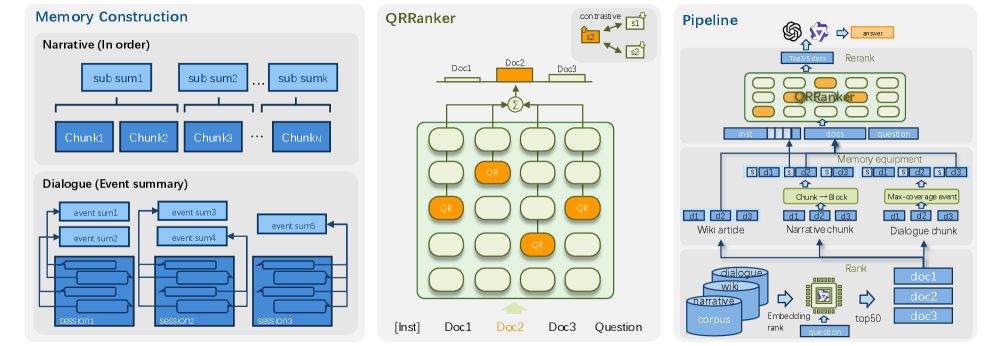

本文提出了一种新的重排序框架,该框架基于对大型语言模型中检索头的现有分析,训练模型利用选定头的注意力分数来估计段落-查询的相关性。这种方法提供了一种列表式解决方案,可以在排序过程中利用整个候选列表中的整体信息。同时,它自然地产生连续的相关性分数,从而可以在任意检索数据集上进行训练,而无需Likert量表监督。我们的框架轻量且有效,仅需小型模型(例如,4B参数)即可实现强大的性能。广泛的实验表明,我们的方法在包括维基百科和长篇叙事数据集在内的多个领域,优于现有的最先进的逐点和列表式重排序器。它进一步在LoCoMo基准测试上建立了新的最先进水平,该基准测试评估了对话理解和记忆使用能力。我们进一步证明,我们的框架支持灵活的扩展。例如,使用上下文信息增强候选段落可以进一步提高排序准确性,而训练中间层的注意力头可以提高效率,而不会牺牲性能。

🔬 方法详解

问题定义:现有重排序方法,特别是逐点(pointwise)方法,无法充分利用候选段落列表的整体信息进行排序。此外,许多方法需要Likert量表形式的监督信号,限制了其在任意检索数据集上的应用。因此,需要一种能够有效利用上下文信息,且对监督信号要求较低的重排序方法,尤其是在长文本上下文中。

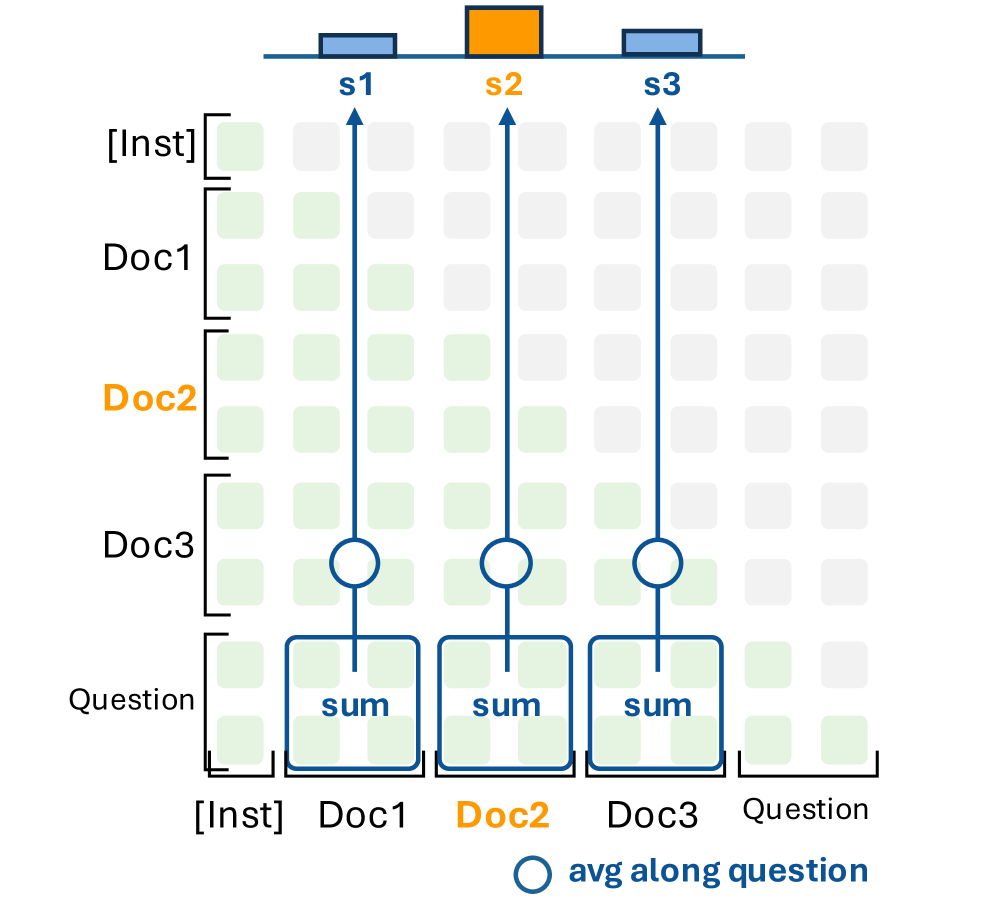

核心思路:本文的核心思路是利用大型语言模型中检索头的注意力分数来估计段落-查询的相关性。通过训练模型学习如何从这些注意力分数中提取有用的信息,可以实现对候选段落的有效排序。这种方法将排序问题视为一个列表式(listwise)问题,允许模型在排序过程中考虑整个候选列表的上下文信息。

技术框架:该重排序框架主要包含以下几个阶段:1) 使用现有的检索模型生成候选段落列表;2) 选择大型语言模型中的特定注意力头作为检索头;3) 利用这些检索头的注意力分数计算段落-查询的相关性;4) 使用计算得到的相关性分数对候选段落进行排序。整个框架是端到端可训练的,可以使用任意检索数据集进行训练。

关键创新:该方法最重要的技术创新点在于利用了大型语言模型中预训练的注意力头作为检索头。与传统的从头开始训练的重排序模型相比,这种方法可以更有效地利用预训练模型的知识,从而提高排序性能。此外,该方法还提出了一种新的训练策略,可以生成连续的相关性分数,从而可以在任意检索数据集上进行训练,而无需Likert量表监督。

关键设计:在具体实现上,该方法选择了大型语言模型中的特定层和注意力头作为检索头。选择的标准是这些头在检索任务上表现良好。损失函数采用pairwise ranking loss,鼓励模型将更相关的段落排在前面。为了进一步提高性能,该方法还探索了使用上下文信息增强候选段落的方法,以及使用中间层的注意力头来提高效率的方法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个领域(包括维基百科和长篇叙事数据集)优于现有的最先进的逐点和列表式重排序器。在LoCoMo基准测试上,该方法取得了新的SOTA,证明了其在对话理解和记忆使用方面的强大能力。例如,在某些数据集上,该方法可以将排序准确率提高5%以上。

🎯 应用场景

该研究成果可广泛应用于信息检索、问答系统、对话系统等领域,尤其是在需要处理长文本上下文的场景下。例如,可以用于提高搜索引擎的排序质量,改进对话系统的回复生成,以及增强知识图谱的推理能力。该方法具有轻量级和高效的特点,易于部署和应用。

📄 摘要(原文)

Built upon the existing analysis of retrieval heads in large language models, we propose an alternative reranking framework that trains models to estimate passage-query relevance using the attention scores of selected heads. This approach provides a listwise solution that leverages holistic information within the entire candidate shortlist during ranking. At the same time, it naturally produces continuous relevance scores, enabling training on arbitrary retrieval datasets without requiring Likert-scale supervision. Our framework is lightweight and effective, requiring only small-scale models (e.g., 4B parameters) to achieve strong performance. Extensive experiments demonstrate that our method outperforms existing state-of-the-art pointwise and listwise rerankers across multiple domains, including Wikipedia and long narrative datasets. It further establishes a new state-of-the-art on the LoCoMo benchmark that assesses the capabilities of dialogue understanding and memory usage. We further demonstrate that our framework supports flexible extensions. For example, augmenting candidate passages with contextual information further improves ranking accuracy, while training attention heads from middle layers enhances efficiency without sacrificing performance.