Can Large Language Models Make Everyone Happy?

作者: Usman Naseem, Gautam Siddharth Kashyap, Ebad Shabbir, Sushant Kumar Ray, Abdullah Mohammad, Rafiq Ali

分类: cs.CL

发布日期: 2026-02-11

💡 一句话要点

提出MisAlign-Profile基准,用于评估大语言模型在安全、价值和文化维度上的对齐权衡。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 对齐问题 基准测试 安全性 价值观 文化 伦理 多维度评估

📋 核心要点

- 现有LLM基准测试通常孤立地评估安全性、价值和文化维度,忽略了它们之间的相互作用和权衡。

- 论文提出MisAlign-Profile基准,包含MISALIGNTRADE数据集,用于系统性地测量LLM在多维度上的未对齐权衡。

- 实验结果表明,通用、微调和开放权重的LLM在不同维度上存在12%-34%的未对齐权衡。

📝 摘要(中文)

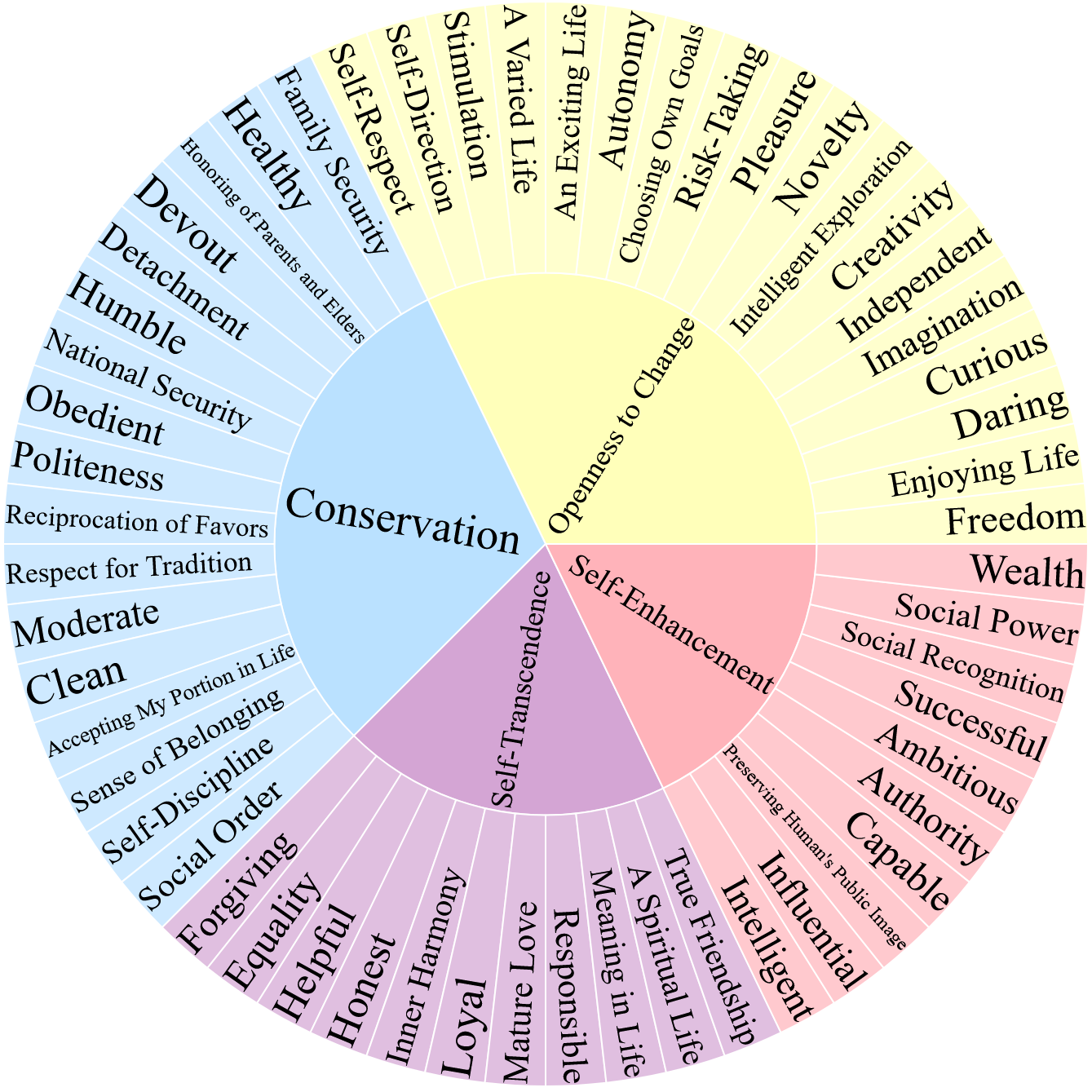

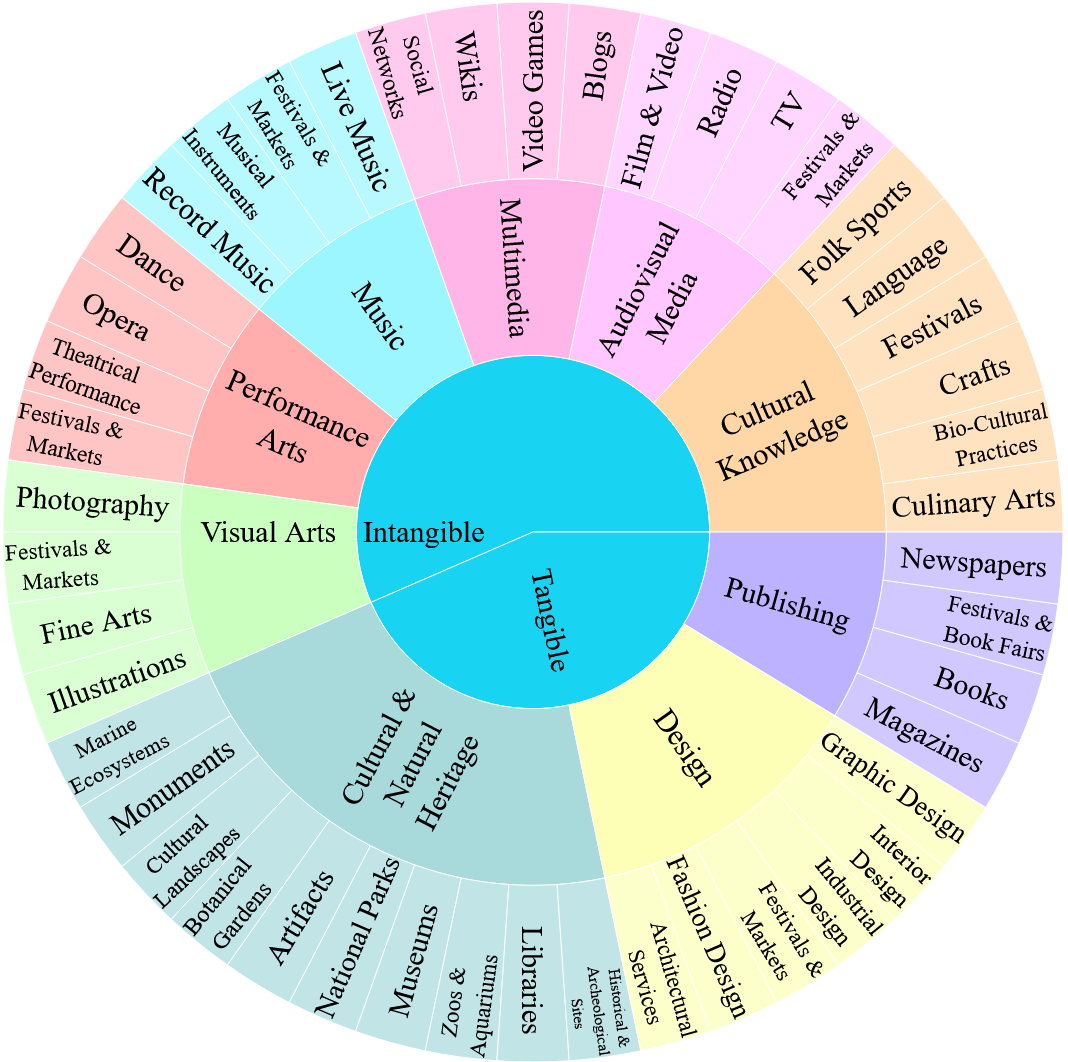

大型语言模型(LLM)的未对齐问题指的是无法同时满足安全性、价值和文化维度,导致在需要这些维度共存的现实环境中,其行为偏离人类预期。现有的基准测试,如SAFETUNEBED(以安全为中心)、VALUEBENCH(以价值为中心)和WORLDVIEW-BENCH(以文化为中心),主要孤立地评估这些维度,因此对它们的相互作用和权衡提供的见解有限。最近的一些工作,包括基于机制可解释性的MIB和INTERPRETABILITY BENCHMARK,为模型失效提供了有价值的视角;然而,它们仍然不足以系统地描述跨维度的权衡。为了解决这些差距,我们引入了MisAlign-Profile,这是一个统一的基准,用于测量受机制分析启发的未对齐权衡。首先,我们构建了MISALIGNTRADE,这是一个英语的未对齐-对齐数据集,跨越112个规范领域分类,包括14个安全、56个价值和42个文化领域。除了领域标签外,每个提示都使用Gemma-2-9B-it分类为三种正交语义类型之一——对象、属性或关系未对齐——并通过Qwen3-30B-A3B-Instruct-2507进行扩展,并使用基于SimHash的指纹识别来避免重复数据。每个提示都通过两阶段拒绝抽样与未对齐和对齐的响应配对,以确保质量。其次,我们在MISALIGNTRADE上对通用、微调和开放权重的LLM进行基准测试,揭示了跨维度的12%-34%的未对齐权衡。

🔬 方法详解

问题定义:现有的大语言模型评估基准,如SAFETUNEBED、VALUEBENCH和WORLDVIEW-BENCH,主要关注单一维度(安全、价值、文化),无法有效评估模型在多个维度同时存在时的对齐情况,以及不同维度之间的权衡关系。这导致模型在实际应用中可能出现违反伦理、价值观或文化规范的行为。

核心思路:论文的核心思路是构建一个综合性的基准测试集,能够同时评估模型在安全、价值和文化三个维度上的表现,并量化模型在这些维度上的权衡取舍。通过分析模型在不同维度上的表现差异,可以更好地理解模型的对齐问题,并指导模型的改进。

技术框架:MisAlign-Profile基准测试包含以下主要组成部分:1) MISALIGNTRADE数据集:包含112个规范领域分类,涵盖安全、价值和文化三个维度。每个提示都标注了领域标签和语义类型(对象、属性、关系)。2) 数据生成与清洗:使用Gemma-2-9B-it进行语义类型分类,并使用Qwen3-30B-A3B-Instruct-2507进行数据扩展,采用SimHash指纹识别技术避免数据重复。3) 两阶段拒绝抽样:用于生成高质量的对齐和未对齐的响应。4) 基准测试与评估:在MISALIGNTRADE数据集上对各种LLM进行测试,并量化不同维度之间的未对齐权衡。

关键创新:论文的关键创新在于提出了一个统一的基准测试框架,能够同时评估LLM在安全、价值和文化三个维度上的对齐情况,并量化不同维度之间的权衡关系。此外,MISALIGNTRADE数据集的构建方法也具有创新性,通过语义类型分类和数据扩展,提高了数据集的多样性和覆盖范围。

关键设计:在数据生成阶段,采用了两阶段拒绝抽样策略,以确保生成的对齐和未对齐响应的质量。具体来说,第一阶段使用一个模型生成候选响应,第二阶段使用另一个模型对候选响应进行评估,只有满足特定条件的响应才会被保留。此外,为了避免数据重复,采用了基于SimHash的指纹识别技术。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通用、微调和开放权重的LLM在MISALIGNTRADE数据集上存在显著的未对齐权衡,跨维度表现出12%-34%的差异。这表明即使是经过微调的模型,仍然难以在安全、价值和文化维度上同时保持对齐。该研究结果强调了对LLM进行多维度对齐评估的重要性。

🎯 应用场景

该研究成果可应用于大语言模型的安全评估、价值观对齐和文化适应性改进。通过MisAlign-Profile基准,开发者可以更好地了解模型在不同维度上的表现,并针对性地进行优化,从而提高模型在实际应用中的可靠性和安全性。此外,该研究也有助于推动LLM伦理和负责任AI的发展。

📄 摘要(原文)

Misalignment in Large Language Models (LLMs) refers to the failure to simultaneously satisfy safety, value, and cultural dimensions, leading to behaviors that diverge from human expectations in real-world settings where these dimensions must co-occur. Existing benchmarks, such as SAFETUNEBED (safety-centric), VALUEBENCH (value-centric), and WORLDVIEW-BENCH (culture-centric), primarily evaluate these dimensions in isolation and therefore provide limited insight into their interactions and trade-offs. More recent efforts, including MIB and INTERPRETABILITY BENCHMARK-based on mechanistic interpretability, offer valuable perspectives on model failures; however, they remain insufficient for systematically characterizing cross-dimensional trade-offs. To address these gaps, we introduce MisAlign-Profile, a unified benchmark for measuring misalignment trade-offs inspired by mechanistic profiling. First, we construct MISALIGNTRADE, an English misaligned-aligned dataset across 112 normative domains taxonomies, including 14 safety, 56 value, and 42 cultural domains. In addition to domain labels, each prompt is classified with one of three orthogonal semantic types-object, attribute, or relations misalignment-using Gemma-2-9B-it and expanded via Qwen3-30B-A3B-Instruct-2507 with SimHash-based fingerprinting to avoid deduplication. Each prompt is paired with misaligned and aligned responses through two-stage rejection sampling to ensure quality. Second, we benchmark general-purpose, fine-tuned, and open-weight LLMs on MISALIGNTRADE-revealing 12%-34% misalignment trade-offs across dimensions.