Beyond Confidence: The Rhythms of Reasoning in Generative Models

作者: Deyuan Liu, Zecheng Wang, Zhanyue Qin, Zhiying Tu, Dianhui Chu, Dianbo Sui

分类: cs.CL, cs.AI

发布日期: 2026-02-11

备注: ICLR 2026

💡 一句话要点

提出Token Constraint Bound以解决LLM预测稳定性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 预测稳定性 Token Constraint Bound 内部状态分析 文本生成

📋 核心要点

- 现有方法如准确率和困惑度无法有效评估大型语言模型在输入扰动下的预测稳定性,导致模型的可靠性受到影响。

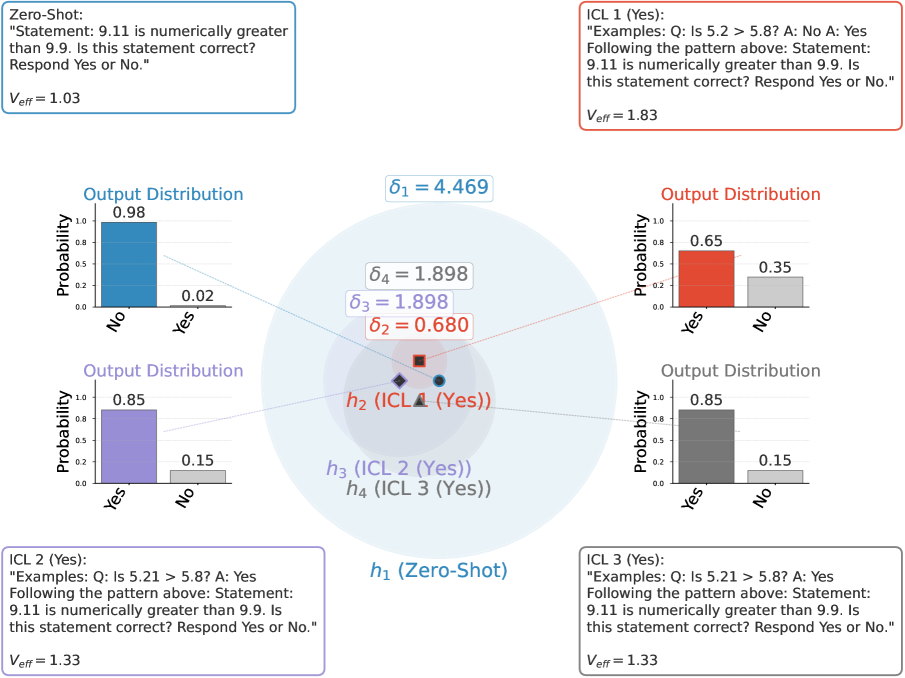

- 本文提出Token Constraint Bound($δ_{ ext{TCB}}$),量化LLM在预测变化前的最大内部状态扰动,从而评估模型的稳定性。

- $δ_{ ext{TCB}}$的实验结果显示其与有效的提示工程相关,并能揭示困惑度未能捕捉的预测不稳定性,提升了模型的上下文稳定性。

📝 摘要(中文)

大型语言模型(LLMs)展现出令人印象深刻的能力,但对输入上下文微小变化的敏感性限制了其可靠性。传统的评估指标如准确率和困惑度无法有效评估局部预测的鲁棒性,因为归一化的输出概率可能掩盖LLM内部状态对扰动的抵抗力。本文提出了一种新颖的度量标准——Token Constraint Bound($δ_{ ext{TCB}}$),量化LLM在其主导下一个token预测显著变化之前,能够承受的最大内部状态扰动。$δ_{ ext{TCB}}$与输出嵌入空间几何密切相关,提供了对模型内部预测承诺稳定性的深入洞察。实验表明,$δ_{ ext{TCB}}$与有效的提示工程相关,并揭示了在上下文学习和文本生成中被困惑度忽视的关键预测不稳定性。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在输入上下文微小变化下预测稳定性不足的问题。现有的评估指标如准确率和困惑度未能有效反映模型内部状态的鲁棒性,导致对模型可靠性的评估不够全面。

核心思路:论文提出的Token Constraint Bound($δ_{ ext{TCB}}$)度量了LLM在其主导下一个token预测显著变化之前,能够承受的最大内部状态扰动。通过这一度量,研究者能够更好地理解模型的内部预测承诺的稳定性。

技术框架:该方法的整体架构包括对LLM的输出嵌入空间进行几何分析,结合输入扰动的影响,计算出$δ_{ ext{TCB}}$。主要模块包括输入扰动生成、内部状态分析和$δ_{ ext{TCB}}$计算。

关键创新:$δ_{ ext{TCB}}$是一个全新的度量标准,能够量化模型在面对输入扰动时的稳定性,与传统的困惑度等指标相比,提供了更深入的分析视角。

关键设计:在设计$δ_{ ext{TCB}}$时,考虑了输出嵌入空间的几何特性,确保度量的准确性和有效性。此外,实验中采用了多种输入扰动策略,以验证$δ_{ ext{TCB}}$的鲁棒性和适用性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,$δ_{ ext{TCB}}$与有效的提示工程显著相关,能够揭示困惑度未能捕捉的关键预测不稳定性。具体而言,$δ_{ ext{TCB}}$在上下文学习和文本生成中的应用,提升了模型的上下文稳定性,提供了新的分析工具。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理、对话系统和文本生成等。通过提高大型语言模型的预测稳定性,能够增强其在实际应用中的可靠性,进而推动智能助手、自动写作等技术的发展。

📄 摘要(原文)

Large Language Models (LLMs) exhibit impressive capabilities yet suffer from sensitivity to slight input context variations, hampering reliability. Conventional metrics like accuracy and perplexity fail to assess local prediction robustness, as normalized output probabilities can obscure the underlying resilience of an LLM's internal state to perturbations. We introduce the Token Constraint Bound ($δ_{\mathrm{TCB}}$), a novel metric that quantifies the maximum internal state perturbation an LLM can withstand before its dominant next-token prediction significantly changes. Intrinsically linked to output embedding space geometry, $δ_{\mathrm{TCB}}$ provides insights into the stability of the model's internal predictive commitment. Our experiments show $δ_{\mathrm{TCB}}$ correlates with effective prompt engineering and uncovers critical prediction instabilities missed by perplexity during in-context learning and text generation. $δ_{\mathrm{TCB}}$ offers a principled, complementary approach to analyze and potentially improve the contextual stability of LLM predictions.