Advancing Block Diffusion Language Models for Test-Time Scaling

作者: Yi Lu, Deyang Kong, Jianing Wang, Linsen Guo, Xue Wang, Qi Guo, Tao Gui, Xuanjing Huang, Wei Ye, Shikun Zhang, Wei Wang

分类: cs.CL

发布日期: 2026-02-10

💡 一句话要点

提出BACD和TCCF框架,提升块扩散语言模型在测试时推理加速和长链推理任务上的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 块扩散语言模型 测试时扩展 长链推理 自适应解码 推理加速

📋 核心要点

- 现有块扩散语言模型在测试时扩展性探索不足,长链推理中解码速度和效果难以平衡。

- 提出BACD和TCCF框架,分别在解码和块生成层面引入自适应性,提升推理效率和效果。

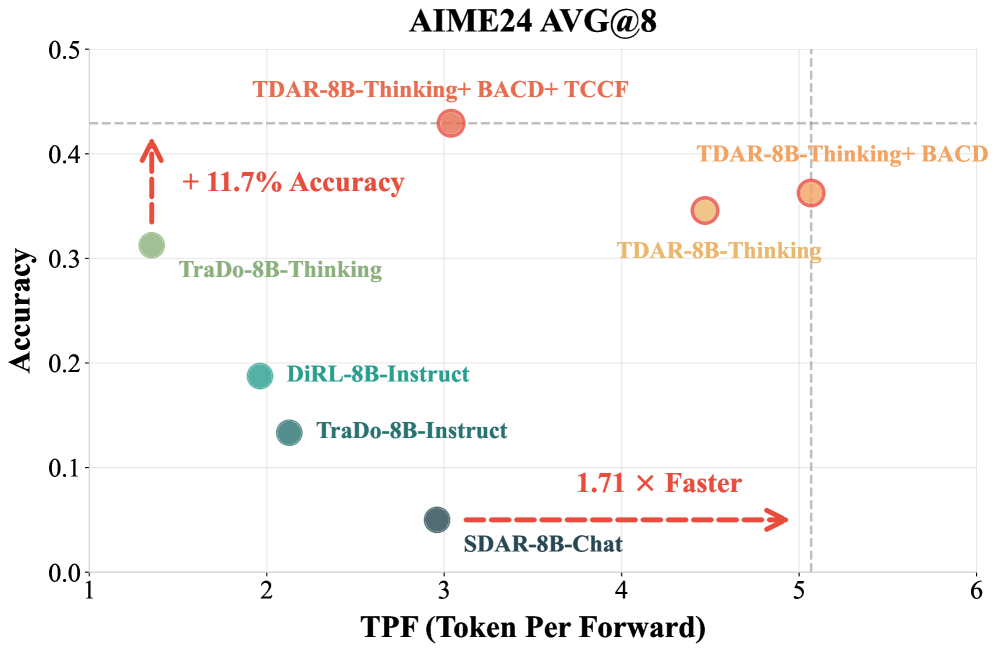

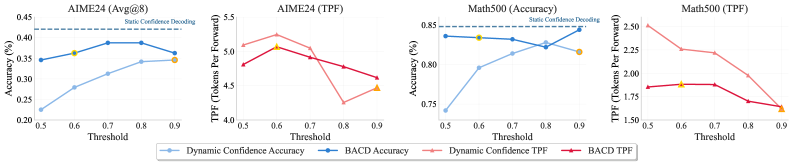

- 实验表明,BACD和TCCF能显著提升TDAR-8B在AIME24等推理任务上的性能和推理速度。

📝 摘要(中文)

本文针对块扩散语言模型(BDLM)在测试时扩展设置下的探索不足以及长链思维推理中解码速度和效果平衡的挑战,提出了一个统一的测试时扩展框架。该框架在解码和块生成两个层面引入自适应性。在解码层面,提出了有界自适应置信度解码(BACD),这是一种难度感知的采样策略,可根据模型置信度动态调整去噪过程,从而加速推理并控制误差累积。在块生成层面,提出了“粗想精评”(TCCF)的测试时扩展范式,该范式为探索性推理分配较大的块大小,为细化分配较小的块大小,从而实现有效的效率-效果平衡。为了在使用大块大小时实现高效解码,采用了渐进式块大小扩展,从而减轻了扩展块大小时的性能下降。大量实验表明,将BACD和TCCF应用于TDAR-8B,可以显著优于TraDo-8B等强大的基线(AIME24上速度提高2.26倍,性能提高11.2分)。这些结果标志着在复杂推理任务中释放BDLM测试时扩展潜力方面迈出了重要一步。

🔬 方法详解

问题定义:现有块扩散语言模型(BDLM)在测试时扩展(Test-Time Scaling)场景下,尤其是在长链思维(Chain-of-Thought)推理任务中,面临着解码速度和推理效果难以兼顾的问题。具体来说,如何在保证推理准确性的前提下,尽可能地加速推理过程,是现有方法的一个痛点。

核心思路:本文的核心思路是在解码和块生成两个层面引入自适应性。在解码层面,根据模型对当前解码结果的置信度动态调整去噪过程,置信度高则加速,置信度低则放慢。在块生成层面,根据推理阶段的不同(探索性推理 vs. 细化),动态调整块的大小,探索性推理使用大块,细化使用小块。这样设计的目的是为了在推理的不同阶段,根据任务的难易程度,自适应地调整解码和生成的策略,从而实现效率和效果的平衡。

技术框架:该框架包含两个主要模块:有界自适应置信度解码(BACD)和“粗想精评”(TCCF)的测试时扩展范式。BACD主要负责在解码过程中,根据模型置信度动态调整去噪过程。TCCF则负责在块生成过程中,根据推理阶段的不同,动态调整块的大小。为了缓解大块大小带来的性能下降,还采用了渐进式块大小扩展(Progressive Block Size Extension)。整体流程是:首先使用TCCF确定块大小,然后在每个块的解码过程中,使用BACD动态调整去噪过程。

关键创新:最重要的技术创新点在于BACD和TCCF的结合,实现了在解码和块生成两个层面的自适应性。与现有方法相比,BACD能够根据模型置信度动态调整解码过程,避免了盲目地进行固定步数的去噪,从而提高了推理效率。TCCF则能够根据推理阶段的不同,动态调整块的大小,从而在探索性推理和细化之间取得平衡。这种双重自适应性是现有方法所不具备的。

关键设计:BACD的关键设计在于置信度的计算方法和动态调整去噪步数的策略。具体来说,置信度可以通过模型输出的概率分布来估计。动态调整去噪步数的策略可以采用线性或非线性的方式,根据置信度的大小来调整。TCCF的关键设计在于如何确定推理阶段的不同,以及如何根据推理阶段的不同来调整块的大小。推理阶段可以通过任务的类型或模型的输出来判断。块的大小可以根据推理阶段的难易程度来调整,例如,探索性推理可以使用较大的块大小,细化可以使用较小的块大小。渐进式块大小扩展的具体实现方式未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,将BACD和TCCF应用于TDAR-8B模型,在AIME24推理任务上,相比于强大的基线模型TraDo-8B,推理速度提升了2.26倍,性能提升了11.2分。这些结果表明,该方法在提升块扩散语言模型的推理效率和准确性方面具有显著优势。

🎯 应用场景

该研究成果可应用于各种需要长链推理的自然语言处理任务,例如问答系统、文本摘要、机器翻译等。通过提升推理速度和准确性,可以提高这些应用的用户体验和实用性。未来,该方法有望扩展到其他类型的语言模型和推理任务中,进一步提升人工智能的推理能力。

📄 摘要(原文)

Recent advances in block diffusion language models have demonstrated competitive performance and strong scalability on reasoning tasks. However, existing BDLMs have limited exploration under the test-time scaling setting and face more severe decoding challenges in long Chain-of-Thought reasoning, particularly in balancing the decoding speed and effectiveness. In this work, we propose a unified framework for test-time scaling in BDLMs that introduces adaptivity in both decoding and block-wise generation. At the decoding level, we propose Bounded Adaptive Confidence Decoding (BACD), a difficulty-aware sampling strategy that dynamically adjusts denoising based on model confidence, accelerating inference while controlling error accumulation. Beyond step-wise adaptivity, we introduce Think Coarse, Critic Fine (TCCF), a test-time scaling paradigm that allocates large block sizes to exploratory reasoning and smaller block sizes to refinement, achieving an effective efficiency-effectiveness balance. To enable efficient and effective decoding with a large block size, we adopt Progressive Block Size Extension, which mitigates performance degradation when scaling block sizes. Extensive experiments show that applying BACD and TCCF to TDAR-8B yields significant improvements over strong baselines such as TraDo-8B (2.26x speedup, +11.2 points on AIME24). These results mark an important step toward unlocking the potential of BDLMs for test-time scaling in complex reasoning tasks.