Breaking the Pre-Sampling Barrier: Activation-Informed Difficulty-Aware Self-Consistency

作者: Taewoong Yoon, Geunyeong Jeong, Geon Park, Sihyeong Yeom, Harksoo Kim

分类: cs.CL

发布日期: 2026-02-10

💡 一句话要点

提出ACTSC,利用激活信息实现难度自适应的自洽解码,降低LLM推理成本。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自洽性解码 难度自适应 大型语言模型 神经元激活 推理成本 轻量级探针

📋 核心要点

- 自洽性解码策略提升LLM推理能力,但高采样量导致推理成本过高。

- ACTSC利用神经元激活信息构建难度估计探针,动态调整采样量,无需额外模型调用。

- 实验表明,ACTSC在降低推理成本的同时,保持了与现有方法相当的准确率。

📝 摘要(中文)

自洽性(SC)是一种有效的解码策略,它通过生成多个思维链推理路径,并通过多数投票选择最终答案来提高大型语言模型(LLM)的推理性能。然而,由于需要大量的样本,它带来了巨大的推理成本。为了缓解这个问题,提出了难度自适应自洽性(DSC),通过根据问题难度调整样本数量来减少简单问题的不必要token使用。但是,DSC需要额外的模型调用和预采样来估计难度,并且这个过程在应用于每个数据集时都会重复,导致显著的计算开销。在这项工作中,我们提出了激活信息难度自适应自洽性(ACTSC)来解决这些限制。ACTSC利用前馈网络神经元激活中反映的内部难度信号来构建轻量级的难度估计探针,而无需任何额外的token生成或模型调用。该探针动态调整SC的样本数量,并且可以应用于新的数据集,而无需预采样进行难度估计。为了验证其有效性,我们在五个基准上进行了实验。实验结果表明,ACTSC有效地降低了推理成本,同时保持了相对于现有方法的准确性。

🔬 方法详解

问题定义:现有难度自适应自洽性方法(如DSC)需要额外的模型调用和预采样来估计问题难度,这增加了计算开销,并且需要针对每个新数据集重复此过程。因此,如何高效且无需额外计算代价地估计问题难度,并动态调整采样数量,是本文要解决的核心问题。

核心思路:论文的核心思路是利用LLM内部的神经元激活信息来估计问题难度。作者认为,前馈网络神经元的激活程度能够反映问题本身的难度,因此可以通过分析这些激活值来构建一个轻量级的难度估计探针。这样,就可以在不进行额外模型调用或预采样的情况下,动态调整自洽性解码的采样数量。

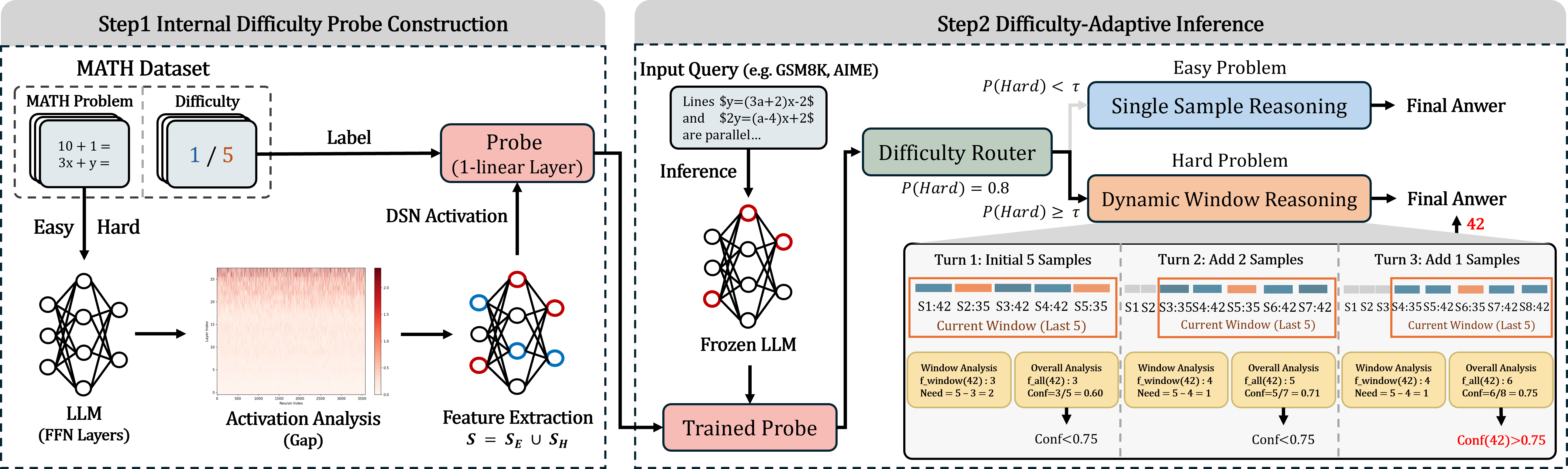

技术框架:ACTSC的整体框架如下:1) 激活信息提取:从LLM的前馈网络层提取神经元激活值。2) 难度估计探针构建:利用提取的激活值训练一个轻量级的难度估计模型(probe)。3) 采样数量动态调整:根据难度估计探针的输出,动态调整自洽性解码的采样数量。4) 自洽性解码:使用调整后的采样数量进行自洽性解码,得到最终答案。

关键创新:ACTSC的关键创新在于利用LLM内部的神经元激活信息来估计问题难度,从而避免了额外的模型调用和预采样。这使得难度自适应的自洽性解码更加高效和实用。与现有方法相比,ACTSC无需针对每个新数据集进行预采样,具有更好的泛化能力。

关键设计:难度估计探针可以使用简单的线性模型或小型神经网络。训练探针的目标是预测问题的难度等级,可以使用交叉熵损失函数。采样数量的调整可以采用线性或非线性函数,将难度估计值映射到采样数量。具体激活层选择、探针模型结构、损失函数权重等超参数需要根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

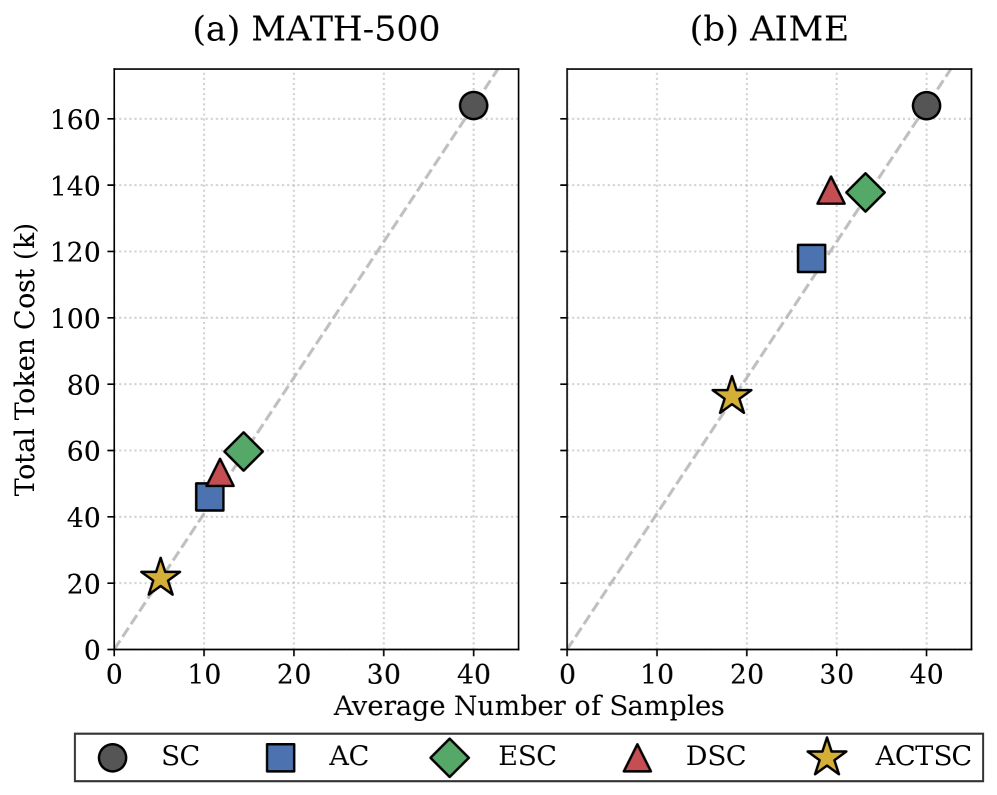

实验结果表明,ACTSC在五个基准测试中有效地降低了推理成本,同时保持了与现有方法相当的准确率。具体而言,ACTSC在某些数据集上能够将推理成本降低高达50%,而准确率仅下降不到1%。与DSC相比,ACTSC无需预采样,因此具有更高的效率和更好的泛化能力。

🎯 应用场景

ACTSC可应用于各种需要LLM进行推理的任务,例如问答、数学问题求解、代码生成等。通过降低推理成本,ACTSC使得LLM能够在资源受限的环境中更高效地运行,例如移动设备或边缘计算设备。此外,ACTSC还可以用于提高LLM在低资源场景下的性能,例如few-shot学习。

📄 摘要(原文)

Self-Consistency (SC) is an effective decoding strategy that improves the reasoning performance of Large Language Models (LLMs) by generating multiple chain-of-thought reasoning paths and selecting the final answer via majority voting. However, it suffers from substantial inference costs because it requires a large number of samples. To mitigate this issue, Difficulty-Adaptive Self-Consistency (DSC) was proposed to reduce unnecessary token usage for easy problems by adjusting the number of samples according to problem difficulty. However, DSC requires additional model calls and pre-sampling to estimate difficulty, and this process is repeated when applying to each dataset, leading to significant computational overhead. In this work, we propose Activation-Informed Difficulty-Aware Self-Consistency (ACTSC) to address these limitations. ACTSC leverages internal difficulty signals reflected in the feed-forward network neuron activations to construct a lightweight difficulty estimation probe, without any additional token generation or model calls. The probe dynamically adjusts the number of samples for SC and can be applied to new datasets without requiring pre-sampling for difficulty estimation. To validate its effectiveness, we conduct experiments on five benchmarks. Experimental results show that ACTSC effectively reduces inference costs while maintaining accuracy relative to existing methods.