Affective Flow Language Model for Emotional Support Conversation

作者: Chenghui Zou, Ning Wang, Tiesunlong Shen, Luwei Xiao, Chuan Ma, Xiangpeng Li, Rui Mao, Erik Cambria

分类: cs.CL, cs.AI

发布日期: 2026-02-09

备注: 19 pages, 7 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出情感流语言模型AFlow,通过细粒度情感建模提升情感支持对话质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感支持对话 情感流建模 语言模型 策略学习 多轮对话

📋 核心要点

- 现有情感支持对话模型依赖稀疏的结果级信号,缺乏对中间策略决策的有效监督。

- AFlow通过建模多轮对话中的连续情感流,为对话前缀提供细粒度的监督信号,从而优化策略。

- 实验表明,AFlow在情感支持对话指标上显著优于现有模型,甚至超越了GPT-4o和Claude-3.5等专有模型。

📝 摘要(中文)

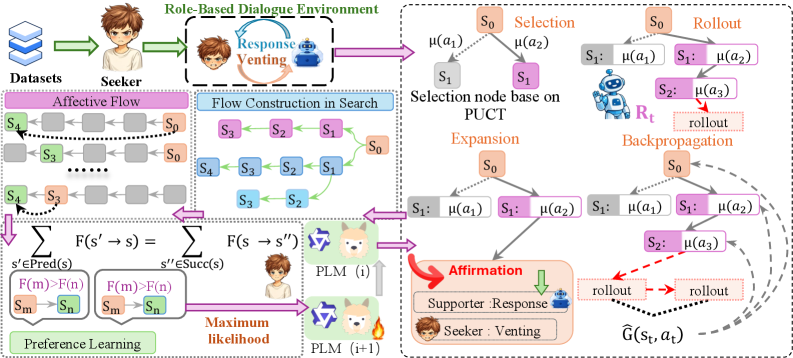

大型语言模型(LLMs)已被广泛应用于情感支持对话(ESC)。然而,复杂的多轮支持仍然具有挑战性。这是因为现有的对齐方案依赖于稀疏的结果级信号,因此为中间策略决策提供的监督有限。为了填补这一空白,本文提出了一种用于情感支持对话的情感流语言模型(AFlow),该框架通过对多轮轨迹建模连续的情感流,从而在对话前缀上引入细粒度的监督。AFlow可以估计搜索轨迹上的中间效用,并学习与偏好一致的策略转换。为了提高策略连贯性和共情响应质量,提出了一种子路径级流平衡目标,以将偏好信号传播到中间状态。实验结果表明,在不同的情感背景下,相对于有竞争力的基线,AFlow具有一致且显著的改进。值得注意的是,AFlow使用紧凑的开源骨干网络,在主要的ESC指标上优于专有的LMM,如GPT-4o和Claude-3.5。我们的代码可在https://github.com/chzou25-lgtm/AffectiveFlow 获取。

🔬 方法详解

问题定义:情感支持对话(ESC)旨在为用户提供情感上的支持和帮助。现有方法,特别是基于大型语言模型的方法,在处理复杂多轮对话时面临挑战。主要痛点在于,模型训练依赖于对话最终结果的稀疏信号,缺乏对中间对话策略的有效监督,导致策略不连贯,共情能力不足。

核心思路:AFlow的核心思路是通过建模对话过程中的情感流动,为模型的中间策略决策提供更细粒度的监督信号。具体来说,AFlow将对话过程视为一个连续的情感变化过程,并学习预测每个对话状态的情感效用。通过这种方式,模型可以更好地理解对话的上下文,并选择更合适的策略来引导对话朝着积极的方向发展。

技术框架:AFlow框架主要包含以下几个模块:1) 情感流建模模块:用于建模对话过程中的情感变化,并预测每个对话状态的情感效用。2) 策略搜索模块:用于搜索最佳的对话策略,以最大化对话的最终情感效用。3) 策略学习模块:用于学习与偏好一致的策略转换,从而提高策略的连贯性。4) 子路径级流平衡模块:通过将偏好信号传播到中间状态,进一步提高策略的连贯性和共情响应质量。

关键创新:AFlow的关键创新在于引入了细粒度的情感流建模,为情感支持对话提供了更有效的监督信号。与现有方法相比,AFlow不仅关注对话的最终结果,还关注对话过程中的情感变化,从而可以更好地理解对话的上下文,并选择更合适的策略。此外,子路径级流平衡目标的引入,进一步提高了策略的连贯性和共情响应质量。

关键设计:AFlow的关键设计包括:1) 使用Transformer模型作为情感流建模模块的基础架构。2) 定义情感效用函数,用于评估每个对话状态的情感价值。3) 设计子路径级流平衡损失函数,用于将偏好信号传播到中间状态。4) 使用强化学习算法进行策略学习,以最大化对话的最终情感效用。

🖼️ 关键图片

📊 实验亮点

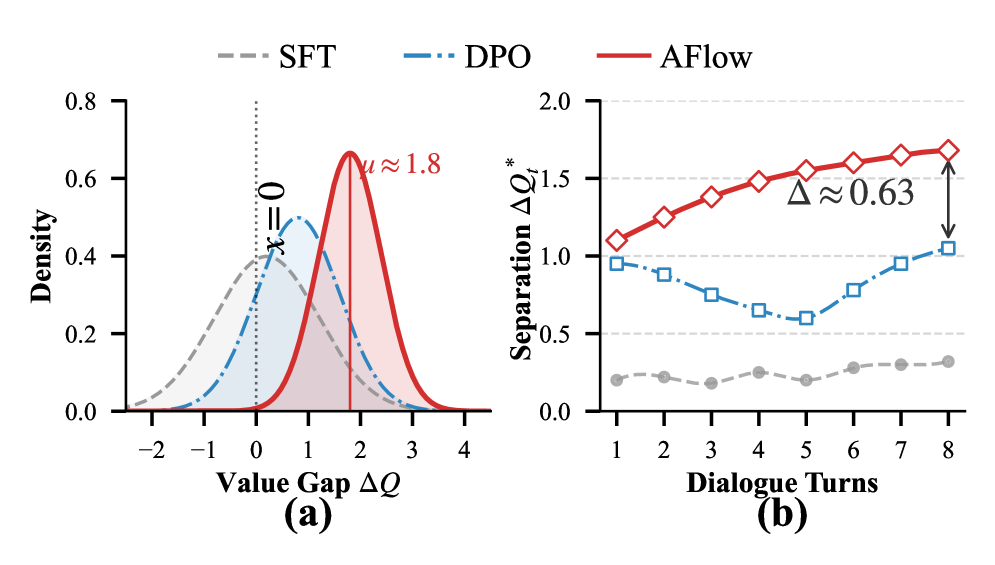

实验结果表明,AFlow在多个情感支持对话指标上取得了显著的提升,包括情感支持质量、策略连贯性和共情响应质量。值得注意的是,AFlow使用紧凑的开源骨干网络,在主要的ESC指标上优于专有的LMM,如GPT-4o和Claude-3.5,证明了其在实际应用中的潜力。

🎯 应用场景

AFlow可应用于各种情感支持场景,例如心理咨询、在线客服、社交机器人等。通过提供更具共情能力和策略性的对话,AFlow可以有效缓解用户的情绪困扰,提升用户满意度,并改善人机交互体验。未来,该技术有望在医疗健康、教育等领域发挥更大的作用。

📄 摘要(原文)

Large language models (LLMs) have been widely applied to emotional support conversation (ESC). However, complex multi-turn support remains challenging.This is because existing alignment schemes rely on sparse outcome-level signals, thus offering limited supervision for intermediate strategy decisions. To fill this gap, this paper proposes affective flow language model for emotional support conversation (AFlow), a framework that introduces fine-grained supervision on dialogue prefixes by modeling a continuous affective flow along multi-turn trajectories. AFlow can estimate intermediate utility over searched trajectories and learn preference-consistent strategy transitions. To improve strategy coherence and empathetic response quality, a subpath-level flow-balance objective is presented to propagate preference signals to intermediate states. Experiment results show consistent and significant improvements over competitive baselines in diverse emotional contexts. Remarkably, AFlow with a compact open-source backbone outperforms proprietary LMMs such as GPT-4o and Claude-3.5 on major ESC metrics. Our code is available at https://github.com/chzou25-lgtm/AffectiveFlow.