Linguistics and Human Brain: A Perspective of Computational Neuroscience

作者: Fudong Zhang, Bo Chai, Yujie Wu, Wai Ting Siok, Nizhuan Wang

分类: q-bio.NC, cs.CL

发布日期: 2026-02-09

💡 一句话要点

计算神经科学视角下语言与人脑关系研究:利用深度学习弥合语言学与神经科学的鸿沟

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 计算神经科学 语言学 大型语言模型 模型-大脑对齐 神经机制 语言处理 深度学习

📋 核心要点

- 现有方法难以有效连接语言学的抽象理论与神经科学的实证数据,阻碍了对语言-大脑关系的深入理解。

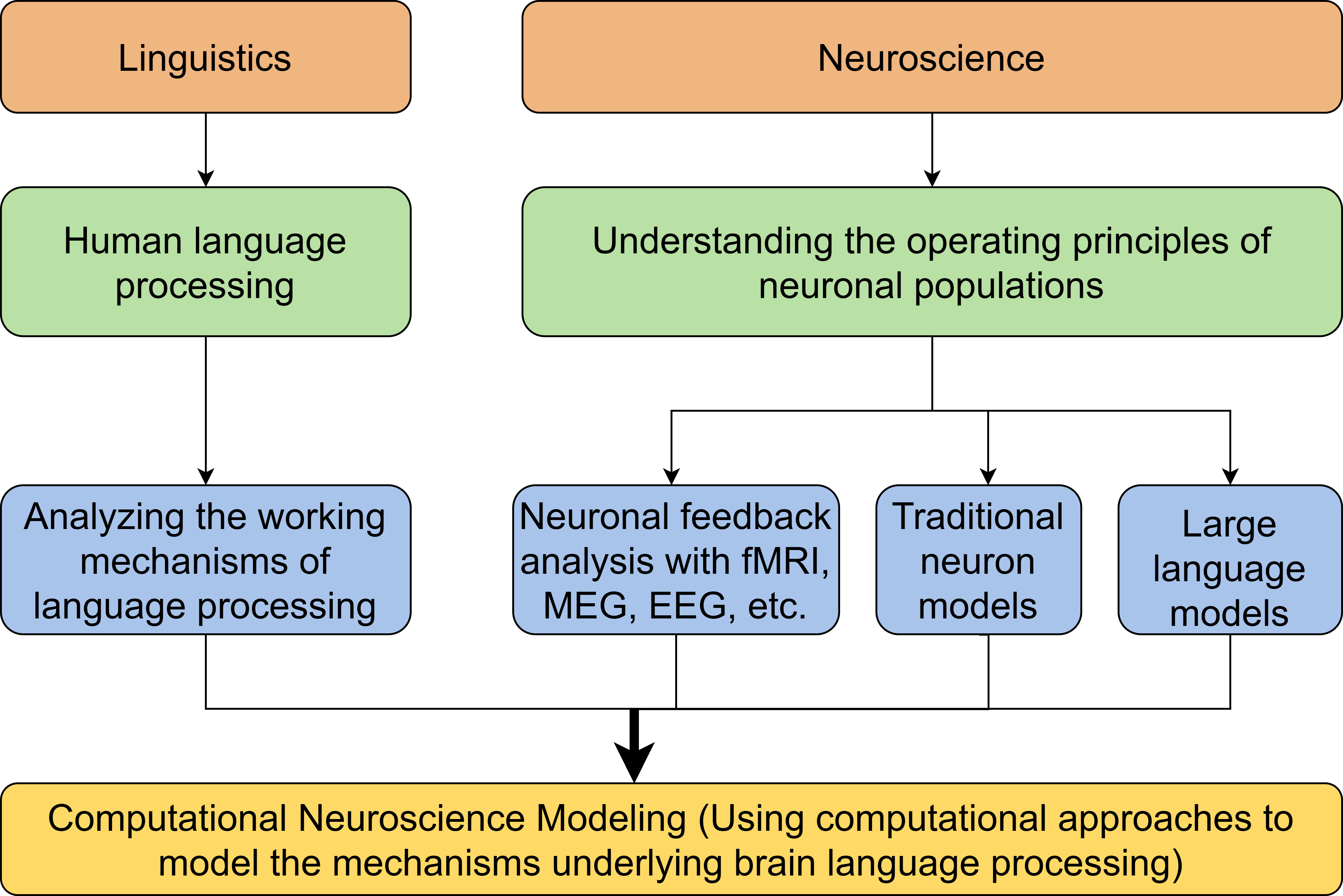

- 论文利用计算神经科学,通过建模和仿真,将语言结构转化为神经模型,促进语言学假设与神经机制的对话。

- 借助深度学习和大型语言模型,探索语言处理的神经基础,并使用“模型-大脑对齐”框架评估理论的生物学合理性。

📝 摘要(中文)

本文探讨了语言-大脑关系,指出弥合语言学抽象理论框架与神经科学实证数据之间的鸿沟是关键。计算神经科学作为跨学科的基石,通过建模、仿真和数据分析,将语言的层次和动态结构形式化为可测试的神经模型,从而实现语言学假设与神经机制之间的计算对话。深度学习,特别是大型语言模型(LLMs)的最新进展,为此提供了强大的推动力。它们的高维表征空间为探索语言处理的神经基础提供了一个新的尺度,而“模型-大脑对齐”框架则提供了一种评估语言相关理论生物学合理性的方法。

🔬 方法详解

问题定义:该论文旨在解决语言学理论与神经科学数据之间脱节的问题。现有方法难以将语言的抽象结构与大脑的神经活动联系起来,导致我们对语言的神经基础理解不足。这种脱节阻碍了语言学理论的验证和神经科学发现的解释。

核心思路:论文的核心思路是利用计算神经科学作为桥梁,通过构建计算模型来模拟语言的神经处理过程。这些模型能够将语言学的抽象概念转化为具体的、可测试的神经表征。通过比较模型预测与实际神经数据,可以评估语言学理论的生物学合理性。

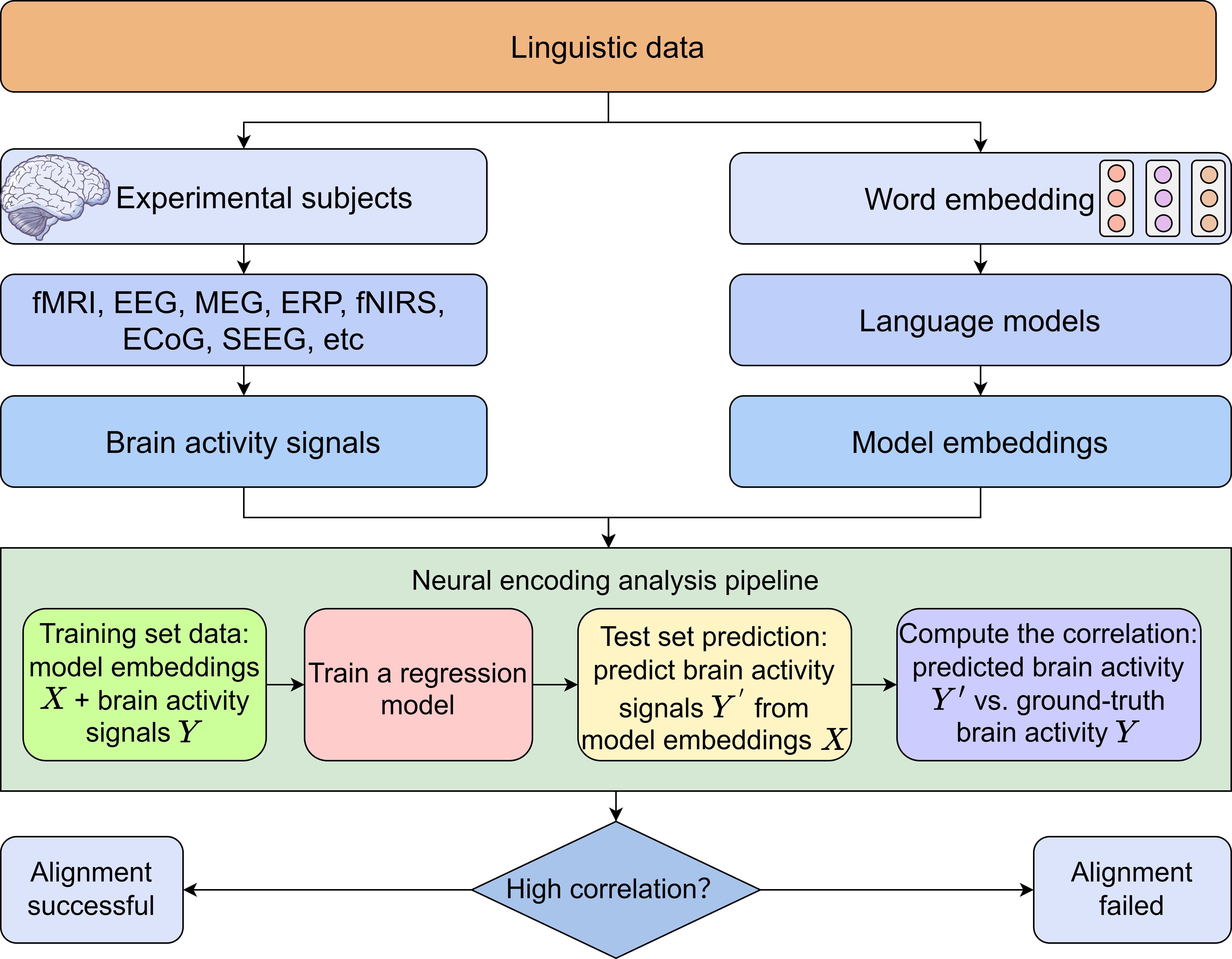

技术框架:整体框架包括以下几个主要阶段:1) 语言学理论形式化:将语言学理论转化为可计算的形式,例如,使用形式语法或语义网络表示语言结构。2) 神经模型构建:基于形式化的语言学理论,构建相应的神经模型,例如,循环神经网络或Transformer模型。3) 模型训练与仿真:使用语言数据训练神经模型,并模拟其在处理语言任务时的神经活动。4) 模型-大脑对齐:将模型的内部表征与大脑的神经活动数据进行比较,评估模型的生物学合理性。常用的方法包括表征相似性分析(RSA)和编码模型。

关键创新:该论文的关键创新在于强调了大型语言模型(LLMs)在连接语言学与神经科学方面的潜力。LLMs具有强大的表征学习能力,能够捕捉语言的复杂结构和语义信息。通过将LLMs作为神经模型,可以更有效地探索语言的神经基础。此外,“模型-大脑对齐”框架提供了一种量化评估语言相关理论生物学合理性的方法。

关键设计:论文中提到的关键设计包括:1) 使用大型语言模型(如BERT、GPT系列)作为神经模型。2) 采用表征相似性分析(RSA)来比较模型表征与神经活动模式。3) 使用编码模型来预测神经活动,并评估模型的预测精度。4) 关注模型内部表征的层次结构,例如,不同层级的表征可能对应于不同的语言处理阶段。

🖼️ 关键图片

📊 实验亮点

论文强调了大型语言模型在连接语言学和神经科学方面的潜力,并提出了“模型-大脑对齐”框架。虽然具体实验数据未在摘要中给出,但该框架为评估语言相关理论的生物学合理性提供了一种有效方法。未来的研究可以关注具体的模型性能指标,例如模型预测神经活动的能力,以及模型在不同语言任务上的表现。

🎯 应用场景

该研究成果可应用于多个领域,包括:1) 改进自然语言处理系统,使其更符合人类的语言处理方式;2) 辅助诊断和治疗语言障碍,例如失语症;3) 深入理解人类认知,揭示语言在认知中的作用;4) 开发更智能的人机交互系统,提升用户体验。未来的研究可以探索更复杂的语言现象,并结合更多模态的信息,例如视觉和听觉。

📄 摘要(原文)

Elucidating the language-brain relationship requires bridging the methodological gap between the abstract theoretical frameworks of linguistics and the empirical neural data of neuroscience. Serving as an interdisciplinary cornerstone, computational neuroscience formalizes the hierarchical and dynamic structures of language into testable neural models through modeling, simulation, and data analysis. This enables a computational dialogue between linguistic hypotheses and neural mechanisms. Recent advances in deep learning, particularly large language models (LLMs), have powerfully advanced this pursuit. Their high-dimensional representational spaces provide a novel scale for exploring the neural basis of linguistic processing, while the "model-brain alignment" framework offers a methodology to evaluate the biological plausibility of language-related theories.