Thinking Makes LLM Agents Introverted: How Mandatory Thinking Can Backfire in User-Engaged Agents

作者: Jiatong Li, Changdae Oh, Hyeong Kyu Choi, Jindong Wang, Sharon Li

分类: cs.CL

发布日期: 2026-02-08

备注: 27 pages, 19 figures

🔗 代码/项目: GITHUB

💡 一句话要点

强制思考降低LLM Agent交互性:用户交互场景下思考提示可能适得其反

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 用户交互 思考提示 信息披露 透明度

📋 核心要点

- 现有研究表明,诱导LLM进行推理可以提高其在复杂任务中的性能,但在真实用户交互场景中的效果尚不明确。

- 该论文的核心思想是研究显式思考提示对用户交互型LLM Agent的影响,并发现强制思考可能导致Agent性能下降。

- 实验结果表明,强制思考会使Agent更加“内向”,减少信息披露,从而影响Agent与用户之间的信息交换,导致任务失败。

📝 摘要(中文)

本文研究了显式思考提示在用户交互型LLM Agent中的影响。通过七个模型、三个基准测试和两种思考实例化方式的实验,并结合定量响应分类分析和定性失败传播案例研究,发现强制思考通常会适得其反,导致各种LLM的性能异常下降。研究表明,思考使Agent更加“内向”,缩短了响应并减少了向用户的信息披露,从而削弱了Agent与用户之间的信息交换,导致下游任务失败。此外,显式提示信息披露能够可靠地提高各种模型系列的性能,表明主动透明性是Agent优化的关键。总体而言,这项研究表明,信息透明度意识是未来现实场景中推理Agent设计的一个至关重要但尚未充分探索的视角。

🔬 方法详解

问题定义:论文旨在解决用户交互场景下,强制LLM Agent进行思考是否总能提升性能的问题。现有方法通常认为,通过思考提示可以提高LLM在复杂任务中的表现,但忽略了用户交互场景的特殊性,即Agent需要与用户进行有效的信息交换。强制思考可能导致Agent过度关注自身推理过程,而忽略了向用户提供足够的信息,从而影响用户理解和任务完成。

核心思路:论文的核心思路是,强制思考可能使Agent变得“内向”,减少信息披露,从而削弱Agent与用户之间的信息交换。因此,需要研究思考提示对Agent信息披露行为的影响,并探索如何通过主动透明性来优化Agent的性能。

技术框架:论文采用实验研究的方法,主要包含以下几个阶段:1) 选择多个LLM模型和基准测试数据集;2) 设计不同的思考实例化方式(例如,强制Agent在回答问题前进行思考);3) 通过定量响应分类分析和定性失败传播案例研究,评估思考提示对Agent性能和信息披露行为的影响;4) 探索通过显式提示信息披露来改善Agent性能的方法。

关键创新:论文最重要的技术创新点在于,发现了强制思考可能导致LLM Agent在用户交互场景下性能下降的现象,并提出了“内向性”的概念来解释这一现象。此外,论文还强调了信息透明度在Agent设计中的重要性,并提出了通过显式提示信息披露来改善Agent性能的方法。

关键设计:论文的关键设计包括:1) 选择了多个具有代表性的LLM模型,以保证研究结果的泛化性;2) 设计了多种思考实例化方式,以探索不同思考提示策略的影响;3) 采用了定量和定性相结合的评估方法,以全面分析思考提示对Agent性能和行为的影响;4) 通过实验验证了显式提示信息披露能够有效提高Agent在用户交互场景下的性能。

🖼️ 关键图片

📊 实验亮点

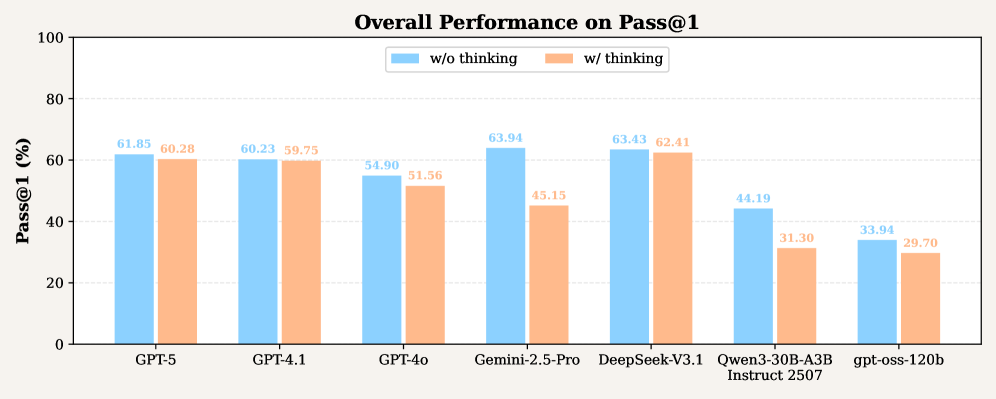

实验结果表明,强制思考通常会导致LLM Agent在用户交互场景下性能下降。例如,在某些基准测试中,强制思考使Agent的准确率下降了5-10%。然而,通过显式提示信息披露,可以显著提高Agent的性能,使其在某些任务上的准确率提升高达15%。这些结果表明,信息透明度是优化用户交互型LLM Agent的关键。

🎯 应用场景

该研究成果可应用于智能客服、虚拟助手、教育辅导等需要与用户进行交互的LLM Agent设计。通过理解思考提示对Agent信息披露行为的影响,可以设计更有效的Agent交互策略,提高用户满意度和任务完成效率。未来的研究可以进一步探索如何平衡Agent的思考深度和信息透明度,以实现最佳的用户交互体验。

📄 摘要(原文)

Eliciting reasoning has emerged as a powerful technique for improving the performance of large language models (LLMs) on complex tasks by inducing thinking. However, their effectiveness in realistic user-engaged agent scenarios remains unclear. In this paper, we conduct a comprehensive study on the effect of explicit thinking in user-engaged LLM agents. Our experiments span across seven models, three benchmarks, and two thinking instantiations, and we evaluate them through both a quantitative response taxonomy analysis and qualitative failure propagation case studies. Contrary to expectations, we find that mandatory thinking often backfires on agents in user-engaged settings, causing anomalous performance degradation across various LLMs. Our key finding reveals that thinking makes agents more ``introverted'' by shortening responses and reducing information disclosure to users, which weakens agent-user information exchange and leads to downstream task failures. Furthermore, we demonstrate that explicitly prompting for information disclosure reliably improves performance across diverse model families, suggesting that proactive transparency is a vital lever for agent optimization. Overall, our study suggests that information transparency awareness is a crucial yet underexplored perspective for the future design of reasoning agents in real-world scenarios. Our code is available at https://github.com/deeplearning-wisc/Thinking-Agent.