Let's Simplify Step by Step: Guiding LLM Towards Multilingual Unsupervised Proficiency-Controlled Sentence Simplification

作者: Jingshen Zhang, Xin Ying Qiu, Lifang Lu, Zhuhua Huang, Yutao Hu, Yuechang Wu, JunYu Lu

分类: cs.CL

发布日期: 2026-02-07

备注: Accepted to EACL 2026 Findings

💡 一句话要点

提出基于动态路径规划的逐步简化框架,提升大语言模型在多语言无监督可控句子简化任务上的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 句子简化 大型语言模型 无监督学习 多语言处理 动态路径规划

📋 核心要点

- 现有大语言模型在跨越较大可读性等级进行句子简化时,可控性较差,难以保证简化效果。

- 提出一种基于动态路径规划的逐步简化框架,将复杂简化分解为多个易于管理的步骤,提升简化效果。

- 实验结果表明,该方法在提高简化效果的同时,还能有效减少计算步骤,但在语义保持方面仍面临挑战。

📝 摘要(中文)

大型语言模型在可控句子简化方面表现出有限的能力,尤其是在跨越较大可读性等级进行简化时。本文提出了一个框架,通过动态路径规划、语义感知范例选择以及带有对话历史的链式思考生成,将复杂的简化分解为可管理的步骤,以实现连贯的推理。在五个语种和两个基准数据集上的评估表明,该方法提高了简化效果,同时减少了22-42%的计算步骤。人工评估证实了简化效果和语义保持之间的根本权衡。值得注意的是,即使是人工标注者也很难在语义保持判断上达成一致,突显了这项任务的内在复杂性。研究表明,虽然逐步简化提高了控制能力,但在广泛简化过程中保持语义保真度仍然是一个开放的挑战。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在多语言环境下,进行无监督且可控的句子简化任务时面临的挑战。现有方法难以在保证简化效果的同时,维持句子的语义信息,尤其是在需要大幅度降低可读性等级的情况下。此外,现有方法通常计算成本较高。

核心思路:论文的核心思路是将复杂的句子简化过程分解为多个更小的、易于管理的步骤。通过逐步简化,模型可以更好地控制简化过程,并在每一步都保持语义的连贯性。这种逐步简化的策略借鉴了人类逐步解决问题的思维方式。

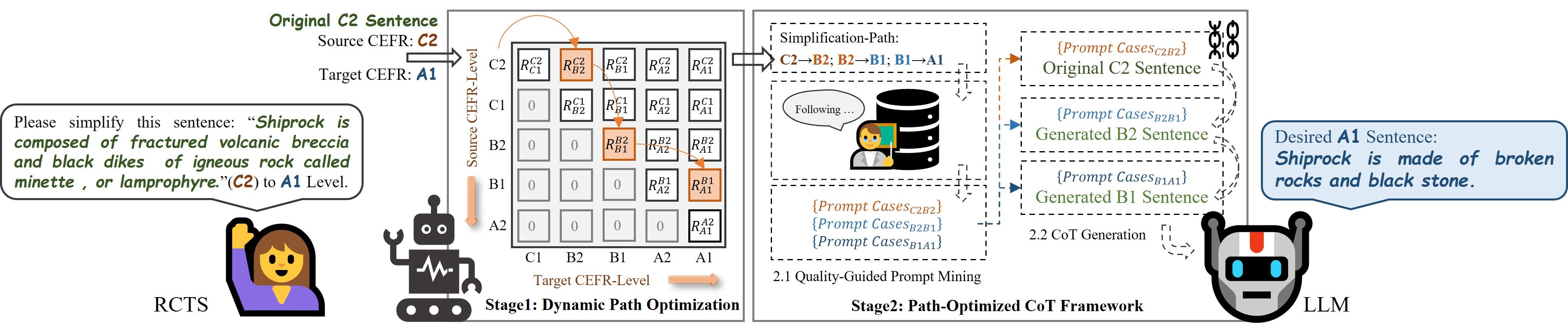

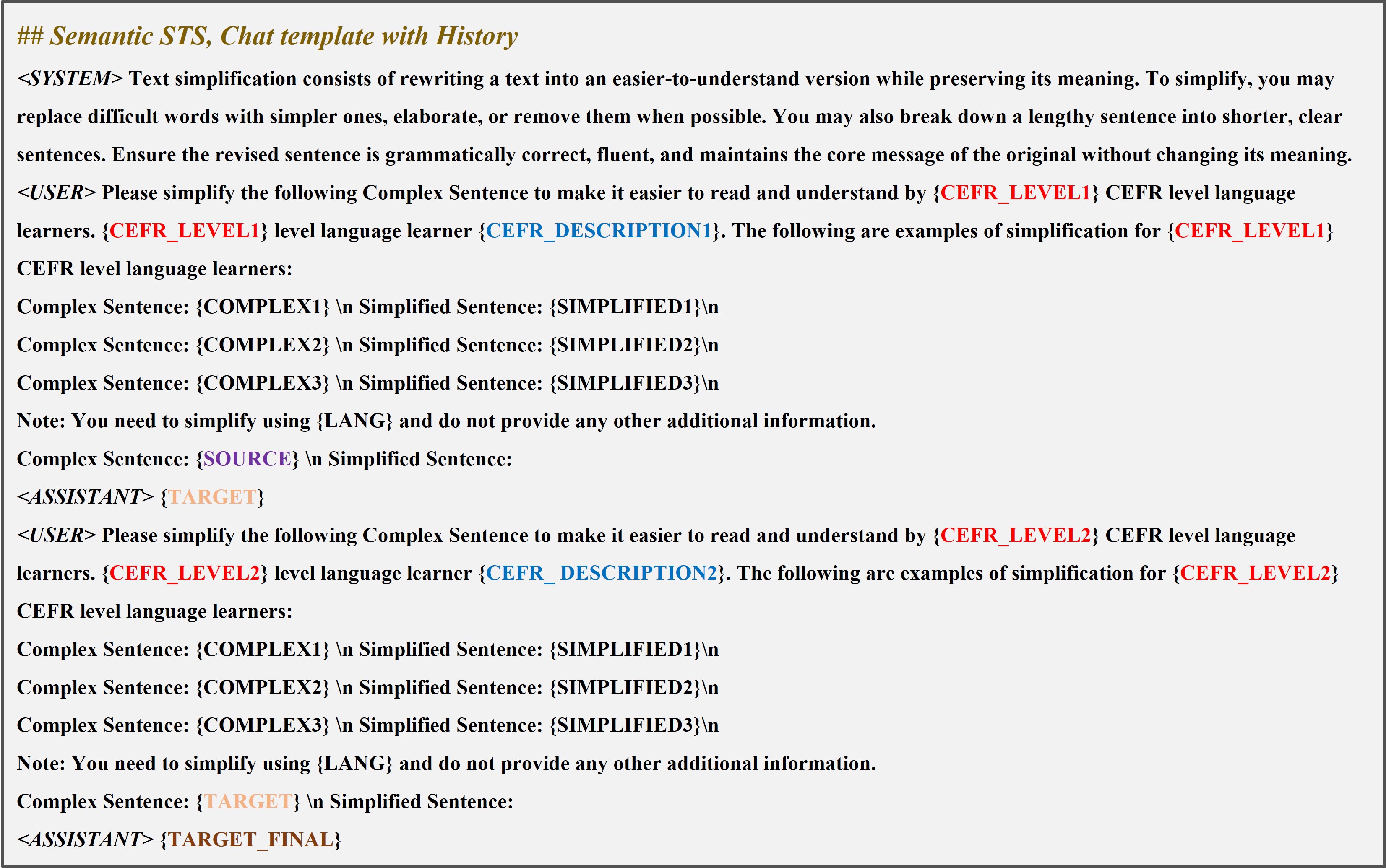

技术框架:该框架主要包含三个核心模块:动态路径规划、语义感知范例选择和链式思考生成。动态路径规划负责确定句子简化的步骤和顺序;语义感知范例选择用于选择与当前句子语义相关的范例,以指导简化过程;链式思考生成则利用对话历史进行连贯推理,生成简化后的句子。

关键创新:该方法最重要的创新点在于将复杂的句子简化任务分解为多个步骤,并通过动态路径规划来控制这些步骤。这种逐步简化的策略使得模型能够更好地平衡简化效果和语义保持,从而提高整体的简化性能。此外,语义感知范例选择和链式思考生成也有助于提高简化过程的连贯性和准确性。

关键设计:动态路径规划模块使用强化学习来学习最佳的简化路径。语义感知范例选择模块使用预训练的语言模型来计算句子之间的语义相似度。链式思考生成模块利用Transformer架构,并结合对话历史来生成简化后的句子。损失函数包括简化损失、语义保持损失和流畅性损失,以确保简化后的句子既简单易懂,又保持原有的语义信息,并且流畅自然。

🖼️ 关键图片

📊 实验亮点

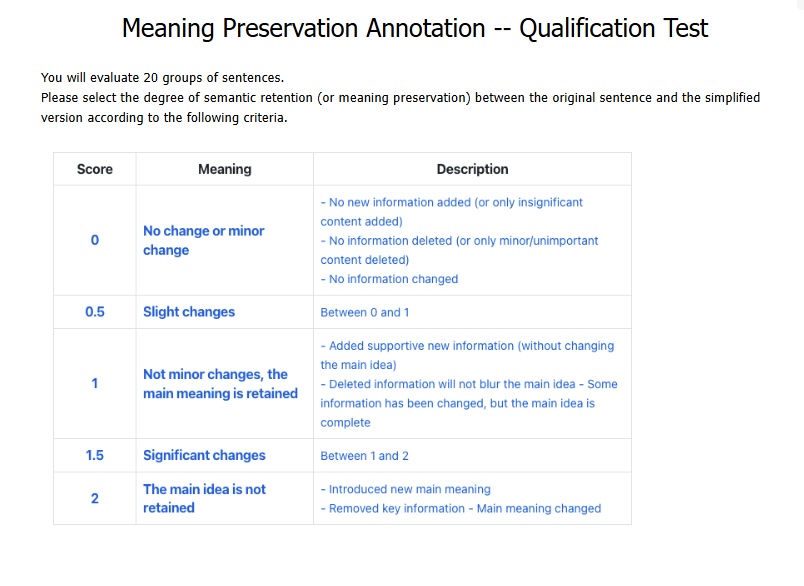

实验结果表明,该方法在五个语种和两个基准数据集上均取得了显著的性能提升。与现有方法相比,该方法在提高简化效果的同时,还能减少22-42%的计算步骤。人工评估也证实了该方法在简化效果和语义保持之间的良好平衡。虽然人工评估结果显示语义保持仍有提升空间,但该研究突出了逐步简化策略的有效性。

🎯 应用场景

该研究成果可应用于机器翻译、文本摘要、教育辅助等领域。例如,可以用于简化新闻报道,使其更容易被不同文化背景的人理解;也可以用于生成适合儿童阅读的文本;还可以辅助语言学习者理解复杂的句子结构。未来,该技术有望在人机交互、信息检索等领域发挥更大的作用。

📄 摘要(原文)

Large language models demonstrate limited capability in proficiency-controlled sentence simplification, particularly when simplifying across large readability levels. We propose a framework that decomposes complex simplifications into manageable steps through dynamic path planning, semantic-aware exemplar selection, and chain-of-thought generation with conversation history for coherent reasoning. Evaluation on five languages across two benchmarks shows our approach improves simplification effectiveness while reducing computational steps by 22-42%. Human evaluation confirms the fundamental trade-off between simplification effectiveness and meaning preservation. Notably, even human annotators struggle to agree on semantic preservation judgments, highlighting the inherent complexity of this task. Our work shows that while step-by-step simplification improves control, preserving semantic fidelity during extensive simplification remains an open challenge.