Massive Sound Embedding Benchmark (MSEB)

作者: Georg Heigold, Ehsan Variani, Tom Bagby, Cyril Allauzen, Ji Ma, Shankar Kumar, Michael Riley

分类: cs.SD, cs.CL

发布日期: 2026-02-06

💡 一句话要点

提出大规模声音嵌入基准MSEB,用于评估多模态系统中音频理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 声音嵌入 音频理解 多模态学习 基准测试 数据集 机器听觉 语音识别 深度学习

📋 核心要点

- 现有方法在处理复杂音频理解任务时,缺乏统一的评估标准和多样化的数据集。

- MSEB通过提供一个可扩展的基准框架,包含多个核心任务和数据集,来评估多模态系统的音频理解能力。

- 初步实验表明,现有模型在MSEB基准上仍有显著的性能提升空间,为未来的研究提供了方向。

📝 摘要(中文)

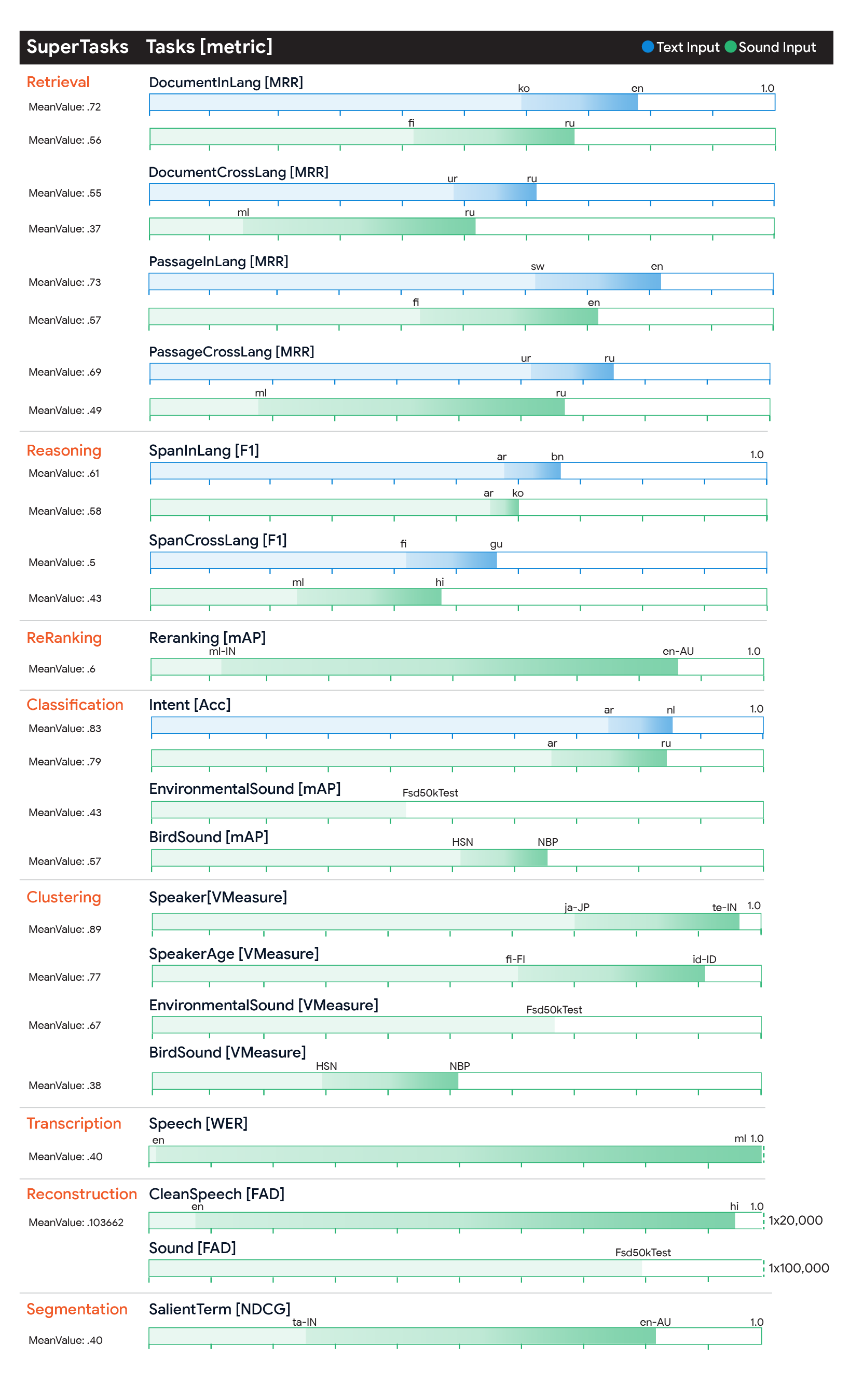

音频是多模态感知的一个关键组成部分,任何真正智能的系统都必须展示广泛的听觉能力。这些能力包括转录、分类、检索、推理、分割、聚类、重排序和重建。从根本上说,每个任务都涉及将原始音频信号转换为有意义的“嵌入”——无论是单个向量、连续或离散表示的序列,还是其他结构化形式——然后作为生成任务最终响应的基础。为了加速在鲁棒的机器听觉智能方面的进展,我们提出了大规模声音嵌入基准(MSEB):一个可扩展的框架,旨在评估任何多模态系统的听觉组件。在第一个版本中,MSEB提供了一套全面的八个核心任务,未来计划增加更多任务,并由多样化的数据集支持,包括新的大规模Simple Voice Questions(SVQ)数据集。我们的初步实验建立了清晰的性能提升空间,突出了改进音频作为核心信号的真实世界多模态体验的重大机会。我们鼓励研究界使用MSEB来评估他们的算法并为其发展做出贡献。该库公开托管在github上。

🔬 方法详解

问题定义:论文旨在解决缺乏统一和全面的音频理解评估基准的问题。现有方法在评估音频嵌入的质量和泛化能力时,往往依赖于特定的任务和数据集,难以进行公平的比较和全面的分析。此外,真实世界的多模态应用需要系统具备广泛的听觉能力,而现有的评估方法难以覆盖这些能力。

核心思路:论文的核心思路是构建一个大规模、可扩展的声音嵌入基准(MSEB),该基准包含多个核心的音频理解任务,并提供多样化的数据集,从而能够全面评估音频嵌入的质量和泛化能力。通过提供统一的评估标准,MSEB旨在促进音频理解领域的研究进展,并推动多模态系统的发展。

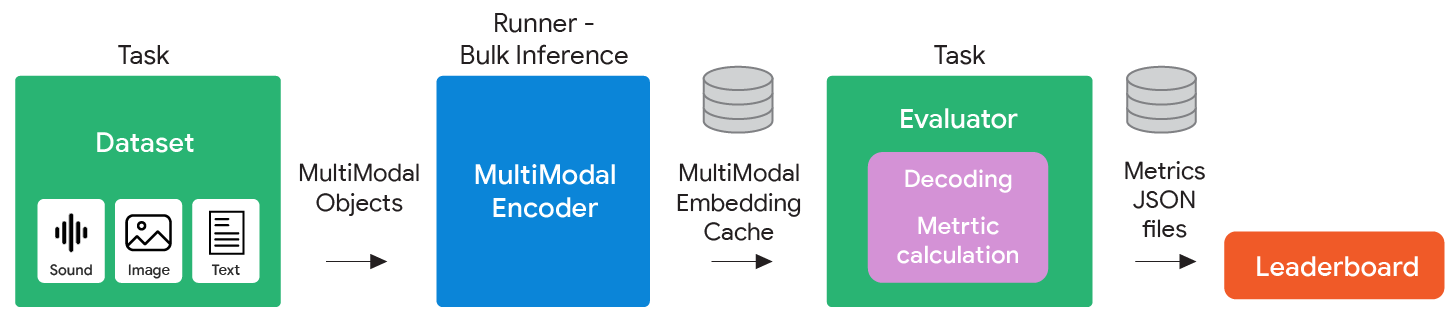

技术框架:MSEB的技术框架主要包括以下几个部分:1)核心任务:定义了一系列核心的音频理解任务,例如转录、分类、检索等。2)数据集:提供了多样化的数据集,包括现有的公开数据集和新构建的大规模SVQ数据集。3)评估指标:为每个任务定义了相应的评估指标,用于衡量音频嵌入的性能。4)可扩展性:MSEB设计为可扩展的框架,可以方便地添加新的任务和数据集。

关键创新:MSEB的关键创新在于其提供了一个统一、全面、可扩展的音频理解评估基准。与现有的评估方法相比,MSEB能够更全面地评估音频嵌入的质量和泛化能力,并促进不同方法之间的公平比较。此外,MSEB的新构建的SVQ数据集为研究人员提供了更多的数据资源。

关键设计:MSEB的关键设计包括:1)任务选择:选择了涵盖广泛听觉能力的核心任务。2)数据集构建:构建了大规模的SVQ数据集,并整合了现有的公开数据集。3)评估指标选择:为每个任务选择了合适的评估指标,以准确衡量音频嵌入的性能。4)框架设计:设计了可扩展的框架,方便添加新的任务和数据集。

🖼️ 关键图片

📊 实验亮点

论文构建了包含八个核心任务的MSEB基准,并使用该基准评估了现有模型的性能。实验结果表明,现有模型在各个任务上均存在显著的性能提升空间,尤其是在新构建的SVQ数据集上。这表明MSEB能够有效地评估音频嵌入的质量,并为未来的研究提供了明确的方向。

🎯 应用场景

该研究成果可广泛应用于多模态人工智能系统,例如智能助手、语音搜索、视频分析、自动驾驶等领域。通过提升音频理解能力,可以改善人机交互体验,提高信息检索效率,增强环境感知能力,并为未来的智能系统发展奠定基础。

📄 摘要(原文)

Audio is a critical component of multimodal perception, and any truly intelligent system must demonstrate a wide range of auditory capabilities. These capabilities include transcription, classification, retrieval, reasoning, segmentation, clustering, reranking, and reconstruction. Fundamentally, each task involves transforming a raw audio signal into a meaningful 'embedding' - be it a single vector, a sequence of continuous or discrete representations, or another structured form - which then serves as the basis for generating the task's final response. To accelerate progress towards robust machine auditory intelligence, we present the Massive Sound Embedding Benchmark (MSEB): an extensible framework designed to evaluate the auditory components of any multimodal system. In its first release, MSEB offers a comprehensive suite of eight core tasks, with more planned for the future, supported by diverse datasets, including the new, large-scale Simple Voice Questions (SVQ) dataset. Our initial experiments establish clear performance headrooms, highlighting the significant opportunity to improve real-world multimodal experiences where audio is a core signal. We encourage the research community to use MSEB to assess their algorithms and contribute to its growth. The library is publicly hosted at github.