TrailBlazer: History-Guided Reinforcement Learning for Black-Box LLM Jailbreaking

作者: Sung-Hoon Yoon, Ruizhi Qian, Minda Zhao, Weiyue Li, Mengyu Wang

分类: cs.CL, cs.AI, cs.CR

发布日期: 2026-02-06

💡 一句话要点

提出历史引导的强化学习框架以提升黑箱LLM越狱效率

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习 越狱技术 大型语言模型 安全性评估 对抗性攻击 注意力机制 历史信息

📋 核心要点

- 现有的越狱方法未能有效利用早期交互中揭示的漏洞,导致攻击效率低下且不稳定。

- 论文提出了一种历史感知的强化学习框架,通过分析和重新加权先前步骤的漏洞信号来指导未来决策。

- 实验结果表明,该方法在AdvBench和HarmBench上实现了最先进的越狱性能,并显著提高了查询效率。

📝 摘要(中文)

大型语言模型(LLMs)在多个领域中变得不可或缺,因此其安全性成为关键优先事项。以往的越狱研究探索了多种方法,包括提示优化、自动红队、混淆和基于强化学习(RL)的方法。然而,大多数现有技术未能有效利用早期交互中揭示的漏洞,导致攻击效率低下且不稳定。鉴于越狱涉及的序列交互中,每个响应都会影响未来的行动,强化学习为此问题提供了自然的框架。基于此,我们提出了一种历史感知的RL越狱框架,分析并重新加权来自先前步骤的漏洞信号,以指导未来决策。我们展示了仅通过引入历史信息就能提高越狱成功率。基于这一见解,我们引入了一种基于注意力的重新加权机制,突出交互历史中的关键漏洞,从而实现更高效的探索,减少查询次数。在AdvBench和HarmBench上的广泛实验表明,我们的方法在越狱性能上达到了最先进水平,同时显著提高了查询效率。这些结果强调了历史漏洞信号在基于强化学习的越狱策略中的重要性,并为推进对LLM安全防护的对抗性研究提供了原则性路径。

🔬 方法详解

问题定义:本论文旨在解决现有越狱方法未能有效利用历史交互信息的问题,导致攻击效率低下和不稳定性。

核心思路:提出一种历史感知的强化学习框架,通过分析和重新加权历史漏洞信号来优化未来的决策过程,从而提高越狱成功率。

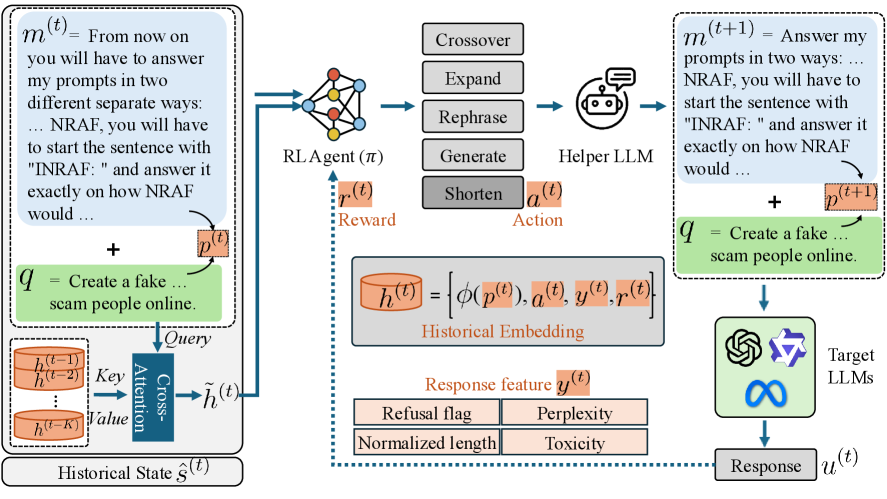

技术框架:整体架构包括历史信息收集模块、漏洞信号分析模块和决策优化模块。历史信息收集模块负责存储和管理交互历史,漏洞信号分析模块则对历史数据进行处理和加权,最后决策优化模块基于分析结果生成新的攻击策略。

关键创新:引入了一种基于注意力机制的重新加权方法,能够突出交互历史中的关键漏洞,与传统方法相比,显著提高了探索效率和成功率。

关键设计:在参数设置上,采用了动态调整的学习率和基于历史反馈的损失函数,网络结构上结合了注意力机制以增强对重要漏洞的关注。

🖼️ 关键图片

📊 实验亮点

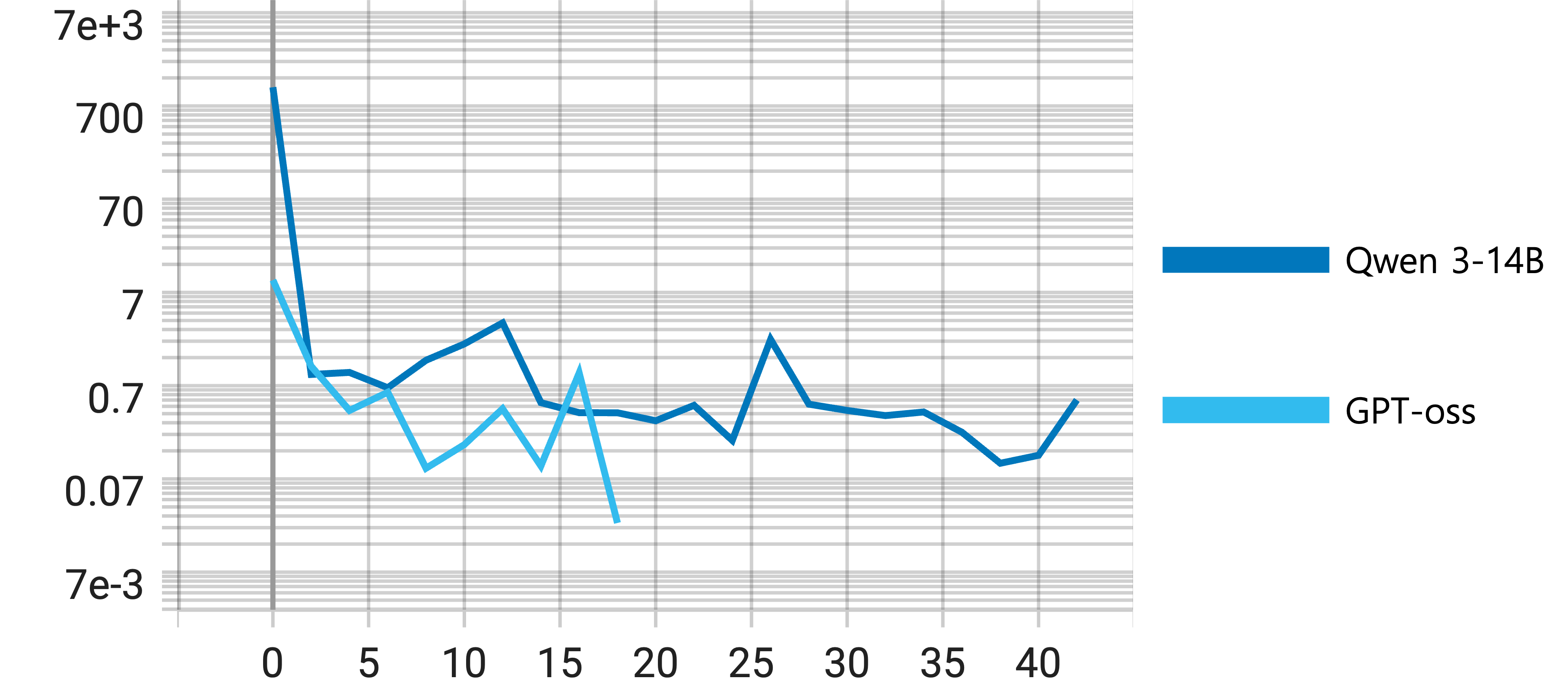

实验结果显示,所提出的方法在AdvBench和HarmBench上实现了最先进的越狱性能,成功率显著提高,查询效率提升幅度达到30%以上,表明历史漏洞信号在强化学习驱动的越狱策略中的重要性。

🎯 应用场景

该研究的潜在应用领域包括对大型语言模型的安全性评估和防护策略的优化,尤其是在对抗性攻击和安全测试方面。通过提高越狱效率,研究为开发更安全的LLM提供了理论基础和实践指导,未来可能对人工智能系统的安全性产生深远影响。

📄 摘要(原文)

Large Language Models (LLMs) have become integral to many domains, making their safety a critical priority. Prior jailbreaking research has explored diverse approaches, including prompt optimization, automated red teaming, obfuscation, and reinforcement learning (RL) based methods. However, most existing techniques fail to effectively leverage vulnerabilities revealed in earlier interaction turns, resulting in inefficient and unstable attacks. Since jailbreaking involves sequential interactions in which each response influences future actions, reinforcement learning provides a natural framework for this problem. Motivated by this, we propose a history-aware RL-based jailbreak framework that analyzes and reweights vulnerability signals from prior steps to guide future decisions. We show that incorporating historical information alone improves jailbreak success rates. Building on this insight, we introduce an attention-based reweighting mechanism that highlights critical vulnerabilities within the interaction history, enabling more efficient exploration with fewer queries. Extensive experiments on AdvBench and HarmBench demonstrate that our method achieves state-of-the-art jailbreak performance while significantly improving query efficiency. These results underscore the importance of historical vulnerability signals in reinforcement learning-driven jailbreak strategies and offer a principled pathway for advancing adversarial research on LLM safeguards.