FMBench: Adaptive Large Language Model Output Formatting

作者: Yaoting Wang, Yun Zhou, Henghui Ding

分类: cs.CL

发布日期: 2026-02-06

🔗 代码/项目: GITHUB

💡 一句话要点

FMBench:自适应大语言模型Markdown格式化输出评测与优化

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 Markdown格式化 指令遵循 监督微调 强化学习 基准测试 格式对齐

📋 核心要点

- 现有大语言模型在生成Markdown格式输出时,容易出现格式错误,影响下游可用性,例如列表错误、表格错误、标题不一致和代码块无效。

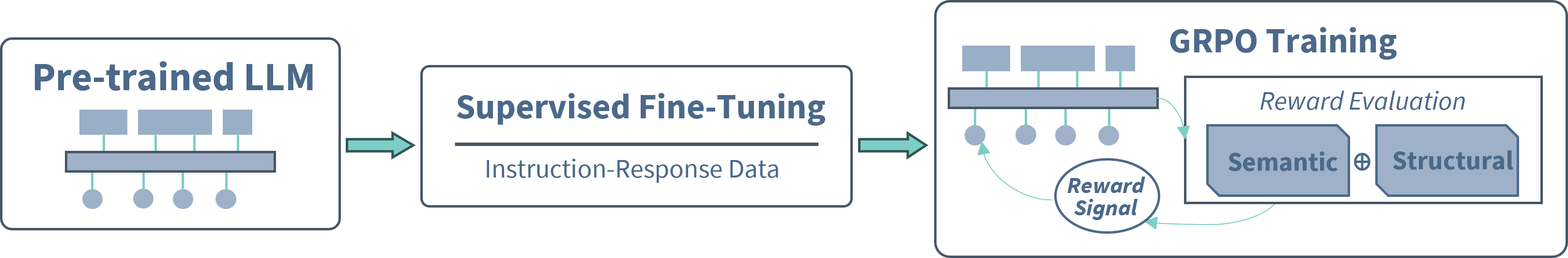

- 论文提出一种轻量级的对齐流程,结合监督微调(SFT)和强化学习微调,以提高Markdown兼容性,同时保持语义的准确性。

- 实验结果表明,SFT可以持续改进语义对齐,而强化学习可以进一步提高模型对复杂Markdown指令的鲁棒性,但需要仔细设计奖励函数。

📝 摘要(中文)

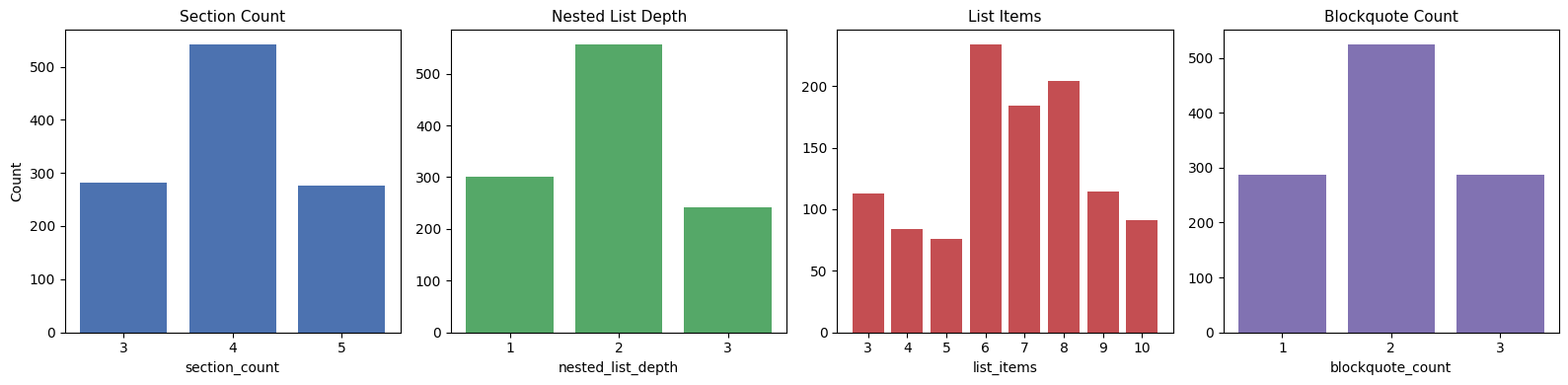

本文提出FMBench,一个用于评估大语言模型自适应Markdown输出格式化的基准。该基准涵盖了广泛的指令遵循场景和多样化的结构要求,强调真实世界的格式化行为,如多级组织、混合内容(自然语言与列表/表格/代码交织)以及严格遵守用户指定的布局约束。为了在不依赖硬解码约束的情况下提高Markdown兼容性,本文提出了一种轻量级的对齐流程,该流程结合了监督微调(SFT)和强化学习微调。实验表明,SFT能够持续改进语义对齐,而强化学习在从强大的SFT策略初始化后,能够进一步提高模型对具有挑战性的Markdown指令的鲁棒性。研究结果还揭示了语义和结构目标之间固有的权衡,突出了精心设计的奖励对于可靠的格式化生成的重要性。

🔬 方法详解

问题定义:论文旨在解决大语言模型在生成Markdown格式文本时,难以同时满足语义意图和格式约束的问题。现有方法通常依赖硬解码约束,限制了生成的多样性,并且难以处理复杂的格式要求。此外,即使是细微的格式错误,也会严重影响下游应用,例如文档生成、助手工具和代码生成等。

核心思路:论文的核心思路是利用监督微调(SFT)来对齐语义意图,然后使用强化学习微调来优化Markdown格式的正确性。通过结合两种微调方法,可以在不牺牲语义准确性的前提下,提高模型的格式化能力。这种方法避免了硬解码约束,允许模型生成更灵活和自然的Markdown文本。

技术框架:整体框架包含两个主要阶段:首先,使用监督微调(SFT)在指令-响应对上训练模型,使其能够理解用户的意图并生成相应的文本。然后,使用强化学习微调,以SFT训练的模型为基础,优化一个复合目标函数,该函数平衡了语义保真度和结构正确性。强化学习的目标是最大化奖励函数,该奖励函数基于生成的Markdown文本的格式正确性和语义相关性。

关键创新:论文的关键创新在于提出了一种轻量级的对齐流程,将监督微调和强化学习微调相结合,用于优化大语言模型的Markdown格式化输出。这种方法能够在不依赖硬解码约束的情况下,提高模型的格式化能力,并且能够处理复杂的格式要求。此外,论文还提出了FMBench基准,用于评估模型的Markdown格式化能力。

关键设计:在强化学习阶段,奖励函数的设计至关重要。论文设计了一个复合奖励函数,该函数包含两部分:一部分是基于语义相似度的奖励,用于衡量生成文本与用户意图的相关性;另一部分是基于格式正确性的奖励,用于衡量生成的Markdown文本的格式是否正确。为了平衡语义和结构目标,需要仔细调整两部分奖励的权重。此外,论文还使用了PPO算法进行强化学习微调。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SFT能够持续改进语义对齐,而强化学习在从强大的SFT策略初始化后,能够进一步提高模型对具有挑战性的Markdown指令的鲁棒性。在OpenPangu和Qwen两个模型家族上的实验都验证了该方法的有效性。研究还揭示了语义和结构目标之间存在权衡,强调了精心设计的奖励函数的重要性。

🎯 应用场景

该研究成果可应用于各种需要生成Markdown格式文本的场景,例如智能助手、文档生成、代码生成和自动化报告等。通过提高大语言模型的Markdown格式化能力,可以显著提升这些应用的可用性和用户体验。此外,该研究还可以促进大语言模型在更多实际场景中的应用。

📄 摘要(原文)

Producing outputs that satisfy both semantic intent and format constraints is essential for deploying large language models in user-facing and system-integrated workflows. In this work, we focus on Markdown formatting, which is ubiquitous in assistants, documentation, and tool-augmented pipelines but still prone to subtle, hard-to-detect errors (e.g., broken lists, malformed tables, inconsistent headings, and invalid code blocks) that can significantly degrade downstream usability. We present FMBench, a benchmark for adaptive Markdown output formatting that evaluates models under a wide range of instruction-following scenarios with diverse structural requirements. FMBench emphasizes real-world formatting behaviors such as multi-level organization, mixed content (natural language interleaved with lists/tables/code), and strict adherence to user-specified layout constraints. To improve Markdown compliance without relying on hard decoding constraints, we propose a lightweight alignment pipeline that combines supervised fine-tuning (SFT) with reinforcement learning fine-tuning. Starting from a base model, we first perform SFT on instruction-response pairs, and then optimize a composite objective that balances semantic fidelity with structural correctness. Experiments on two model families (OpenPangu and Qwen) show that SFT consistently improves semantic alignment, while reinforcement learning provides additional gains in robustness to challenging Markdown instructions when initialized from a strong SFT policy. Our results also reveal an inherent trade-off between semantic and structural objectives, highlighting the importance of carefully designed rewards for reliable formatted generation. Code is available at: https://github.com/FudanCVL/FMBench.