Codified Finite-state Machines for Role-playing

作者: Letian Peng, Yupeng Hou, Kun Zhou, Jingbo Shang

分类: cs.CL

发布日期: 2026-02-05

💡 一句话要点

提出Codified有限状态机,提升LLM角色扮演的连贯性和可控性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 角色扮演 有限状态机 大型语言模型 状态建模 概率模型

📋 核心要点

- 现有角色扮演方法难以追踪潜在状态,导致角色行为缺乏一致性。

- CFSMs框架利用LLM将角色配置文件编码为有限状态机,提取关键状态和转换。

- 实验表明,CFSMs和CPFSMs在角色扮演任务中优于现有基线方法。

📝 摘要(中文)

本文提出Codified有限状态机(CFSMs)框架,旨在提升大型语言模型(LLMs)在角色扮演(RP)中的表现。现有基于提示的方法主要关注表面行为,难以追踪驱动交互的潜在状态。CFSMs通过LLM自动将文本角色配置文件编码为有限状态机,直接从配置文件中提取关键状态和转换,生成可解释的结构以保证角色一致性。进一步,扩展为Codified概率有限状态机(CPFSMs),将状态转换建模为概率分布,以捕捉不确定性和可变性。合成评估和真实角色扮演场景实验表明,CFSM和CPFSM优于通用基线方法,验证了其在结构化任务和开放式随机状态探索中的有效性。

🔬 方法详解

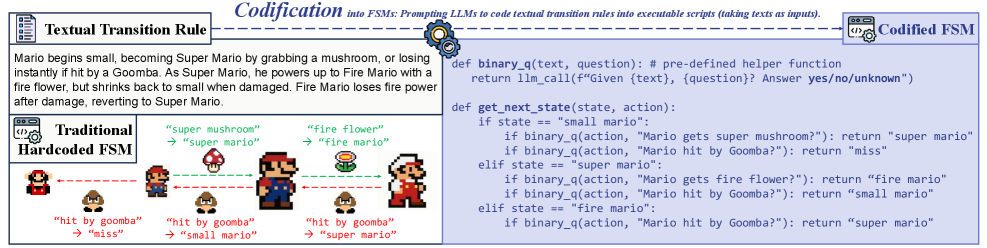

问题定义:现有基于LLM的角色扮演方法主要依赖于prompt工程,关注角色的表面行为,缺乏对角色内在状态的建模。这导致角色行为前后不一致,难以进行复杂和长期的角色扮演。传统的手工设计的有限状态机(FSMs)虽然可以建模状态转换,但难以适应开放域的角色扮演场景。

核心思路:本文的核心思路是利用LLM的编码能力,自动将角色配置文件转化为有限状态机(FSM)。通过这种方式,可以将角色的内在状态显式地建模出来,并利用FSM来约束角色的行为,从而保证角色扮演的一致性。同时,为了应对角色扮演中的不确定性,进一步提出了概率有限状态机(PFSM)。

技术框架:CFSMs框架包含以下几个主要步骤:1) 角色配置文件输入:输入角色的文本描述文件。2) LLM编码:利用LLM从角色配置文件中提取关键状态和状态之间的转换关系。3) 构建FSM:基于提取的状态和转换关系,构建有限状态机。4) 角色扮演:在角色扮演过程中,根据当前状态和FSM的转换规则,生成角色的行为。CPFSMs在CFSMs的基础上,将状态转换建模为概率分布。

关键创新:最重要的创新点在于利用LLM自动构建有限状态机,从而将角色的内在状态显式地建模出来。这与传统的手工设计FSM的方法相比,大大提高了FSM的构建效率和适应性。此外,CPFSMs通过引入概率模型,更好地处理了角色扮演中的不确定性。

关键设计:在利用LLM进行编码时,需要设计合适的prompt,以引导LLM提取出关键的状态和转换关系。在CPFSMs中,需要选择合适的概率分布来建模状态转换。具体的参数设置和网络结构取决于所使用的LLM和角色扮演任务。

🖼️ 关键图片

📊 实验亮点

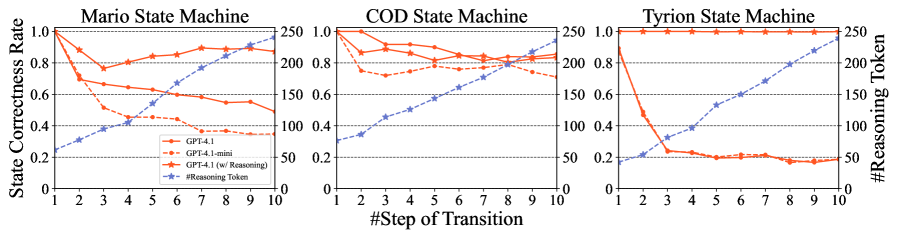

实验结果表明,CFSM和CPFSM在合成评估和真实角色扮演场景中均优于通用基线方法。具体而言,在结构化任务中,CFSM和CPFSM能够更准确地追踪角色的状态。在开放式随机状态探索中,CFSM和CPFSM能够生成更加多样化和有趣的角色行为。性能提升幅度取决于具体的任务和数据集,但总体而言,CFSM和CPFSM都表现出了显著的优势。

🎯 应用场景

该研究成果可应用于各种需要角色扮演的场景,例如游戏开发、虚拟助手、教育培训等。通过CFSMs和CPFSMs,可以创建更加智能、连贯和可控的角色,提升用户体验。未来,可以进一步探索如何将CFSMs和CPFSMs与其他技术相结合,例如知识图谱、强化学习等,以实现更加复杂和高级的角色扮演。

📄 摘要(原文)

Modeling latent character states is crucial for consistent and engaging role-playing (RP) with large language models (LLMs). Yet, existing prompting-based approaches mainly capture surface actions, often failing to track the latent states that drive interaction. We revisit finite-state machines (FSMs), long used in game design to model state transitions. While effective in small, well-specified state spaces, traditional hand-crafted, rule-based FSMs struggle to adapt to the open-ended semantic space of RP. To address this, we introduce Codified Finite-State Machines (CFSMs), a framework that automatically codifies textual character profiles into FSMs using LLM-based coding. CFSMs extract key states and transitions directly from the profile, producing interpretable structures that enforce character consistency. To further capture uncertainty and variability, we extend CFSMs into Codified Probabilistic Finite-State Machines (CPFSMs), where transitions are modeled as probability distributions over states. Through both synthetic evaluations and real-world RP scenarios in established artifacts, we demonstrate that CFSM and CPFSM outperform generally applied baselines, verifying effectiveness not only in structured tasks but also in open-ended stochastic state exploration.