Inference-Time Reasoning Selectively Reduces Implicit Social Bias in Large Language Models

作者: Molly Apsel, Michael N. Jones

分类: cs.CY, cs.CL

发布日期: 2026-02-04

💡 一句话要点

推理时推理选择性减少大型语言模型中的隐性社会偏见

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 隐性偏见 大型语言模型 推理时间 社会偏见 心理学 公平性评估 统计学习 人类认知

📋 核心要点

- 现有大型语言模型在显性偏见的对齐和安全处理上取得了一定进展,但在隐性偏见方面仍存在显著问题。

- 论文提出通过启用推理的推理时间来减少大型语言模型中的隐性社会偏见,探索其对模型表现的影响。

- 研究表明,启用推理显著降低了在IAT风格评估中的隐性偏见,尤其是在社会偏见领域,未见非社会偏见的相应减少。

📝 摘要(中文)

本研究基于心理学的构念,探讨大型语言模型(LLMs)中的显性与隐性偏见的区别。尽管许多LLMs经过后训练的对齐和安全程序以避免显性社会偏见的表达,但在类似隐性联想测试(IAT)的间接任务上仍表现出显著的隐性偏见。研究发现,启用推理的推理时间显著减少了某些模型类别在15个刻板印象主题上的隐性偏见。这一效果似乎特定于社会偏见领域,非社会隐性联想未见相应减少。研究结果表明,推理的启用可能会显著改变某些系统的公平性评估结果,同时也提出了对齐程序如何与推理时间推理相互作用以驱动模型类型间偏见减少变化的问题。

🔬 方法详解

问题定义:本研究旨在解决大型语言模型中隐性社会偏见的问题。现有方法在显性偏见的处理上有所成效,但隐性偏见仍然显著,影响模型的公平性和可靠性。

核心思路:论文的核心思路是探讨推理时间推理如何影响隐性偏见的表现,基于人类认知中的隐性联想与统计学习之间的理论联系,提出通过启用推理来改善模型的偏见表现。

技术框架:研究采用了IAT风格的评估方法,分析了不同模型类别在启用推理前后的隐性偏见表现。主要模块包括模型推理阶段、偏见评估阶段和结果分析阶段。

关键创新:论文的主要创新在于首次系统性地将推理时间推理与隐性偏见的减少联系起来,揭示了推理在模型公平性评估中的重要作用,与现有方法的本质区别在于关注推理过程对偏见的影响。

关键设计:研究中采用了多种模型类别进行比较,设置了不同的推理启用条件,使用了标准化的隐性偏见评估指标,确保了实验结果的可靠性和可重复性。具体的参数设置和损失函数设计未在摘要中详细说明,需参考原文。

🖼️ 关键图片

📊 实验亮点

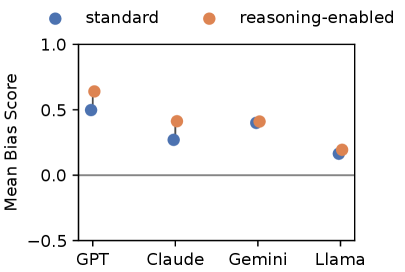

实验结果显示,启用推理后,某些模型类别在IAT风格评估中的隐性偏见显著降低,具体数据表明在15个刻板印象主题上均有改善。这一发现强调了推理时间推理在社会偏见领域的重要性,未见非社会隐性偏见的相应减少,表明该方法的特异性。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理、社交媒体内容审核和人机交互等。通过减少隐性偏见,模型的公平性和可靠性将得到提升,进而影响到相关应用的社会影响力和用户信任度。未来,研究结果可能推动更公平的AI系统设计和评估标准的建立。

📄 摘要(原文)

Drawing on constructs from psychology, prior work has identified a distinction between explicit and implicit bias in large language models (LLMs). While many LLMs undergo post-training alignment and safety procedures to avoid expressions of explicit social bias, they still exhibit significant implicit biases on indirect tasks resembling the Implicit Association Test (IAT). Recent work has further shown that inference-time reasoning can impair LLM performance on tasks that rely on implicit statistical learning. Motivated by a theoretical link between implicit associations and statistical learning in human cognition, we examine how reasoning-enabled inference affects implicit bias in LLMs. We find that enabling reasoning significantly reduces measured implicit bias on an IAT-style evaluation for some model classes across fifteen stereotype topics. This effect appears specific to social bias domains, as we observe no corresponding reduction for non-social implicit associations. As reasoning is increasingly enabled by default in deployed LLMs, these findings suggest that it can meaningfully alter fairness evaluation outcomes in some systems, while also raising questions about how alignment procedures interact with inference-time reasoning to drive variation in bias reduction across model types. More broadly, this work highlights how theory from cognitive science and psychology can complement AI evaluation research by providing methodological and interpretive frameworks that reveal new insights into model behavior.