How Few-shot Demonstrations Affect Prompt-based Defenses Against LLM Jailbreak Attacks

作者: Yanshu Wang, Shuaishuai Yang, Jingjing He, Tong Yang

分类: cs.CL, cs.AI, cs.CR

发布日期: 2026-02-04

备注: 13 pages, 4 figures, 6 tables

💡 一句话要点

探究Few-shot示例对Prompt防御LLM越狱攻击的影响,揭示RoP与ToP的差异。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 越狱攻击 Prompt防御 Few-shot学习 安全对齐

📋 核心要点

- 现有研究缺乏对Few-shot示例如何影响基于Prompt的LLM防御策略的深入理解,尤其是在不同类型的Prompt策略下。

- 该研究通过系统评估Few-shot示例与RoP和ToP两种Prompt策略的交互作用,揭示了它们对防御效果的相反影响。

- 实验结果表明,Few-shot示例能提升RoP的安全性,但会降低ToP的有效性,并据此提出了实际应用建议。

📝 摘要(中文)

大型语言模型(LLMs)面临越来越多的越狱攻击威胁,这些攻击旨在绕过安全对齐。虽然基于Prompt的防御方法,如面向角色的Prompt(RoP)和面向任务的Prompt(ToP)已显示出有效性,但Few-shot示例在这些防御策略中的作用仍不清楚。先前的工作表明,Few-shot示例可能会损害安全性,但缺乏对Few-shot与不同系统Prompt策略之间相互作用的调查。在本文中,我们使用六种越狱攻击方法,在四个安全基准(AdvBench、HarmBench、SG-Bench、XSTest)上对多个主流LLM进行了全面评估。我们的关键发现表明,Few-shot示例对RoP和ToP产生相反的影响:Few-shot通过加强角色身份,将RoP的安全率提高了高达4.5%,而通过分散对任务指令的注意力,将ToP的有效性降低了高达21.2%。基于这些发现,我们为在实际LLM应用中部署基于Prompt的防御提供了实用的建议。

🔬 方法详解

问题定义:该论文旨在解决大型语言模型(LLMs)在面对越狱攻击时,基于Prompt的防御策略(如RoP和ToP)受Few-shot示例影响程度不明确的问题。现有研究未能充分理解Few-shot示例与不同Prompt策略之间的复杂交互,导致防御效果不稳定,存在被绕过的风险。

核心思路:核心思路是通过系统性实验,探究Few-shot示例对RoP和ToP两种Prompt策略在防御越狱攻击时的影响。研究假设Few-shot示例会以不同的方式影响这两种策略,并通过实验验证这一假设,从而为实际应用提供指导。

技术框架:该研究的技术框架主要包括以下几个部分:1) 选择主流LLM作为实验对象;2) 采用多种越狱攻击方法;3) 使用四个安全基准(AdvBench、HarmBench、SG-Bench、XSTest)进行评估;4) 分别测试RoP和ToP在有无Few-shot示例情况下的防御效果;5) 分析实验结果,揭示Few-shot示例对两种Prompt策略的不同影响。

关键创新:该研究的关键创新在于揭示了Few-shot示例对RoP和ToP两种Prompt策略的相反影响。以往研究可能只关注Few-shot示例对安全性的整体影响,而该研究深入分析了不同Prompt策略下的差异,为更有效地利用Prompt进行防御提供了新的视角。

关键设计:关键设计包括:1) 精心设计的Few-shot示例,以确保其能够有效影响LLM的行为;2) 细致的实验参数控制,以排除其他因素的干扰;3) 采用多种评估指标,全面衡量防御效果;4) 对实验结果进行深入分析,以揭示Few-shot示例与Prompt策略之间的内在联系。

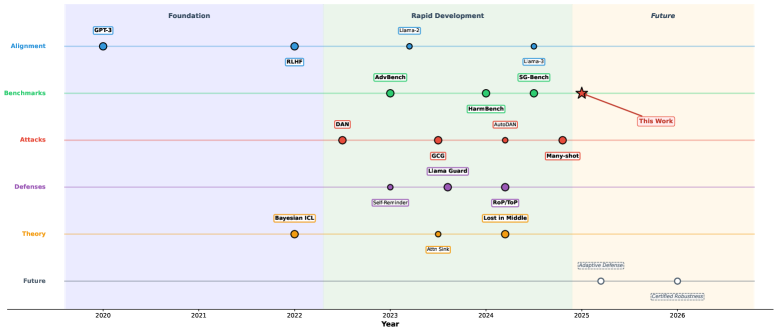

🖼️ 关键图片

📊 实验亮点

实验结果表明,Few-shot示例能够将RoP的安全率提高高达4.5%,这表明Few-shot示例可以通过强化角色身份来增强RoP的防御能力。然而,Few-shot示例会使ToP的有效性降低高达21.2%,这说明Few-shot示例可能会分散ToP对任务指令的注意力,从而削弱其防御效果。这些发现为实际应用中选择合适的Prompt策略提供了重要依据。

🎯 应用场景

该研究成果可应用于提升LLM在各种场景下的安全性,例如智能客服、内容生成、代码助手等。通过合理选择和配置Prompt策略,并结合对Few-shot示例影响的理解,可以有效防御恶意攻击,保障LLM的可靠性和安全性。未来的研究可以进一步探索更复杂的Prompt策略和攻击方法,以构建更强大的防御体系。

📄 摘要(原文)

Large Language Models (LLMs) face increasing threats from jailbreak attacks that bypass safety alignment. While prompt-based defenses such as Role-Oriented Prompts (RoP) and Task-Oriented Prompts (ToP) have shown effectiveness, the role of few-shot demonstrations in these defense strategies remains unclear. Prior work suggests that few-shot examples may compromise safety, but lacks investigation into how few-shot interacts with different system prompt strategies. In this paper, we conduct a comprehensive evaluation on multiple mainstream LLMs across four safety benchmarks (AdvBench, HarmBench, SG-Bench, XSTest) using six jailbreak attack methods. Our key finding reveals that few-shot demonstrations produce opposite effects on RoP and ToP: few-shot enhances RoP's safety rate by up to 4.5% through reinforcing role identity, while it degrades ToP's effectiveness by up to 21.2% through distracting attention from task instructions. Based on these findings, we provide practical recommendations for deploying prompt-based defenses in real-world LLM applications.