Contextual Drag: How Errors in the Context Affect LLM Reasoning

作者: Yun Cheng, Xingyu Zhu, Haoyu Zhao, Sanjeev Arora

分类: cs.CL, cs.AI, cs.LG

发布日期: 2026-02-04

💡 一句话要点

揭示上下文拖拽效应:上下文错误如何影响大语言模型推理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 上下文拖拽 大语言模型 推理能力 错误分析 自完善

📋 核心要点

- 大型语言模型(LLM)的自提升流程依赖于模型反思过去错误的能力,但实际效果受限。

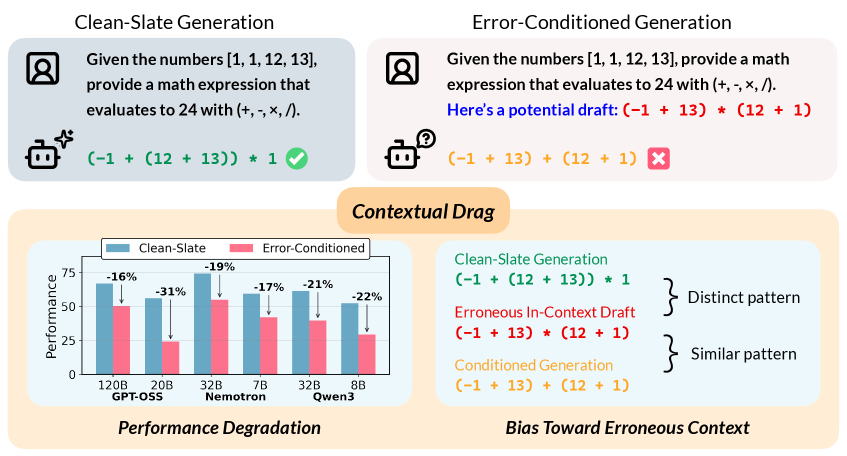

- 论文提出“上下文拖拽”现象,即上下文中错误信息会使模型倾向于产生结构相似的错误。

- 实验表明,上下文拖拽导致性能显著下降,且现有缓解策略无法完全消除此负面影响。

📝 摘要(中文)

本文研究了一种名为“上下文拖拽”的现象,即上下文中存在的失败尝试会使后续生成偏向于结构相似的错误。通过对11个专有和开源模型在8个推理任务上的评估,上下文拖拽会导致10-20%的性能下降,并且具有严重上下文拖拽的模型中的迭代自完善可能会崩溃为自恶化。使用树编辑距离的结构分析表明,后续的推理轨迹会从上下文中继承结构相似的错误模式。研究表明,外部反馈或成功的自我验证都不足以消除这种影响。虽然诸如回退行为微调和上下文去噪等缓解策略产生了部分改进,但它们未能完全恢复基线性能,这使得上下文拖拽成为当前推理架构中一种持续存在的失败模式。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在推理过程中,受到上下文中错误信息干扰,导致推理性能下降的问题。现有方法未能有效解决这种“上下文拖拽”效应,使得模型在迭代自完善过程中可能陷入恶性循环。

核心思路:论文的核心思路是识别并量化“上下文拖拽”效应,分析其对模型推理过程的影响,并尝试通过不同的策略来缓解这种效应。通过结构分析,揭示错误模式的传递机制。

技术框架:论文的技术框架主要包括:1) 设计实验评估上下文拖拽对不同LLM的影响;2) 使用树编辑距离分析推理轨迹的结构相似性,量化错误模式的传递;3) 探索多种缓解策略,如外部反馈、自我验证、回退行为微调和上下文去噪,并评估其效果。

关键创新:论文的关键创新在于首次提出了“上下文拖拽”这一概念,并系统地研究了其对LLM推理的影响。通过结构分析,揭示了错误模式在推理过程中的传递机制,为理解和解决LLM的推理缺陷提供了新的视角。

关键设计:论文的关键设计包括:1) 选择具有代表性的推理任务和LLM进行评估;2) 使用树编辑距离作为衡量推理轨迹结构相似性的指标;3) 设计多种缓解策略,并进行消融实验,分析不同策略的效果。具体参数设置和网络结构取决于所使用的LLM,论文侧重于现象的分析和缓解策略的探索,而非特定模型的优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,上下文拖拽会导致LLM在推理任务中出现10-20%的性能下降。即使采用外部反馈或自我验证等方法,也无法完全消除这种影响。回退行为微调和上下文去噪等缓解策略虽然能带来部分改进,但仍无法完全恢复基线性能,表明上下文拖拽是当前推理架构中一个顽固的问题。

🎯 应用场景

该研究成果可应用于提升大型语言模型的推理能力和鲁棒性,尤其是在需要迭代自完善的场景中。通过缓解上下文拖拽效应,可以提高模型在复杂任务中的表现,并减少模型产生错误答案的可能性。此外,该研究也为开发更可靠的LLM自提升方法提供了指导。

📄 摘要(原文)

Central to many self-improvement pipelines for large language models (LLMs) is the assumption that models can improve by reflecting on past mistakes. We study a phenomenon termed contextual drag: the presence of failed attempts in the context biases subsequent generations toward structurally similar errors. Across evaluations of 11 proprietary and open-weight models on 8 reasoning tasks, contextual drag induces 10-20% performance drops, and iterative self-refinement in models with severe contextual drag can collapse into self-deterioration. Structural analysis using tree edit distance reveals that subsequent reasoning trajectories inherit structurally similar error patterns from the context. We demonstrate that neither external feedback nor successful self-verification suffices to eliminate this effect. While mitigation strategies such as fallback-behavior fine-tuning and context denoising yield partial improvements, they fail to fully restore baseline performance, positioning contextual drag as a persistent failure mode in current reasoning architectures.