CoLT: Reasoning with Chain of Latent Tool Calls

作者: Fangwei Zhu, Zhifang Sui

分类: cs.CL

发布日期: 2026-02-04

💡 一句话要点

提出CoLT框架,通过链式潜在工具调用提升LLM推理效率与精度

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 潜在推理 工具调用 链式推理 数学问题求解

📋 核心要点

- 现有潜在推理方法通常需要模型结构增强和大量训练,限制了其广泛适用性。

- CoLT框架通过“工具调用”实现潜在推理,利用外部小模型处理种子token,主模型保持在显式token空间推理。

- 实验表明,CoLT在数学数据集上实现了更高的准确率和更短的推理长度,并具有良好的兼容性。

📝 摘要(中文)

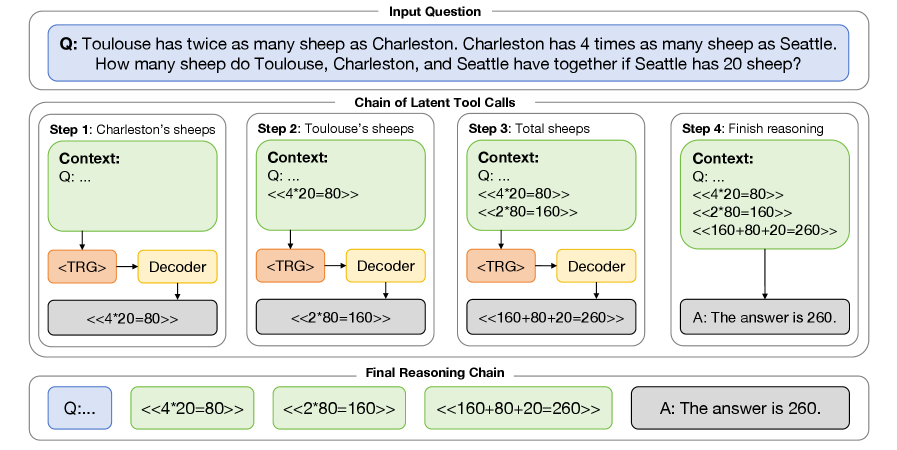

本文提出了一种名为CoLT的新框架,旨在提升大型语言模型(LLMs)的推理能力,并加速低效的token级推理链。CoLT将潜在推理实现为“工具调用”,避免了完全在潜在空间中推理。CoLT生成包含推理步骤信息的种子token。当触发潜在工具调用时,一个较小的外部模型将种子token的隐藏状态作为输入,并将种子token解包回完整的推理步骤。这样,主模型可以在显式的token空间中推理,保持其能力的同时提高效率。在四个数学数据集上的实验结果表明,CoLT比基线潜在模型实现了更高的准确率和更短的推理长度,并且与强化学习算法和不同的解码器结构兼容。

🔬 方法详解

问题定义:现有的大型语言模型(LLMs)在进行复杂推理时,通常采用Chain-of-Thought (CoT) 方法,但这种方法在token级别上进行推理,效率较低。现有的潜在推理方法试图在隐空间进行推理以加速过程,但通常需要修改模型结构并进行大量的训练,这限制了它们的通用性和易用性。

核心思路:CoLT的核心思想是将潜在推理过程视为一系列的“工具调用”。主模型负责生成包含推理步骤信息的种子token,然后将这些种子token传递给一个外部的、较小的模型(即“工具”)。这个外部模型负责将种子token“解包”为完整的推理步骤,从而在隐空间中完成推理过程,并将结果返回给主模型。这样,主模型仍然在显式的token空间中进行推理,避免了修改主模型结构的需求,同时提高了推理效率。

技术框架:CoLT框架主要包含以下几个模块:1) 主模型:负责生成种子token,并接收外部模型返回的推理结果。2) 种子token生成器:嵌入在主模型中,负责将推理步骤的信息编码到种子token中。3) 外部模型(工具):接收种子token的隐藏状态作为输入,并将其解码为完整的推理步骤。4) 解码器:将外部模型的输出解码为可用的token序列。整个流程如下:主模型生成种子token -> 触发潜在工具调用 -> 外部模型接收种子token的隐藏状态 -> 外部模型进行推理并将结果返回 -> 主模型接收推理结果并继续推理。

关键创新:CoLT的关键创新在于将潜在推理过程解耦为主模型和外部模型之间的“工具调用”。这种解耦使得可以在不修改主模型结构的情况下,利用外部模型进行高效的潜在推理。与现有方法相比,CoLT不需要对主模型进行大量的训练,并且可以灵活地选择不同的外部模型作为“工具”。

关键设计:CoLT的关键设计包括:1) 种子token的设计:种子token需要包含足够的信息,以便外部模型能够准确地还原推理步骤。2) 外部模型的选择:外部模型的大小和结构需要根据具体的任务进行选择,以在推理效率和准确率之间取得平衡。3) 损失函数的设计:需要设计合适的损失函数来训练外部模型,使其能够准确地将种子token解码为推理步骤。论文中可能使用了交叉熵损失或类似的损失函数来训练外部模型。

🖼️ 关键图片

📊 实验亮点

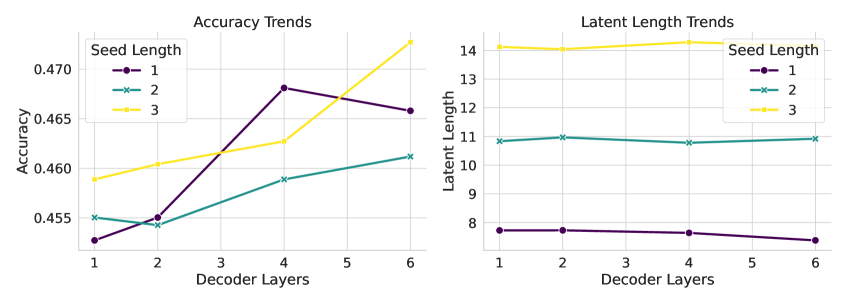

实验结果表明,CoLT在四个数学数据集上均优于基线潜在模型,实现了更高的准确率和更短的推理长度。具体性能数据未知,但摘要中明确指出CoLT在准确率和推理长度上均有提升。此外,CoLT还与强化学习算法和不同的解码器结构兼容,表明其具有良好的通用性。

🎯 应用场景

CoLT框架可应用于各种需要复杂推理的场景,例如数学问题求解、代码生成、知识图谱推理等。该框架通过提高推理效率和准确率,可以提升LLM在这些领域的应用价值。未来,CoLT可以进一步扩展到其他类型的推理任务,并与其他技术(如强化学习)相结合,以实现更强大的推理能力。

📄 摘要(原文)

Chain-of-Thought (CoT) is a critical technique in enhancing the reasoning ability of Large Language Models (LLMs), and latent reasoning methods have been proposed to accelerate the inefficient token-level reasoning chain. We notice that existing latent reasoning methods generally require model structure augmentation and exhaustive training, limiting their broader applicability. In this paper, we propose CoLT, a novel framework that implements latent reasoning as ``tool calls''. Instead of reasoning entirely in the latent space, CoLT generates seed tokens that contain information of a reasoning step. When a latent tool call is triggered, a smaller external model will take the hidden states of seed tokens as its input, and unpack the seed tokens back to a full reasoning step. In this way, we can ensure that the main model reasons in the explicit token space, preserving its ability while improving efficiency. Experimental results on four mathematical datasets demonstrate that CoLT achieves higher accuracy and shorter reasoning length than baseline latent models, and is compatible with reinforcement learning algorithms and different decoder structures.