ACL: Aligned Contrastive Learning Improves BERT and Multi-exit BERT Fine-tuning

作者: Wei Zhu

分类: cs.CL

发布日期: 2026-02-03

💡 一句话要点

提出对齐对比学习(ACL)框架,提升BERT和多出口BERT微调性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 对比学习 BERT微调 多出口BERT 自然语言处理 预训练模型

📋 核心要点

- 监督学习中,交叉熵损失与对比学习目标可能冲突,限制了对比学习的应用。

- ACL框架通过对齐标签嵌入和样本表示,并动态调整损失权重,缓解了目标冲突。

- 实验表明,ACL在GLUE任务和多出口BERT微调上均取得了显著的性能提升。

📝 摘要(中文)

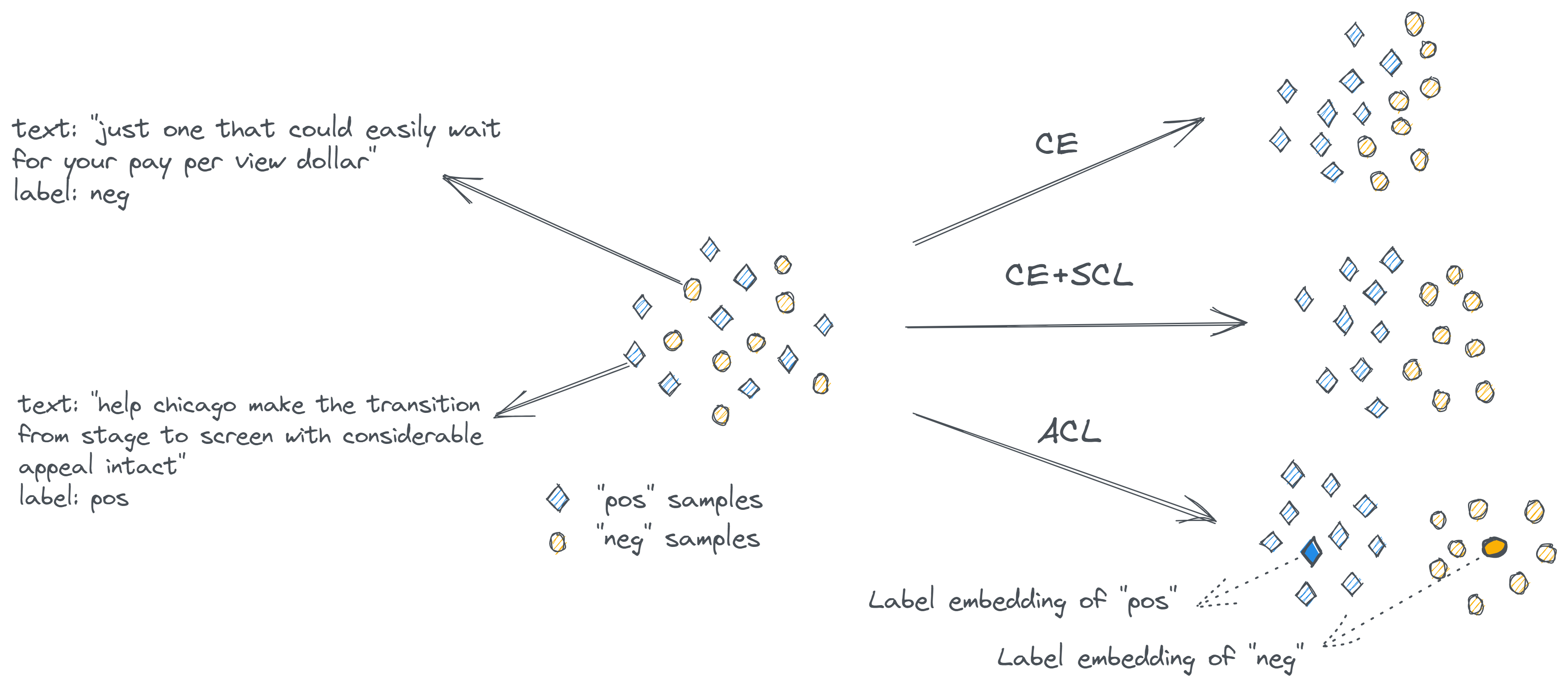

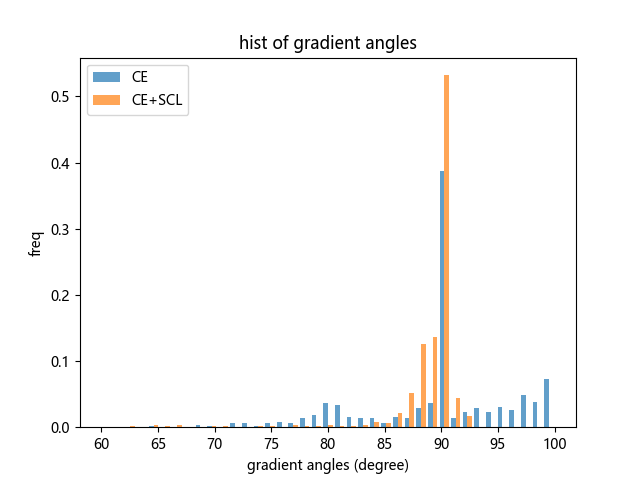

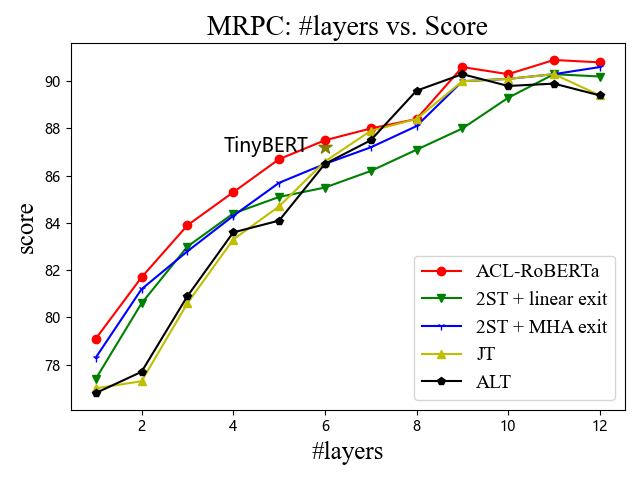

本文研究了监督学习场景下对比学习的应用。通过初步实验发现,交叉熵损失(CE)和对比学习目标之间存在冲突,阻碍了对比学习在监督环境中的应用。为了解决这个问题,我们提出了一种新的对齐对比学习(ACL)框架。首先,ACL-Embed将标签嵌入视为具有不同标签的额外增强样本,并采用对比学习来对齐标签嵌入与其样本的表示。其次,为了促进ACL-Embed目标与CE损失的联合优化,我们提出了ACL-Grad,如果两个目标之间存在冲突,则会丢弃ACL-Embed项。为了进一步提高多出口BERT中间出口的性能,我们进一步提出了跨层ACL(ACL-CL),它要求教师出口指导学生浅层出口的优化。在GLUE基准上的大量实验表明:(a) ACL-BRT在GLUE任务上优于或与CE和CE+SCL相当;(b) ACL,特别是CL-ACL,显著优于多出口BERT微调的基线方法,从而为低延迟应用提供了更好的质量-速度权衡。

🔬 方法详解

问题定义:现有方法在微调BERT等预训练模型时,通常使用交叉熵损失函数。然而,直接将对比学习引入监督微调任务时,交叉熵损失和对比学习的目标可能不一致,导致模型性能下降。尤其是在多出口BERT中,浅层出口的训练更加困难。

核心思路:论文的核心思路是通过对齐标签嵌入和样本表示来解决交叉熵损失和对比学习目标之间的冲突。具体来说,将标签信息融入到对比学习过程中,使得模型能够更好地学习到样本和标签之间的关系。此外,还提出了一种动态调整损失权重的方法,以避免两个目标之间的负面影响。

技术框架:ACL框架主要包含两个模块:ACL-Embed和ACL-Grad。ACL-Embed模块将标签嵌入视为额外的增强样本,并使用对比学习来对齐标签嵌入和样本表示。ACL-Grad模块则根据交叉熵损失和ACL-Embed目标之间的冲突程度,动态地调整ACL-Embed的权重,甚至在冲突严重时直接丢弃ACL-Embed项。对于多出口BERT,提出了跨层ACL(ACL-CL),利用深层出口指导浅层出口的训练。

关键创新:论文的关键创新在于提出了对齐对比学习(ACL)框架,该框架能够有效地解决交叉熵损失和对比学习目标之间的冲突,从而提升BERT和多出口BERT的微调性能。ACL-Embed通过将标签信息融入到对比学习过程中,使得模型能够更好地学习到样本和标签之间的关系。ACL-Grad则通过动态调整损失权重,避免了两个目标之间的负面影响。

关键设计:ACL-Embed的关键设计在于如何生成标签嵌入。论文中将标签嵌入视为额外的增强样本,并使用对比学习来对齐标签嵌入和样本表示。ACL-Grad的关键设计在于如何判断交叉熵损失和ACL-Embed目标之间是否存在冲突,以及如何动态地调整ACL-Embed的权重。ACL-CL的关键设计在于如何选择合适的教师出口来指导学生出口的训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ACL框架在GLUE基准测试中取得了显著的性能提升。ACL-BRT在GLUE任务上优于或与CE和CE+SCL相当。特别是在多出口BERT的微调中,ACL,尤其是CL-ACL,显著优于基线方法,为低延迟应用提供了更好的质量-速度权衡。例如,在某些任务上,ACL可以将多出口BERT的性能提升数个百分点。

🎯 应用场景

该研究成果可应用于各种自然语言处理任务,尤其是在需要低延迟的应用场景中,例如实时文本分类、情感分析、机器翻译等。通过提升多出口BERT的性能,可以在保证模型精度的前提下,显著降低计算复杂度,从而实现更快的推理速度。该方法具有广泛的应用前景,可以提升各种NLP应用的效率和用户体验。

📄 摘要(原文)

Despite its success in self-supervised learning, contrastive learning is less studied in the supervised setting. In this work, we first use a set of pilot experiments to show that in the supervised setting, the cross-entropy loss objective (CE) and the contrastive learning objective often conflict with each other, thus hindering the applications of CL in supervised settings. To resolve this problem, we introduce a novel \underline{A}ligned \underline{C}ontrastive \underline{L}earning (ACL) framework. First, ACL-Embed regards label embeddings as extra augmented samples with different labels and employs contrastive learning to align the label embeddings with its samples' representations. Second, to facilitate the optimization of ACL-Embed objective combined with the CE loss, we propose ACL-Grad, which will discard the ACL-Embed term if the two objectives are in conflict. To further enhance the performances of intermediate exits of multi-exit BERT, we further propose cross-layer ACL (ACL-CL), which is to ask the teacher exit to guide the optimization of student shallow exits. Extensive experiments on the GLUE benchmark results in the following takeaways: (a) ACL-BRT outperforms or performs comparably with CE and CE+SCL on the GLUE tasks; (b) ACL, especially CL-ACL, significantly surpasses the baseline methods on the fine-tuning of multi-exit BERT, thus providing better quality-speed tradeoffs for low-latency applications.