SAES-SVD: Self-Adaptive Suppression of Accumulated and Local Errors for SVD-based LLM Compression

作者: Xing Hu, Dawei Yang, Yuan Cheng, Zhixuan Chen, Zukang Xu

分类: cs.CL

发布日期: 2026-02-03

💡 一句话要点

SAES-SVD:自适应抑制累积误差的SVD压缩LLM框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型压缩 低秩分解 奇异值分解 误差抑制 自适应优化

📋 核心要点

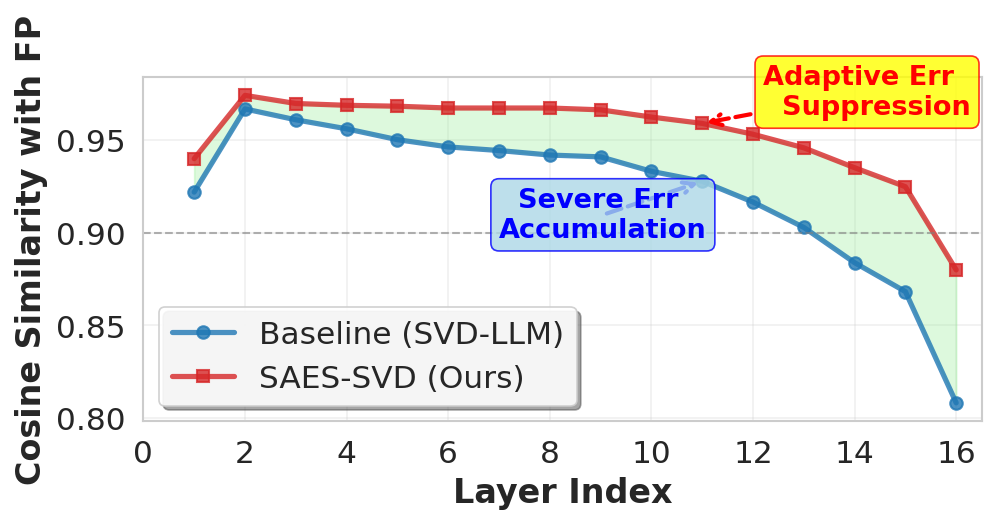

- 现有LLM低秩压缩方法忽略了层间误差累积,导致全局性能下降。

- SAES-SVD框架联合优化层内重建和层间误差补偿,抑制误差累积。

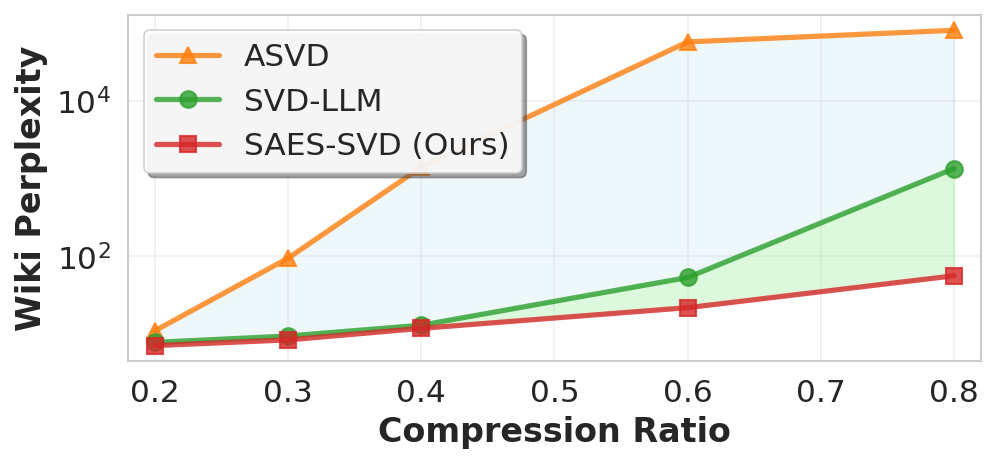

- 实验表明,SAES-SVD在多种LLM和任务上,无需微调即可提升压缩性能。

📝 摘要(中文)

大型语言模型(LLM)参数规模的快速增长对高效压缩技术提出了很高的需求。低秩压缩作为一种与硬件无关且高度兼容的技术,已被广泛采用。然而,现有方法通常通过最小化每层重建误差来独立压缩每一层,忽略了一个关键限制:重建误差在网络中传播和累积,导致与全精度基线相比,全局偏差被放大。为了解决这个问题,我们提出了自适应误差抑制SVD(SAES-SVD),一个LLM压缩框架,它联合优化层内重建和层间误差补偿。SAES-SVD由两个新颖的组件组成:(1)累积误差感知层压缩(CEALC),它将压缩目标公式化为局部重建和加权累积误差补偿的组合。在此基础上,我们推导出依赖于二阶激活统计的闭式低秩解,该解显式地将每一层的输出与其全精度对应物对齐,以补偿累积误差。(2)自适应协同误差抑制(ACES),它自动调整加权系数,以增强CEALC中压缩目标的低秩结构。具体来说,优化该系数以最大化压缩层输出的Frobenius范数与固定秩下压缩目标的Frobenius范数之比,从而确保秩预算得到有效利用。跨多个LLM架构和任务的广泛实验表明,在没有微调或混合秩策略的情况下,SAES-SVD始终提高压缩后的性能。

🔬 方法详解

问题定义:现有基于SVD的LLM压缩方法通常独立地压缩每一层,仅关注层内的重建误差最小化。这种做法忽略了层间误差的传播和累积,导致压缩后的模型在深层网络中产生较大的全局偏差,最终影响模型性能。现有方法缺乏对累积误差的有效抑制机制。

核心思路:SAES-SVD的核心思路是联合优化层内重建误差和层间误差补偿。通过显式地将每一层的输出与其全精度对应物对齐,来补偿累积误差。同时,自适应地调整权重系数,以增强压缩目标的低秩结构,从而更有效地利用秩预算。

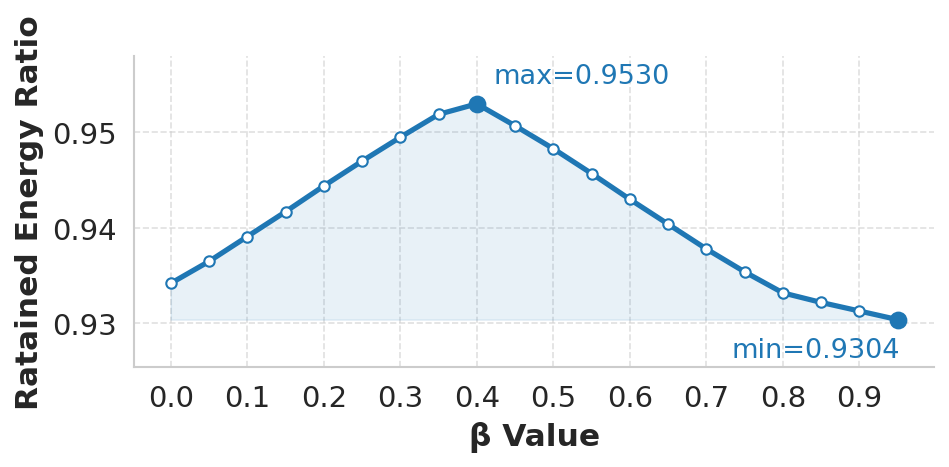

技术框架:SAES-SVD框架包含两个主要模块:累积误差感知层压缩(CEALC)和自适应协同误差抑制(ACES)。CEALC模块将压缩目标定义为局部重建误差和加权累积误差补偿的组合,并推导出基于二阶激活统计的闭式低秩解。ACES模块则负责自动调整CEALC中的权重系数,以优化压缩目标的低秩结构。整体流程是,首先使用CEALC进行初步压缩,然后利用ACES自适应地调整权重,最终得到压缩后的模型。

关键创新:SAES-SVD的关键创新在于其对累积误差的显式建模和自适应抑制。与现有方法仅关注局部重建误差不同,SAES-SVD通过CEALC模块将累积误差纳入优化目标,并通过ACES模块自适应地调整权重,从而更有效地抑制误差累积,提升压缩性能。

关键设计:CEALC模块的关键设计在于其将压缩目标定义为局部重建误差和加权累积误差补偿的组合。具体来说,压缩目标可以表示为:Loss = ||W - W_hat||_F^2 + lambda * ||Output - Output_hat||_F^2,其中W和W_hat分别表示全精度和压缩后的权重矩阵,Output和Output_hat分别表示全精度和压缩后层的输出,lambda是权重系数。ACES模块的关键设计在于其自适应地调整lambda,以最大化压缩层输出的Frobenius范数与压缩目标的Frobenius范数之比,从而确保秩预算得到有效利用。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SAES-SVD在多个LLM架构和任务上均取得了显著的性能提升。例如,在不进行微调的情况下,SAES-SVD在某些任务上的性能甚至超过了需要微调的基线方法。此外,SAES-SVD在不同压缩率下均表现出良好的鲁棒性,证明了其在实际应用中的潜力。

🎯 应用场景

SAES-SVD可应用于各种需要高效部署大型语言模型的场景,例如移动设备、边缘计算和资源受限的环境。通过在不显著降低模型性能的前提下减少模型大小,SAES-SVD能够降低存储成本、加速推理速度,并支持更广泛的应用,例如智能助手、自然语言处理服务和嵌入式人工智能系统。

📄 摘要(原文)

The rapid growth in the parameter scale of large language models (LLMs) has created a high demand for efficient compression techniques. As a hardware-agnostic and highly compatible technique, low-rank compression has been widely adopted. However, existing methods typically compress each layer independently by minimizing per-layer reconstruction error, overlooking a critical limitation: the reconstruction error propagates and accumulates through the network, which leads to amplified global deviations from the full-precision baseline. To address this, we propose Self-Adaptive Error Suppression SVD (SAES-SVD), a LLMs compression framework that jointly optimizes intra-layer reconstruction and inter-layer error compensation. SAES-SVD is composed of two novel components: (1) Cumulative Error-Aware Layer Compression (CEALC), which formulates the compression objective as a combination of local reconstruction and weighted cumulative error compensation. Based on it, we derive a closed-form low-rank solution relied on second-order activation statistics, which explicitly aligns each layer's output with its full-precision counterpart to compensate for accumulated errors. (2) Adaptive Collaborative Error Suppression (ACES), which automatically adjusts the weighting coefficient to enhance the low-rank structure of the compression objective in CEALC. Specifically, the coefficient is optimized to maximize the ratio between the Frobenius norm of the compressed layer's output and that of the compression objective under a fixed rank, thus ensuring that the rank budget is utilized effectively. Extensive experiments across multiple LLM architectures and tasks show that, without fine-tuning or mixed-rank strategies, SAES-SVD consistently improves post-compression performance.