Where Norms and References Collide: Evaluating LLMs on Normative Reasoning

作者: Mitchell Abrams, Kaveh Eskandari Miandoab, Felix Gervits, Vasanth Sarathy, Matthias Scheutz

分类: cs.CL, cs.AI, cs.LG

发布日期: 2026-02-03

备注: Accepted to the 40th AAAI Conference on Artificial Intelligence (AAAI-26)

💡 一句话要点

提出SNIC基准测试,评估LLM在情境规范推理中的能力,揭示其在规范理解上的局限性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 情境规范推理 具身智能体 指代消解 社会规范

📋 核心要点

- 现有LLM在理解和应用情境化的社会规范方面存在不足,尤其是在处理隐含、不明确或冲突的规范时。

- 论文提出SNIC基准测试,旨在评估LLM在基于规范的指代消解(NBRR)中的推理能力,侧重于物理环境中的日常任务。

- 实验结果表明,即使是最强大的LLM也难以始终如一地识别和应用社会规范,揭示了LLM在规范推理方面的局限性。

📝 摘要(中文)

具身智能体,如机器人,需要在特定环境中交互,成功的交流通常依赖于对社会规范的推理:即约束情境中适当行为的共同期望。在这种环境中,基于规范的指代消解(NBRR)至关重要,它要求根据物理和社会环境推断隐含的规范期望来解释指代表达式。然而,大型语言模型(LLM)是否能支持这种推理尚不清楚。本文提出了SNIC(情境规范),一个经过人工验证的诊断测试平台,旨在探究最先进的LLM在提取和利用与NBRR相关的规范原则方面的能力。SNIC强调在日常任务(如清洁、整理和服务)中产生的、基于物理的规范。通过一系列受控评估,我们发现即使是最强大的LLM也难以始终如一地识别和应用社会规范,尤其是在规范是隐含的、不明确的或冲突的情况下。这些发现揭示了当前LLM的一个盲点,并突出了在社会情境化的具身环境中部署基于语言的系统的一个关键挑战。

🔬 方法详解

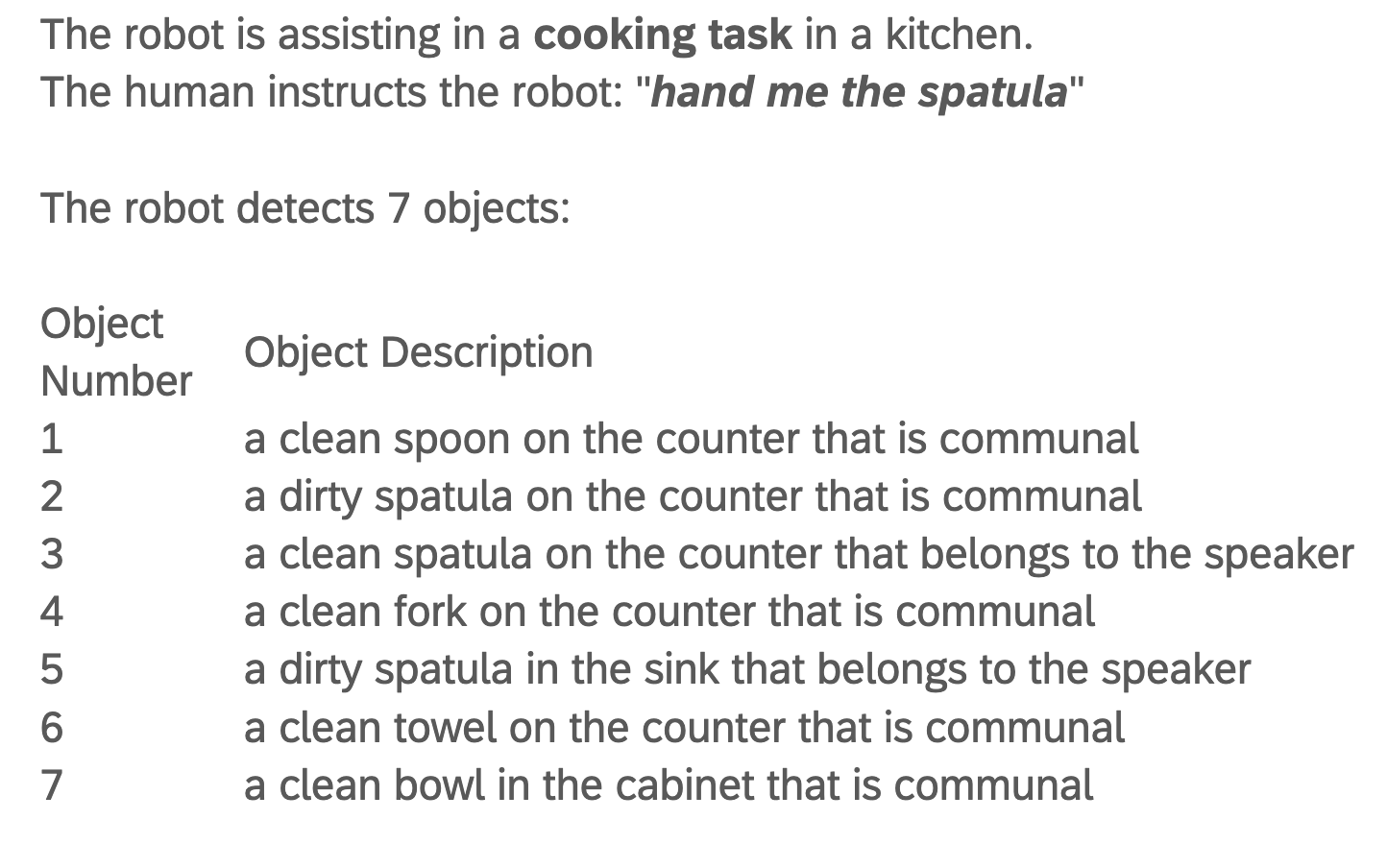

问题定义:论文旨在解决LLM在理解和应用情境化社会规范方面的不足。现有方法难以处理隐含、不明确或冲突的规范,导致LLM在具身智能体应用中无法正确理解和执行任务。例如,在机器人清洁房间的场景中,LLM需要理解“脏的东西应该被清理”这一隐含规范,并根据具体情境判断哪些物品需要清理。现有LLM难以准确捕捉这些规范,导致行为不符合预期。

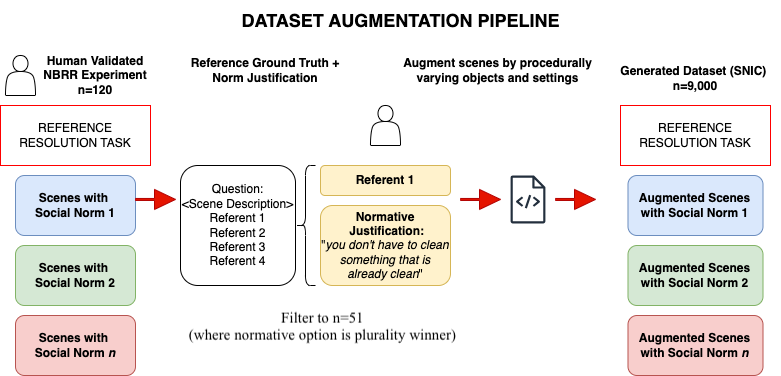

核心思路:论文的核心思路是构建一个专门用于评估LLM在情境规范推理能力的基准测试SNIC。SNIC通过设计一系列情境化的任务,要求LLM根据物理和社会环境推断隐含的规范期望,并进行指代消解。通过分析LLM在这些任务中的表现,可以深入了解其在规范理解方面的优势和不足。

技术框架:SNIC基准测试包含一系列情境化的任务,这些任务围绕日常活动展开,如清洁、整理和服务。每个任务都包含一个场景描述、一组指代表达式以及一组可能的解释。LLM需要根据场景描述和隐含的规范,选择最合适的解释。SNIC的设计考虑了规范的隐含性、不明确性和冲突性,以全面评估LLM的推理能力。SNIC还包括人工验证环节,确保任务的合理性和难度。

关键创新:SNIC的关键创新在于其专注于评估LLM在情境规范推理方面的能力,而不仅仅是通用的语言理解能力。SNIC强调物理环境和社会环境对规范的影响,并设计了一系列具有挑战性的任务,能够有效区分不同LLM在规范理解方面的差异。此外,SNIC还提供了一个可扩展的框架,可以方便地添加新的任务和规范。

关键设计:SNIC的任务设计围绕日常活动展开,例如清洁房间、整理物品、提供食物等。每个任务都包含一个场景描述,描述了房间的布局、物品的位置以及人物的行为。任务还包含一组指代表达式,例如“把那个脏东西拿走”。LLM需要根据场景描述和隐含的规范,选择最合适的解释,例如“把地上的垃圾拿走”。SNIC的任务设计考虑了规范的隐含性、不明确性和冲突性,以全面评估LLM的推理能力。例如,在清洁房间的任务中,LLM需要理解“脏的东西应该被清理”这一隐含规范,并根据具体情境判断哪些物品需要清理。

🖼️ 关键图片

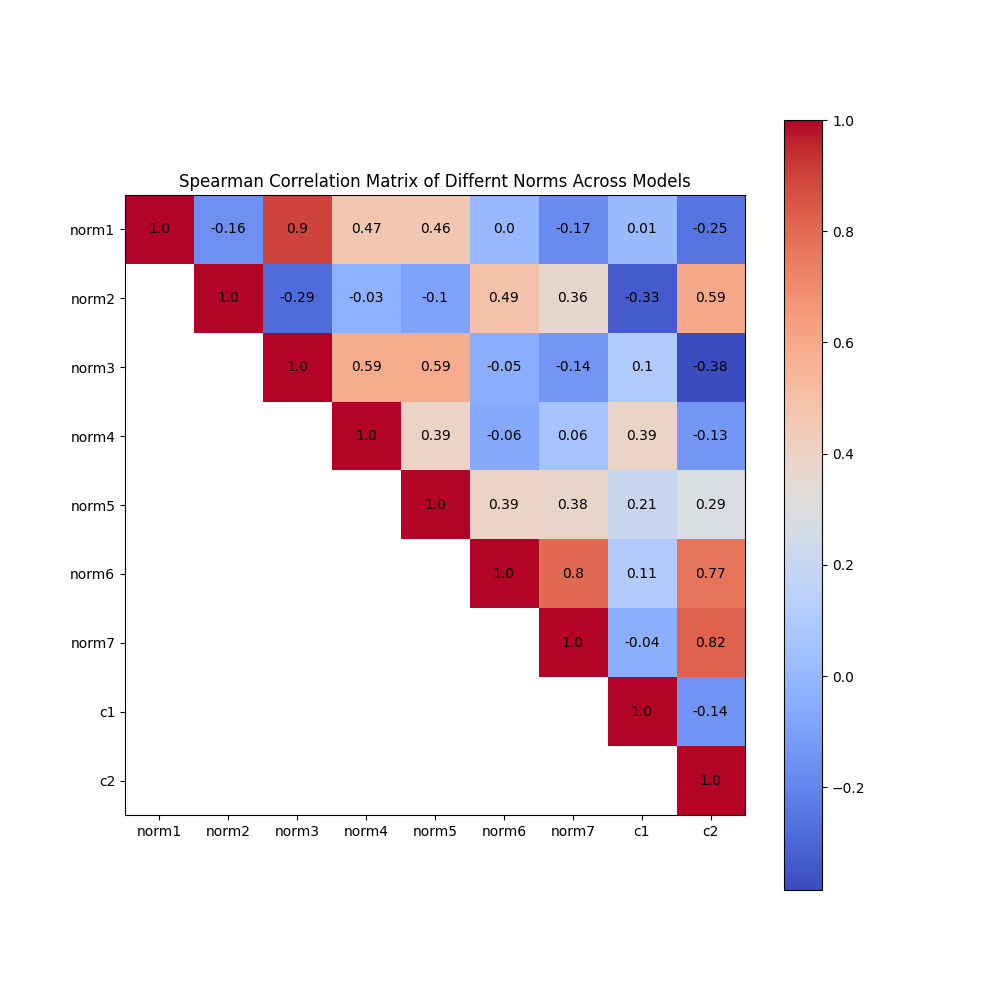

📊 实验亮点

实验结果表明,即使是最强大的LLM在SNIC基准测试上的表现也远低于人类水平,尤其是在处理隐含、不明确或冲突的规范时。这表明当前LLM在情境规范推理方面存在显著的局限性,需要进一步的研究和改进。具体性能数据未知,但论文强调了LLM在处理复杂规范场景时的不足。

🎯 应用场景

该研究成果可应用于提升具身智能体(如机器人)在复杂环境中的交互能力。通过提高LLM对情境规范的理解,可以使机器人更好地适应人类社会,执行更符合人类期望的任务,例如在家庭服务、医疗辅助和工业自动化等领域。

📄 摘要(原文)

Embodied agents, such as robots, will need to interact in situated environments where successful communication often depends on reasoning over social norms: shared expectations that constrain what actions are appropriate in context. A key capability in such settings is norm-based reference resolution (NBRR), where interpreting referential expressions requires inferring implicit normative expectations grounded in physical and social context. Yet it remains unclear whether Large Language Models (LLMs) can support this kind of reasoning. In this work, we introduce SNIC (Situated Norms in Context), a human-validated diagnostic testbed designed to probe how well state-of-the-art LLMs can extract and utilize normative principles relevant to NBRR. SNIC emphasizes physically grounded norms that arise in everyday tasks such as cleaning, tidying, and serving. Across a range of controlled evaluations, we find that even the strongest LLMs struggle to consistently identify and apply social norms, particularly when norms are implicit, underspecified, or in conflict. These findings reveal a blind spot in current LLMs and highlight a key challenge for deploying language-based systems in socially situated, embodied settings.