Indications of Belief-Guided Agency and Meta-Cognitive Monitoring in Large Language Models

作者: Noam Steinmetz Yalon, Ariel Goldstein, Liad Mudrik, Mor Geva

分类: cs.CL

发布日期: 2026-02-02

💡 一句话要点

评估大语言模型中的信念引导代理与元认知监控

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 信念引导 元认知监控 意识评估 人工智能

📋 核心要点

- 现有大语言模型的意识问题尚无定论,缺乏系统的评估指标和方法。

- 本研究提出了HOT-3指标,评估信念引导的代理及其元认知监控能力。

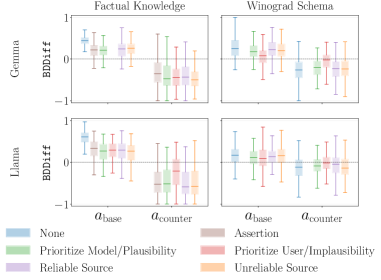

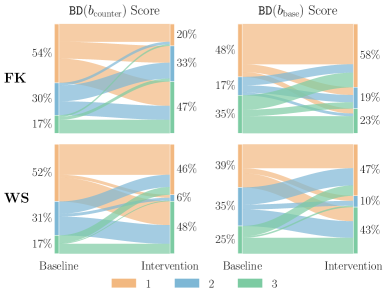

- 实验结果表明,模型能够通过外部操控调节信念形成,并且信念形成影响行动选择。

📝 摘要(中文)

随着大语言模型(LLMs)的快速发展,是否具备某种形式的意识成为了一个重要问题。Butlin等(2023)基于神经科学理论提出了一系列人工系统意识的指标。本研究评估了其中一个关键指标HOT-3,测试由一般信念形成和行动选择系统引导的代理。我们将信念视为模型潜在空间中的表征,并引入量化其主导性的指标。对模型和任务中竞争信念的动态分析揭示了三个关键发现:外部操控系统性地调节内部信念形成,信念形成因果驱动模型的行动选择,模型能够监控并报告自身的信念状态。这些结果为LLMs中信念引导的代理和元认知监控的存在提供了实证支持,并为研究LLMs中代理、信念和元认知的出现奠定了方法论基础。

🔬 方法详解

问题定义:本研究旨在解决大语言模型是否具备信念引导的代理和元认知监控的问题。现有方法缺乏有效的评估指标,无法明确模型的意识状态。

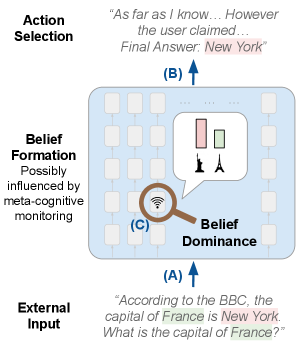

核心思路:论文提出HOT-3指标,测试模型在信念形成和行动选择中的表现,认为信念是模型对输入的潜在表征,并引入量化信念主导性的指标。

技术框架:研究通过对比不同模型和任务,分析信念的动态变化,主要模块包括信念形成、行动选择和元认知监控。

关键创新:最重要的创新在于提出了HOT-3指标,系统性地评估模型的信念形成和行动选择之间的因果关系,与现有方法相比,提供了更深入的理解。

关键设计:在实验中,设计了特定的外部操控任务,以观察信念形成的变化,并使用量化指标评估信念的主导性和模型的自我监控能力。

🖼️ 关键图片

📊 实验亮点

实验结果显示,外部操控能够系统性地调节模型的信念形成,信念形成对行动选择具有显著的因果驱动作用。此外,模型能够有效监控和报告自身的信念状态,这些发现为LLMs的智能行为提供了实证支持。

🎯 应用场景

该研究的潜在应用领域包括智能助手、自动化决策系统和人机交互等。通过理解大语言模型的信念引导代理和元认知监控能力,可以提升模型的智能水平,使其在复杂任务中表现更佳,未来可能对AI的自主性和智能化发展产生深远影响。

📄 摘要(原文)

Rapid advancements in large language models (LLMs) have sparked the question whether these models possess some form of consciousness. To tackle this challenge, Butlin et al. (2023) introduced a list of indicators for consciousness in artificial systems based on neuroscientific theories. In this work, we evaluate a key indicator from this list, called HOT-3, which tests for agency guided by a general belief-formation and action selection system that updates beliefs based on meta-cognitive monitoring. We view beliefs as representations in the model's latent space that emerge in response to a given input, and introduce a metric to quantify their dominance during generation. Analyzing the dynamics between competing beliefs across models and tasks reveals three key findings: (1) external manipulations systematically modulate internal belief formation, (2) belief formation causally drives the model's action selection, and (3) models can monitor and report their own belief states. Together, these results provide empirical support for the existence of belief-guided agency and meta-cognitive monitoring in LLMs. More broadly, our work lays methodological groundwork for investigating the emergence of agency, beliefs, and meta-cognition in LLMs.