ROG: Retrieval-Augmented LLM Reasoning for Complex First-Order Queries over Knowledge Graphs

作者: Ziyan Zhang, Chao Wang, Zhuo Chen, Chiyi Li, Kai Song

分类: cs.CL

发布日期: 2026-02-02

💡 一句话要点

提出ROG:一种检索增强的LLM推理框架,用于解决知识图谱上的复杂一阶逻辑查询

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱推理 一阶逻辑查询 检索增强 大型语言模型 思维链 知识图谱 逻辑推理

📋 核心要点

- 现有方法难以处理知识图谱上包含投影、交集、并集和否定等复杂结构的一阶逻辑查询。

- ROG框架结合查询感知的邻域检索与LLM思维链推理,将复杂查询分解为子查询,并利用缓存机制提高推理一致性。

- 实验表明,ROG在标准知识图谱推理基准上优于基于嵌入的基线,尤其在复杂和否定查询上提升显著。

📝 摘要(中文)

回答不完整知识图谱上的复杂一阶逻辑(FOL)查询非常困难,特别是对于包含投影、交集、并集和否定的复杂查询结构。我们提出了ROG,一个检索增强框架,它结合了查询感知的邻域检索与大型语言模型(LLM)的思维链推理。ROG将多算子查询分解为一系列单算子子查询,并将每一步都建立在紧凑的、查询相关的邻域证据之上。中间答案集被缓存并在步骤之间重用,从而提高了深度推理链上的一致性。这种设计减少了复合误差,并在复杂和否定繁重的查询上产生了更强大的推理。总的来说,ROG通过用检索支持的、逐步推理代替学习的算子,为基于嵌入的逻辑推理提供了一种实用的替代方案。在标准KG推理基准上的实验表明,相对于强大的基于嵌入的基线,ROG取得了持续的收益,尤其是在高复杂性和否定繁重的查询类型上。

🔬 方法详解

问题定义:论文旨在解决知识图谱上复杂一阶逻辑查询推理的问题。现有基于嵌入的方法在处理复杂查询结构(特别是包含否定操作的查询)时,容易出现误差累积,导致推理性能下降。此外,这些方法依赖于学习到的算子,缺乏可解释性,并且泛化能力有限。

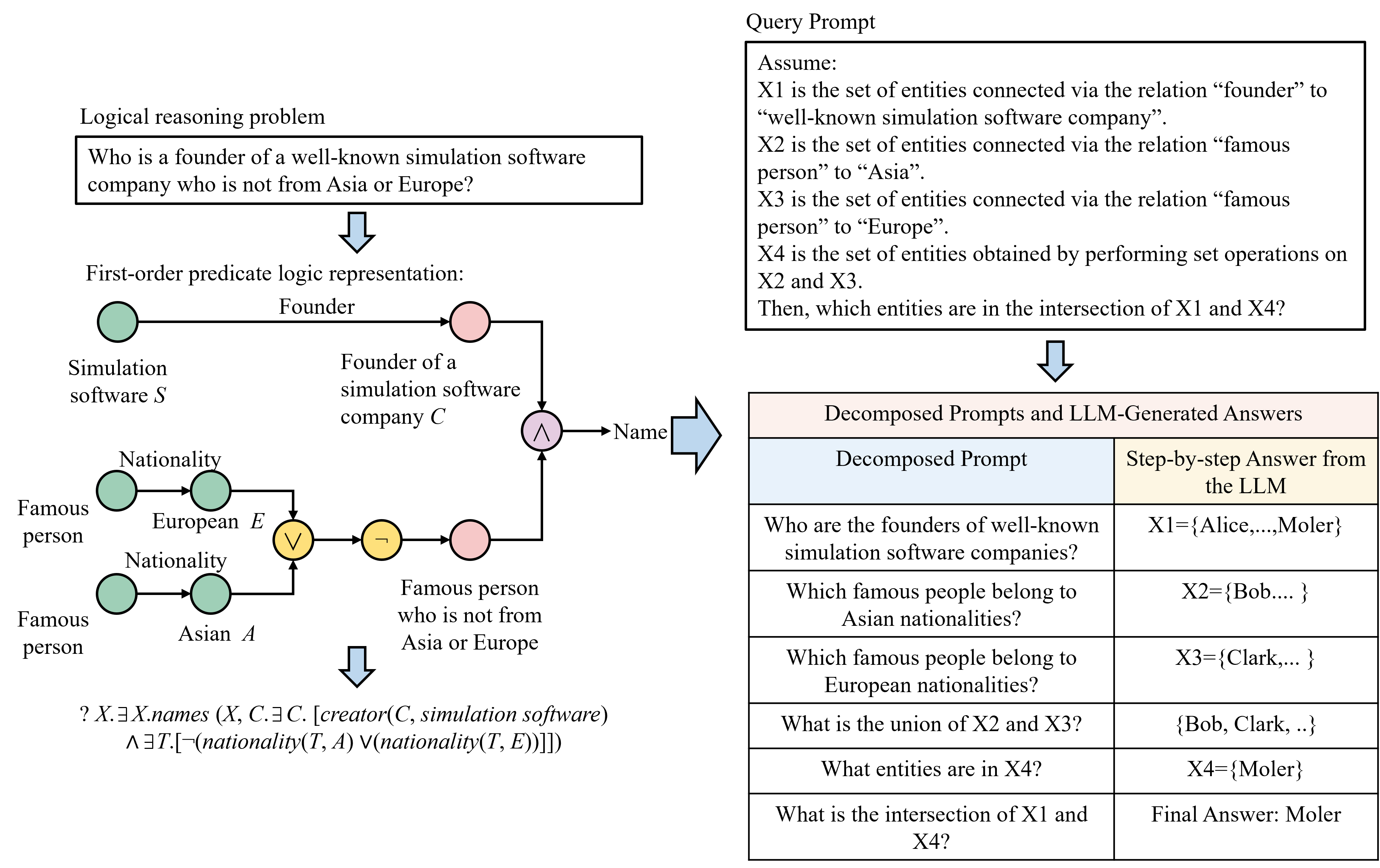

核心思路:论文的核心思路是将复杂的查询分解为一系列简单的子查询,并利用检索增强的方式,为每个子查询步骤提供相关的知识图谱邻域信息作为证据。通过结合大型语言模型的思维链推理能力,逐步推导出最终答案。这种方法避免了直接学习复杂算子,提高了推理的鲁棒性和可解释性。

技术框架:ROG框架主要包含以下几个模块:1) 查询分解模块:将复杂的一阶逻辑查询分解为一系列单算子子查询。2) 邻域检索模块:根据当前子查询,从知识图谱中检索相关的邻域信息作为证据。3) LLM推理模块:利用大型语言模型,基于检索到的邻域证据,进行思维链推理,得到当前子查询的答案。4) 缓存模块:缓存中间子查询的答案,并在后续步骤中重用,以提高推理效率和一致性。

关键创新:ROG的关键创新在于将检索增强与LLM推理相结合,用于解决知识图谱上的复杂逻辑查询。与传统的基于嵌入的方法相比,ROG不需要学习复杂的算子,而是通过检索相关的知识图谱信息,并利用LLM的推理能力,逐步推导出答案。这种方法具有更好的可解释性和泛化能力。

关键设计:ROG框架的关键设计包括:1) 查询分解策略:如何将复杂查询分解为一系列有效的子查询。2) 邻域检索策略:如何选择与当前子查询最相关的邻域信息。3) LLM推理提示:如何设计合适的提示,引导LLM进行有效的思维链推理。4) 缓存策略:如何有效地缓存和重用中间子查询的答案。论文中可能涉及一些超参数的设置,例如邻域检索的范围、LLM推理的步数等,但具体细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ROG在标准知识图谱推理基准上取得了显著的性能提升,尤其是在处理高复杂度和否定繁重的查询时。与基于嵌入的基线方法相比,ROG在某些查询类型上取得了超过10%的性能提升。这些结果表明,ROG框架能够有效地解决复杂一阶逻辑查询推理问题。

🎯 应用场景

ROG框架可应用于智能问答、知识发现、推荐系统等领域。例如,在智能问答中,可以利用ROG推理知识图谱中的复杂关系,从而回答用户提出的复杂问题。在知识发现中,可以利用ROG挖掘知识图谱中隐藏的逻辑规则。在推荐系统中,可以利用ROG推理用户与物品之间的潜在关联,从而提高推荐的准确性。该研究有助于提升AI系统在知识密集型任务中的推理能力。

📄 摘要(原文)

Answering first-order logic (FOL) queries over incomplete knowledge graphs (KGs) is difficult, especially for complex query structures that compose projection, intersection, union, and negation. We propose ROG, a retrieval-augmented framework that combines query-aware neighborhood retrieval with large language model (LLM) chain-of-thought reasoning. ROG decomposes a multi-operator query into a sequence of single-operator sub-queries and grounds each step in compact, query-relevant neighborhood evidence. Intermediate answer sets are cached and reused across steps, improving consistency on deep reasoning chains. This design reduces compounding errors and yields more robust inference on complex and negation-heavy queries. Overall, ROG provides a practical alternative to embedding-based logical reasoning by replacing learned operators with retrieval-grounded, step-wise inference. Experiments on standard KG reasoning benchmarks show consistent gains over strong embedding-based baselines, with the largest improvements on high-complexity and negation-heavy query types.