D-CORE: Incentivizing Task Decomposition in Large Reasoning Models for Complex Tool Use

作者: Bowen Xu, Shaoyu Wu, Hao Jiang, Kai Liu, Xin Chen, Lulu Hu, Bin Yang

分类: cs.CL

发布日期: 2026-02-02

🔗 代码/项目: GITHUB

💡 一句话要点

D-CORE:通过激励任务分解提升大型推理模型在复杂工具使用中的性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 大型推理模型 工具使用 任务分解 自蒸馏 强化学习 惰性推理 反思推理 BFCLv3

📋 核心要点

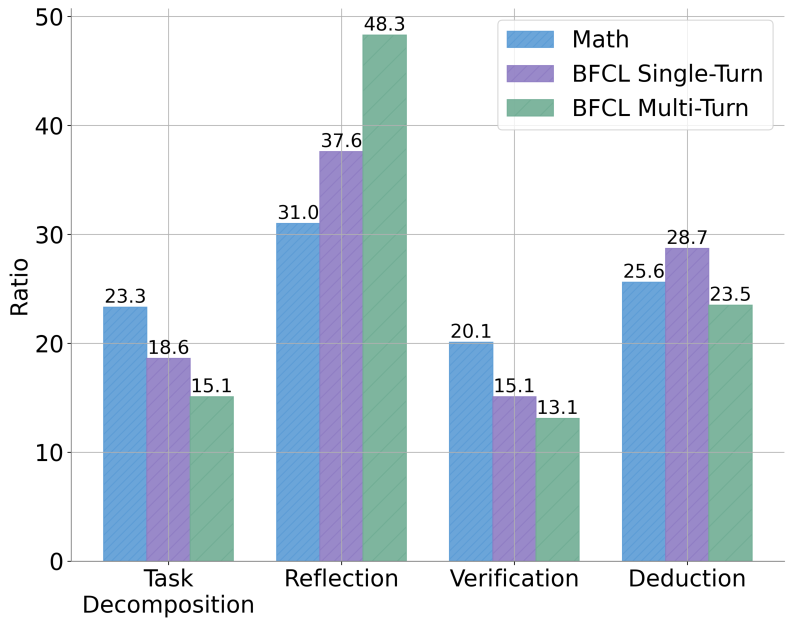

- 现有大型推理模型在复杂工具使用中存在惰性推理问题,缺乏有效的子任务分解能力。

- D-CORE框架通过自蒸馏激励任务分解,并利用多样性感知强化学习恢复反思推理能力。

- 实验表明,D-CORE在多个基准测试中显著提升了工具使用性能,并在BFCLv3上取得了SOTA结果。

📝 摘要(中文)

大型推理模型(LRM)有效使用工具和进行推理是解决复杂现实世界问题的关键能力。通过实证分析,我们发现当前的LRM在复杂工具使用场景中缺乏子任务分解能力,导致惰性推理。为了解决这个问题,我们提出了一个两阶段训练框架D-CORE(分解任务和组合推理过程),该框架首先通过自蒸馏来激励LRM的任务分解推理能力,然后通过多样性感知强化学习(RL)来恢复LRM的反思推理能力。D-CORE在不同的基准测试和模型规模上实现了强大的工具使用改进。在BFCLv3上的实验表明了我们方法的优越性:D-CORE-8B达到了77.7%的准确率,超过了性能最佳的8B模型5.7%。同时,D-CORE-14B建立了一个新的state-of-the-art,达到了79.3%,优于70B模型,尽管其规模小了5倍。

🔬 方法详解

问题定义:论文旨在解决大型推理模型(LRM)在复杂工具使用场景中存在的“惰性推理”问题。现有的LRM在面对需要分解成多个子任务才能完成的复杂任务时,往往无法有效地进行任务分解,导致推理效率低下,最终影响性能。这种现象的痛点在于,LRM无法充分利用工具,难以解决现实世界中的复杂问题。

核心思路:D-CORE的核心思路是分阶段地提升LRM的任务分解和反思推理能力。首先,通过自蒸馏的方式,让LRM学习如何将复杂任务分解为更小的、易于管理的子任务。然后,利用多样性感知强化学习,鼓励LRM探索不同的推理路径,从而恢复其反思推理能力。这种分阶段的方法旨在克服LRM在复杂工具使用中的固有缺陷。

技术框架:D-CORE框架包含两个主要阶段:1) 任务分解阶段:使用自蒸馏技术,训练LRM生成任务分解方案。具体来说,使用一个更强大的教师模型生成高质量的任务分解方案,然后训练学生模型模仿教师模型的行为。2) 反思推理阶段:使用多样性感知强化学习,训练LRM探索不同的推理路径,并从中学习。具体来说,设计一个奖励函数,鼓励LRM生成多样化的推理过程,并选择能够获得更高奖励的推理路径。

关键创新:D-CORE的关键创新在于其两阶段训练框架,该框架将任务分解和反思推理分开处理,并分别使用自蒸馏和多样性感知强化学习进行优化。这种方法能够更有效地提升LRM在复杂工具使用中的性能。与现有方法相比,D-CORE能够更好地激励LRM进行任务分解,并恢复其反思推理能力。

关键设计:在自蒸馏阶段,使用交叉熵损失函数来训练学生模型模仿教师模型的行为。在多样性感知强化学习阶段,使用策略梯度算法来训练LRM探索不同的推理路径。奖励函数的设计至关重要,它需要能够鼓励LRM生成多样化的推理过程,并选择能够获得更高奖励的推理路径。具体来说,奖励函数可以包含任务完成的奖励、推理步骤的惩罚以及多样性奖励。

🖼️ 关键图片

📊 实验亮点

D-CORE在BFCLv3基准测试中取得了显著的性能提升。D-CORE-8B达到了77.7%的准确率,超过了最佳8B模型5.7%。更令人印象深刻的是,D-CORE-14B达到了79.3%的准确率,超越了70B模型,同时模型规模缩小了5倍。这些结果表明D-CORE在提升工具使用能力方面具有显著优势。

🎯 应用场景

D-CORE的研究成果可广泛应用于需要复杂工具使用的场景,例如智能客服、自动化编程、科学研究等。通过提升大型推理模型在复杂任务中的工具使用能力,可以显著提高工作效率和问题解决能力。未来,该技术有望赋能更智能的机器人和自动化系统,从而在更多领域发挥重要作用。

📄 摘要(原文)

Effective tool use and reasoning are essential capabilities for large reasoning models~(LRMs) to address complex real-world problems. Through empirical analysis, we identify that current LRMs lack the capability of sub-task decomposition in complex tool use scenarios, leading to Lazy Reasoning. To address this, we propose a two-stage training framework D-CORE~(\underline{\textbf{D}}ecomposing tasks and \underline{\textbf{Co}}mposing \underline{\textbf{Re}}asoning processes) that first incentivize the LRMs' task decomposition reasoning capability via self-distillation, followed by diversity-aware reinforcement learning~(RL) to restore LRMs' reflective reasoning capability. D-CORE achieves robust tool-use improvements across diverse benchmarks and model scales. Experiments on BFCLv3 demonstrate superiority of our method: D-CORE-8B reaches 77.7\% accuracy, surpassing the best-performing 8B model by 5.7\%. Meanwhile, D-CORE-14B establishes a new state-of-the-art at 79.3\%, outperforming 70B models despite being 5$\times$ smaller. The source code is available at https://github.com/alibaba/EfficientAI.