S3-CoT: Self-Sampled Succinct Reasoning Enables Efficient Chain-of-Thought LLMs

作者: Yanrui Du, Sendong Zhao, Yibo Gao, Danyang Zhao, Qika Lin, Ming Ma, Jiayun Li, Yi Jiang, Kai He, Qianyi Xu, Bing Qin, Mengling Feng

分类: cs.CL

发布日期: 2026-02-02

🔗 代码/项目: GITHUB

💡 一句话要点

S3-CoT:自采样精简推理,实现高效思维链大语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 思维链 大语言模型 自采样 激活引导 高效推理 监督微调 知识推理

📋 核心要点

- 现有思维链(CoT)方法存在推理过程冗余的问题,限制了大语言模型(LLM)的效率和快速思考能力。

- 提出一种基于激活引导的自采样框架,从LLM自身生成风格对齐、长度可变的推理轨迹,无需人工标注。

- 实验表明,该方法在数学和医学等领域均能有效提升LLM的推理效率和泛化能力,且无需黄金答案。

📝 摘要(中文)

本文提出了一种基于激活引导的自采样框架,用于高效的思维链(CoT)学习。该方法能够从目标大语言模型(LLM)自身诱导出风格对齐且长度可变的推理轨迹,无需任何教师指导,从而缓解了基于SFT方法的核心瓶颈——高质量监督数据的稀缺性。通过使用黄金答案过滤数据,我们进行SFT以实现高效的CoT学习,构建(i)类人双认知系统,以及(ii)渐进式压缩课程。此外,我们探索了一种自我进化机制,其中SFT仅由预测一致的变长数据驱动,无需黄金答案。在数学基准测试以及医学领域的跨领域泛化测试中,大量实验表明,我们的方法为通用和R1风格的LLM带来了稳定的改进。数据和模型检查点可在https://github.com/DYR1/S3-CoT找到。

🔬 方法详解

问题定义:现有的大语言模型(LLM)在进行思维链(CoT)推理时,往往存在推理过程冗余的问题,导致效率低下。传统的CoT方法依赖于大量高质量的监督数据,而获取这些数据需要耗费大量的人力物力。因此,如何减少推理冗余,并在缺乏高质量监督数据的情况下,提升LLM的推理效率是一个关键问题。

核心思路:本文的核心思路是利用LLM自身的能力,通过自采样的方式生成风格对齐且长度可变的推理轨迹,从而避免对大量人工标注数据的依赖。通过激活引导技术,可以控制LLM的推理过程,使其产生更精简、更高效的推理路径。同时,利用黄金答案进行数据过滤,以及采用渐进式压缩课程,可以进一步提升模型的学习效率和推理能力。

技术框架:该方法主要包含以下几个阶段:1) 自采样阶段:利用激活引导技术,从目标LLM自身采样生成推理轨迹。2) 数据过滤阶段:使用黄金答案对采样数据进行过滤,保留高质量的推理轨迹。3) SFT训练阶段:使用过滤后的数据进行监督微调(SFT),训练高效的CoT模型。4) 自我进化阶段:利用预测一致的变长数据进行SFT,无需黄金答案,进一步提升模型性能。

关键创新:该方法最重要的创新点在于提出了一个完全基于LLM自身的自采样框架,无需任何人工标注数据。通过激活引导技术,可以控制LLM的推理过程,使其产生风格对齐且长度可变的推理轨迹。此外,该方法还探索了一种自我进化机制,利用预测一致的变长数据进行SFT,进一步提升了模型的性能。与现有方法的本质区别在于,该方法避免了对大量人工标注数据的依赖,从而降低了成本,并提升了效率。

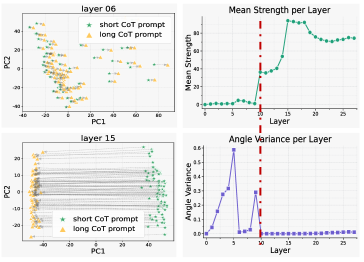

关键设计:在自采样阶段,使用了激活引导技术来控制LLM的推理过程。具体来说,通过调整特定神经元的激活值,可以影响LLM的推理路径,使其产生更精简、更高效的推理轨迹。在SFT训练阶段,采用了渐进式压缩课程,逐步减小推理轨迹的长度,从而提升模型的学习效率。损失函数方面,使用了标准的交叉熵损失函数。在自我进化阶段,使用了预测一致性作为筛选数据的标准,只保留那些预测结果与黄金答案一致的推理轨迹。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在数学基准测试中取得了显著的性能提升,并且在医学领域的跨领域泛化测试中也表现出色。具体来说,该方法在多个数学数据集上超越了现有的CoT方法,并且在医学问答数据集上取得了与人工标注数据训练的模型相媲美的性能。此外,该方法还能够在无需黄金答案的情况下,通过自我进化机制进一步提升模型性能。

🎯 应用场景

该研究成果可广泛应用于需要高效推理的大语言模型应用场景,例如智能客服、自动问答系统、医疗诊断辅助等。通过提升LLM的推理效率,可以降低计算成本,并提升用户体验。此外,该方法还可以应用于其他需要知识推理的领域,例如知识图谱推理、逻辑推理等,具有广阔的应用前景。

📄 摘要(原文)

Large language models (LLMs) equipped with chain-of-thought (CoT) achieve strong performance and offer a window into LLM behavior. However, recent evidence suggests that improvements in CoT capabilities often come with redundant reasoning processes, motivating a key question: Can LLMs acquire a fast-thinking mode analogous to human System 1 reasoning? To explore this, our study presents a self-sampling framework based on activation steering for efficient CoT learning. Our method can induce style-aligned and variable-length reasoning traces from target LLMs themselves without any teacher guidance, thereby alleviating a central bottleneck of SFT-based methods-the scarcity of high-quality supervision data. Using filtered data by gold answers, we perform SFT for efficient CoT learning with (i) a human-like dual-cognitive system, and (ii) a progressive compression curriculum. Furthermore, we explore a self-evolution regime in which SFT is driven solely by prediction-consistent data of variable-length variants, eliminating the need for gold answers. Extensive experiments on math benchmarks, together with cross-domain generalization tests in medicine, show that our method yields stable improvements for both general and R1-style LLMs. Our data and model checkpoints can be found at https://github.com/DYR1/S3-CoT.