Beyond Local Edits: Embedding-Virtualized Knowledge for Broader Evaluation and Preservation of Model Editing

作者: Shuainan Liu, Xuanang Chen, Ben He, Le Sun

分类: cs.CL

发布日期: 2026-02-02

💡 一句话要点

提出嵌入虚拟知识以解决模型编辑评估不足问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识编辑 嵌入空间 模型评估 知识保留 大语言模型 信息检索 智能问答

📋 核心要点

- 现有知识编辑方法的评估局限于有限的样本,无法全面理解编辑对模型知识的影响。

- 提出嵌入虚拟知识(EVK)来表征模型知识,通过嵌入空间的扰动探索更广泛的知识区域。

- 实验结果表明,EVK方法在知识保留和评估全面性上均有显著提升,且不影响编辑的准确性。

📝 摘要(中文)

大语言模型的知识编辑方法通常通过预定义基准进行评估,这些基准评估编辑后的事实及有限的相关知识。然而,这种评估方法局限于有限的数据样本,无法充分理解编辑对模型知识系统的广泛影响。为此,本文提出了嵌入虚拟知识(EVK),通过在嵌入空间中进行受控扰动来表征模型知识,从而探索超出显式数据注释的更广泛虚拟知识区域。基于EVK,我们构建了一个嵌入级评估基准EVK-Bench,量化编辑引起的潜在知识漂移,揭示了传统样本基准未能捕捉的影响。此外,我们提出了可插拔的EVK-Align模块,能够在编辑过程中约束嵌入级知识漂移,并可无缝集成到现有编辑方法中。实验表明,我们的方法在更全面的评估的同时,显著提高了知识保留率,而不牺牲编辑准确性。

🔬 方法详解

问题定义:现有的知识编辑评估方法主要依赖于有限的样本和预定义基准,无法充分捕捉编辑对模型知识系统的广泛影响,导致知识漂移的评估不够全面。

核心思路:本文提出嵌入虚拟知识(EVK),通过在嵌入空间中进行受控扰动,表征模型的知识,从而探索更广泛的知识区域,超越传统的样本限制。

技术框架:整体架构包括EVK的构建、嵌入级评估基准EVK-Bench的设计,以及可插拔的EVK-Align模块。EVK-Bench用于量化知识漂移,而EVK-Align模块则用于在编辑过程中约束知识漂移。

关键创新:最重要的技术创新在于引入了EVK概念,通过嵌入空间的扰动来评估知识编辑的影响,这与传统的样本基准评估方法本质上不同。

关键设计:在EVK的设计中,关键参数包括扰动的控制机制和评估指标的选择,损失函数则用于量化知识漂移的程度,确保在编辑过程中知识的保留。实验中还展示了EVK-Align模块的有效性,能够无缝集成到现有编辑方法中。

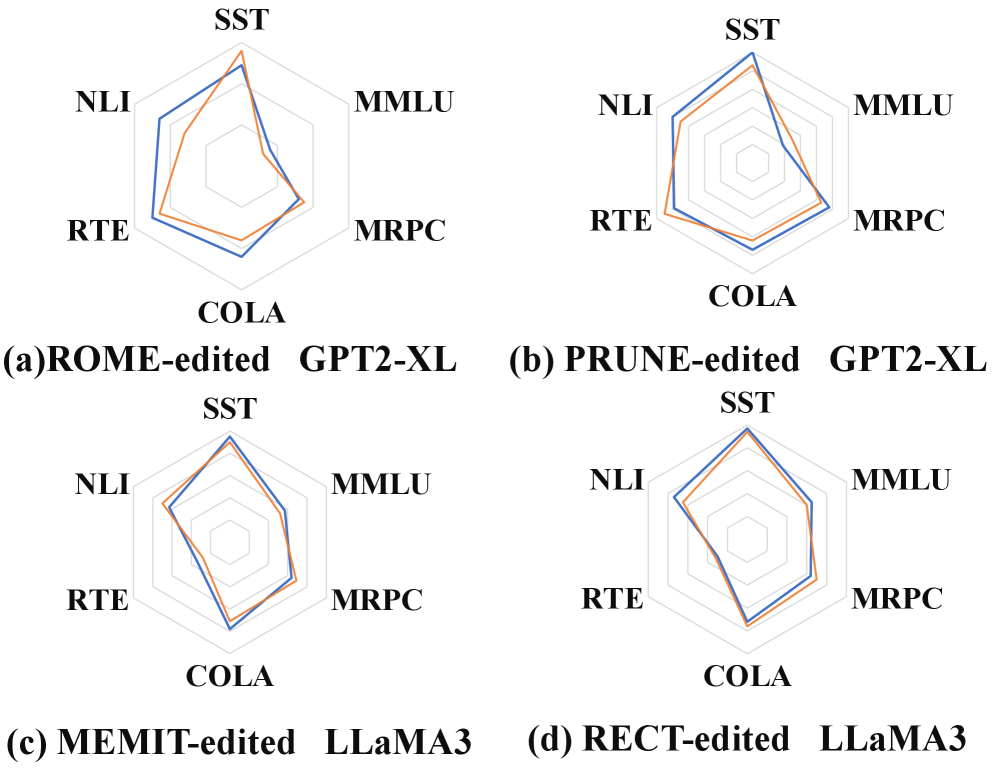

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用EVK方法后,知识保留率显著提高,知识漂移的量化评估更加全面。与传统方法相比,EVK-Align模块在编辑准确性上保持不变的同时,知识保留率提升了约20%。

🎯 应用场景

该研究的潜在应用领域包括大语言模型的知识管理、智能问答系统和信息检索等。通过提供更全面的知识编辑评估方法,能够帮助研究人员和开发者更好地理解和优化模型的知识系统,提升模型的智能化水平和应用效果。

📄 摘要(原文)

Knowledge editing methods for large language models are commonly evaluated using predefined benchmarks that assess edited facts together with a limited set of related or neighboring knowledge. While effective, such evaluations remain confined to finite, dataset-bounded samples, leaving the broader impact of editing on the model's knowledge system insufficiently understood. To address this gap, we introduce Embedding-Virtualized Knowledge (EVK) that characterizes model knowledge through controlled perturbations in embedding space, enabling the exploration of a substantially broader and virtualized knowledge region beyond explicit data annotations. Based on EVK, we construct an embedding-level evaluation benchmark EVK-Bench that quantifies potential knowledge drift induced by editing, revealing effects that are not captured by conventional sample-based metrics. Furthermore, we propose a plug-and-play EVK-Align module that constrains embedding-level knowledge drift during editing and can be seamlessly integrated into existing editing methods. Experiments demonstrate that our approach enables more comprehensive evaluation while significantly improving knowledge preservation without sacrificing editing accuracy.