AXE: Low-Cost Cross-Domain Web Structured Information Extraction

作者: Abdelrahman Mansour, Khaled W. Alshaer, Moataz Elsaban

分类: cs.CL

发布日期: 2026-02-02

💡 一句话要点

AXE:提出一种低成本的跨领域网页结构化信息抽取方法,利用小型LLM实现高效抽取。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 网页信息抽取 结构化数据 低成本 零样本学习 HTML DOM XPath 语言模型

📋 核心要点

- 现有网页信息抽取方法要么依赖脆弱的手动规则,要么需要高成本的大型语言模型,缺乏成本效益。

- AXE通过将HTML DOM视为树结构,采用“修剪”机制去除冗余信息,从而降低了对大型语言模型的依赖。

- AXE在SWDE数据集上实现了88.1%的F1分数,超越了许多大型的、完全训练的模型,展示了其优越的零样本性能。

📝 摘要(中文)

从网页中提取结构化数据通常需要在手动启发式的脆弱性和大型语言模型的高昂成本之间进行权衡。本文提出了一种名为AXE(自适应X-Path提取器)的流程,它将HTML DOM视为需要修剪的树,而不仅仅是要阅读的文本墙。AXE使用专门的“修剪”机制来去除样板和不相关的节点,留下精简的、高密度的上下文,从而允许一个微小的0.6B LLM生成精确的结构化输出。为了保证模型的可信度,我们实现了Grounded XPath Resolution (GXR),确保每次提取都可以物理地追溯到源节点。尽管其占用空间很小,但AXE实现了最先进的零样本性能,在SWDE数据集上以88.1%的F1分数优于几种更大的、完全训练的替代方案。通过发布我们专门的适配器,我们的目标是为大规模Web信息提取提供一种实用、经济高效的途径。

🔬 方法详解

问题定义:现有网页信息抽取方法面临着手动规则的脆弱性和大型语言模型的高成本之间的矛盾。手动规则难以适应不同网站的结构变化,而大型语言模型虽然效果好,但计算资源消耗巨大,难以大规模应用。因此,需要一种低成本、高精度的跨领域网页结构化信息抽取方法。

核心思路:AXE的核心思路是将HTML DOM树视为需要修剪的结构,通过去除不相关的节点和样板信息,提取出包含关键信息的精简子树。这样可以显著降低后续语言模型处理的数据量,从而可以使用更小的模型,降低计算成本。同时,通过Grounded XPath Resolution (GXR) 保证抽取结果的可追溯性,提高抽取结果的可靠性。

技术框架:AXE的整体流程包括以下几个主要阶段:1) HTML DOM树构建:将网页转换为DOM树结构。2) 节点修剪:使用特定的修剪算法去除DOM树中的冗余节点,例如广告、导航栏等。3) 上下文提取:从修剪后的DOM树中提取关键信息上下文。4) 结构化信息生成:使用小型语言模型根据提取的上下文生成结构化数据。5) GXR验证:使用GXR验证抽取结果是否可追溯到原始DOM树节点。

关键创新:AXE的关键创新在于其“修剪”机制和Grounded XPath Resolution (GXR)。修剪机制能够有效地去除DOM树中的冗余信息,降低了对大型语言模型的依赖。GXR则保证了抽取结果的可追溯性,提高了抽取结果的可靠性。此外,AXE还针对网页结构化信息抽取任务,对小型语言模型进行了专门的适配。

关键设计:AXE的修剪机制采用了基于规则和机器学习相结合的方法。规则用于去除一些常见的冗余节点,例如广告、导航栏等。机器学习模型则用于识别更复杂的冗余节点。GXR通过记录每个抽取结果对应的XPath路径,并验证该路径是否指向原始DOM树中的有效节点来实现。小型语言模型使用了0.6B参数的规模,并针对网页结构化信息抽取任务进行了微调。

🖼️ 关键图片

📊 实验亮点

AXE在SWDE数据集上取得了88.1%的F1分数,超越了许多参数量更大的、完全训练的模型,证明了其在零样本学习方面的优越性能。尤其值得一提的是,AXE仅使用了0.6B参数的小型语言模型,在保证性能的同时,显著降低了计算成本。这使得AXE成为一种极具竞争力的网页结构化信息抽取解决方案。

🎯 应用场景

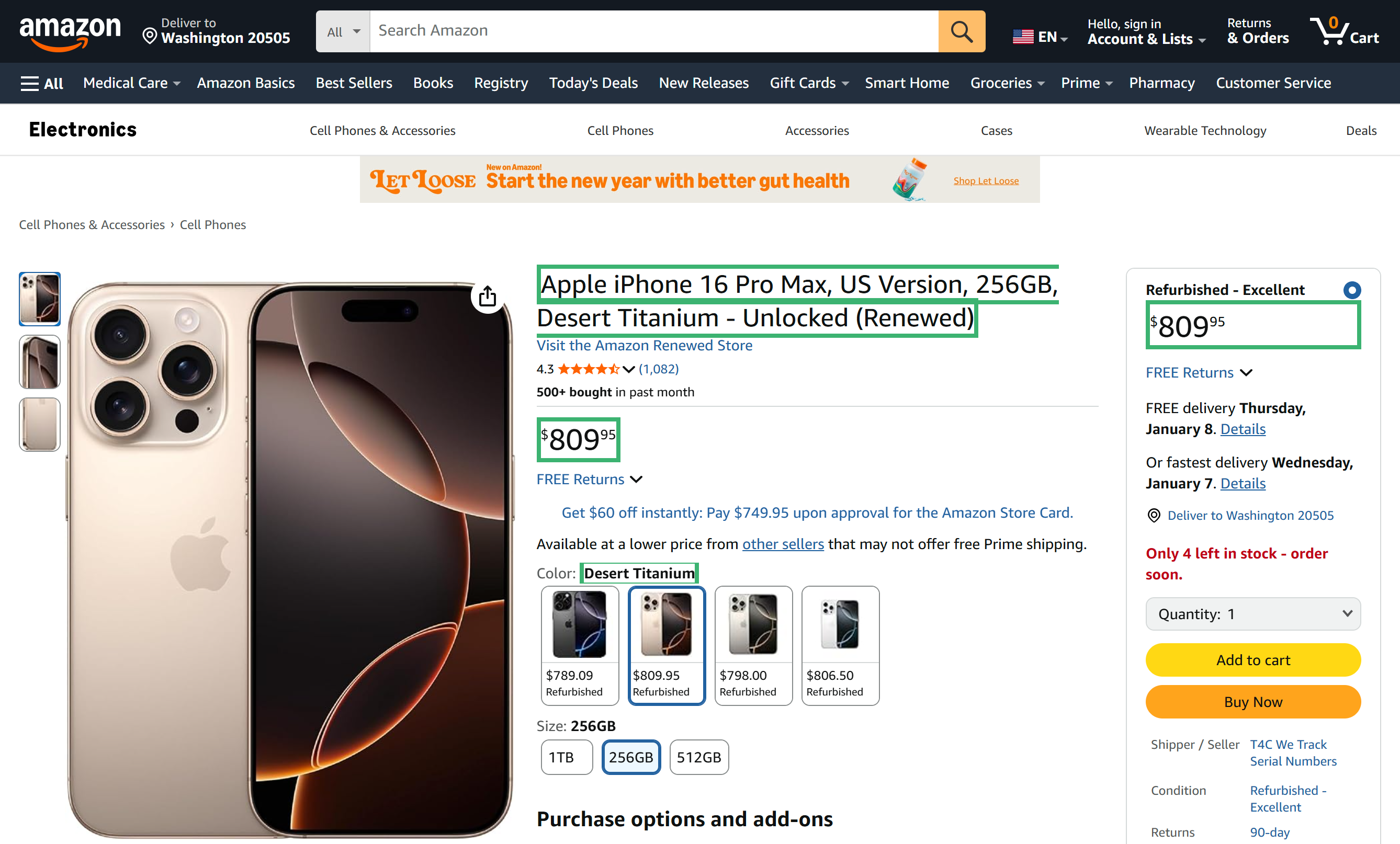

AXE可应用于各种需要从网页中提取结构化信息的场景,例如:电商商品信息抓取、新闻文章信息提取、招聘信息聚合等。其低成本的特性使其能够大规模部署,为企业和研究机构提供高效、经济的网页数据获取解决方案。未来,AXE可以进一步扩展到更多领域,例如:金融数据分析、舆情监控等。

📄 摘要(原文)

Extracting structured data from the web is often a trade-off between the brittle nature of manual heuristics and the prohibitive cost of Large Language Models. We introduce AXE (Adaptive X-Path Extractor), a pipeline that rethinks this process by treating the HTML DOM as a tree that needs pruning rather than just a wall of text to be read. AXE uses a specialized "pruning" mechanism to strip away boilerplate and irrelevant nodes, leaving behind a distilled, high-density context that allows a tiny 0.6B LLM to generate precise, structured outputs. To keep the model honest, we implement Grounded XPath Resolution (GXR), ensuring every extraction is physically traceable to a source node. Despite its low footprint, AXE achieves state-of-the-art zero-shot performance, outperforming several much larger, fully-trained alternatives with an F1 score of 88.1% on the SWDE dataset. By releasing our specialized adaptors, we aim to provide a practical, cost-effective path for large-scale web information extraction.