CodeOCR: On the Effectiveness of Vision Language Models in Code Understanding

作者: Yuling Shi, Chaoxiang Xie, Zhensu Sun, Yeheng Chen, Chenxu Zhang, Longfei Yun, Chengcheng Wan, Hongyu Zhang, David Lo, Xiaodong Gu

分类: cs.CL, cs.SE

发布日期: 2026-02-02

备注: Code and data are available at https://github.com/YerbaPage/CodeOCR

💡 一句话要点

CodeOCR:探索视觉语言模型在代码理解中的有效性,实现高效代码表示。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码理解 视觉语言模型 多模态学习 代码压缩 计算效率

📋 核心要点

- 现有代码理解模型依赖文本token序列,导致计算成本随代码长度线性增长,效率受限。

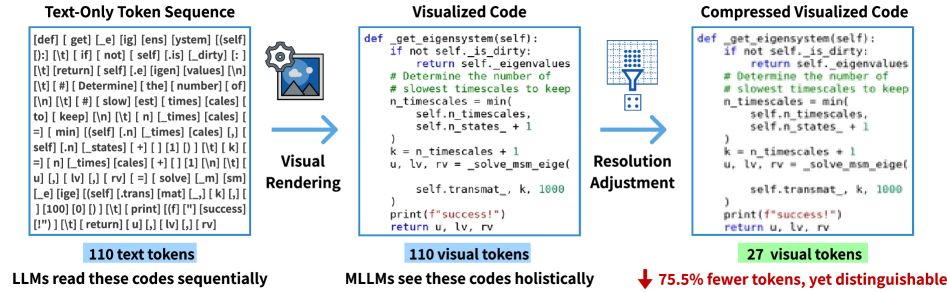

- 提出CodeOCR,将源代码渲染为图像,利用MLLM进行理解,图像天然适合压缩,降低计算负担。

- 实验表明,MLLM能有效理解压缩后的代码图像,在代码补全和克隆检测任务中表现良好。

📝 摘要(中文)

大型语言模型(LLM)在源代码理解方面取得了显著成功,但随着软件系统规模的增长,计算效率已成为一个关键瓶颈。目前,这些模型依赖于一种基于文本的范式,将源代码视为一个线性的token序列,导致上下文长度线性增加,计算成本也随之增加。多模态LLM(MLLM)的快速发展提供了一个通过将源代码表示为渲染图像来优化效率的机会。与难以在不损失语义意义的情况下压缩的文本不同,图像模态本质上适合压缩。通过调整分辨率,图像可以缩放到原始token成本的一小部分,同时保持视觉模型的可识别性。为了探索这种方法的可行性,我们首次对MLLM在代码理解中的有效性进行了系统的研究。我们的实验表明:(1)MLLM可以有效地理解代码,并大幅减少token数量,实现高达8倍的压缩;(2)MLLM可以有效地利用语法高亮等视觉线索,在4倍压缩下提高代码补全性能;(3)像克隆检测这样的代码理解任务对视觉压缩表现出极强的鲁棒性,在某些压缩比下甚至略优于原始文本输入。我们的研究结果突出了MLLM在代码理解中的潜力和当前局限性,这表明转向图像模态代码表示是实现更高效推理的一种途径。

🔬 方法详解

问题定义:现有基于文本的LLM在处理大规模代码时,由于token数量线性增长,计算效率成为瓶颈。传统方法难以在不损失语义信息的前提下有效压缩代码表示,限制了模型在资源受限环境下的应用。

核心思路:将源代码渲染成图像,利用MLLM处理。图像本身具有空间结构和视觉特征,且可以通过调整分辨率进行压缩,从而在降低计算成本的同时保留代码的关键信息。这种方法旨在利用MLLM的视觉理解能力,克服传统文本方法的局限性。

技术框架:该研究主要通过实验评估MLLM在不同代码理解任务中的表现。首先,将源代码渲染成图像,然后使用不同的压缩比率调整图像分辨率。接着,将压缩后的图像输入到MLLM中,执行代码补全和克隆检测等任务。最后,分析MLLM在不同压缩比率下的性能表现,并与基于文本的LLM进行比较。

关键创新:该研究的关键创新在于将代码理解问题从传统的文本领域扩展到视觉领域,利用图像压缩技术降低计算成本。通过将源代码表示为图像,并利用MLLM的视觉理解能力,实现了在大幅减少token数量的同时保持甚至提高代码理解性能。

关键设计:实验中,使用了不同的压缩比率(例如,4倍和8倍)来评估MLLM在不同分辨率下的性能。针对代码补全任务,采用了标准的代码补全指标来评估模型的准确性。针对克隆检测任务,采用了精确率和召回率等指标来评估模型的性能。此外,还比较了MLLM与基于文本的LLM在相同任务上的性能,以评估视觉方法的优势。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MLLM在代码理解方面具有显著的潜力。在高达8倍的压缩率下,MLLM仍能有效理解代码。在4倍压缩率下,MLLM利用语法高亮等视觉线索,提高了代码补全性能。在克隆检测任务中,某些压缩比率下,MLLM甚至优于原始文本输入。这些结果表明,基于图像的代码表示方法具有很高的效率和鲁棒性。

🎯 应用场景

该研究成果可应用于资源受限环境下的代码理解和分析,例如移动设备或嵌入式系统。通过将代码表示为图像并进行压缩,可以降低计算成本,提高代码分析的效率。此外,该方法还可以应用于代码安全分析、代码生成和代码搜索等领域,具有广阔的应用前景。

📄 摘要(原文)

Large Language Models (LLMs) have achieved remarkable success in source code understanding, yet as software systems grow in scale, computational efficiency has become a critical bottleneck. Currently, these models rely on a text-based paradigm that treats source code as a linear sequence of tokens, which leads to a linear increase in context length and associated computational costs. The rapid advancement of Multimodal LLMs (MLLMs) introduces an opportunity to optimize efficiency by representing source code as rendered images. Unlike text, which is difficult to compress without losing semantic meaning, the image modality is inherently suitable for compression. By adjusting resolution, images can be scaled to a fraction of their original token cost while remaining recognizable to vision-capable models. To explore the feasibility of this approach, we conduct the first systematic study on the effectiveness of MLLMs for code understanding. Our experiments reveal that: (1) MLLMs can effectively understand code with substantial token reduction, achieving up to 8x compression; (2) MLLMs can effectively leverage visual cues such as syntax highlighting, improving code completion performance under 4x compression; and (3) Code-understanding tasks like clone detection exhibit exceptional resilience to visual compression, with some compression ratios even slightly outperforming raw text inputs. Our findings highlight both the potential and current limitations of MLLMs in code understanding, which points out a shift toward image-modality code representation as a pathway to more efficient inference.